Quando a IA Discrepa, a Confiança Surge:

A Revolução da Responsabilidade Multimodal da Mira

Artigo Redefinido para Máximo Impacto

@Mira - Trust Layer of AI #Mira

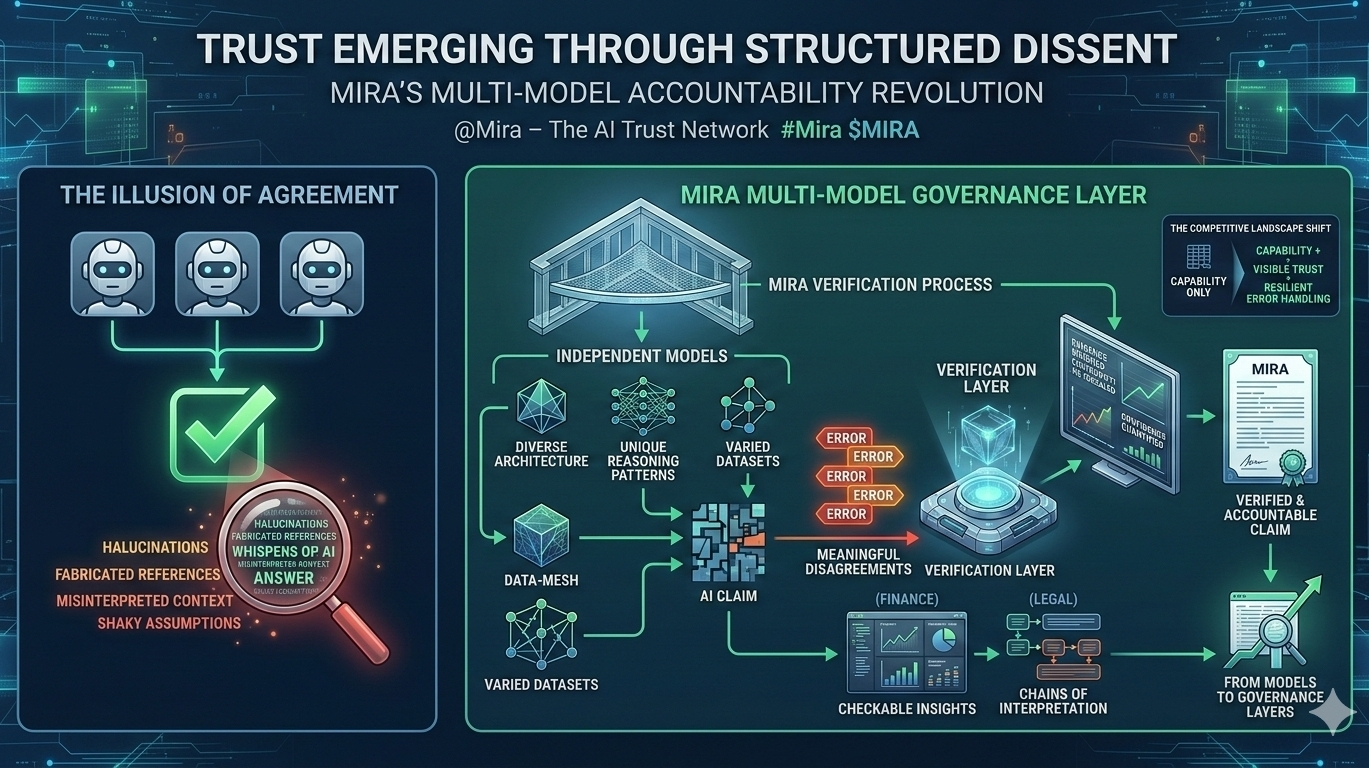

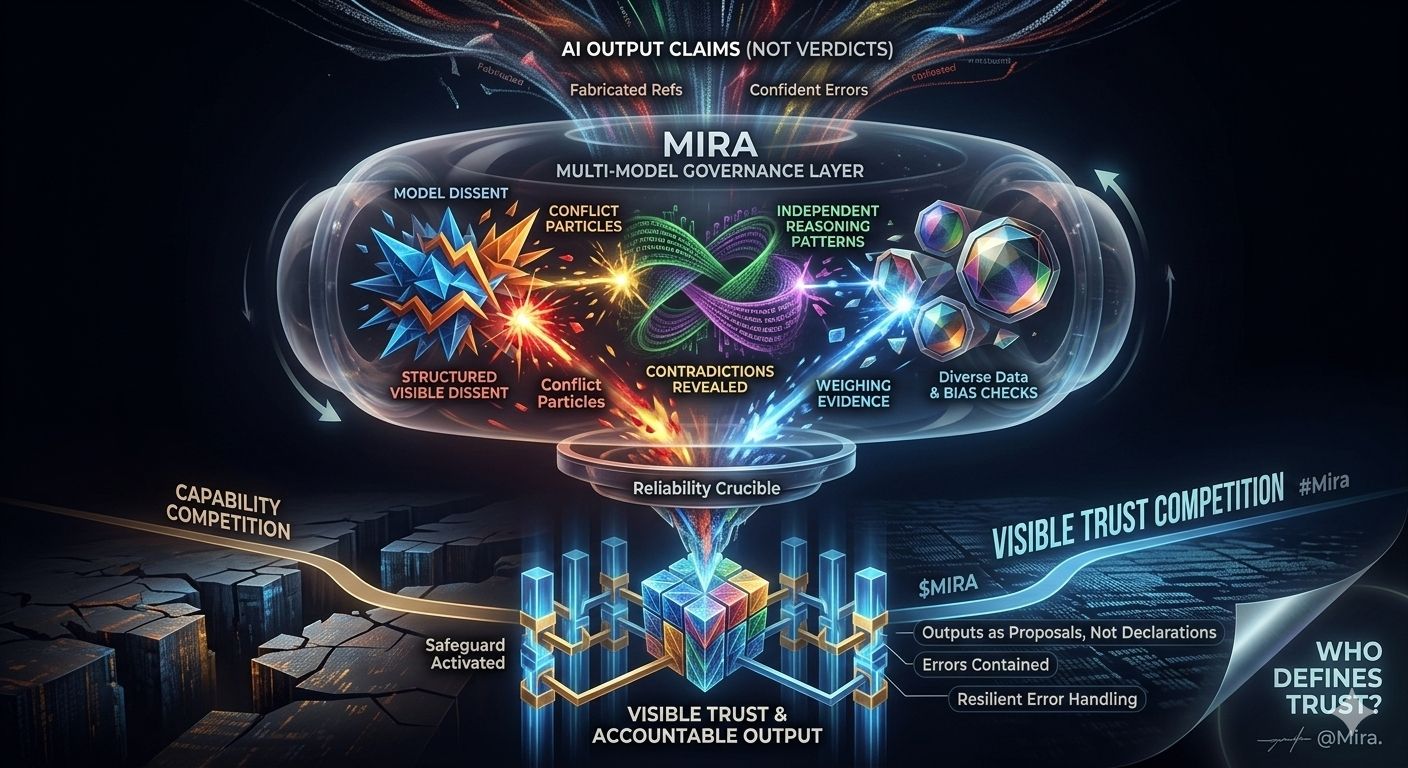

A confiabilidade em IA não se trata de respostas unânimes—trata-se de como os sistemas lidam com a dissidência. O acordo pode parecer tranquilizador, mas pode ocultar falhas sutis: fatos mal interpretados, referências fabricadas ou raciocínios confiantes, mas instáveis. A verdadeira confiança emerge quando a discordância é estruturada, visível e verificável.

A maioria das falhas da IA são sussurros sutis: uma cláusula mal interpretada, um contexto negligenciado, uma saída confiante construída sobre suposições instáveis. A autocorreção por um único modelo frequentemente amplifica os mesmos erros. A Mira inverte esse paradigma: cada saída da IA é uma afirmação, não um veredicto. Múltiplos modelos independentes examinam a afirmação, cada um contribuindo com dados diversos, padrões de raciocínio e viés arquitetônico. A verificação não se trata do modelo mais audível—trata-se de como as evidências são pesadas, as contradições reveladas e a confiança quantificada.

O consenso é sutil. Dois modelos podem concordar enquanto um discorda—o outlier está identificando uma falha real ou está alucinando? O sistema da Mira identifica desacordos significativos versus ruído. Saídas complexas se transformam em declarações verificáveis: resumos financeiros se tornam percepções verificáveis, argumentos legais se transformam em cadeias de interpretação. Modelos não precisam ser mais inteligentes—alegações se tornam testáveis e responsáveis.

A confiança muda dos modelos para as camadas de governança. As saídas são credíveis não porque um modelo disse isso, mas porque sistemas independentes chegaram a conclusões compatíveis. A transparência é a chave: dados sobrepostos ou arquiteturas semelhantes podem enviesar o consenso, então a diversidade é uma salvaguarda de confiabilidade.

A verificação tem um custo—latência, computação, supervisão humana. Aplicações que integram IA agora se tornam orquestradores de confiabilidade, gerenciando trade-offs entre velocidade e certeza. Isso transforma o cenário competitivo: a IA competirá não apenas em capacidade, mas em confiança visível, desacordo estruturado e manejo resiliente de erros.

A governança multi-modelo da Mira é mais do que uma característica—é uma camada de responsabilidade. As saídas da IA se tornam propostas, não declarações. Erros são inevitáveis, mas o sistema os contém antes que se espalhem para decisões do mercado ou discurso público.

A pergunta definitiva: quem define a confiança, como é interpretada a dissensão e quais salvaguardas se ativam quando o consenso oscila? É aí que a confiabilidade da IA realmente reside.

$MIRA