A conversa em torno da inteligência artificial está se expandindo rapidamente pelo mundo da tecnologia. Toda semana vemos novos modelos, novas capacidades e novas aplicações surgindo. Mas, juntamente com esse progresso rápido, outra pergunta continua a crescer: como verificamos as saídas produzidas pelos sistemas de IA?

A inteligência artificial pode analisar conjuntos de dados massivos, gerar insights e automatizar processos mais rapidamente do que nunca. No entanto, a velocidade por si só não garante confiabilidade. À medida que a IA se integra a sistemas críticos, garantir que as saídas sejam confiáveis se torna cada vez mais importante.

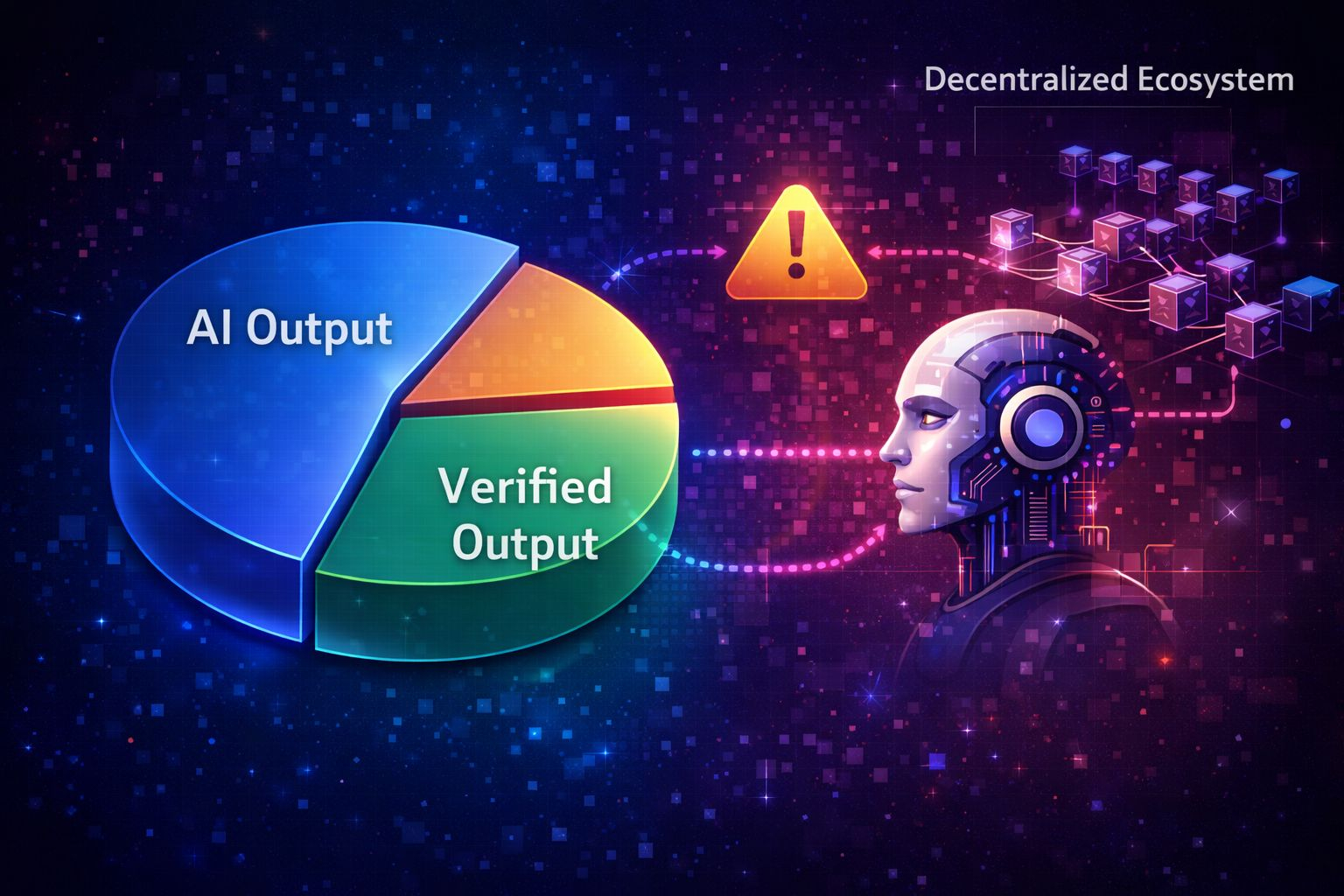

Este desafio se torna ainda mais complexo em ecossistemas descentralizados. Em plataformas centralizadas tradicionais, os usuários costumam confiar na credibilidade das empresas que operam o sistema. Mas em ambientes Web3, a confiança precisa vir de mecanismos transparentes em vez de autoridade centralizada.

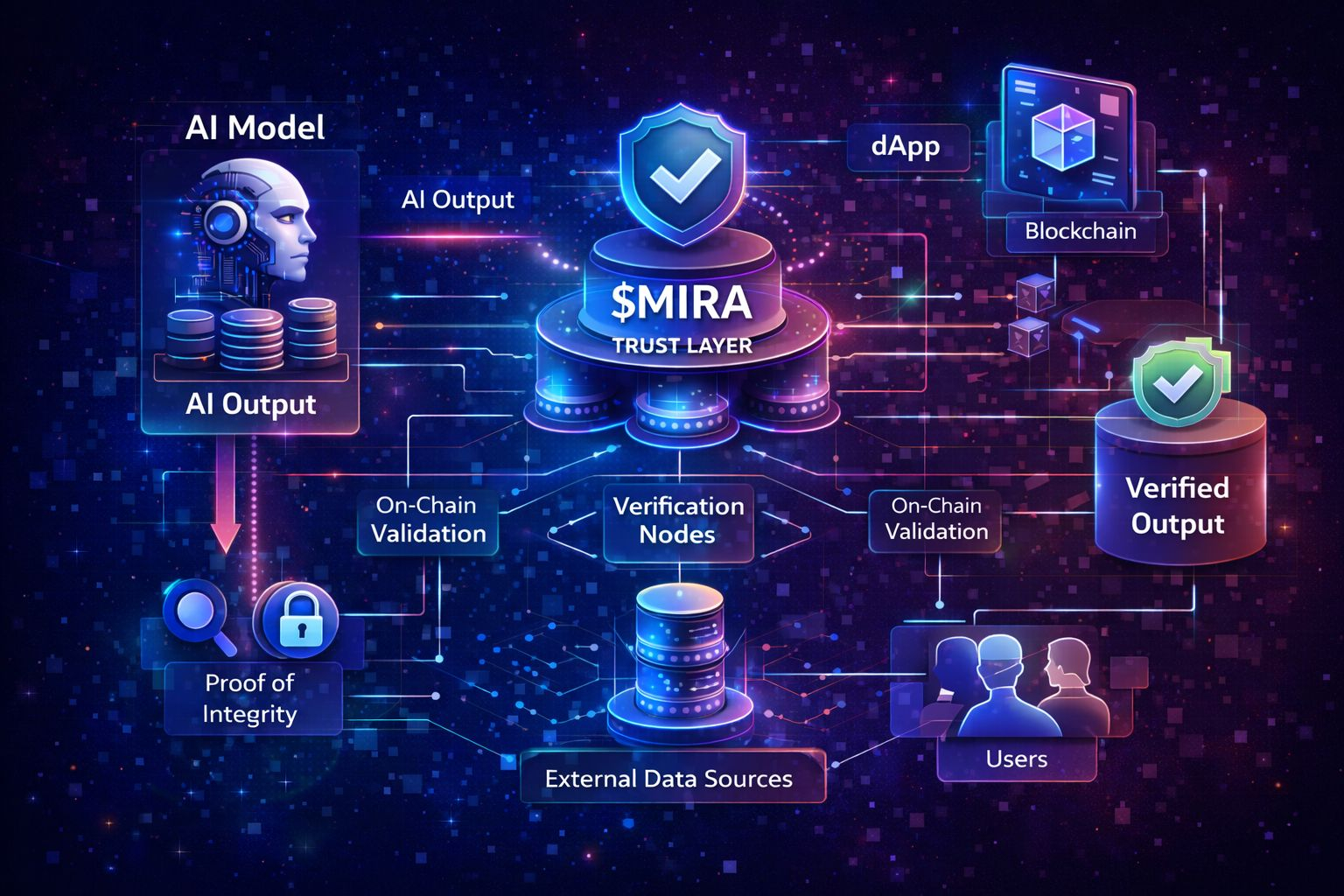

Esta é uma das razões pelas quais projetos que exploram infraestrutura de verificação estão ganhando atenção. Enquanto pesquisava diferentes abordagens, comecei a olhar mais profundamente para a ideia por trás da @mira_network e como $MIRA visa explorar o conceito de uma camada de confiança para IA.

A ideia é interessante porque as saídas de IA muitas vezes são difíceis de verificar rapidamente. Um modelo de IA pode produzir uma resposta em segundos, mas verificar essa resposta pode exigir tempo, especialização e acesso a fontes de dados confiáveis. Esse desequilíbrio entre geração e verificação cria desafios potenciais à medida que a adoção de IA aumenta.

Se aplicações descentralizadas começarem a depender de insights impulsionados por IA, sistemas devem existir para confirmar que esses insights atendem aos padrões de confiabilidade. Camadas de verificação poderiam ajudar a fornecer transparência e confiança quando sistemas de IA interagem com aplicações baseadas em blockchain.

Outra razão pela qual este tópico é importante é a crescente sobreposição entre IA e Web3. Redes blockchain já estão sendo usadas para sistemas financeiros, propriedade digital, mecanismos de governança e infraestrutura distribuída. À medida que ferramentas de IA se integram a esses ambientes, garantir saídas confiáveis se torna um fator crítico.

Projetos como @mira_network estão explorando como a infraestrutura descentralizada pode apoiar processos de verificação de IA. O conceito por trás de $MIRA se concentra na construção de estruturas que permitem que resultados de IA sejam validados em vez de aceitos cegamente.

Essa abordagem poderia potencialmente ajudar a fortalecer a confiabilidade de aplicações impulsionadas por IA em ecossistemas Web3. Seja na análise de dados, governança descentralizada ou processos automatizados, mecanismos de verificação poderiam fornecer confiança adicional para usuários que interagem com sistemas de IA.

Durante a campanha #Mira, observar como a comunidade reage a essas ideias tem sido bastante interessante. Períodos de campanha frequentemente trazem novos participantes que começam a explorar a visão do projeto e discutir as implicações mais amplas da verificação de IA.

De muitas maneiras, a próxima fase do desenvolvimento da IA pode não se concentrar apenas na inteligência, mas também na credibilidade. Sistemas capazes de gerar insights poderosos também devem fornecer maneiras para que esses insights sejam validados.

É por isso que conversas em torno de camadas de confiança, estruturas de verificação e infraestrutura de IA descentralizada estão se tornando cada vez mais importantes.

Assistir como essas ideias se desenvolvem ao redor da @mira_network e $MIRA fornece um vislumbre interessante de como a comunidade Web3 está pensando sobre o futuro relacionamento entre IA e confiança.