Como alguém que passa muito tempo analisando ferramentas e infraestrutura de IA, um problema continua aparecendo - os modelos de IA são poderosos, mas nem sempre são confiáveis. Qualquer um que tenha trabalhado com grandes modelos de linguagem sabe que alucinações e saídas incorretas ainda podem acontecer.

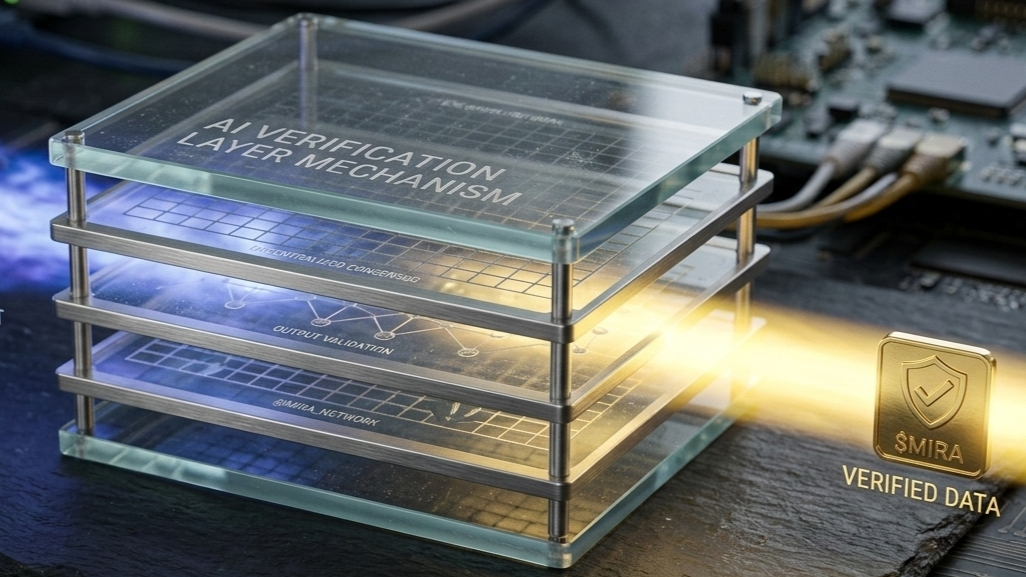

É por isso que a abordagem adotada pelo @Mira - Trust Layer of AI chamou minha atenção. Em vez de simplesmente focar em modelos mais rápidos ou conjuntos de dados maiores, o projeto está trabalhando em uma camada de verificação para saídas de IA. A ideia é bastante simples: em vez de confiar cegamente no que um modelo de IA produz, a rede pode validar as respostas usando mecanismos de verificação descentralizados.

Do ponto de vista de um desenvolvedor, isso poderia ser extremamente útil. À medida que mais aplicações começam a usar agentes de IA, sistemas de automação e serviços em cadeia, ter uma maneira de verificar criptograficamente as saídas poderia reduzir o risco e melhorar a confiança nos processos automatizados.

Isso também abre a porta para sistemas de IA que interagem diretamente com ambientes de blockchain. Se as saídas puderem ser verificadas por uma rede, os desenvolvedores poderão criar aplicações mais confiáveis impulsionadas por IA sem depender de um único provedor confiável.

É por isso que estou de olho no $MIRA. Se o ecossistema em torno de @Mira - Trust Layer of AI continuar a se desenvolver, o projeto pode se tornar uma peça importante da emergente pilha de infraestrutura AI+crypto.

Curioso para ver como os construtores começam a experimentar isso nos próximos meses.