Quando ouço pela primeira vez a frase "inteligência artificial verificada", minha reação não é a excitação imediata que geralmente envolve os novos anúncios de infraestrutura de IA, mas uma sensação mais silenciosa de reconhecimento, porque isso reconhece algo que as pessoas que trabalham de perto com sistemas de aprendizado de máquina sabem há muito tempo, que é que a verdadeira barreira para uma IA confiável nunca foi a geração de saídas, mas a capacidade de provar que essas saídas foram produzidas de maneira confiável, rastreável e verificável, em vez de emergirem de uma caixa-preta que ninguém pode auditar ou reproduzir com confiança.

Durante anos, a conversa em torno da inteligência artificial se concentrou na capacidade, escala e velocidade, o que levou ao rápido lançamento de modelos cada vez mais poderosos que podem gerar texto, código, imagens e decisões com notável fluência, no entanto, esse progresso também expôs uma fraqueza fundamental que se torna impossível de ignorar à medida que esses sistemas começam a influenciar decisões financeiras, conclusões de pesquisa e infraestrutura digital, pois os usuários são frequentemente solicitados a confiar em saídas que não podem verificar de forma independente, e os desenvolvedores são esperados para defender modelos cujos processos de raciocínio permanecem em grande parte opacos.

O modelo tradicional de implantação de IA coloca o ônus da confiança no usuário, o que significa que indivíduos, organizações e plataformas devem decidir se acreditam nas saídas de um sistema sem ter uma maneira clara de verificar a integridade da computação que a produziu, e enquanto esse arranjo pode funcionar para tarefas de baixo risco, como gerar cópias de marketing ou resumir documentos, rapidamente se torna frágil quando a IA começa a participar de sistemas onde precisão, responsabilidade e transparência não são características opcionais, mas requisitos fundamentais.

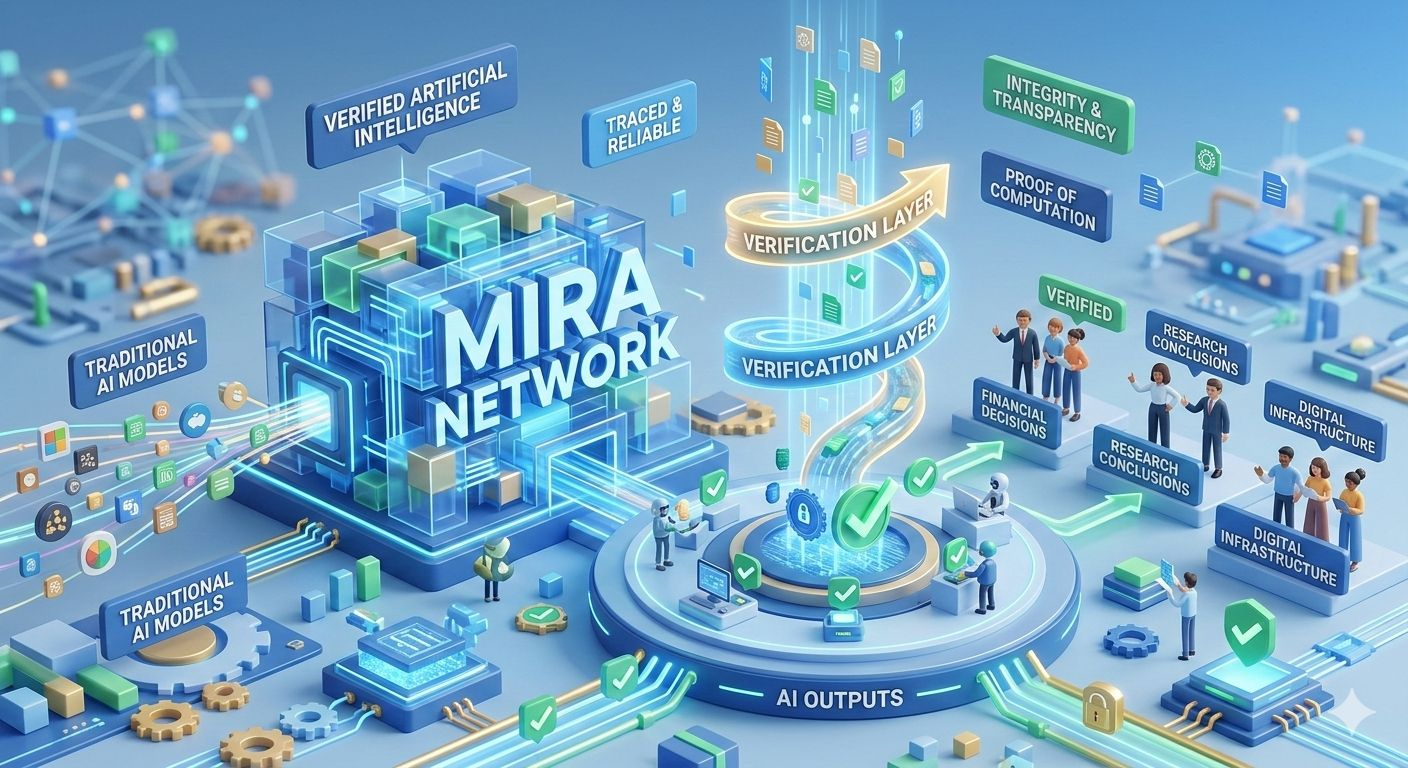

Este é o contexto em que a Rede Mira começa a importar, porque o conceito por trás dela não é simplesmente criar outra plataforma de inteligência artificial ou competir na corrida por modelos maiores, mas sim introduzir uma camada de verificação que permite que as saídas da IA sejam acompanhadas por prova criptográfica ou computacional de que o processo subjacente ocorreu exatamente como afirmado, transformando efetivamente a IA de um sistema que apenas produz respostas em um sistema que pode demonstrar a integridade de como aquelas respostas foram produzidas.

Uma vez que a conversa muda de geração para verificação, um novo conjunto de questões de infraestrutura aparece imediatamente, porque produzir resultados de IA verificáveis requer mais do que executar um modelo em um servidor e retornar uma saída, pois envolve rastrear etapas computacionais, ancorar estruturas de prova, coordenar processos de verificação entre participantes distribuídos e garantir que o custo e a latência da verificação permaneçam práticos o suficiente para apoiar aplicações reais, em vez de se tornarem uma garantia teórica que poucos sistemas podem se dar ao luxo de usar.

O que emerge dessa arquitetura não é apenas uma melhoria técnica, mas uma mudança estrutural em como os sistemas de inteligência artificial são integrados em ecossistemas digitais, porque a verificação introduz uma nova camada operacional que se coloca entre a computação bruta da IA e o consumo do usuário, e essa camada começa a se assemelhar à infraestrutura da mesma forma que processadores de pagamento, provedores de nuvem e validadores de blockchain formam componentes invisíveis, mas essenciais, dos serviços digitais modernos.

As implicações dessa mudança tornam-se mais claras quando se considera como a confiança atualmente opera na indústria de IA, onde a credibilidade é frequentemente concentrada em um punhado de grandes organizações cujos modelos são aceitos em grande parte devido à reputação da marca, prestígio da pesquisa ou dominância da plataforma, o que significa que os usuários, em última análise, confiam em instituições em vez da integridade verificável da própria computação, criando uma estrutura de dependência que funciona apenas enquanto essas instituições permanecerem competentes e benevolentes.

Uma rede de verificação muda essa dinâmica, distribuindo a responsabilidade da validação por meio de um sistema mais amplo de participantes que podem confirmar de forma independente que uma execução de modelo particular seguiu um conjunto específico de regras ou computações, o que gradualmente transforma a confiança de uma promessa institucional em uma propriedade técnica que pode ser verificada, reproduzida e validada, independentemente de qual entidade originalmente gerou o resultado.

No entanto, a introdução da verificação também cria um novo conjunto de considerações operacionais que muitos observadores subestimam porque verificar as saídas da IA requer gerenciar provas computacionais, coordenar validadores, manter estruturas de incentivo e garantir que as camadas de verificação permaneçam resilientes durante períodos de alta demanda ou atividade adversarial, o que significa que a confiabilidade da própria rede de verificação se torna um fator crítico para determinar se todo o sistema pode funcionar em escala.

Nesse sentido, a Rede Mira não apenas introduz um recurso que torna as saídas da IA mais fáceis de confiar, mas estabelece a base para uma nova classe de operadores de infraestrutura cujo papel se assemelha ao de câmaras de compensação financeiras ou validadores de blockchain, pois participam do processo de confirmação da integridade computacional e manutenção da confiabilidade de um marketplace de verificação que se coloca entre produtores de IA e consumidores de IA.

Esse desenvolvimento traz implicações importantes para o mercado, uma vez que, quando a verificação se torna uma expectativa padrão para as saídas de IA, o cenário competitivo começa a mudar de capacidade pura do modelo para a qualidade do pipeline de verificação que envolve esses modelos, incluindo fatores como a rapidez com que os resultados podem ser verificados, quão transparente é o processo de verificação, quão robusta a rede permanece durante períodos de uso intenso e quão resistente o sistema é à manipulação ou fraude.

O resultado é que as aplicações de inteligência artificial podem competir cada vez mais não apenas em quão inteligentes seus modelos parecem ser, mas também em quão confiavelmente podem provar que a inteligência foi executada corretamente, o que sutilmente, mas significativamente, eleva o padrão do que os usuários esperam ao interagir com sistemas impulsionados por IA que influenciam decisões do mundo real ou atividades financeiras.

Há também uma dimensão estratégica mais profunda a essa evolução, porque a IA verificada introduz um modelo de responsabilidade que plataformas tradicionais de aprendizado de máquina têm lutado para fornecer, uma vez que desenvolvedores e organizações não podem mais confiar apenas na autoridade de sua infraestrutura, mas devem, em vez disso, garantir que seus sistemas operem dentro de estruturas que possam suportar verificação e escrutínio independentes.

Se este modelo tiver sucesso, a importância a longo prazo de redes como Mira não será medida apenas pelo número de tarefas de IA processadas por meio de sua infraestrutura, mas pela eficácia com que transformam a confiança na inteligência artificial de um acordo social em um padrão técnico verificável que opera de forma confiável mesmo quando os sistemas subjacentes se tornam mais complexos, mais autônomos e mais profundamente integrados no tecido econômico e informacional da internet.

O que leva, em última análise, à questão que mais importa ao avaliar a ascensão da inteligência artificial verificada, porque o verdadeiro teste dessa arquitetura não ocorrerá quando os sistemas estiverem operando em condições ideais, mas quando a demanda aumentar, atores adversariais tentarem manipular saídas e os incentivos econômicos dos participantes da verificação estiverem sob estresse, uma vez que a credibilidade a longo prazo da IA verificada dependerá de saber se redes como Mira podem manter integridade, transparência e confiabilidade precisamente quando essas qualidades se tornam mais difíceis de garantir.

@Mira - Trust Layer of AI #Mira $MIRA