A maioria das pessoas assume que o maior desafio da IA é a inteligência. Na realidade, o desafio sempre foi a confiança. Grandes modelos podem produzir respostas confiantes, mas confiança não é igual a correção. Erros sutis—fatos mal interpretados, citações fabricadas ou raciocínio incompleto—escapam silenciosamente e raramente se anunciam de forma barulhenta.

Esses erros não são catastróficos individualmente. Mas em sistemas financeiros, contratos inteligentes ou redes autônomas, até pequenos descuidos podem resultar em consequências no mundo real. E é exatamente por isso que depender de um único modelo é frágil.

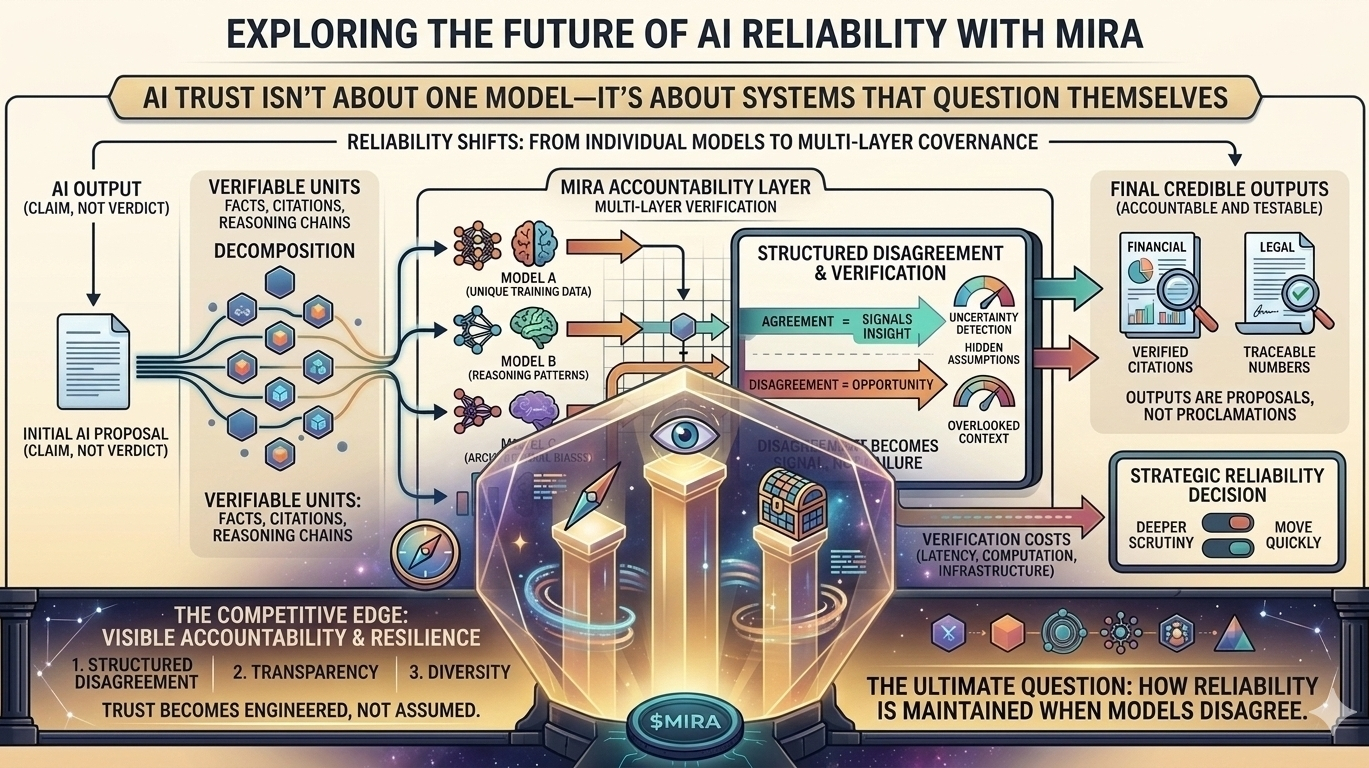

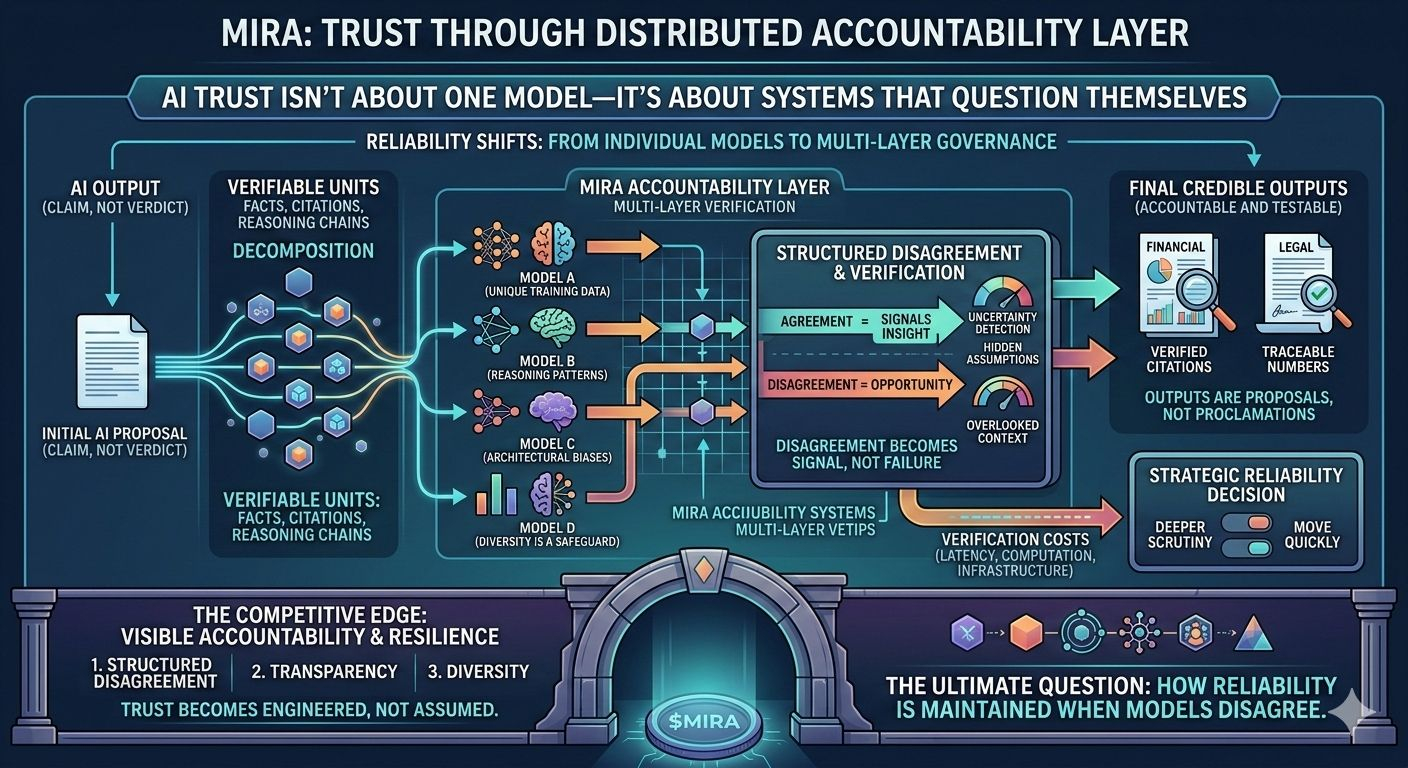

A Mira introduz uma nova maneira: trate cada saída como uma reivindicação, não um veredicto. Múltiplos modelos independentes avaliam a mesma reivindicação, cada um trazendo dados de treinamento únicos, padrões de raciocínio e vieses arquitetônicos. O acordo sinaliza insight, mas a discordância sinaliza oportunidade—oportunidade de detectar incertezas, suposições ocultas ou contextos negligenciados.

Na prática, as saídas são divididas em unidades verificáveis. Um resumo financeiro complexo torna-se números rastreáveis. Uma interpretação legal se transforma em uma cadeia de raciocínio. A IA não se torna magicamente mais inteligente—suas reivindicações tornam-se responsáveis e testáveis.

A confiança se afasta dos modelos individuais e se move em direção à governança em múltiplas camadas. As saídas são credíveis não porque um modelo as produziu, mas porque sistemas independentes chegaram a conclusões compatíveis. A transparência é crítica: conjuntos de dados sobrepostos ou arquiteturas similares podem enviesar o consenso, então a diversidade é uma salvaguarda de confiabilidade.

A verificação tem custos—latência, computação e infraestrutura. Aplicações que integram essas camadas devem decidir quais reivindicações precisam de uma análise mais profunda e quais podem seguir rapidamente. A confiabilidade não é mais um atributo passivo; é uma decisão estratégica incorporada ao design do sistema.

A vantagem competitiva para a próxima geração de IA não virá de quem responde mais rápido ou soa mais inteligente. Virá de responsabilidade visível, discordância estruturada e resiliência diante de erros.

A governança multi-modelo da Mira não é apenas um recurso—é uma camada de responsabilidade para a inteligência de máquina. As saídas tornam-se propostas, não proclamações. A discordância torna-se sinal, não falha. A confiança torna-se engenheirada, não presumida.

A pergunta definitiva não é se os modelos concordam. É quem interpreta a discordância, quais salvaguardas são ativadas e como a confiabilidade é mantida. Este é o mundo onde a IA pode realmente ser confiável.

#Mira

@Mira - Trust Layer of AI