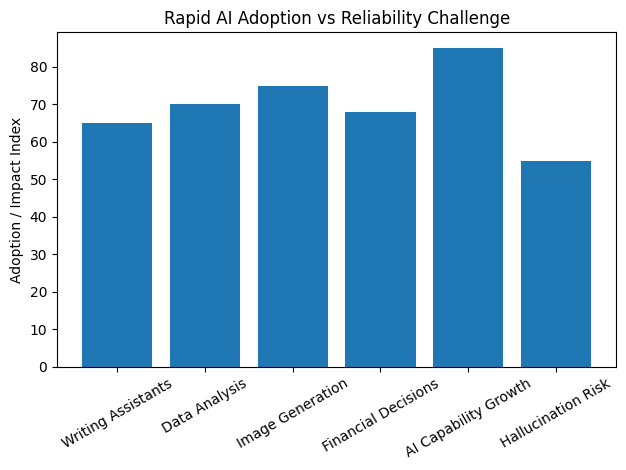

Frequentemente me pego pensando sobre quão rápido a tecnologia está mudando o mundo ao nosso redor. A inteligência artificial, que antes parecia algo distante e experimental, rapidamente se tornou parte de nossas rotinas diárias. Vemos isso em assistentes de escrita, ferramentas de análise de dados, plataformas de geração de imagens e até mesmo sistemas de decisão financeira. O que antes exigia equipes de especialistas agora pode ser feito por um modelo de IA em segundos.

Este progresso rápido é emocionante, mas também levanta uma questão importante. À medida que confiamos mais na IA, como sabemos se as informações que ela fornece estão realmente corretas?

Muitos sistemas de IA hoje operam analisando grandes conjuntos de dados e prevendo a resposta mais provável a uma pergunta. Esses sistemas são incrivelmente poderosos, mas não são perfeitos. Às vezes, eles geram respostas que parecem confiantes e lógicas, mas contêm erros ou informações completamente fabricadas. Esse problema, muitas vezes referido como alucinação de IA, destaca uma das maiores fraquezas da inteligência artificial moderna.

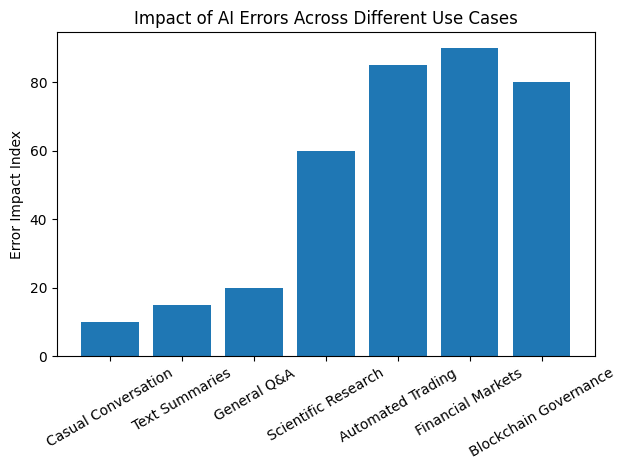

Para tarefas simples ou conversas casuais, esses erros podem não causar grandes problemas. Se uma IA comete um pequeno erro ao resumir um texto ou responder a uma pergunta geral, as consequências geralmente são mínimas. No entanto, a situação se torna muito mais séria quando a IA começa a influenciar decisões importantes.

Imagine a IA sendo usada em mercados financeiros para analisar tendências e guiar investimentos. Considere sistemas de negociação automatizados que dependem de previsões de IA para executar transações. Pense em pesquisas científicas onde modelos de IA ajudam a interpretar dados ou sistemas de governança blockchain onde agentes automatizados ajudam a gerenciar economias digitais. Nessas situações, mesmo um pequeno erro pode ter grandes consequências.

Uma suposição incorreta em um algoritmo de negociação poderia desencadear grandes perdas financeiras. Uma interpretação errada em dados de pesquisa poderia retardar o progresso científico. Em redes descentralizadas, informações não confiáveis poderiam prejudicar a confiança e interromper ecossistemas inteiros. À medida que a inteligência artificial avança nesses ambientes de alto impacto, a confiabilidade se torna mais importante do que nunca.

É aqui que a Mira Network introduz uma ideia atraente.

Em vez de se concentrar apenas em construir modelos de IA maiores e mais poderosos, a Mira Network se concentra em garantir que as saídas da IA possam ser verificadas. O projeto aborda a inteligência artificial de uma perspectiva diferente. Em vez de perguntar quão rápida ou complexa a IA pode se tornar, a Mira pergunta quão confiáveis suas informações podem ser.

O conceito por trás da Mira Network é centrado na verificação. Quando um sistema de IA gera informações, a Mira não aceita simplesmente a saída como uma única verdade. Em vez disso, o sistema divide essas informações em reivindicações menores. Cada reivindicação pode então ser verificada e validada de forma independente.

Essas reivindicações são distribuídas em uma rede de validadores independentes. Cada participante revisa as informações e avalia sua precisão. Como múltiplos validadores participam do processo, o resultado final é determinado por consenso descentralizado em vez de depender de uma única autoridade.

Essa abordagem reduz o risco de viés ou erro proveniente de um modelo ou uma organização. Ela também cria um sistema onde as informações são continuamente examinadas e verificadas pela própria rede.

A tecnologia blockchain desempenha um papel importante no apoio a esse processo. Os resultados de verificação podem ser registrados em logs transparentes e auditáveis, permitindo que desenvolvedores e usuários rastreiem como as informações foram validadas. Essa transparência ajuda a construir confiança em sistemas que dependem de dados confiáveis.

Outro elemento chave é o mecanismo de incentivo. Participantes que contribuem com verificações precisas são recompensados, enquanto ações desonestas ou negligentes podem levar a penalidades. Esse sistema incentiva a participação honesta e fortalece a integridade da rede.

À medida que a inteligência artificial continua a se expandir em finanças, pesquisa e tecnologia descentralizada, a importância de informações confiáveis só aumentará. Sistemas que dependem de IA precisarão de mecanismos que confirmem se os dados que utilizam são precisos e confiáveis.

A Mira Network representa um passo em direção a esse futuro. Ao focar na verificação e validação descentralizada, o projeto visa criar um ambiente onde as informações geradas por IA não são apenas poderosas, mas também confiáveis.

A longo prazo, o sucesso da inteligência artificial não dependerá apenas de quão inteligentes esses sistemas se tornam. Dependerá de quão confiáveis podemos considerá-los. A inteligência verificada pode se tornar a base que permite que a IA impulsione com segurança a próxima geração de sistemas digitais.