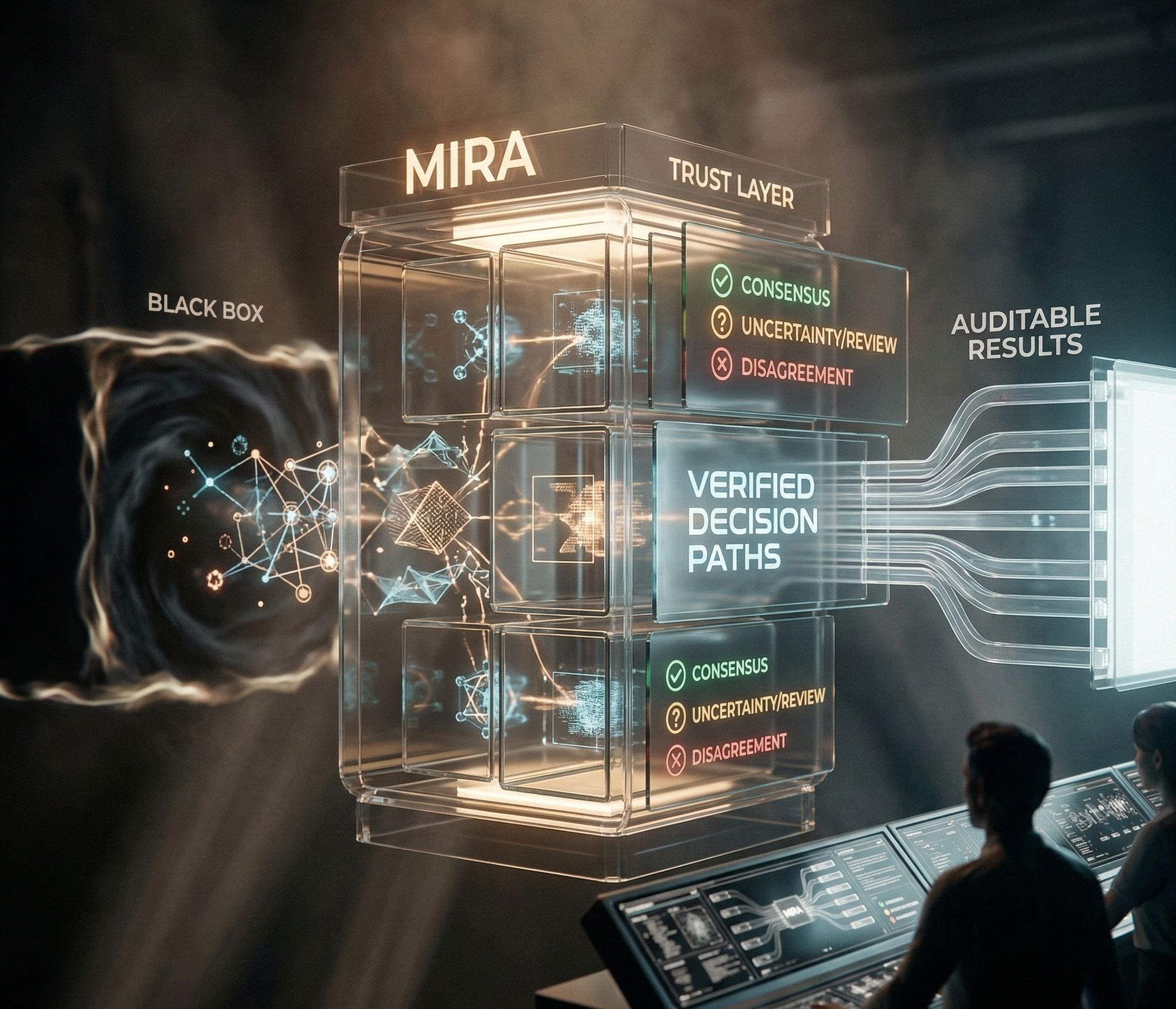

L'IA est désormais partout : automatisation, analyse de données, aide à la décision. Mais un problème majeur persiste pour les entreprises et les utilisateurs : la boîte noire. Comment faire confiance à un résultat si on ne peut pas vérifier comment il a été généré ?

La performance ne suffit plus. Pour passer à l'étape supérieure, l'IA a besoin de transparence et d'auditabilité. C'est ici qu'intervient @Mira - Trust Layer of AI, la couche de confiance qui apporte enfin la vérification nécessaire aux systèmes d'IA.

🔍 Le défi : Pourquoi la transparence est-elle cruciale ?

Les modèles d'IA actuels sont puissants mais opaques. Lorsqu'une IA donne une réponse, le cheminement logique reste souvent invisible. Dans un environnement professionnel ou réglementé, c'est un risque. Les organisations ont besoin de savoir :

Pourquoi cette conclusion spécifique ?

Les sources utilisées sont-elles fiables ?

Quel est le degré de certitude du système ?

Le résultat peut-il être vérifié de manière indépendante ?

Sans visibilité, il est impossible de bâtir une confiance durable dans l'automatisation.

✅ L'auditabilité : Tracer l'invisible

Contrairement aux logiciels classiques basés sur des règles fixes (si A, alors B), l'IA repose sur des probabilités statistiques. Cela rend le traçage d'une erreur très complexe.

À mesure que l'IA s'intègre dans les industries critiques, l'auditabilité devient une obligation. Mira répond à ce besoin en transformant les flux de travail IA pour qu'ils deviennent examinables, validables et révisables.

⚙️ Comment Mira Network change la donne

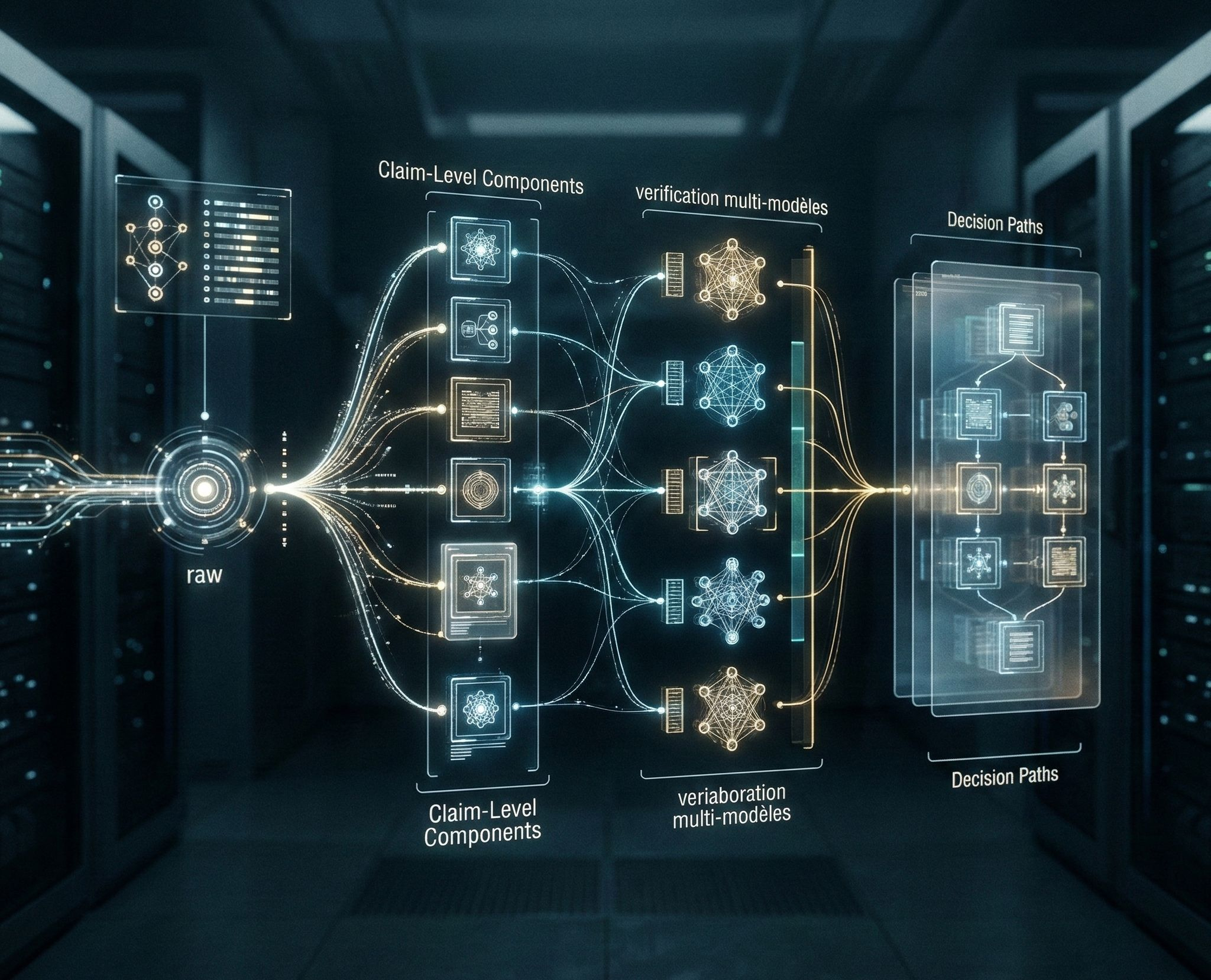

Mira ne traite pas les réponses de l'IA comme un bloc de texte monolithique. Le réseau décompose chaque sortie en "Claim-Level Components" (revendications individuelles).

Atomisation : La réponse est séparée en plusieurs affirmations spécifiques.

Évaluation isolée : Chaque micro-affirmation est analysée indépendamment pour vérifier sa cohérence avec les données disponibles.

Vérification Multi-Modèles : Au lieu de croire un seul modèle sur parole, Mira utilise une validation croisée. Plusieurs modèles analysent la même revendication :

Consensus : Niveau de confiance élevé.

Désaccord : Alerte sur l'incertitude ou besoin d'examen humain.

📊 Une traçabilité complète (Decision Paths)

Grâce à cette structure, Mira crée un historique clair de la décision :

Quelles affirmations ont été extraites ?

Comment ont-elles été évaluées ?

Quel score de confiance global a été attribué ?

Cela permet aux développeurs de construire des applications "intelligentes" : le système peut valider automatiquement les sorties à haute confiance et isoler les résultats douteux pour une vérification manuelle.

🚀 Vers un écosystème IA Trustless

L'avenir de l'IA ne dépend plus seulement de la puissance de calcul, mais de la fiabilité de l'infrastructure. Mira Network construit les fondations d'un écosystème où l'IA n'est plus une boîte noire, mais un outil responsable, traçable et auditable.

En apportant cette couche de vérification, Mira permet à l'IA de passer d'un simple gadget à une infrastructure critique digne de confiance.

$MIRA #Mira #Aİ #Web3 #Transparency