Escrito pela Equipe Científica Qubic

Um comentário sobre o último artigo de Nick Bostrom pela Equipe Científica Qubic

Reformulando o Debate sobre Superinteligência: Cirurgia, Não Roleta

Ele acaba de publicar um novo artigo de trabalho, Tempo Ótimo para Superinteligência: Considerações Mundanas para Pessoas Existentes (2026), no qual ele muda a questão central. Em vez de perguntar se devemos desenvolver superinteligência, Bostrom foca em quando é ótimo fazê-lo. Para qualquer um que esteja acompanhando a interseção em rápida evolução de IA e blockchain, seu framework traz implicações profundas sobre como projetamos a infraestrutura que sustentará a inteligência geral artificial (AGI).

Reformulando o Debate sobre Superinteligência: Cirurgia, Não Roleta

O ponto de partida do artigo de Bostrom é elegante e disruptivo. Ele reformula completamente o debate polarizado “IA sim vs. IA não”. Desenvolver superinteligência, ele argumenta, não é como jogar roleta russa. É mais como passar por uma cirurgia arriscada para uma condição que já é fatal.

Qual é essa condição? O estado atual da humanidade em si. Considere a linha de base: aproximadamente 170.000 mortes ocorrem a cada dia devido ao envelhecimento, doenças e falhas sistêmicas. Uma população global envelhecida enfrenta deterioração biológica irreversível. Doenças incuráveis, incluindo condições oncológicas, neurodegenerativas e cardiovasculares, continuam a sobrecarregar milhões. Enfrentamos riscos globais não mitigados, desde a instabilidade climática até a corrupção institucional sistêmica e a erosão da qualidade democrática. Pandemias, guerras e o colapso de sistemas inteiros permanecem ameaças sempre presentes.

Dadas essas realidades, Bostrom argumenta que enquadrar a escolha como “risco zero sem IA” versus “risco extremo com uma superinteligência” é simplista. A questão mais rigorosa é: qual trajetória gera maior expectativa de vida e maior qualidade de vida para as pessoas que já existem?

Ao ancorar sua análise nas condições reais e presentes da vida humana, Bostrom evita abstrações filosóficas e especulações teológicas. Ele está falando sobre você, sua família e as pessoas vivas agora.

Expectativa de Vida, Risco de Mortalidade e o Caso para a Inteligência Geral Artificial

Quando somos jovens, o risco anual de morrer é extremamente baixo. Biologicamente, estamos longe da morte na maioria dos casos. Mas à medida que envelhecemos, a probabilidade de morrer aumenta implacavelmente devido à deterioração biológica.

Se a superinteligência pudesse reduzir radicalmente ou até eliminar o envelhecimento, como Bostrom propõe, seu risco anual de mortalidade permaneceria no nível de uma pessoa jovem e saudável. Sua mortalidade deixaria de aumentar com o tempo. Nesse cenário, a expectativa de vida se tornaria extraordinariamente longa.

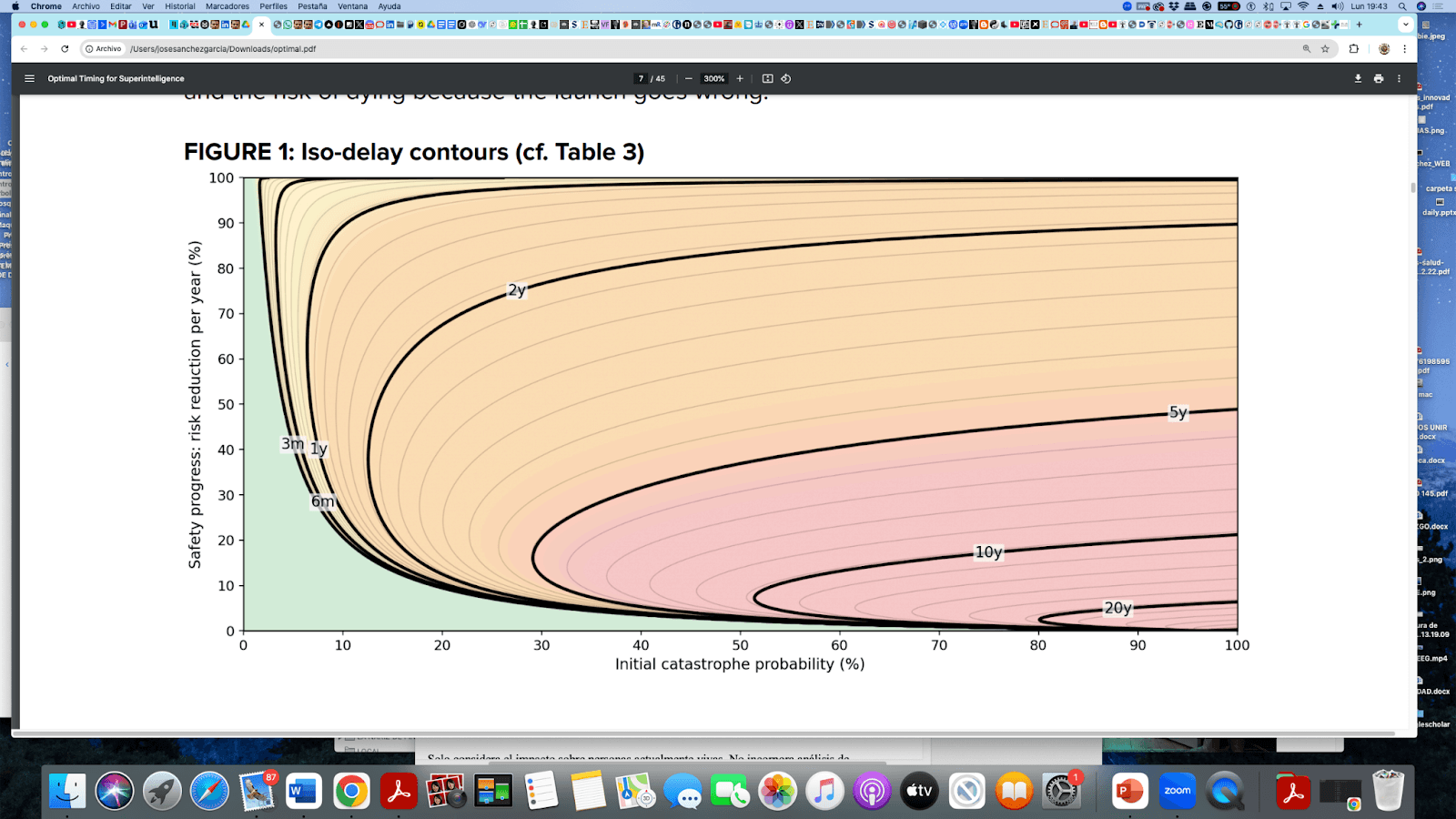

A partir deste ponto de vista, o valor esperado da superinteligência compensa seus altos riscos. Mas o que acontece se atrasarmos até que a tecnologia se torne perfeitamente “segura”? E se acumulássemos a probabilidade de morrer a cada ano que passa? A questão se torna: é mais racional aceitar a probabilidade de catástrofe da implantação precoce, dado que o progresso em segurança da IA é exponencial, ou aceitar a certeza de mortes acumuladas do atraso?

Desconto Temporal e o Custo da Espera

Bostrom introduz o conceito de desconto temporal (ρ), um princípio bem estudado na teoria da decisão. Os humanos sistematicamente valorizam os resultados presentes mais do que os futuros. É por isso que permanecemos em empregos, relacionamentos e padrões insatisfatórios: o esforço para mudar parece grande, e a recompensa parece distante.

Mas aqui ocorre uma inversão interessante. Se a vida após a AGI não é apenas mais longa, mas dramaticamente melhor, com melhorias radicais na saúde, capacidade cognitiva e qualidade de vida, então o desconto temporal realmente pune a espera. Cada ano de atraso é um ano passado em uma condição qualitativamente pior quando um estado muito superior é acessível.

Qualidade de Vida e Aversão ao Risco na Implantação de AGI

O modelo de Bostrom não assume longevidade sozinha. Ele incorpora melhorias substanciais no bem-estar. Se a qualidade de vida dobrar após a transição para a superinteligência, o equilíbrio se desloca decisivamente em direção à implantação anterior. Ele então adiciona métricas de aversão ao risco (CRRA e CARA), reconhecendo que se somos mais sensíveis a perdas extremas, a janela onde “lançar agora” continua sendo aconselhável se estreita e os atrasos ótimos se prolongam.

Isso não é aceleração imprudente. É uma tomada de decisão calibrada sob incerteza, o tipo de análise que deve informar como governamos o caminho para a inteligência geral artificial.

Implantação em Duas Fases: Rápido para o Porto, Lento para a Cais

Uma das contribuições mais fortes do artigo é sua divisão da transição da AGI em duas fases distintas:

Fase 1: Alcançando a capacidade de AGI. Mova-se tão rapidamente quanto for responsável para construir um sistema que demonstre inteligência geral.

Fase 2: Uma pausa estratégica antes da implantação total. Uma vez que o sistema exista, introduza um atraso controlado para estudá-lo, testá-lo em condições reais e resolver problemas de segurança técnica que eram anteriormente apenas teóricos.

A hipótese de Bostrom é que uma vez que um sistema AGI realmente exista, um “ganho de segurança” ocorre. Os pesquisadores podem observar comportamentos reais em vez de especular sobre eles. O progresso em segurança acelera dramaticamente porque os problemas se tornam empíricos em vez de abstratos. O lema que ele cria: rápido para o porto, lento para o cais.

Quem se Beneficia Mais de uma Transição Antecipada para a Superinteligência?

Bostrom não trata o timing ótimo como universal. As pessoas mais velhas, os gravemente doentes e aqueles que vivem em condições precárias têm menos anos esperados restantes. Para eles, o benefício potencial de uma transição rápida para a superinteligência é muito maior. Pessoas mais jovens com décadas pela frente podem tolerar mais espera.

Se você aplicar uma lógica prioritariana, dando maior peso àqueles que estão em pior situação, a linha do tempo ótima se desloca para frente. Bostrom também rejeita explicitamente a suposição comum de que, além de certa idade, a vida adicional não adiciona valor. Esse julgamento, ele argumenta, está enraizado em nossa experiência de envelhecimento e deterioração atuais. Não leva em conta um cenário de genuína rejuvenescimento, uma das promessas centrais de um futuro superinteligente.

Riscos Institucionais: Por que a Infraestrutura de Governança de IA é Importante

Nas seções finais de seu artigo, Bostrom introduz avisos institucionais críticos. O cenário mais razoável, ele sugere, é aquele em que o líder tecnológico usa sua vantagem para a segurança. Mas ele também sinaliza os perigos de moratórias nacionais, proibições internacionais e as dinâmicas competitivas que surgem quando vários atores correm em direção à AGI sob pressão geopolítica.

A análise dele assume implicitamente um ecossistema onde o poder computacional tende a se concentrar. Em tal ambiente, os riscos se acumulam: militarização de recursos computacionais, acúmulo de computação (reservas massivas prontas para serem ativadas sob pressão competitiva) e os incentivos perversos da centralização extrema. Essas não são preocupações abstratas. A trajetória atual do desenvolvimento de IA, dominada por um punhado de provedores de nuvem hiperscala e laboratórios corporativos, cria precisamente essa concentração.

Implicações para a Qubic: Por que a Infraestrutura de IA Descentralizada Reduz o Risco Existencial

Se levamos a sério a estrutura de Bostrom, a questão fundamental muda de “quando lançar a AGI” para que tipo de infraestrutura reduz os riscos associados a esse lançamento. É aqui que a arquitetura da Qubic se torna diretamente relevante para a conversa global sobre segurança da superinteligência.

O Problema da Centralização no Desenvolvimento Atual de IA

Se a superinteligência for construída sobre infraestruturas centralizadas, dependentes de enormes centros de dados, pipelines de treinamento opacos e controle corporativo, o perfil de risco se expande além do puramente técnico. Torna-se geopolítico. A concentração de computação torna o tipo de governança adaptativa que Bostrom considera essencial durante a fase crítica de pré-implantação muito mais difícil. Também cria exatamente o tipo de acúmulo de computação sobre o qual ele alerta: reservas computacionais massivas prontas para serem ativadas de uma só vez sob pressão competitiva.

Como a Arquitetura de Computação Distribuída da Qubic Aborda Esses Riscos

A Qubic dilui esse gargalo estrutural. Sua arquitetura distribui o poder computacional por uma rede global em vez de concentrá-lo em um único nó. A Qubic não depende de uma arquitetura tipo LLM treinada opacamente em mega centros de dados. Em vez disso, aproveita o Trabalho Útil de Prova (uPoW), onde os mineradores contribuem com computação real para o treinamento de seu núcleo de IA, Aigarth, em vez de resolver quebra-cabeças de hash arbitrários.

Essa escolha de design tem implicações diretas para a análise de Bostrom. Uma infraestrutura menos centralizada reduz a probabilidade dos cenários de implantação abrupta e competitiva que ele alerta. Computação distribuída significa que o poder não está localizado em uma única instalação que pode ser capturada militarmente, nem em um laboratório corporativo sob controle unilateral. Essa resiliência estrutural expande o espaço para a Fase 2 de Bostrom: a pausa estratégica onde testes reais, melhorias incrementais e governança adaptativa podem ocorrer antes da implantação total.

Para uma compreensão mais profunda de como a abordagem da Qubic em IA difere dos modelos tradicionais, explore Neuraxon: O Grande Salto da Qubic Rumo à IA Viva e Aprendente e a análise recente de Que IA Estática É um Impasse. O Google Confirma.. Essas postagens ilustram como a Qubic está construindo inteligência através de um paradigma fundamentalmente diferente: um projetado para aprendizado contínuo, resiliência distribuída e adaptação ao mundo real em uma rede descentralizada.

IA Descentralizada e Blockchain: Alinhamento Estrutural com a Segurança da AGI

Do ponto de vista de Bostrom, o potencial da Qubic não reside simplesmente em ser “descentralizado” como um exercício de marca. Reside na modificação das variáveis estruturais que determinam o timing ótimo para a implantação da superinteligência. Ao distribuir a computação, ao construir protocolos de consenso que alinhem os incentivos dos mineradores com o verdadeiro treinamento de IA, e ao tornar todo o processo de código aberto e auditável, a Qubic cria o tipo de infraestrutura que torna a transição para AGI estruturalmente mais segura.

Se você está interessado em como o modelo de mineração de CPU da Qubic e a rede de computação distribuída estão evoluindo, a análise profunda da Mineração de Dogecoin na Qubic explica a mais recente expansão do Trabalho Útil de Prova, e a Visão de 2026 da Qubic detalha o roadmap de infraestrutura mais amplo atualmente em andamento.

O Problema Mais Difícil: Construindo AGI que Aprende com o Mundo

Imaginar cenários utópicos e distópicos é valioso. É, de fato, o melhor caminho para criar futuros alinhados com as necessidades e valores humanos. Mas desviar o olhar, esperar sem rumo ou acelerar sem restrição falham em fornecer as reflexões necessárias.

Talvez o desafio mais difícil agora não seja tanto pesar o risco de acelerar a transição e modelá-lo. Por enquanto, a tarefa mais difícil é construir uma inteligência artificial geral capaz de aprender por conta própria a partir de diferentes ambientes dinâmicos, criando representações do mundo e agindo dentro dele. Esse é precisamente o desafio que a estrutura Neuraxon da Qubic foi projetada para abordar, não treinando em conjuntos de dados estáticos atrás de portas fechadas, mas evoluindo em aberto, aprendendo com a complexidade do mundo real em uma rede descentralizada na qual qualquer um pode participar.

Referências e Fontes

1. Bostrom, N. (2026). Timing Óptimo para Superinteligência: Considerações Mundanas para Pessoas Existentes. Documento de trabalho, v1.0.

https://nickbostrom.com/optimal.pdf

2. Bostrom, N. (2014). Superinteligência: Caminhos, Perigos, Estratégias. Oxford University Press.

3. Bostrom, N. (2003). Desperdício Astronômico: O Custo de Oportunidade do Desenvolvimento Tecnológico Atrasado. Utilitas, 15(3), 308–314.

4. Yudkowsky, E. & Soares, N. (2025). Se Alguém Construí-lo, Todos Morrem.

5. Hall, R. E. & Jones, C. I. (2007). O Valor da Vida e o Aumento dos Gastos com Saúde. Quarterly Journal of Economics, 122(1), 39–72.

6. Equipe Científica da Qubic. Neuraxon: O Grande Salto da Qubic Rumo à IA Viva e Aprendente.

https://qubic.org/blog-detail/neuraxon-qubic-s-big-leap-toward-living-learning-ai

7. Discussão da comunidade LessWrong: Timing Óptimo para Superinteligência

https://www.lesswrong.com/posts/2trvf5byng7caPsyx/optimal-timing-for-superintelligence-mundane-considerations