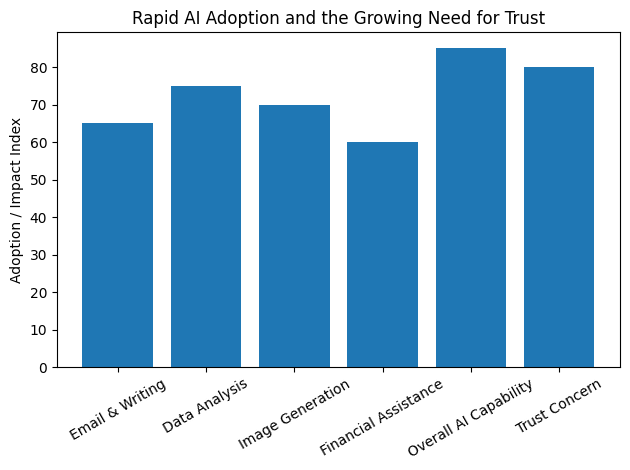

Às vezes, sento e penso em quanto o mundo mudou em apenas alguns anos. A tecnologia que antes parecia ficção científica agora faz parte da vida cotidiana. A inteligência artificial é um dos maiores exemplos dessa transformação. Ela escreve e-mails, explica tópicos complexos, gera imagens, analisa dados e até ajuda as pessoas a tomar decisões financeiras. O que antes exigia especialistas e horas de trabalho agora pode acontecer em segundos.

Assistir a esse progresso é emocionante. A cada mês, os sistemas de IA ficam mais inteligentes e mais capazes. Mas, enquanto assisto a essa tecnologia crescer, uma pergunta continua voltando à minha mente. Se a IA vai guiar decisões importantes, como sabemos quando ela realmente está dizendo a verdade?

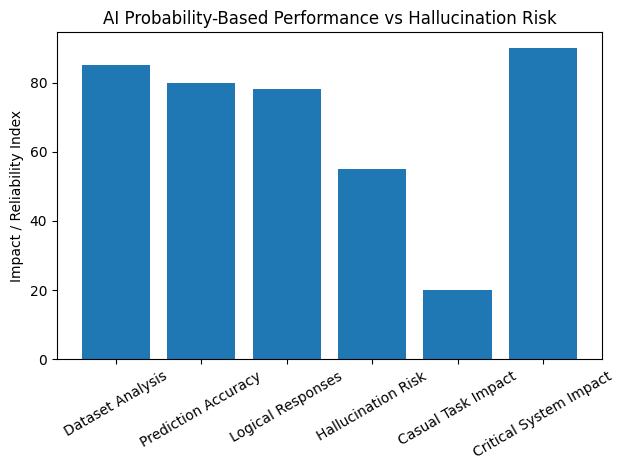

A maioria dos modelos de IA hoje é construída em torno da probabilidade. Eles analisam enormes conjuntos de dados e tentam prever a resposta mais provável a uma pergunta. Esse método funciona surpreendentemente bem na maior parte do tempo. Mas não é perfeito. Os sistemas de IA às vezes produzem respostas que soam confiantes e lógicas, mas estão completamente erradas. Esses erros são frequentemente chamados de alucinações. O sistema pode inventar informações, interpretar mal fontes ou combinar dados de maneiras que criam algo crível, mas não factual.

Para tarefas simples do dia a dia, esse problema pode não ser muito sério. Se um assistente de IA comete um pequeno erro ao resumir um documento ou responder a uma pergunta casual, o impacto geralmente é pequeno. Mas a situação se torna muito diferente quando a IA começa a influenciar sistemas onde a precisão realmente importa.

Imagine a inteligência artificial analisando mercados financeiros e ajudando a guiar estratégias de investimento. Pense em sistemas de negociação automatizados que dependem de previsões de IA para tomar decisões em tempo real. Considere pesquisas científicas onde modelos de IA interpretam dados complexos, ou redes blockchain descentralizadas onde agentes automatizados ajudam a gerenciar economias digitais. Em esses ambientes, mesmo um pequeno erro poderia criar consequências significativas.

Uma única suposição incorreta em uma estratégia de negociação automatizada poderia levar a grandes perdas financeiras. Uma interpretação falha de IA em pesquisas científicas poderia retardar descobertas ou criar conclusões enganosas. Em sistemas descentralizados, informações não confiáveis poderiam prejudicar a confiança e afetar comunidades inteiras. À medida que a inteligência artificial avança mais profundamente nesses ambientes de alto impacto, a confiabilidade se torna um dos desafios mais importantes na tecnologia moderna.

É aqui que a Mira Network introduz uma solução interessante.

Em vez de se concentrar apenas em construir modelos de IA mais rápidos ou poderosos, a Mira Network foca na verificação. O projeto aborda a inteligência artificial de um ângulo diferente. Em vez de perguntar quão inteligente a IA pode se tornar, a Mira se concentra em como suas informações podem ser validadas e confiáveis.

A ideia por trás da Mira Network é surpreendentemente simples, mas poderosa. Quando uma IA gera uma resposta complexa, o sistema não trata essa resposta como uma única peça de verdade. Em vez disso, a saída é dividida em reivindicações menores. Cada uma dessas reivindicações pode então ser avaliada de forma independente.

Essas reivindicações são distribuídas por uma rede de validadores independentes. Cada validador examina a reivindicação e verifica se as informações são precisas. Como muitos participantes estão envolvidos, o resultado final é formado através de consenso descentralizado, em vez de depender de um único modelo ou organização.

Esse processo ajuda a reduzir o risco de viés e melhora a confiabilidade. Em vez de confiar em um sistema de IA, a rede verifica informações coletivamente. A tecnologia blockchain ajuda a apoiar esse sistema registrando resultados de verificação em logs transparentes e auditáveis. Qualquer um pode revisar como as informações foram validadas e ver o processo por trás do resultado final.

Outra parte importante do design é a estrutura de incentivos. Participantes que fornecem verificações precisas são recompensados, enquanto comportamentos desonestos podem levar a penalidades. Isso incentiva a participação honesta e ajuda a manter a integridade da rede.

O que torna esse conceito particularmente empolgante é seu potencial papel no futuro dos sistemas autônomos. Nos próximos anos, agentes de IA podem interagir diretamente com plataformas de finanças descentralizadas, contratos inteligentes e economias digitais. Esses agentes poderiam analisar mercados, executar estratégias e gerenciar recursos automaticamente. Em um mundo assim, informações verificadas se tornam essenciais.

A Mira Network visa atuar como uma camada de confiabilidade para esses sistemas inteligentes. Ao verificar saídas geradas por IA antes que elas influenciem decisões importantes, a rede pode reduzir riscos e aumentar a confiança em processos automatizados.

À medida que a inteligência artificial continua a se expandir em novas áreas da tecnologia, a confiança se tornará tão importante quanto a capacidade. Algoritmos poderosos por si só não serão suficientes. Os sistemas que terão sucesso serão aqueles que puderem provar que suas informações são confiáveis.

A Mira Network representa um passo inicial em direção a esse futuro. Ela mostra que a próxima evolução da IA pode não ser apenas sobre criar máquinas mais inteligentes, mas também sobre construir sistemas que garantam que a inteligência possa ser confiável.

\u003ct-48/\u003e\u003cc-49/\u003e \u003cm-51/\u003e