Há algumas semanas, minha internet caiu na maior parte da tarde. Nada dramático—apenas uma dessas quedas rotineiras que lembram quanto a coordenação invisível está por trás de algo tão simples quanto carregar uma página da web. Eu liguei para o provedor, e o agente de suporte deu a explicação habitual: manutenção, algum problema de roteamento, engenheiros trabalhando nisso. O que me impressionou não foi a queda em si, mas quanto eu tinha que confiar em um sistema que não podia ver. Eu não tinha uma maneira direta de verificar o que deu errado, quem consertou, ou se a explicação era mesmo precisa. No entanto, o sistema funciona na maior parte do tempo, não porque eu possa inspecioná-lo, mas porque incentivos, responsabilidade e infraestrutura estão alinhados o suficiente para torná-lo confiável.

Essa experiência é uma maneira útil de abordar a ideia por trás do Midnight—promessa de transformar dados ocultos em algo que não é apenas privado, mas utilitariamente privado. Em um nível alto, a afirmação é atraente: os dados podem permanecer confidenciais enquanto ainda são verificáveis e acionáveis. Em vez de expor informações brutas, os sistemas podem provar coisas sobre esses dados sem revelá-los. É uma mudança de “mostre-me tudo” para “prove apenas o suficiente.” Em teoria, isso resolve uma tensão de longa data entre transparência e privacidade.

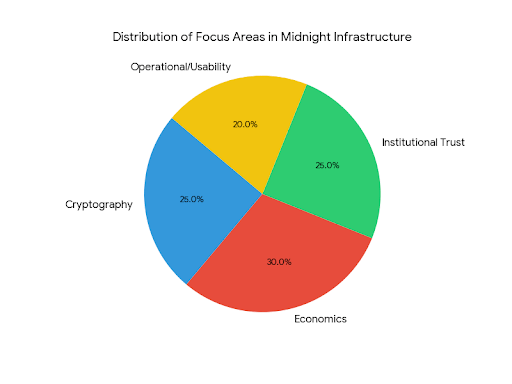

Mas no momento em que tento mapear essa ideia em sistemas do mundo real, as perguntas se tornam mais concretas. A privacidade não é apenas uma propriedade técnica; é uma propriedade operacional. Depende de quem controla o sistema, quem o verifica, quem arca com o custo e quem é responsável quando algo dá errado. O Midnight, como outras arquiteturas focadas em privacidade, está na interseção de criptografia, economia e confiança institucional. Essa interseção é onde a maioria dos sistemas se torna útil—ou falha silenciosamente.

A proposta central repousa na ideia de que dados ocultos ainda podem participar de processos significativos. Uma transação pode ser validada sem revelar seu conteúdo. Uma credencial pode ser provada sem expor a identidade. Um cálculo pode ser confiável sem mostrar entradas. Essas não são ideias novas, mas o Midnight se posiciona como uma estrutura que as torna práticas em grande escala. A questão, no entanto, não é se isso é possível—é. A questão é se isso se sustenta sob as condições desordenadas do uso real.

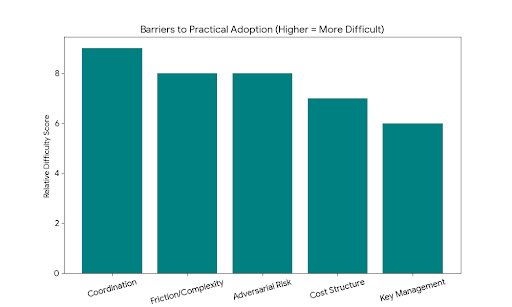

Na maioria dos sistemas que observei, o gargalo não é a capacidade, mas a coordenação. Para que o Midnight funcione além de ambientes controlados, várias partes precisam concordar sobre os padrões do que conta como prova válida, como essas provas são geradas e como as disputas são resolvidas. É aqui que as coisas começam a se assemelhar à infraestrutura em vez de software. É mais próximo de como sistemas de compensação financeira ou cadeias de suprimento operam do que como um aplicativo autônomo se comporta. E a infraestrutura, ao contrário dos aplicativos, não pode contar com otimismo—ela precisa funcionar sob estresse, uso indevido e falha parcial.

Também há a questão dos incentivos. Sistemas de privacidade muitas vezes presumem que os usuários querem proteger seus dados, o que é verdade em princípio. Mas, na prática, os usuários rotineiramente trocam privacidade por conveniência, velocidade ou custo. Se o Midnight introduzir fricção—taxas mais altas, processamento mais lento, fluxos de trabalho mais complexos—então a adoção dependerá de se essa fricção é justificada por benefícios tangíveis. As empresas, em particular, farão uma pergunta direta: isso reduz o risco, diminui o custo ou desbloqueia algo que não era possível antes? Se a resposta for incerta, o sistema permanece uma ferramenta de nicho em vez de uma camada fundamental.

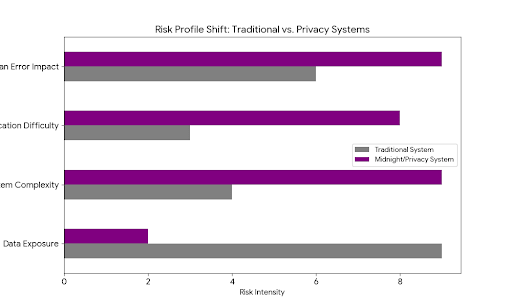

A verificação é outro ponto de pressão. Em um sistema tradicional, a verificação é muitas vezes direta: você audita registros, inspeciona logs ou confia na supervisão regulatória. Em um sistema que preserva a privacidade, a verificação se torna indireta. Você confia na prova, não nos dados em si. Essa é uma mudança sutil, mas importante. Coloca um pesado fardo sobre a correção da criptografia subjacente e a implementação. Se houver um defeito—seja em código, suposições ou integração—pode não ser imediatamente visível. E quando algo dá errado, diagnosticar o problema se torna mais difícil precisamente porque os dados estão ocultos.

Isso leva a uma preocupação mais ampla sobre risco operacional. Sistemas como o Midnight são projetados para reduzir uma categoria de risco—exposição de dados—mas podem introduzir outros. A complexidade é uma delas. Quanto mais camadas de abstração existem entre os dados brutos e seu uso, mais pontos potenciais de falha existem. Outro é o gerenciamento de chaves. Se usuários ou instituições perderem acesso às chaves criptográficas, os dados podem se tornar efetivamente irrecuperáveis. Em teoria, isso é uma característica. Na prática, pode se tornar uma responsabilidade, especialmente em ambientes onde os processos são imperfeitos e o erro humano é comum.

A sustentabilidade econômica também merece atenção. Mecanismos de privacidade não são gratuitos; eles exigem computação, armazenamento e coordenação. Se o Midnight depender de provas intensivas em recursos, então a estrutura de custos importa. Quem paga pela geração de provas? Quem paga pela verificação delas? Se o sistema depender de subsídios ou atividade especulativa para se manter viável, isso levanta questões sobre sua estabilidade a longo prazo. Infraestruturas que sustentam processos do mundo real tendem a ter modelos de receita claros e duráveis. Sem isso, corre o risco de se tornar mais um sistema tecnicamente impressionante, mas economicamente frágil.

Condições adversariais são onde essas ideias são realmente testadas. É fácil demonstrar privacidade e correção em um ambiente controlado. É muito mais difícil quando os participantes têm incentivos para trapacear, manipular ou explorar casos extremos. Para que o Midnight seja credível, precisa mostrar não apenas que funciona, mas que continua a funcionar quando as suposições são violadas. Pode lidar com atores maliciosos gerando provas enganosas? Pode prevenir formas sutis de vazamento de dados ao longo do tempo? Pode manter o desempenho sob carga sem comprometer garantias? Essas não são preocupações teóricas—são as condições sob as quais sistemas reais operam.

A adoção, em última análise, dependerá de se o Midnight se integra aos fluxos de trabalho existentes em vez de exigir que sejam reconstruídos do zero. A maioria das organizações não está procurando por reformas radicais; preferem melhorias incrementais que se encaixam no que já fazem. Se o Midnight puder agir como uma camada que melhora a privacidade sem interromper as operações, terá um caminho a seguir. Se exigir mudanças totais, a barreira se torna muito mais alta.

O que acho convincente sobre a ideia não é a promessa de privacidade absoluta, mas a possibilidade de uma transparência mais seletiva. Em muitos cenários do mundo real, o problema não é que os dados estão ocultos ou expostos—é que são tratados de uma maneira grosseira, tudo ou nada. Os sistemas ou revelam demais ou de menos. Uma abordagem mais sutil, onde apenas as informações necessárias são divulgadas, poderia alinhar-se melhor com como as instituições realmente funcionam. Mas essa sutileza vem ao custo da complexidade, e a complexidade é onde os sistemas frequentemente falham.

Minha visão geral é cautelosa, mas não desdenhosa. O Midnight aborda um problema real, e a direção subjacente faz sentido. No entanto, seu sucesso dependerá menos da elegância de sua criptografia e mais de sua capacidade de operar sob restrições do mundo real—custo, incentivos, usabilidade e resiliência. Se puder demonstrar vantagens claras e mensuráveis em ambientes onde privacidade e verificação realmente importam, pode se tornar parte da camada de infraestrutura. Caso contrário, corre o risco de permanecer um conceito interessante que nunca consegue escapar das fronteiras do uso controlado.

No final, eu vejo isso como um sistema que precisa se provar não por promessas, mas por desempenho sustentado e observável. A privacidade é valiosa, mas a privacidade útil—aquele tipo que se sustenta na prática—é muito mais difícil de alcançar.

Porque sistemas como este não são avaliados em condições ideais; eles são avaliados quando algo dá errado e ninguém está assistindo.

@MidnightNetwork #night $NIGHT