Eu continuo sendo puxado de volta a uma ideia simples, mas desconfortável: os sistemas geralmente não falham no centro, eles falham nas bordas—onde suposições encontram comportamento. E o Sign, por todo seu design cuidadoso, parece viver bem naquela fronteira.

Em um nível estrutural, está claro o que está tentando fazer. Credenciais são emitidas, verificadas e então reutilizadas em diferentes contextos, idealmente removendo a necessidade constante de provar a mesma coisa repetidamente. Essa parte faz sentido para mim. Reduz a fricção, reduz a repetição. Mas então começo a me perguntar sobre a natureza dessa fricção—tudo isso era desnecessário, ou alguma parte estava silenciosamente atuando como uma salvaguarda?

Porque quando você remove a verificação repetida, você não está apenas removendo ineficiência — você também está reduzindo oportunidades de detectar erros, inconsistências ou até mesmo manipulação. E, honestamente, eu entendo por que o Sign se inclina para a automação e a lógica de verificação em vez da supervisão humana. Os humanos são lentos, inconsistentes, tendenciosos. Mas eles também são imprevisíveis de maneiras que às vezes pegam problemas que os sistemas perdem.

Então há a privacidade. O sistema sugere que os usuários podem controlar suas credenciais, revelando apenas o que é necessário. Isso soa ideal. Mas eu continuo circulando a mesma dúvida — com que frequência os usuários realmente entendem o que estão compartilhando? A divulgação seletiva pressupõe um nível de consciência que, na prática, nem sempre está presente. E uma vez que os dados são compartilhados, mesmo parcialmente, tende a se propagar de maneiras que nem sempre são óbvias.

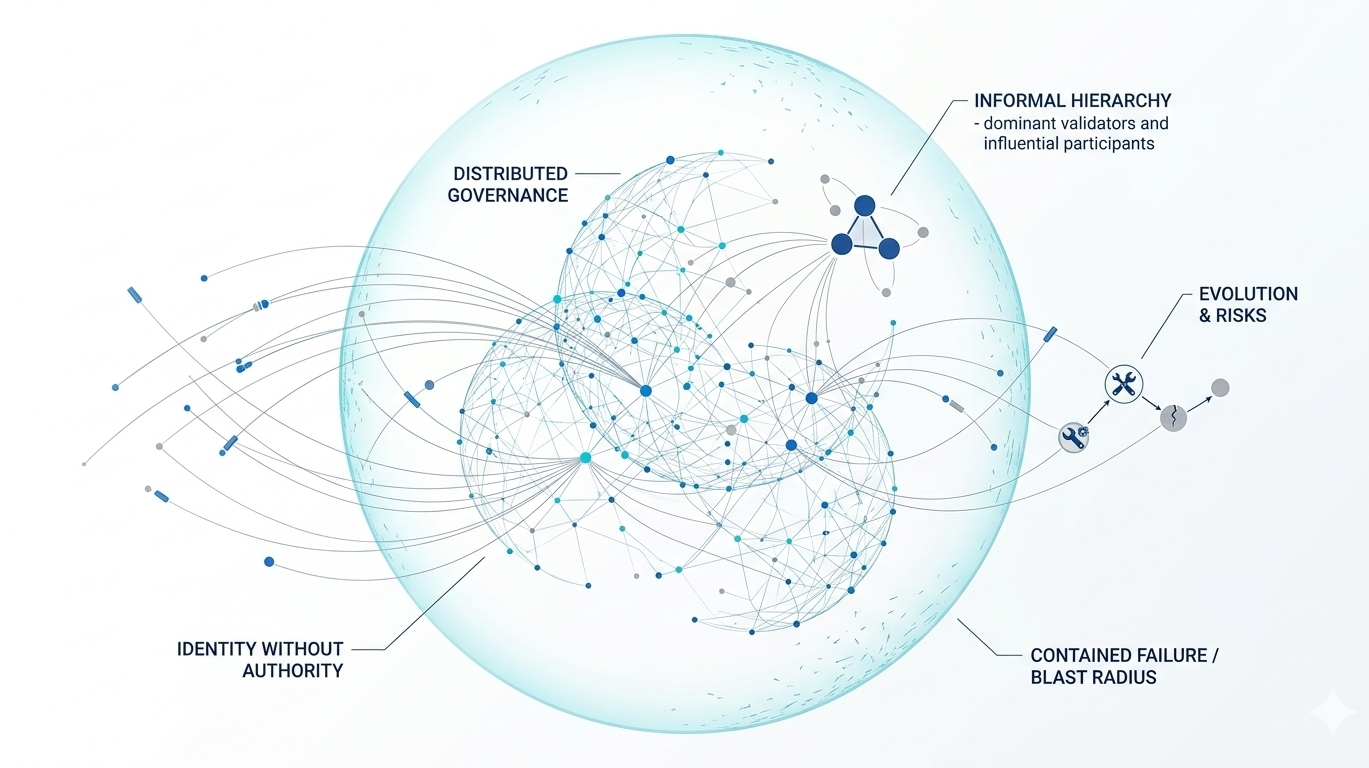

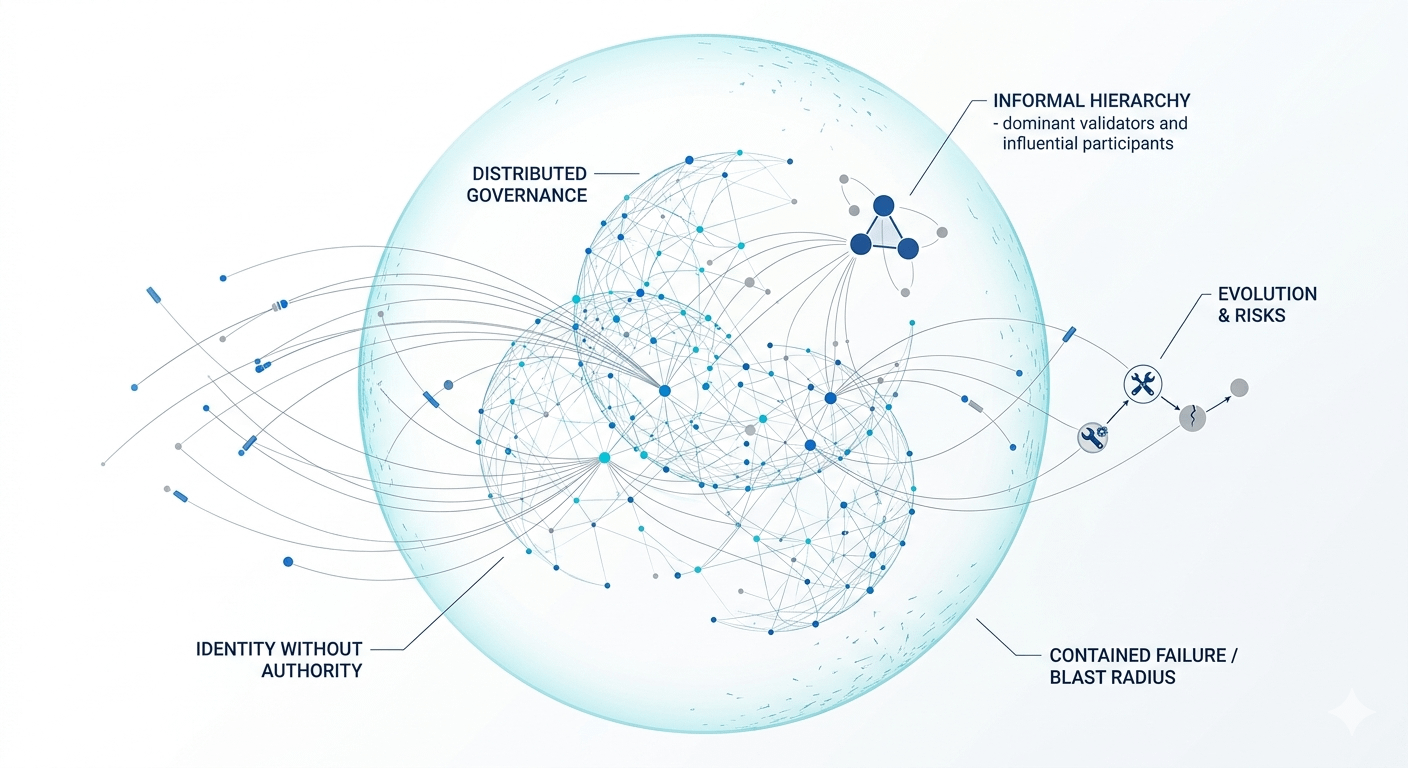

Eu também me pego pensando sobre como o Sign se cruza com a distribuição de tokens e a filtragem de identidade. Se credenciais podem definir elegibilidade, acesso ou reputação, então elas não apenas verificam — elas moldam resultados. É aí que as coisas se tornam mais sutis. Quem define o que conta como uma credencial válida? Quem se beneficia dessas definições? Não é mais apenas técnico. É estrutural.

E então há a reputação, que fica quieta sob tudo. O Sign não constrói explicitamente um sistema de reputação, mas permite um. Credenciais se acumulam, contextos se sobrepõem e, ao longo do tempo, a identidade se torna em camadas. Isso é poderoso. Mas também é frágil. A reputação, uma vez formada, pode ser difícil de ajustar, mesmo que os dados subjacentes mudem.

Um usuário é classificado de forma errada e luta para corrigir isso.

Uma credencial é válida tecnicamente, mas enganosa contextual.

Um sistema depende da verificação, mas ignora nuances.

Nenhum desses é uma falha no código. Mas eles importam.

Eu continuo voltando para a mesma tensão: o Sign tenta remover a confiança do processo incorporando a verificação na infraestrutura. Essa parte é elegante. Mas a confiança não desaparece — ela se desloca. De instituições para protocolos, de pessoas para sistemas, de julgamento para lógica.

E eu não tenho certeza de que a mudança é neutra.

Então eu fico em algum lugar entre. A arquitetura é reflexiva, o problema é real e a abordagem parece medida. Mas as consequências — especialmente as sutis — são mais difíceis de prever.

Talvez o Sign se torne uma espinha dorsal discreta de como a identidade flui através dos sistemas. Ou talvez revele que a verificação sozinha não é suficiente para capturar a complexidade da confiança.

Eu não consigo decidir qual ainda.