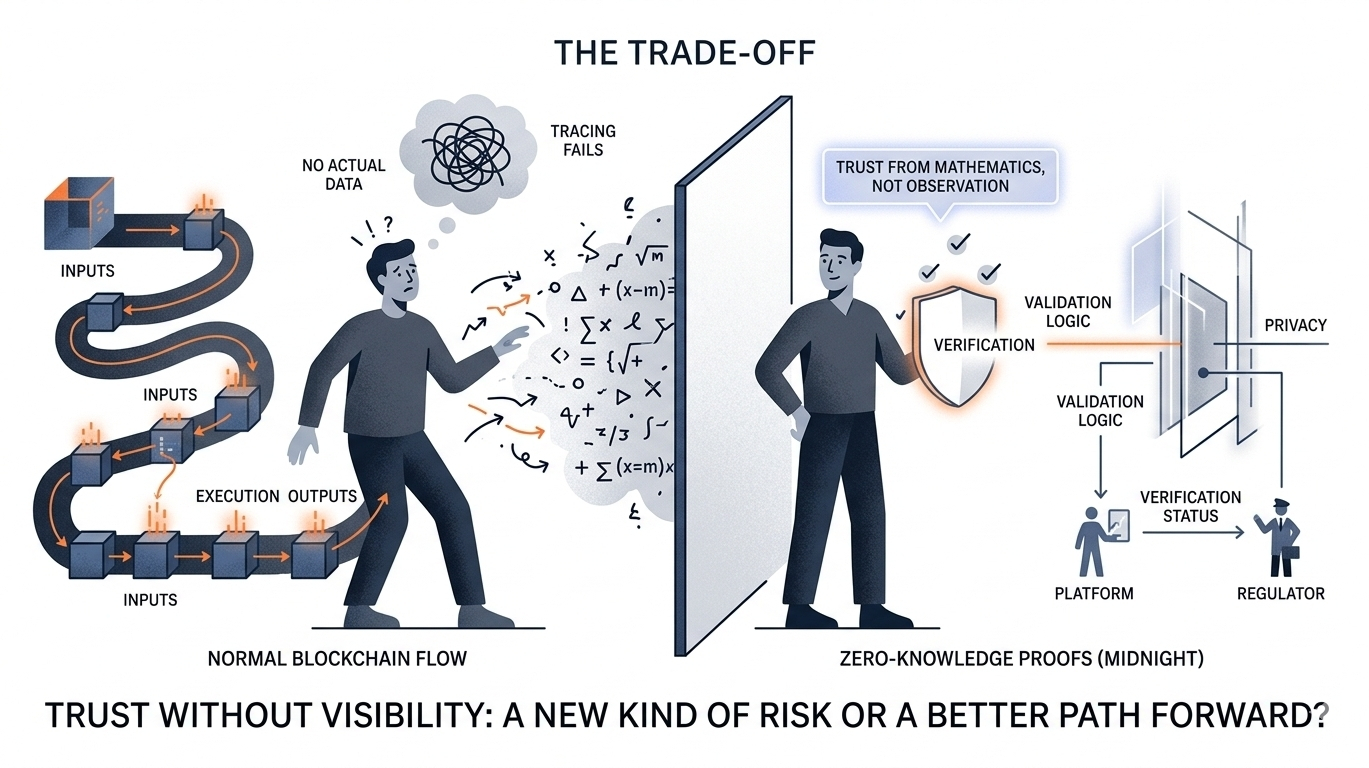

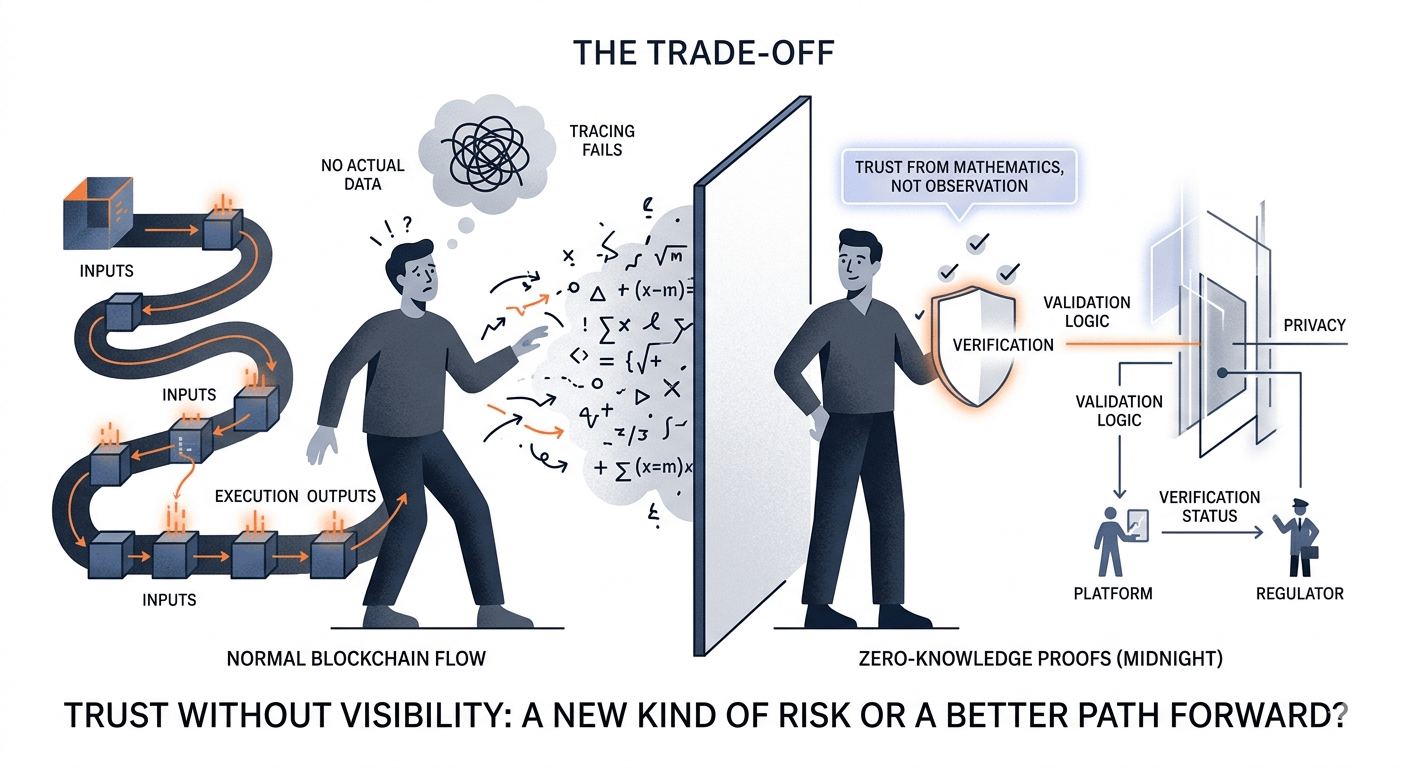

Eu me peguei fazendo algo ligeiramente ridículo hoje—tentando “rastrear” uma transação do Midnight como se fosse um fluxo normal de blockchain. Entradas, execução, saídas. Limpo, linear, visível. Exceto… não funciona assim. Quanto mais eu tentava seguir o caminho, mais ele se dissolvia em provas e confirmações sem dados reais para agarrar. Em algum momento, eu parei e percebi que o sistema não foi projetado para ser seguido. Ele foi projetado para ser aceito.

E, honestamente, eu entendo o porquê.

Midnight é construído em torno da ideia de que a verificação não precisa de exposição. Provas de conhecimento zero permitem que a rede confirme que algo está correto sem revelar o que esse “algo” realmente é. Validadores não interpretam transações, eles validam provas. É eficiente, quase minimalista. Remova tudo o que é desnecessário, deixe apenas a correção.

Mas eu continuo circulando o trade-off, porque não parece trivial.

Quando você remove a visibilidade, também remove um certo tipo de entendimento compartilhado. Na maioria dos sistemas, múltiplos participantes podem olhar para os mesmos dados e concordar sobre o que aconteceu. Aqui, o acordo vem da matemática, não da observação. É preciso, mas também distante. E eu não tenho certeza se as pessoas naturalmente confiam no que não podem inspecionar, mesmo que lhes digam que é provadamente correto.

Então vem a questão de quem mais se beneficia.

Os usuários obtêm privacidade, obviamente. Essa parte é clara. Mas as instituições—serviços, plataformas, até reguladores—obtêm algo diferente: a capacidade de verificar condições sem manter dados sensíveis. Isso reduz o risco, mas também desloca o controle para quem define a lógica por trás dessas provas. Se as regras estiverem embutidas profundamente o suficiente, questioná-las se torna mais difícil, não mais fácil.

Essa parte me faz hesitar.

Porque a Midnight não apenas oculta dados, ela eleva a lógica. O sistema assume que se a lógica estiver correta, tudo o mais segue. Mas a lógica é escrita por alguém. Projetada com suposições. E essas suposições nem sempre sobrevivem à complexidade do mundo real.

Eu também continuo pensando sobre a fricção, o tipo que não aparece em diagramas técnicos. A geração de provas consome recursos. A execução privada complica a depuração. Os desenvolvedores podem se ver trabalhando em uma escuridão parcial, construindo sistemas que não podem observar completamente. É gerenciável em teoria. Na prática, pode parecer como montar algo com peças faltando.

De forma direta: a abstração é útil até se tornar desorientadora.

E então vem a adoção. Não a versão otimista, mas a bagunçada. Usuários mal interpretando o que está acontecendo. Sistemas sob carga. Casos extremos se acumulando. O design da Midnight pode lidar com a correção perfeitamente, mas conseguirá lidar com confusão, hesitação, uso indevido?

Ainda assim, eu continuo voltando a isso.

Porque por trás de toda a incerteza, há uma ideia consistente: que a confiança não precisa vir da visibilidade, que a privacidade e a verificação podem coexistir sem compromisso. É uma afirmação forte, mesmo que não seja declarada em voz alta.

Eu ainda não estou totalmente convencido de que remover a visibilidade não introduz um tipo diferente de risco—mais silencioso, mais difícil de detectar, mas ainda lá.

E talvez essa seja a verdadeira tensão aqui.

Não se trata de saber se a Midnight funciona, mas se as pessoas se sentirão confortáveis em confiar em algo que não podem ver verdadeiramente, mesmo quando está funcionando exatamente como pretendido.

\u003ct-46/\u003e \u003cc-48/\u003e \u003cm-50/\u003e