Infrastructura AI-prim este nu este descoperirea, descoperirea este să ai un strat de decontare neutru pe care sistemele AI nu pot să-l evite.

Cei mai mulți oameni o ratează pentru că tratează „AI” ca produs, nu ca un nou tip de utilizator care are nevoie de coordonare.

Schimbă totul pentru constructori și utilizatori pentru că partea dificilă devine responsabilitatea: cine a făcut ce, când, și ce va accepta sistemul ca fiind final.

Am început să acord atenție acestui lucru când am văzut automatizarea bună eșuând în moduri plictisitoare: plăți care „păreau finalizate” dar nu erau, aprobatări care au fost anulate și roboți care se comportau perfect într-un sandbox, dar s-au stricat în momentul în care au atins bani reali sau utilizatori reali. Nimic nu a fost dramatic, doar mici discrepanțe între ceea ce o aplicație presupunea și ceea ce lumea mai largă recunoștea de fapt. În timp, înveți că fiabilitatea este o caracteristică, și de obicei este cea mai scumpă de cumpărat mai târziu.

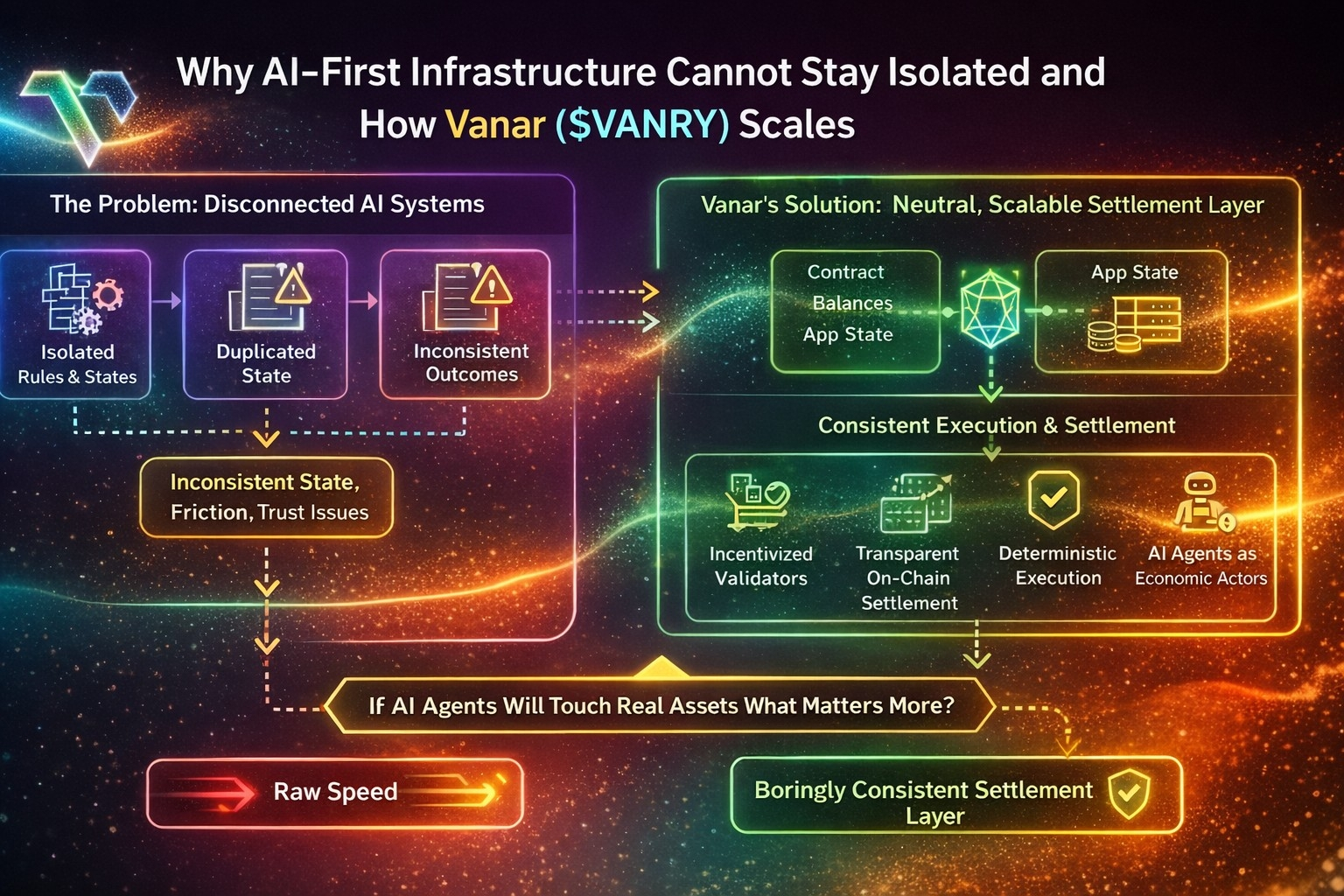

Fricțiunea concretă este simplă: sistemele AI nu pot rămâne izolate pentru că valoarea lor provine din acțiunea pe parcursul multor aplicații, portofele, jocuri, piețe și surse de date. În momentul în care un agent AI trece de la a „sugera” la a „executa”, are nevoie de un loc unde acțiunile sunt înregistrate, ordonate și decontate într-un mod pe care alte sisteme îl vor respecta. Dacă fiecare aplicație își rulează propriile reguli, obții o stare duplicată, rezultate inconsistent și o argumentație constantă despre ce este real: a avut loc transferul, a fost generat obiectul, s-a schimbat permisiunea, a fost clarificat plățile. Aceasta nu este o problemă AI, ci o problemă de infrastructură pe care AI o face mai frecventă și mai adversarială.

Este ca și cum ai încerca să conduci un oraș în care fiecare cartier își tipărește propriul timp și îl numește „oficial”.

Calea scalabilă a lui Vanar, din această perspectivă, este mai puțin despre adăugarea de caracteristici AI izolate și mai mult despre a fi un mediu de execuție și de decontare constant, în care alte sisteme pot fi integrate fără a renegocia încrederea de fiecare dată. Concentrează-te pe o idee de bază: stare comună, deterministă care transformă „intenția agentului” în rezultate verificabile. Dacă un agent AI va acționa în numele unui utilizator, rețeaua trebuie să ofere tuturor același răspuns la o întrebare: care este starea curentă și ce modificări sunt valide.

Din punct de vedere mecanic, asta înseamnă un model de stare direct pe lanț, unde conturile și contractele (sau logica aplicației) produc un singur registru canonic al soldurilor, permisiunilor și stării aplicației. O tranzacție, fie că este trimisă de un utilizator, un serviciu sau un agent care acționează sub autoritate delegată, intră într-un mempool, este ordonată de validatori și este executată împotriva stării curente. Validatorii verifică semnăturile și regulile, rulează tranziția de stare și se angajează în noua stare odată ce consensul finalizează blocul. Cheia este că verificarea este publică: oricine poate verifica că tranziția a respectat regulile protocolului, chiar dacă nu au încredere în agentul care a inițiat-o.

Incentivele sunt cele care fac ca această promisiune să rămână valabilă în zilele proaste. Validatorii pun în joc VANRY pentru a participa și pentru a face comportamentul greșit costisitor. Taxele există pentru a prețui resursele rare, spațiul pe bloc și execuția și pentru a preveni spamul, mai ales când „agenții” pot genera acțiuni cu viteza mașinii. Guvernarea există pentru a ajusta parametrii care trebuie inevitabil reglați în timp: politica de taxe, cerințele de stocare, limitele care conturează debitul față de siguranță și regulile în jurul actualizărilor. Niciuna dintre acestea nu garantează că rețeaua este „sigură” în mod magic, dar înseamnă că sistemul are o modalitate definită de a coordona schimbarea în loc să se bazeze pe încrederea informală între aplicații.

Modurile de eșec încă contează. Dacă validatorii ies offline sau nu sunt de acord, activitatea poate să degradeze și finalizarea poate să încetinească, ceea ce este mortal pentru automatizarea care presupune decontare instantanee. Dacă validatorii cenzurează, unele acțiuni pot fi întârziate chiar dacă sunt valide. Dacă permisiunile delegate ale unui agent sunt prea largi, lanțul va executa cu fidelitate o decizie proastă, deoarece blockchains nu cunosc intenția, ci doar autorizația și regulile. Și dacă dezvoltatorii construiesc dependențe externe (date off-chain, poduri, custode), acele dependențe pot eșua în timp ce lanțul rămâne „corect”, creând o prăpastie între adevărul registrului și experiența utilizatorului. Ceea ce este garantat este îngust: tranzacții valide, corect autorizate, vor fi executate conform regulilor protocolului și vor fi înregistrate odată ce sunt finale. Ceea ce nu este garantat este judecata bună, datele bune sau UX bun construit pe deasupra.

Incertitudine: dacă agenții AI devin actori economici semnificativi, adversarii vor viza cel mai slab punct de coordonare, validatori, portofele, permisiuni sau conexiuni off-chain și securitatea din lumea reală va depinde la fel de mult de disciplina operațională cât și de designul protocolului.

Dacă presupui că agenții AI vor atinge active reale și identități reale, ce crezi că contează mai mult: viteza brută sau un strat de decontare care este plictisitor de constant sub stres?