Cu cât folosesc mai mult instrumentele AI în fluxurile de lucru reale de luare a deciziilor, cu atât sunt mai puțin impresionat de cât de rafinate sună. Fluiditatea nu mai este rară. Ceea ce rămâne rar este certitudinea.

AI-ul modern poate scrie persuasiv, poate rezuma eficient și poate construi argumente logice. Dar ai permite să execute ceva irevocabil fără revizuire? Majoritatea oamenilor ezită. Această ezitare reflectă o problemă structurală mai profundă.

Modelele AI generează rezultate probabilistice. Ele prezic modele; nu verifică în mod inerent adevărul. Când apar erori, ele par adesea încrezătoare. Aceasta nu este o mică defectiune a interfeței - este o limitare a arhitecturii.

Când am explorat rețeaua Mira, ceea ce a ieșit în evidență nu a fost o încercare de a construi un model de limbaj mai puternic. În schimb, accentul este pus pe verificare. Mira se poziționează ca un strat descentralizat care evaluează rezultatele AI înainte ca încrederea să fie asumată.

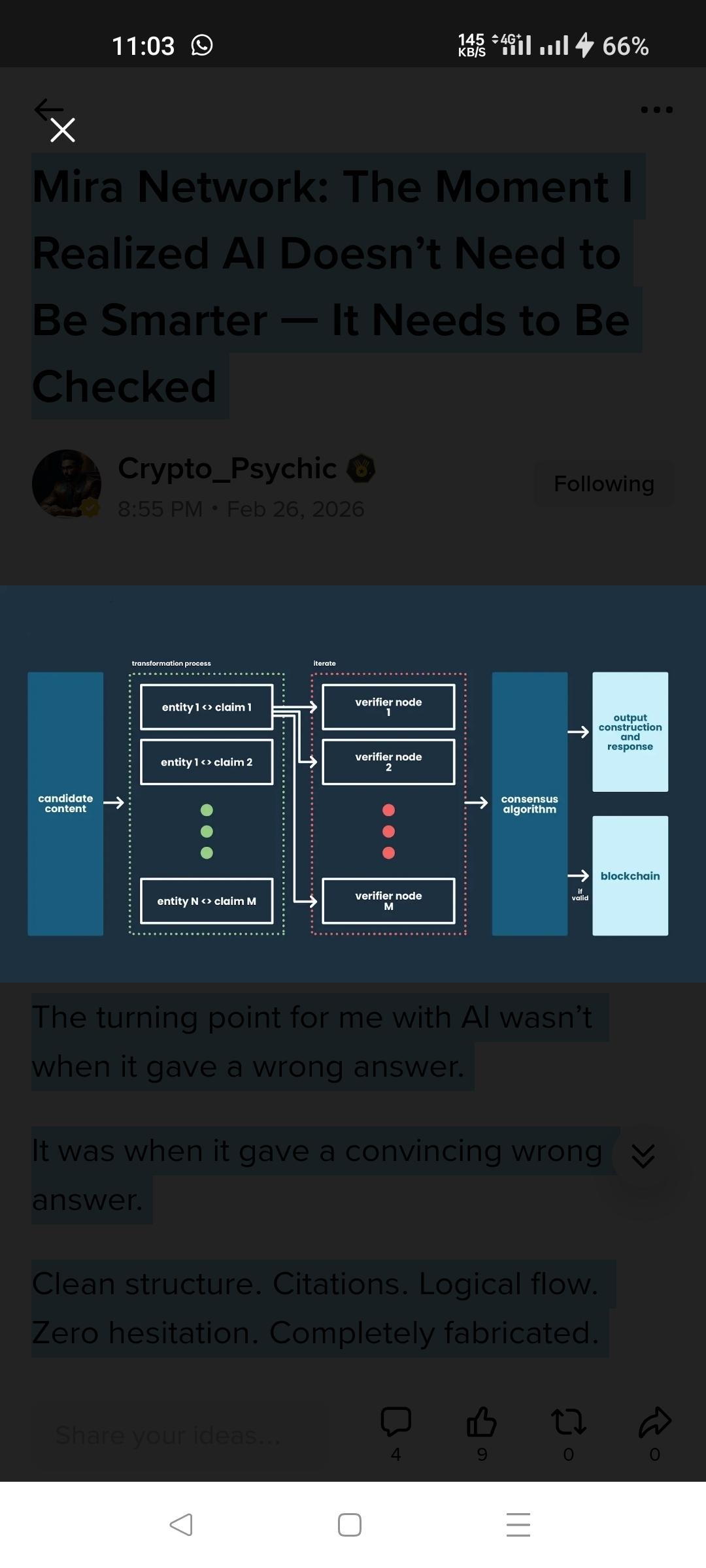

În loc să trateze un răspuns AI ca pe un singur răspuns indivizibil, sistemul îl descompune în afirmații mai mici. Aceste afirmații sunt apoi evaluate de validatorii distribuiți. Mecanismele de consens și stimulentele economice sunt folosite pentru a coordona rezultatele validării.

Aceasta schimbă modelul de încredere. În loc să ne bazăm pe autoritatea unui singur furnizor, validarea devine distribuită și aliniată la interes. Validatorii au stimulente să evalueze cu atenție afirmațiile, deoarece rezultatele le afectează economic.

Această distincție devine importantă pe măsură ce sistemele AI se îndreaptă către o autonomie mai mare. În contexte precum analiza financiară, fluxurile de lucru ale întreprinderilor sau sistemele de execuție automată, „în mare parte precise” poate să nu fie suficient. Rezultatele pot necesita să fie contestabile și audibile.

Designul lui Mira sugerează că halucinațiile nu vor dispărea complet — și în schimb construiește mecanisme în jurul verificării. Această abordare pare pragmatică mai degrabă decât idealistă.

Există întrebări deschise. Granularitatea afirmației, alinierea validatorilor și stimulentele de coordonare sunt provocări de design complexe. Sistemele distribuite sunt rareori simple. Dar teza de bază este clară: inteligența de una singură nu garantează fiabilitatea.

Pe măsură ce AI devine mai integrat în sistemele critice, infrastructura de responsabilitate poate deveni din ce în ce mai importantă.

Mira explorează acel strat.

Nu prin promisiunea unei inteligențe perfecte — ci prin concentrarea pe încrederea verificabilă.

@Mira - Trust Layer of AI #mira $MIRA