Pe măsură ce sistemele AI devin din ce în ce mai integrate în viața noastră de zi cu zi și în infrastructura critică, riscurile halucinațiilor AI și ale prejudecăților sistemice cresc exponențial. Nu ne mai putem baza doar pe rezultatele probabilistice ale modelelor de limbaj mari, în special în domenii cu mize mari, cum ar fi sănătatea, finanțele și aplicațiile descentralizate. Acesta este exact locul unde @Mira - Trust Layer of AI intervine pentru a schimba regulile jocului.

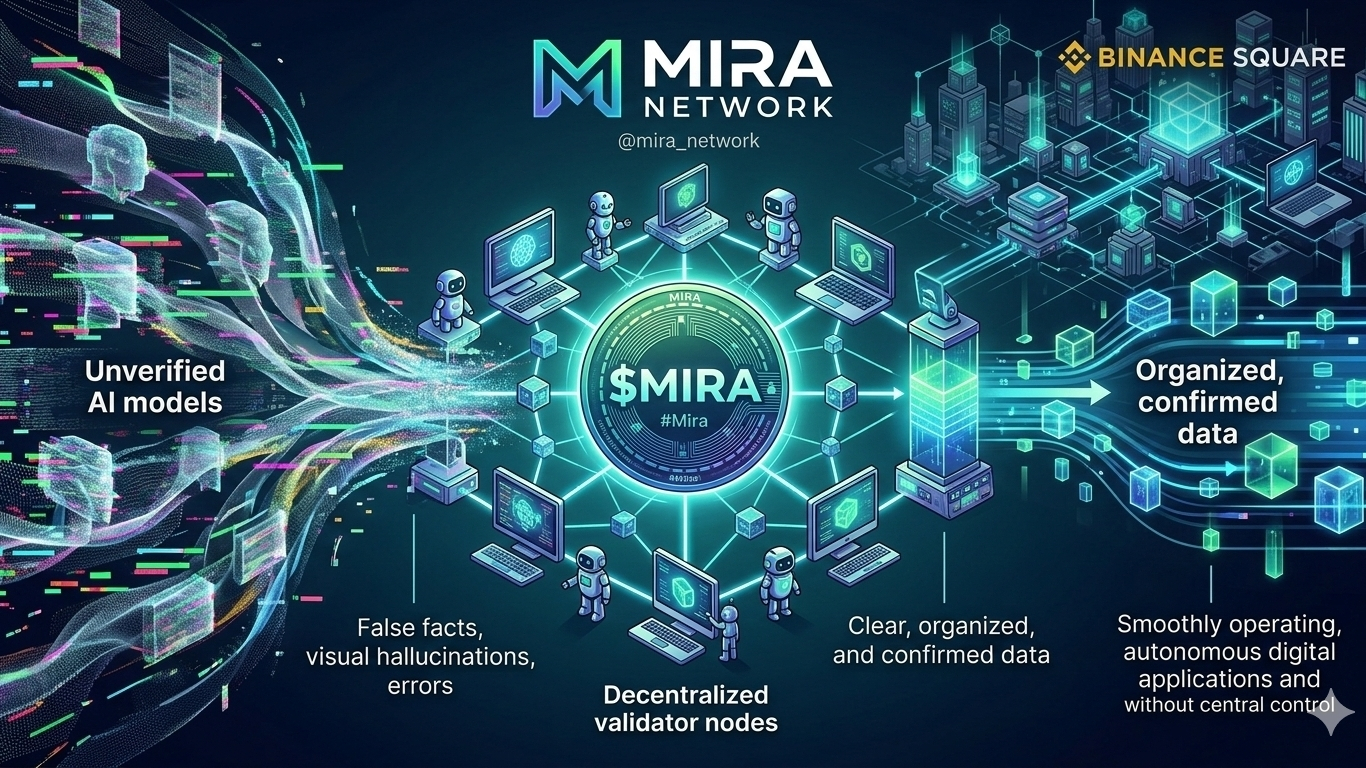

În loc să ne bazăm pe o autoritate centralizată pentru a verifica faptele AI, Mira construiește un "Strat de Încredere" descentralizat care verifică criptografic rezultatele AI. Funcționează prin descompunerea conținutului complex generat de AI în afirmații mai mici, verificabile independent, și apoi folosește un mecanism de consens între mai multe modele AI distincte pentru a asigura o acuratețe absolută. Acest lucru transformă efectiv fiabilitatea AI într-o problemă de inginerie rezolvabilă, mai degrabă decât într-un joc de ghicit probabilistic.

La baza acestui ecosistem de verificare descentralizat se află tokenul $MIRA . Acesta funcționează pe un model robust de Proof-of-Stake, unde nodurile validator trebuie să stake-uiască tokenuri pentru a participa în procesul de verificare. Validarea onestă este răsplătită cu stimulente de rețea, în timp ce comportamentul necinstit sau leneș duce la reducerea stake-urilor. Această structură criptoeconomică asigură că rețeaua rămâne sigură, extrem de scalabilă și complet aliniată cu scopul de a crea o AI de încredere și autonomă.

Pe măsură ce avansăm rapid spre o eră digitală autonomă, AI verificabil nu este doar un lux—este o necesitate absolută. Încrederea nu poate fi doar presupusă; trebuie să fie integrată în infrastructură. Proiectele care umplu acest gol pun bazele esențiale pentru viitorul Web3 și automatizarea inteligentă. #Mira