Inteligența Artificială este peste tot astăzi. Scrie, calculează, prezice, rezumă, recomandă și chiar oferă sfaturi. Cu toate acestea, sub capabilitățile sale impresionante se află o îngrijorare tăcută, dar serioasă: AI poate suna încrezător chiar și atunci când greșește. Poate genera răspunsuri care par precise, dar sunt bazate pe presupuneri greșite, date incomplete sau fapte halucinate. În situații cu riscuri reduse, aceasta poate fi inofensivă. În medii cu riscuri mari, cum ar fi sănătatea, finanțele, sistemele legale sau operațiunile autonome, poate fi periculoasă.

Rețeaua Mira s-a născut din această tensiune exactă între inteligență și fiabilitate. Viziunea sa nu este de a construi un alt model AI puternic care să concureze pentru atenție. În schimb, își propune să rezolve o problemă structurală mai profundă — cum facem ca rezultatele AI să fie demne de încredere la scară?

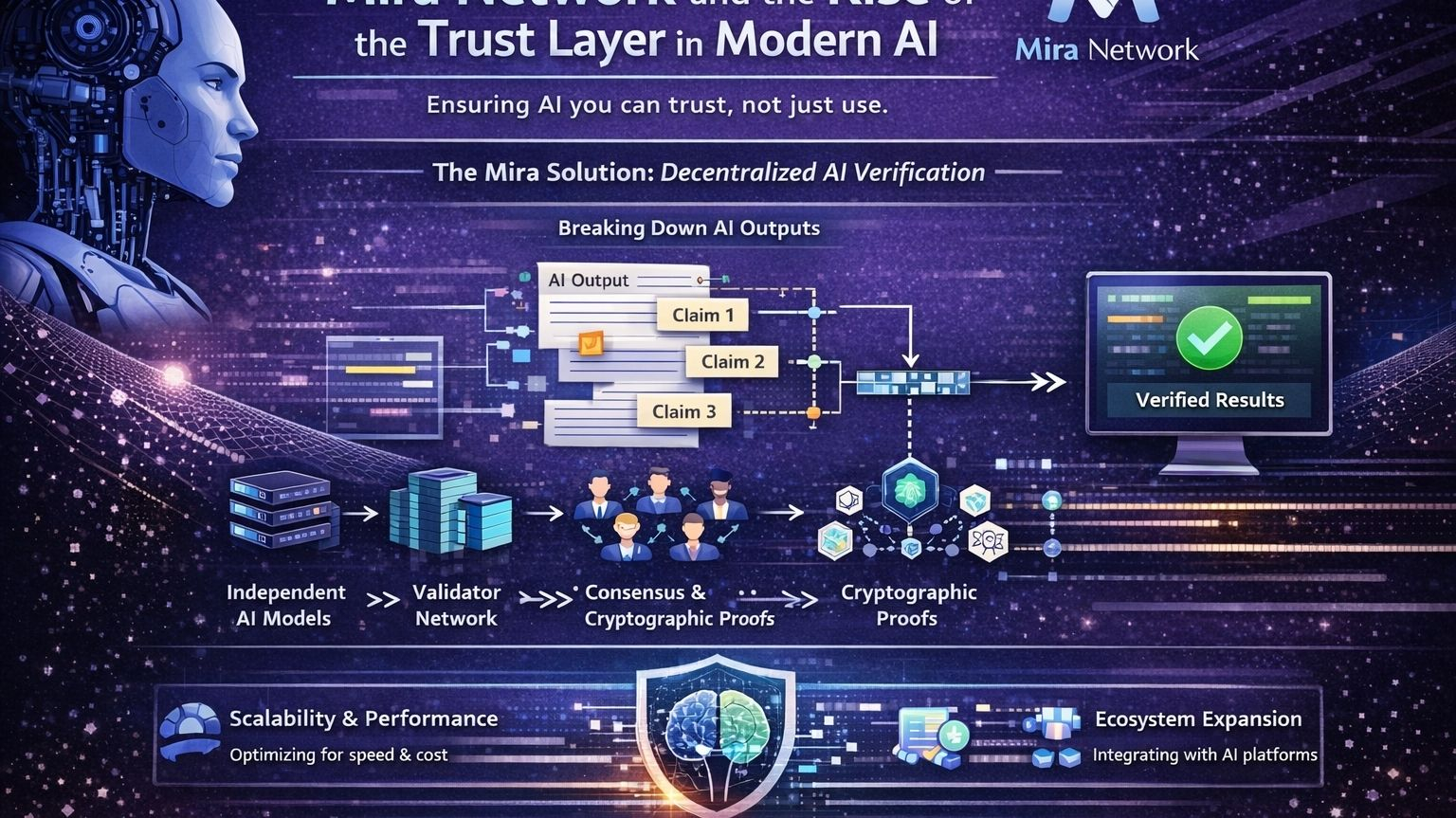

În esență, Mira își imaginează o lume în care răspunsurile AI nu sunt acceptate pe nemestecate, ci verificate independent înainte de a influența deciziile reale. În loc să ceară utilizatorilor să aibă încredere într-un singur furnizor centralizat, Mira își imaginează un mediu descentralizat în care informațiile generate de AI trec printr-o rețea de validatorii. În acest sistem, încrederea nu provine din reputația mărcii sau din autoritatea corporativă. Ea provine din consens, verificare criptografică și aliniere economică.

Ideea este simplă, dar transformatoare. Când un AI produce un răspuns complex, Mira nu îl tratează ca pe un singur bloc de text. Îl descompune în afirmații mai mici, logice. Fiecare afirmație factuală, fiecare concluzie, fiecare referință statistică devine ceva ce poate fi examinat independent. Aceste afirmații sunt apoi distribuite între mai multe modele AI și validatorii care le evaluează separat. Numai când acordul atinge un prag definit, sistemul finalizează rezultatul.

Această abordare reduce dramatic riscul de prejudecată a unui singur model, halucinație sistemică sau inexactitate ascunsă. În loc să avem încredere într-un singur "creier," sistemul se bazează pe inteligența colectivă. Diversitatea devine o protecție.

Dar misiunea lui Mira depășește designul tehnic. Aceasta include și stimulente economice pentru a asigura participarea onestă. Validatorii din rețea pot miza tokenuri ca garanție, aliniind interesele lor financiare cu acuratețea. Dacă verifică responsabil, sunt recompensați. Dacă acționează necinstit sau neglijent, pot apărea penalizări. Acest lucru creează un sistem unde acuratețea nu este doar încurajată — este rațională din punct de vedere economic.

Imaginează-ți cum ar funcționa acest lucru în practică. Un AI medical generează un rezumat diagnostic. În loc să acționeze imediat pe baza acestuia, rezumatul este descompus în afirmații medicale individuale și corelații. Mai multe modele independente revizuiesc aceste afirmații. Validatorii compară rezultatele. Se formează consens. Numai atunci rezultatul este confirmat. Același proces ar putea fi aplicat modelor de prognoză financiară, analizei legale automate, roboticii industriale sau sistemelor autonome de decizie. În fiecare caz, verificarea devine o măsură de siguranță încorporată, nu o idee ulterioară.

Ce face ca Mira să fie deosebit de captivant este poziționarea sa. Nu încearcă să înlocuiască furnizorii existenți de AI. Acționează ca un strat de infrastructură — un motor de verificare care se poate integra cu diferite sisteme AI. În timp ce auditarea tradițională a AI se bazează pe recenzii centralizate sau corecții ulterioare, Mira introduce validarea proactivă, pe lanț, înainte ca rezultatele să fie finalizate.

Desigur, construirea unui astfel de sistem nu este lipsită de provocări. Verificarea descentralizată introduce costuri computaționale. Mecanismele de consens pot crea latență. Descompunerea răspunsurilor complexe în afirmații structurate necesită un design sofisticat. Echilibrarea vitezei cu fiabilitatea este o provocare tehnică continuă. Totuși, recunoașterea acestor obstacole întărește credibilitatea misiunii. Inovația la acest nivel necesită atât ambiție, cât și realism.

Pe termen scurt, accentul lui Mira se află pe dezvoltarea protocolului său, integrarea validatorilor și pilotarea integrărilor cu platformele AI. Pe termen mediu, își propune să își extindă ecosistemul, să își rafineze modelul economic și să întărească interoperabilitatea. Pe termen lung, ambiția este mult mai mare — să devină un strat de încredere fundamental pentru inteligența artificială la nivel mondial.

Semnificația mai largă a rețelei Mira constă în schimbarea sa filozofică. De ani de zile, societatea a abordat AI cu un amestec de entuziasm și prudență. Ne minunăm de capabilitățile sale, în timp ce ne întrebăm în tăcere despre acuratețea sa. Mira reformulează conversația. În loc să întrebăm dacă putem avea încredere în AI, întrebăm cum putem construi sisteme care fac ca încrederea să fie inutilă — sisteme în care verificarea este automată, transparentă și descentralizată.

Dacă inteligența artificială reprezintă mintea viitorului nostru digital, rețeaua Mira aspiră să ofere sistemul său imunitar — verificând constant, validând și filtrând înainte ca deciziile să contureze realitatea. Într-o lume tot mai influențată de sisteme autonome, un astfel de strat de încredere poate să nu doar îmbunătățească AI. Poate defini evoluția sa sigură.

@Mira - Trust Layer of AI #Mira $MIRA