După ce am petrecut ceva timp citind documentația lui Mira și urmărind actualizările de la @Mira - Trust Layer of AI , am ajuns să văd rețeaua Mira mai puțin ca „un alt proiect de IA” și mai mult ca o încercare de a rezolva o bottleneck foarte specific: cum putem verifica ce spun sistemele de IA fără a ne baza pe o singură companie pentru a defini ce este adevărat?

Această întrebare devine din ce în ce mai greu de ignorat.

Modelele mari de IA sunt puternice, dar totuși ele halucinează. Pot produce răspunsuri sigure care sunt parțial greșite, subtil părtinitoare sau pur și simplu imposibil de verificat. Astăzi, validarea se întâmplă de obicei în interiorul sistemelor centralizate. O companie antrenează un model, construiește conducte interne de evaluare și decide când rezultatul este „suficient de bun.” Utilizatorii nu văd cu adevărat cum funcționează acea validare. Ne bazăm în principal pe brand.

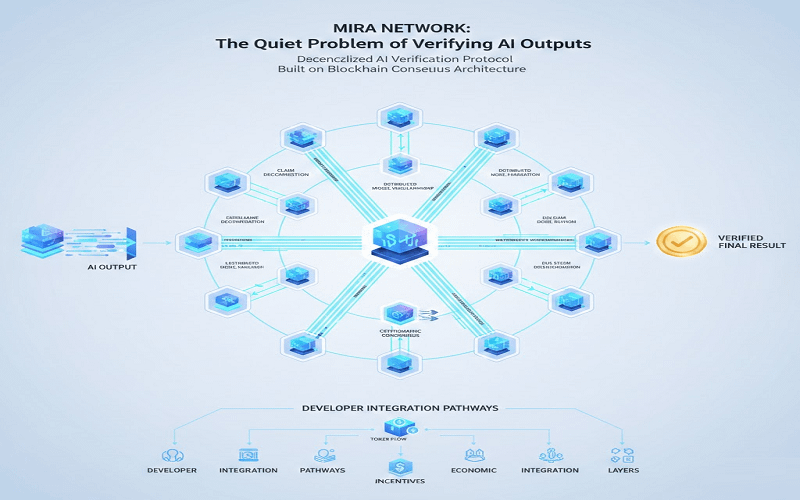

#MiraNetwork abordează acest lucru diferit. În loc să presupună că un singur model sau o singură organizație poate servi ca autoritate finală, tratează rezultatele AI ca afirmații care pot fi verificate independent.

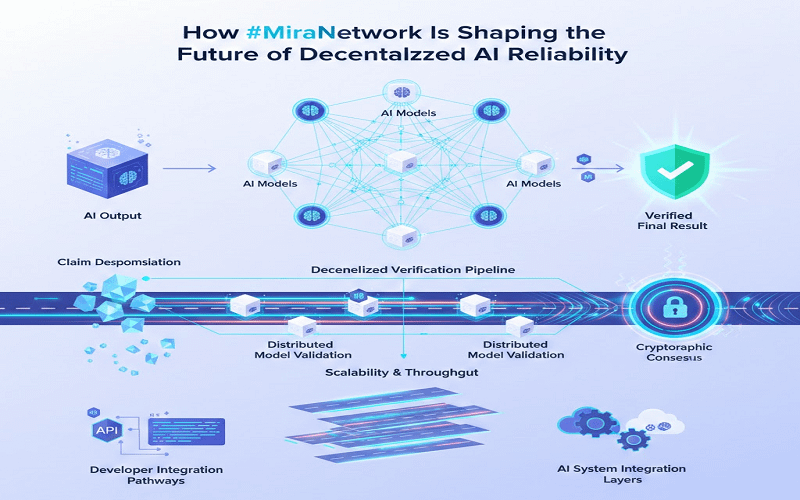

Modul în care funcționează, în termeni simpli, este că un răspuns AI este descompus în afirmații mai mici, testabile. În loc să întrebe „Este acest răspuns corect?” într-un sens larg, sistemul pune întrebări mai granulare, cum ar fi: această afirmație factuală este susținută, acest număr se potrivește cu datele cunoscute, acest raționament se contrazice?

Aceste afirmații sunt apoi evaluate în cadrul mai multor modele AI independente din rețea. Dacă mai multe modele converg asupra aceluiași rezultat de validare, acel consens este înregistrat. Dacă ele diverge, dezacordul devine parte din semnal. Ideea este mai aproape de un strat distribuit de verificare a faptelor decât de un singur gardian.

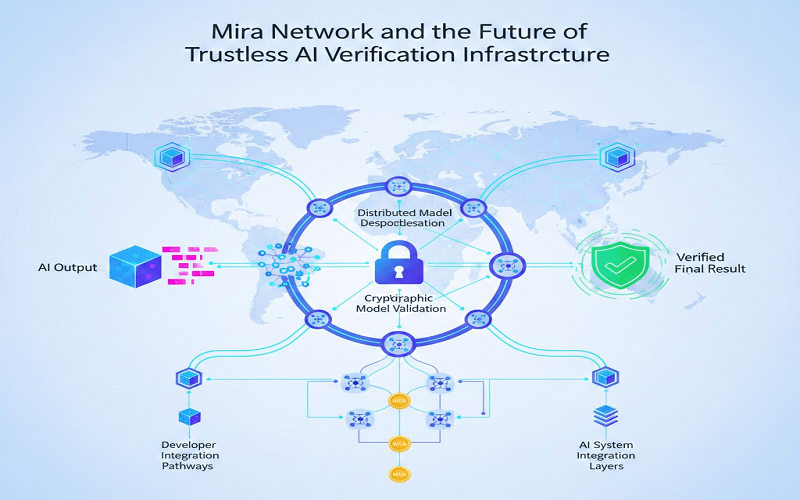

Aici blockchain joacă un rol structural. În loc să se bazeze pe un server central pentru a înregistra ce rezultat a trecut validarea, Mira ancorează rezultatele validării pe lanț. Consensul bazat pe blockchain și verificarea criptografică asigură că, odată ce rezultatul verificării unei afirmații este înregistrat, nu poate fi modificat în tăcere. Încrederea se mută de la „avem încredere în această companie” la „avem încredere în reguli și criptografie.”

Îmi amintește de modul în care dezinformarea se răspândește online. Dacă doar o singură autoritate etichetează ceva ca fiind fals, oamenii pun la îndoială autoritatea. Dar dacă mai mulți analiști independenți revizuiesc aceeași afirmație și ajung la o concluzie similară, aceasta cântărește mai mult. Mira încearcă să formalizeze acel proces pentru rezultatele AI.

Tokenul, $MIRA , se încadrează în această structură ca un instrument de coordonare economică. Validatorii care participă la verificarea afirmațiilor sunt stimulați să acționeze corect. Dacă se comportă malițios sau neglijent, există mecanisme pentru a reduce recompensele sau a-i penaliza. Aceasta introduce un cost pentru necinste, pe care sistemele AI centralizate nu îl expun întotdeauna în mod transparent.

Din perspectiva sistemelor, partea interesantă este că Mira nu încearcă să construiască „cel mai bun model.” Construiește un strat de verificare care poate sta deasupra multor modele. Asta o face mai mult ca o infrastructură decât o aplicație. Teoretic, orice sistem AI ar putea direcționa rezultatele sale prin această rețea distribuită de verificare înainte de a prezenta rezultate utilizatorilor finali.

Desigur, există limite practice.

Descompunerea rezultatelor AI în afirmații structurale necesită calcul. Rularea mai multor modele pentru a valida încrucișat acele afirmații crește costul. Coordonarea între validatorii distribuiți adaugă latență. Iar spațiul infrastructurii AI descentralizate devine competitiv, cu alte protocoale explorând straturi similare de fiabilitate.

Există de asemenea întrebarea maturității. O rețea de verificare este la fel de puternică precum participarea validatorilor și diversitatea modelului. În etapele incipiente, ecosistemul este încă în formare. Asta înseamnă că îmbunătățirile fiabilității pot fi graduale, mai degrabă decât imediate.

Dar din punct de vedere conceptual, schimbarea este semnificativă.

În loc să ceară utilizatorilor să aibă încredere într-un furnizor de model, Mira introduce un sistem în care validarea este transparentă, aliniată economic și înregistrată într-un mod rezistent la manipulare. Aceasta schimbă conversația despre fiabilitatea AI de la „În cine să avem încredere?” la „Ce arată consensul rețelei?”

Dacă te uiți la discuțiile de sub #Mira , vei observa că accentul este adesea mai puțin pe performanța brută a modelului și mai mult pe verificabilitate și coordonare. Asta se simte ca o direcție mai bine fundamentată pentru infrastructura AI, în special pe măsură ce modelele devin din ce în ce mai autonome.

În contextul mai larg al AI și blockchain, Rețeaua Mira nu încearcă să înlocuiască inteligența. Încearcă să o verifice.

Și acea distincție ar putea conta mai mult decât ne dăm seama.