Recent, am examinat Mira Network și tokenul $MIRA dintr-o perspectivă tehnologică și de infrastructură, mai degrabă decât să mă concentrez doar pe prețul său de piață. Ceea ce mă interesează cel mai mult este modul în care este conceput rețeaua, cum funcționează sistemele sale interne și ce rol joacă tokenul în cadrul ecosistemului mai larg.

Inteligența artificială evoluează cu o viteză incredibilă. Sistemele de IA de astăzi pot genera perspective impresionante, automatiza sarcini și susține procese complexe de luare a deciziilor. Cu toate acestea, alături de aceste avansuri, o problemă serioasă continuă să existe: fiabilitatea.

Sistemele AI pot produce uneori halucinații, rezultate părtinitoare sau rezultate inconsistente. În aplicațiile informale sau de divertisment, acest lucru poate să nu cauzeze daune majore, dar în medii unde deciziile au consecințe reale, riscurile devin semnificative. Serviciile financiare, sănătatea, analiza juridică și deciziile politice necesită toate un nivel mult mai ridicat de certitudine decât sistemele AI actuale pot oferi în mod constant.

Această provocare este parte din motivul pentru care a fost dezvoltat Mira Network. Proiectul se concentrează pe transformarea rezultatelor AI în informații verificabile, mai degrabă decât să accepte pur și simplu rezultatul unui singur model.

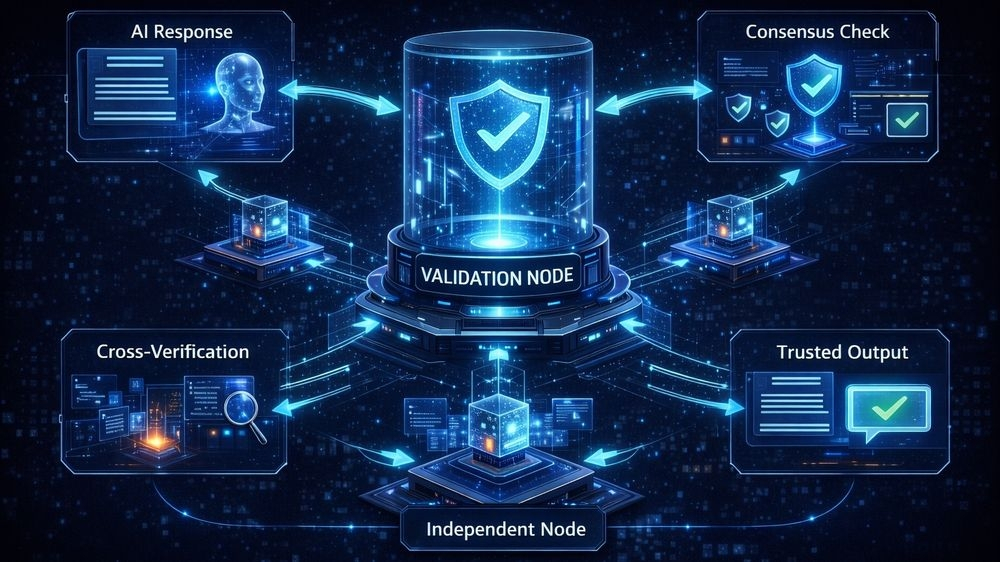

Conceptul din spatele Mira este relativ simplu, dar puternic. În loc să se bazeze pe un singur model de AI pentru a genera și valida un răspuns, Mira descompune rezultatele complexe ale AI în afirmații individuale verificabile. Aceste afirmații sunt apoi distribuite pe o rețea unde mai multe sisteme AI participă în verificarea acurateței informațiilor.

Prin acest proces, sistemul introduce un strat suplimentar de verificare care lipsește adesea în arhitecturile tradiționale de AI. În loc să aibă încredere într-un singur sistem, rețeaua creează un mecanism de validare colaborativ.

Unul dintre principalele avantaje ale acestei abordări este transparența. Rezultatele procesului de verificare pot fi înregistrate pe un blockchain, creând un record trasabil al modului în care a fost ajuns la o concluzie. Dezvoltatorii și organizațiile pot revizui aceste înregistrări pentru a înțelege calea de verificare din spatele unui rezultat generat de AI.

Acest nivel de transparență este deosebit de important în sectoare unde responsabilitatea și auditabilitatea sunt esențiale.

Un alt aspect interesant al Mira Network este designul său neutru. Sistemul nu este construit în jurul unui singur furnizor sau model de AI. În schimb, este conceput pentru a lucra cu multiple sisteme AI de la diferiți dezvoltatori. Permițând diferitelor modele să evalueze și să verifice rezultatele unii altora, rețeaua își propune să reducă dependența de orice sursă unică de informații.

În teorie, această structură ar putea îmbunătăți semnificativ fiabilitatea informațiilor generate de AI.

Cu toate acestea, la fel ca în cazul oricărei infrastructuri emergente, rămân mai multe întrebări importante. Rețelele de verificare trebuie să asigure mecanisme de stimulare puternice pentru validatori pentru a participa onest. Fără stimulente corespunzătoare, sistemul ar putea avea dificultăți în a menține o participare fiabilă.

Există, de asemenea, provocări legate de scalabilitate și guvernanță. Pe măsură ce rețeaua crește, trebuie să mențină eficiența în timp ce previne riscuri precum coluziunea sau manipularea validatorilor. Cadrele de guvernanță vor juca un rol important în determinarea modului în care sistemul evoluează și se adaptează în timp.

În ciuda acestor provocări, Mira Network reprezintă o schimbare interesantă în conversația despre inteligența artificială. Marea parte a discuției actuale despre AI se concentrează pe capacitate — cât de puternice devin modelele.

Mira introduce o perspectivă diferită: verificare.

Dacă straturile de verificare devin adoptate pe scară largă, ele ar putea juca un rol critic în modul în care sistemele AI sunt implementate în medii reale. Verificarea fiabilă ar putea deveni infrastructura lipsă care permite AI să treacă de la instrumente experimentale la sisteme de suport decizional de încredere.

În acest context, proiecte precum Mira Network și ecosistemul $MIRA explorează o întrebare importantă: nu doar ce poate face AI, ci și cum putem avea încredere în ceea ce produce.