Ceva important se desfășoară liniștit în infrastructura crypto. Multe persoane încă o consideră o problemă viitoare, dar deja se întâmplă acum.

Agenții AI operează activ pe rețelele blockchain. Ei gestionează portofele, ajustează strategiile DeFi, execută tranzacții și realocă lichiditățile între protocoale. Ceea ce a fost odată descris ca o „economy AI” teoretică începe să apară mai devreme decât se aștepta.

Și acel schimb dezvăluie o lacună structurală.

Când un om face o tranzacție, responsabilitatea este clară. Un portofel semnează tranzacția și decizia poate fi urmărită înapoi la o persoană.

Când un contract inteligent execută o acțiune, regulile sunt vizibile pe lanț. Oricine poate examina codul și înțelege logica care a declanșat tranzacția.

Dar când un agent AI folosește informații dintr-un model de limbaj pentru a decide când să tranzacționeze, cât de multă lichiditate să mute sau ce poziție să închidă, stratul de responsabilitate devine neclar. Raționamentul din spatele deciziei poate exista în ieșirile modelului care lasă puține dovezi verificabile.

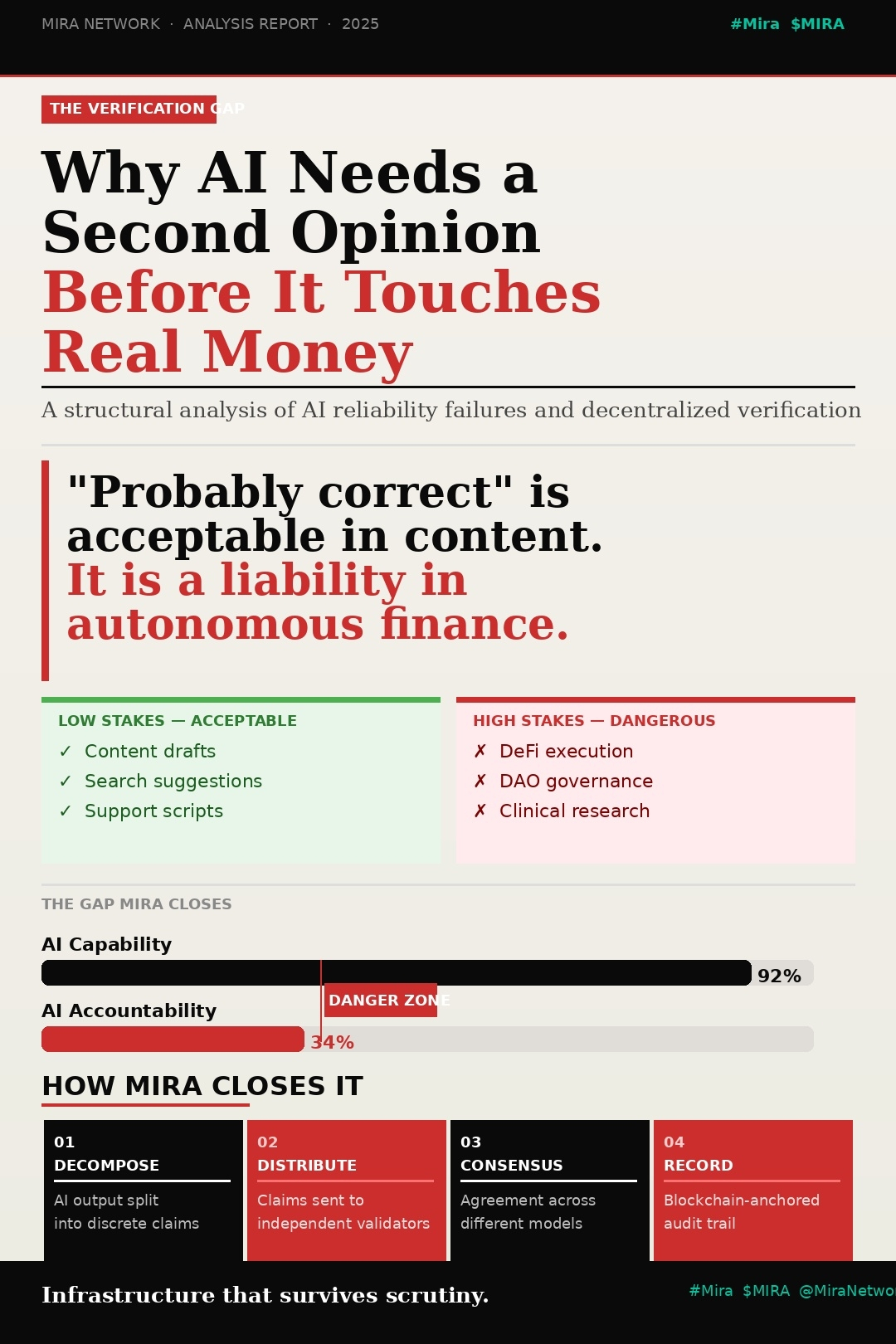

Aceasta este lacuna pe care Mira Network încearcă să o închidă.

De la Ieșirea Brută a AI la Informații Verificate

Sistemele tradiționale nu au fost concepute pentru o lume în care agenți autonomi participă la activități financiare. Mira introduce un strat suplimentar care stă între informațiile generate de AI și executarea pe lanț.

Când un agent AI solicită o analiză de la un model de limbaj, răspunsul poate fi direcționat prin cadrul de verificare al Mira. În loc să accepte ieșirea ca un singur bloc de text, sistemul restructurează informația în revendicări mai mici care pot fi examinate independent.

Aceste revendicări sunt apoi revizuite de validatorii distribuiți. Fiecare validator evaluează informația separat înainte ca rețeaua să ajungă la un acord cu privire la acceptarea revendicării.

Odată ce se ajunge la un consens, rezultatul verificat este înregistrat pe lanț împreună cu informații despre cine l-a validat și cum s-a ajuns la concluzie.

Responsabilitatea pentru Deciziile Conduse de AI

Diferența dintre utilizarea ieșirii brute a modelului și utilizarea informațiilor verificate nu este doar despre îmbunătățirea preciziei. Schimbarea mai importantă este responsabilitatea.

Fiecare revendicare verificată produce o înregistrare. Acea înregistrare arată când a fost generată informația, cum a fost evaluată și care validatori au participat la confirmarea acesteia.

Dacă ceva mai târziu merge prost, investigatorii pot urmări calea decizională în loc să se confrunte cu o ieșire AI opacă. Înregistrarea devine un punct de referință pentru înțelegerea informațiilor care au influențat acțiunea.

Acest tip de trasabilitate devine din ce în ce mai important pe măsură ce autoritățile încep să elaboreze reguli pentru sistemele autonome care operează în medii financiare.

De ce îi preocupă pe Regulatori Urmele Decizionale

Agențiile de reglementare nu sunt doar preocupate de faptul că sistemele AI funcționează bine în medie. Ele doresc să înțeleagă cum sunt luate deciziile specifice.

Dacă un sistem condus de AI execută o tranzacție care cauzează pierderi sau perturbări pe piață, autoritățile vor dori să reconstituie procesul decizional. Ele vor întreba ce date au fost folosite, ce raționament a fost aplicat și dacă a avut loc o verificare înainte ca acțiunea să fie realizată.

Arhitectura Mira creează un traseu structurat care poate răspunde la aceste întrebări. În loc să se bazeze pe documentația internă sau pe jurnale fragmentate, înregistrarea de verificare oferă un lanț transparent de dovezi pe care echipele de conformitate le pot revizui.

Stimulente și Reputație pentru Validatori

Fiabilitatea sistemului depinde de persoanele sau entitățile care verifică informațiile. Mira încearcă să întărească acest strat prin stimulente economice și urmărirea reputației.

Participanții care produc constant evaluări precise pot construi un istoric de fiabilitate în cadrul rețelei. În timp, acest lucru creează un ecosistem de validatori unde încrederea apare din performanță mai degrabă decât dintr-o autoritate centrală.

Obiectivul este de a crea un mediu de verificare care să rămână descentralizat, în timp ce produce rezultate de încredere.

Compatibilitate Între Lanțuri pentru un Ecosistem Multi-Rețea

O altă caracteristică practică a designului este capacitatea sa de a interacționa cu multiple ecosisteme blockchain.

Agenții AI operează deja pe mai multe rețele, inclusiv Bitcoin, Ethereum și Solana. Stratificarea de verificare a Mira este concepută să se integreze cu aplicații din aceste medii, mai degrabă decât să restricționeze activitatea la un singur lanț.

Această flexibilitate permite dezvoltatorilor să adauge infrastructură de verificare fără a-și restructurea întreaga stivă.

Colaborarea cu Date Private Fără a le Expune

Întreprinderile se confruntă cu o altă provocare atunci când integrează sistemele AI: datele sensibile. Instituțiile financiare și corporațiile nu pot expune liber seturi de date proprietare sau informații confidențiale.

Arhitectura Mira încearcă să abordeze acest lucru permițând verificarea rezultatelor fără a dezvălui datele de bază. În practică, acest lucru înseamnă că agenții AI pot conta pe informații derivate din seturi de date private, în timp ce produc dovezi că concluziile au fost verificate.

Această capacitate devine deosebit de importantă pentru organizațiile care operează sub reguli stricte de protecție a datelor.

Problema Principală Nu A Fost Niciodată Doar Precizia

Îngrijorările legate de AI se concentrează adesea pe halucinații sau ieșiri incorecte. Deși precizia contează, problema mai profundă este responsabilitatea structurală.

Sistemele autonome devin din ce în ce mai capabile să ia decizii economice semnificative. Fără un mecanism care să înregistreze cum au fost formate acele decizii, devine dificil să se atribuie responsabilitate sau să se dovedească că s-a avut loc diligența necesară.

Provocarea nu este doar de a construi modele mai inteligente. Este de a construi sisteme care documentează și verifică raționamentul din spatele deciziilor pe care acele modele le influențează.

Un Strat de Verificare pentru Economia AI

Creșterea agenților AI în ecosistemele blockchain sugerează că luarea deciziilor autonome va deveni o parte normală a infrastructurii digitale. Pe măsură ce această tranziție se accelerează, necesitatea unor urme decizionale verificabile va crește.

Proiecte precum Mira Network încearcă să construiască infrastructura care înregistrează și validează acele decizii înainte de a influența sistemele financiare.

Dacă economia AI continuă să se extindă, rețelele care oferă responsabilitate ar putea deveni la fel de importante ca sistemele care generează inteligența în sine.