În lumea în continuă mișcare a inteligenței artificiale, cele mai multe proiecte urmăresc aceleași obiective: mai multă viteză, mai multă scară și rezultate mai impresionante. Dar Mira Network abordează problema dintr-un unghi foarte diferit. În loc să se concentreze asupra puterii pe care AI o poate atinge, se concentrează pe o întrebare mai dificilă și mai incomodă: Ce se întâmplă când oamenii încep să aibă prea multă încredere în răspunsurile AI?

Această întrebare se află în centrul filozofiei Mira.

Astăzi, multe sisteme AI sunt judecate după cât de fluent generează limbaj. Dacă un răspuns sună încrezător, structurat și inteligent, oamenii tind să îl accepte. Problema este că fluența nu este același lucru cu fiabilitatea. Un model AI poate produce o explicație rafinată care sună convingător, dar care conține în continuare erori subtile, interpretări greșite sau concluzii exagerate.

Și odată ce un răspuns pare complet, cei mai mulți utilizatori rareori se opresc să-l verifice. Ei îl citesc, îl acceptă și merg mai departe. Această comportare creează un risc tăcut, dar serios: AI poate greși într-un mod foarte convingător.

Mira Network pare să înțeleagă această problemă mai bine decât majoritatea proiectelor din spațiul AI-crypto.

În loc să încerce să facă outputurile AI mai impresionante, Mira se concentrează pe a face ca încrederea să fie mai greu de oferit fără verificare. Aceasta schimbă conversația de la performanță pură la ceva mai important - judecata și responsabilitatea.

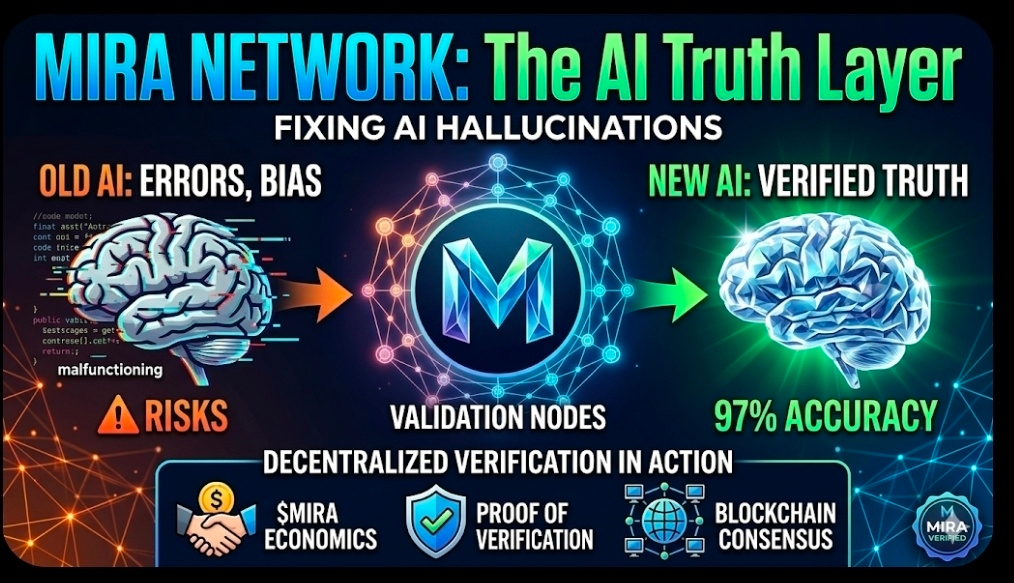

La baza abordării lui Mira se află o idee simplă dar puternică: outputurile AI nu ar trebui să fie de încredere doar pentru că un sistem le-a generat. Ele ar trebui să fie verificate.

Aceasta înseamnă că afirmațiile făcute de un sistem AI ar trebui să treacă printr-un proces în care sunt verificate și validate înainte de a fi considerate de încredere. Încrederea ar trebui să vină după verificare, nu înainte.

Deși acest concept pare evident, majoritatea ecosistemului actual AI încă presupune că modele mai bune vor rezolva în cele din urmă problema încrederii de la sine. Îmbunătățirea antrenamentului, seturi de date mai mari, sisteme de recuperare mai puternice și interfețe mai bune pot reduce greșelile - dar nu le pot elimina complet.

Chiar și cel mai avansat model poate produce totuși o eroare convingătoare.

Mira pleacă de la o presupunere mai disciplinată: problema încrederii în AI nu se referă doar la modele mai bune - ci la construirea de sisteme care verifică outputurile.

Interesant, această filozofie se aliniază strâns cu principiile din spatele tehnologiei blockchain. Crypto a fost inițial construit pe scepticism față de încrederea centralizată. În loc să se bazeze pe o singură autoritate, sistemele blockchain folosesc validarea distribuită pentru a confirma informațiile.

Mira aplică aceeași mentalitate la inteligența artificială.

Mai degrabă decât să presupună că inteligența merită automat încredere, proiectul încearcă să creeze un cadru în care outputurile AI trebuie să câștige credibilitate prin verificare.

Aceasta face ca Mira să fie mai puțin despre producția AI și mai mult despre responsabilitatea AI.

Un alt motiv pentru care proiectul se simte ancorat este că reflectă comportamentul real al utilizatorilor. În practică, oamenii rareori verifică de două ori răspunsurile AI. Cei mai mulți utilizatori sunt ocupați și preferă răspunsuri rapide. Când un răspuns AI arată rafinat și complet, scade natural impulsul de a-l pune la îndoială.

Mira pare să fie proiectată având în vedere această realitate. În loc să se aștepte ca utilizatorii să devină verificatori perfecți de fapte, încearcă să construiască verificarea direct în sistem.

Această abordare devine din ce în ce mai importantă pe măsură ce AI începe să influențeze deciziile, mai degrabă decât doar să genereze texte.

Următoarea fază a AI nu se referă doar la scrierea rezumatelor sau la răspunsuri la întrebări. Va ajuta din ce în ce mai mult oamenii să interpreteze informații, să evalueze oportunități, să analizeze riscuri și să ia decizii.

Când AI operează în acele domenii, greșelile nu mai sunt inofensive.

Un output defectuos ar putea influența investițiile, deciziile de guvernare, concluziile din cercetare sau strategiile de afaceri. În acel moment, consecințele erorii devin reale. Greșelile AI încetează să fie defecțiuni jenante - devin riscuri operaționale.

Acolo este locul unde teza lui Mira începe să câștige putere.

Proiectul explorează practic dacă încrederea în outputurile AI poate deveni o formă de infrastructură, mai degrabă decât ceva ce utilizatorii presupun pur și simplu. În loc să ceară sistemelor AI să genereze mai multe răspunsuri, Mira întreabă dacă mediul din jurul acestor răspunsuri poate face ca falsa încredere să fie mai greu de creat.

Puține proiecte lucrează în prezent la acel nivel.

Cele mai multe platforme AI concurează pe capacitate - cine poate genera răspunsuri mai rapide, texte mai inteligente sau automatizare mai avansată. Mira, în contrast, încearcă să concureze pe credibilitate.

Aceasta este o piață mult mai dificilă de construit. Verificarea introduce fricțiune. Poate adăuga timp, cost și complexitate. Dezvoltatorii și utilizatorii vor accepta aceste compromisuri doar dacă beneficiile sunt clar vizibile.

Aceasta devine cea mai mare provocare a lui Mira.

Succesul proiectului va depinde de faptul dacă verificarea devine practic necesară, nu doar teoretic atrăgătoare. Dacă oamenii admiră conceptul, dar evită să-l folosească pentru că pare incomod, Mira ar putea rămâne o idee puternică fără o adoptare pe scară largă.

Cu toate acestea, dacă outputurile AI nevalidate încep să pară riscante - în special în medii în care deciziile au consecințe reale - verificarea ar putea deveni esențială.

Când se întâmplă asta, sisteme precum Mira ar putea trece de la a fi unelte opționale la a deveni infrastructură de bază, similar cu straturile de securitate din internet.

Sistemele invizibile devin adesea cele mai importante odată ce tehnologia se maturizează. Când verificarea funcționează bine, utilizatorii ar putea să nu o observe aproape deloc. Ei experimentează pur și simplu mai puține outputuri înșelătoare câștigând încredere.

Această absență a erorii poate fi dificil de comercializat, dar valoarea sa poate fi enormă.

În cele din urmă, Mira Network nu este doar un alt proiect AI conectat la tehnologia blockchain. Reprezintă o încercare de a formaliza scepticismul într-o eră în care mașinile pot vorbi convingător.

În loc să aibă încredere în răspunsuri pentru că sună inteligent, Mira încearcă să creeze un proces în care răspunsurile sunt de încredere pentru că au supraviețuit verificării.

Această ambiție este mai restrânsă decât multe narațiuni AI, dar este, de asemenea, mai profundă. Proiectul nu urmărește cea mai largă poveste despre inteligența artificială. În schimb, explorează o problemă specifică și din ce în ce mai importantă: cum să construiești încredere în informațiile generate de AI.

Pe măsură ce AI devine mai implicat în modul în care oamenii interpretează datele, evaluează riscurile și iau decizii, această problemă va deveni din ce în ce mai relevantă.

Mira se poziționează direct în acel interval dintre aparență și fiabilitate.