Când AI dezbate, încrederea apare:

Revoluția responsabilității multi-model ale lui Mira

Articol redefinit pentru impact maxim

@Mira - Trust Layer of AI #Mira

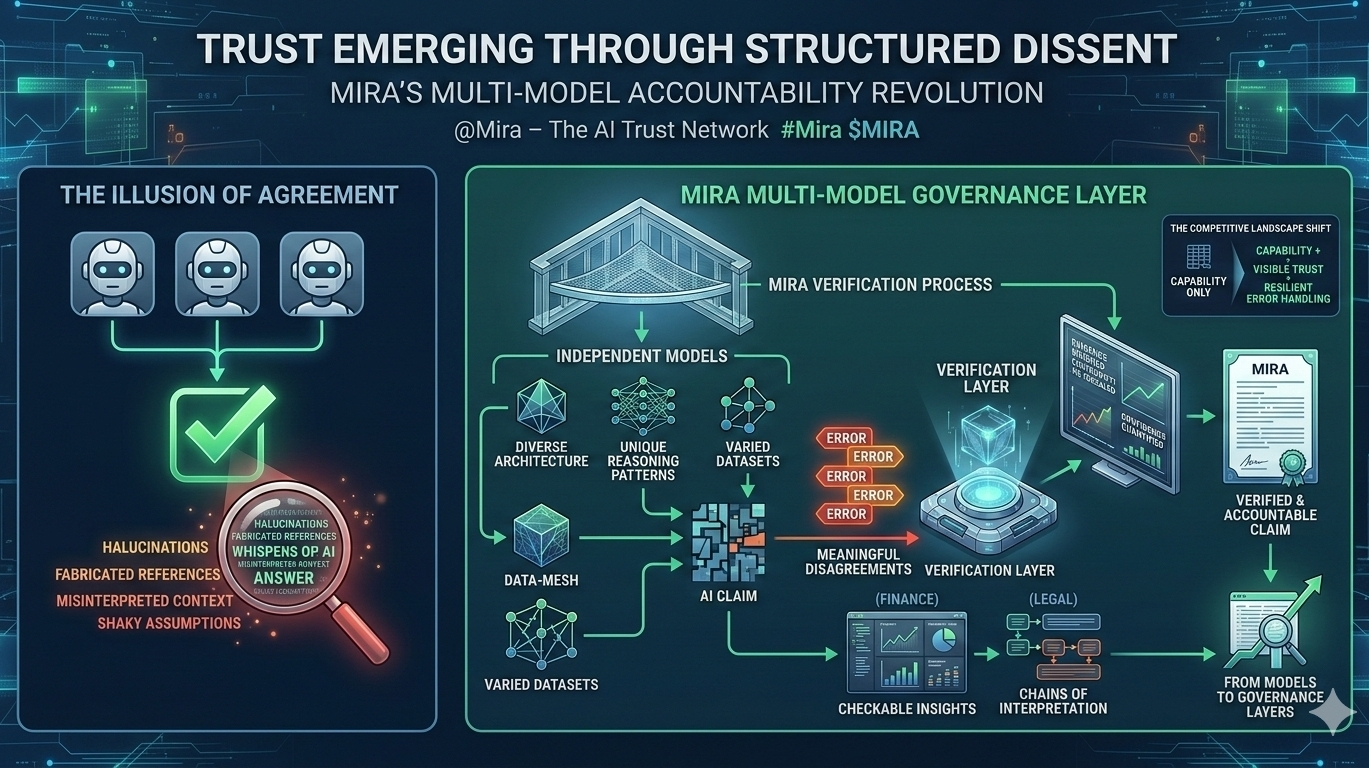

Fiabilitatea în AI nu este despre răspunsuri unanime - este despre modul în care sistemele gestionează dissentul. Acordul poate părea reconfortant, dar poate ascunde defecte subtile: fapte interpretate greșit, referințe fabricate sau raționamente încrezătoare dar instabile. Încrederea adevărată apare atunci când dezacordul este structurat, vizibil și verificabil.

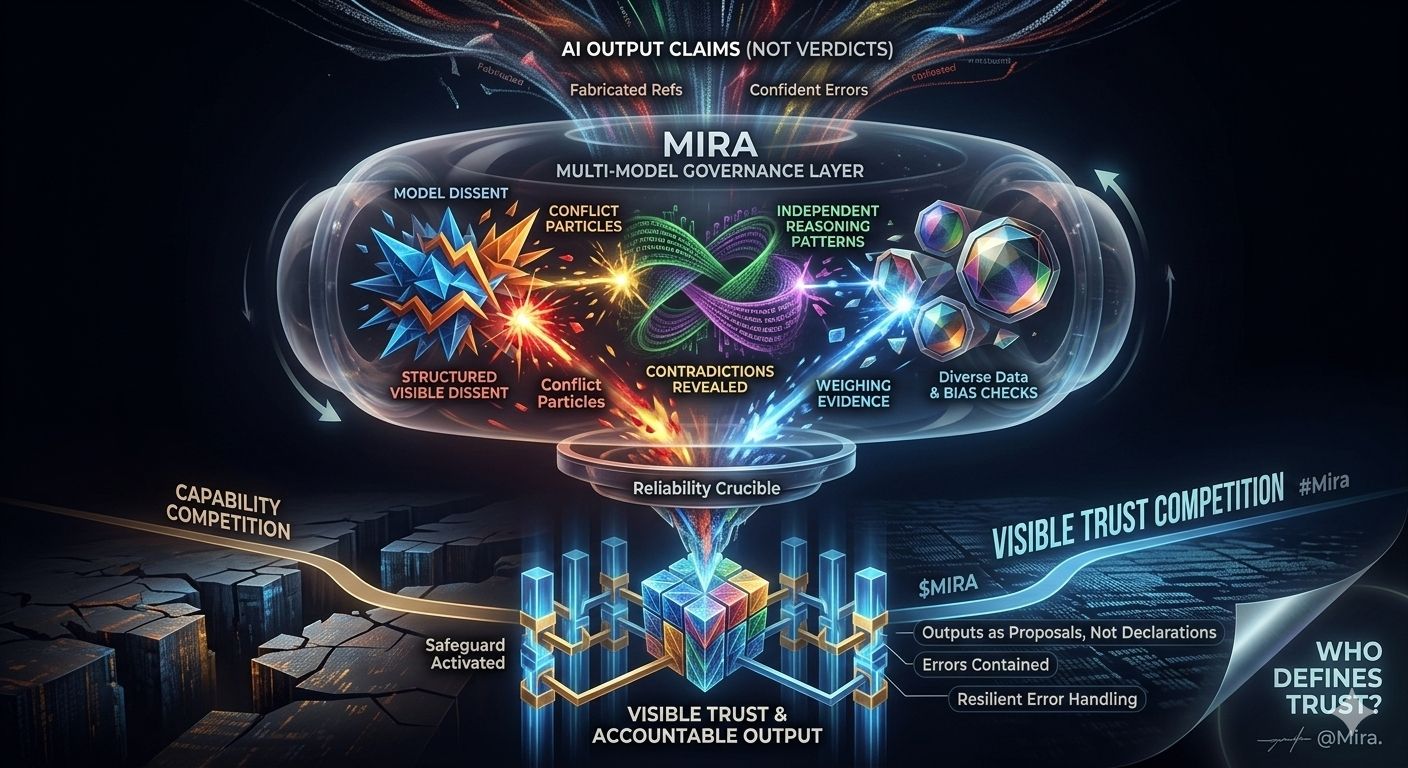

Cele mai multe eșecuri AI sunt șoapte subtile: o clauză interpretată greșit, un context trecut cu vederea, un rezultat încrezător construit pe presupuneri instabile. Auto-corectarea de către un singur model adesea amplifică aceleași greșeli. Mira răstoarnă acest paradigm: fiecare rezultat AI este o afirmație, nu un verdict. Mai multe modele independente examinează afirmația, fiecare contribuind cu date diverse, modele de raționare și prejudecăți arhitecturale. Verificarea nu este despre modelul cel mai zgomotos - este despre modul în care dovezile sunt cântărite, contradicțiile dezvăluite și încrederea cuantificată.

Consensul este nuanțat. Două modele pot fi de acord în timp ce unul poate fi în dezacord—este excepția care observă o adevărată defectiune sau halucinează? Sistemul lui Mira identifică dezacordurile semnificative versus zgomotul. Ieșirile complexe se descompun în afirmații verificabile: rezumatele financiare devin perspective verificabile, argumentele legale se transformă în lanțuri de interpretare. Modelele nu trebuie să fie mai inteligente—afirmațiile devin testabile și responsabile.

Încrederea se mută de la modele la straturi de guvernanță. Ieșirile sunt credibile nu pentru că un model a spus asta, ci pentru că sistemele independente au ajuns la concluzii compatibile. Transparența este cheia: datele suprapuse sau arhitecturile similare pot distorsiona consensul, astfel că diversitatea este o garanție de fiabilitate.

Verificarea implică costuri—latență, calcul, supraveghere umană. Aplicațiile care integrează AI devin acum orchestratori de fiabilitate, gestionând compromisurile între viteză și certitudine. Aceasta reshapează peisajul competitiv: AI va concura nu doar pe baza capacității, ci și pe baza încrederii vizibile, dezacordului structurat și gestionării erorilor reziliente.

Guvernanța multi-model a lui Mira este mai mult decât o caracteristică—este un strat de responsabilitate. Ieșirile AI devin propuneri, nu declarații. Erorile sunt inevitabile, dar sistemul le conține înainte de a se desfășura în piețe, decizii sau discursuri publice.

Întrebarea supremă: cine definește încrederea, cum este interpretat dezacordul și ce măsuri de siguranță se activează când consensul fluctuează? Acolo este locul în care fiabilitatea AI trăiește cu adevărat.

$MIRA