Discuția despre inteligența artificială se extinde rapid în lumea tehnologiei. Fiecare săptămână vedem modele noi, noi capacități și noi aplicații care apar. Dar, alături de acest progres rapid, o altă întrebare continuă să crească: cum verificăm rezultatele produse de sistemele IA?

Inteligența artificială poate analiza seturi de date masive, genera perspective și automatiza procese mai repede ca niciodată. Cu toate acestea, viteza singură nu garantează fiabilitatea. Pe măsură ce IA devine integrată în sisteme critice, asigurarea că rezultatele sunt de încredere devine din ce în ce mai importantă.

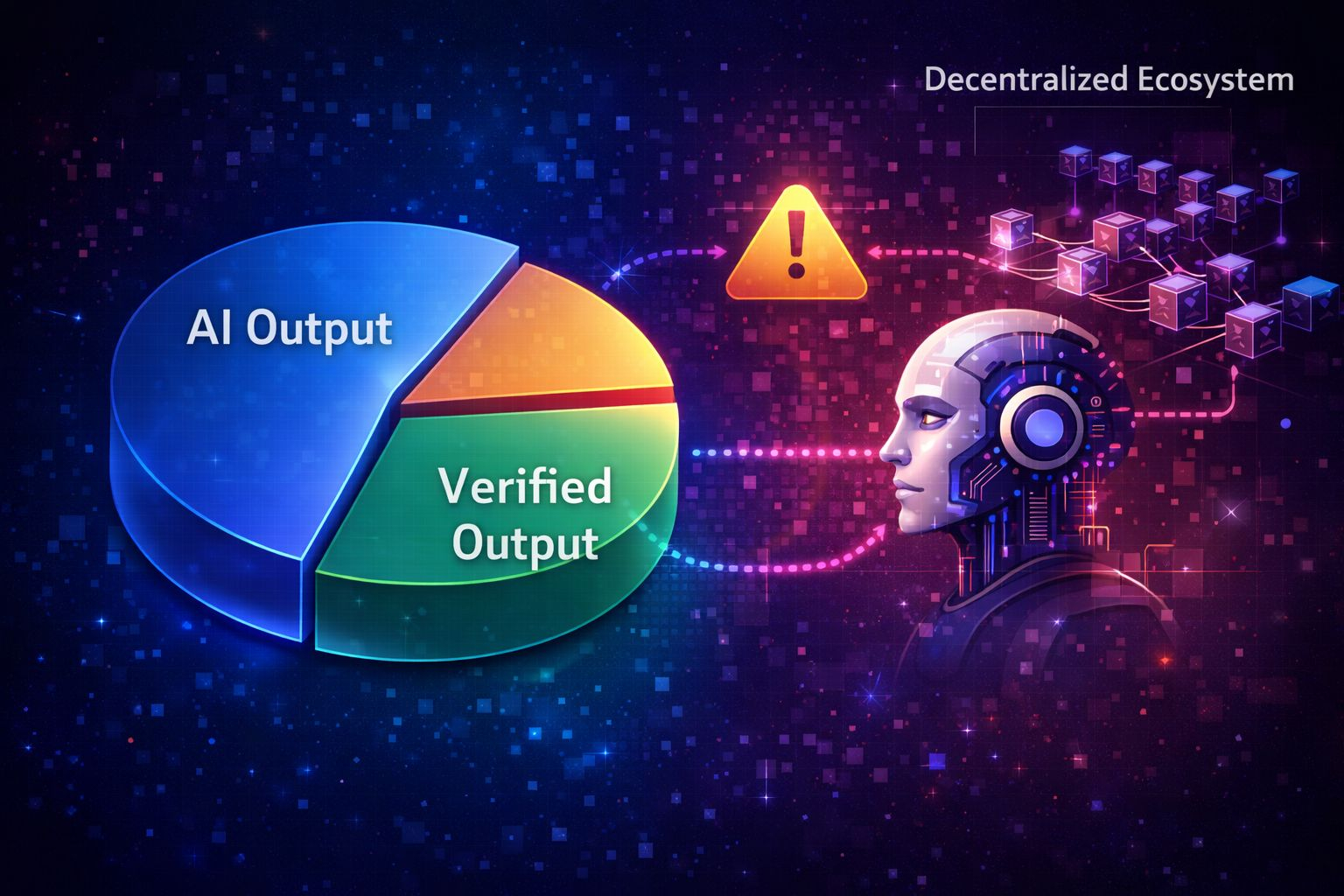

Această provocare devine și mai complexă în ecosistemele descentralizate. În platformele centralizate tradiționale, utilizatorii se bazează adesea pe credibilitatea companiilor care operează sistemul. Dar în medii Web3, încrederea trebuie să provină din mecanisme transparente, mai degrabă decât din autoritate centralizată.

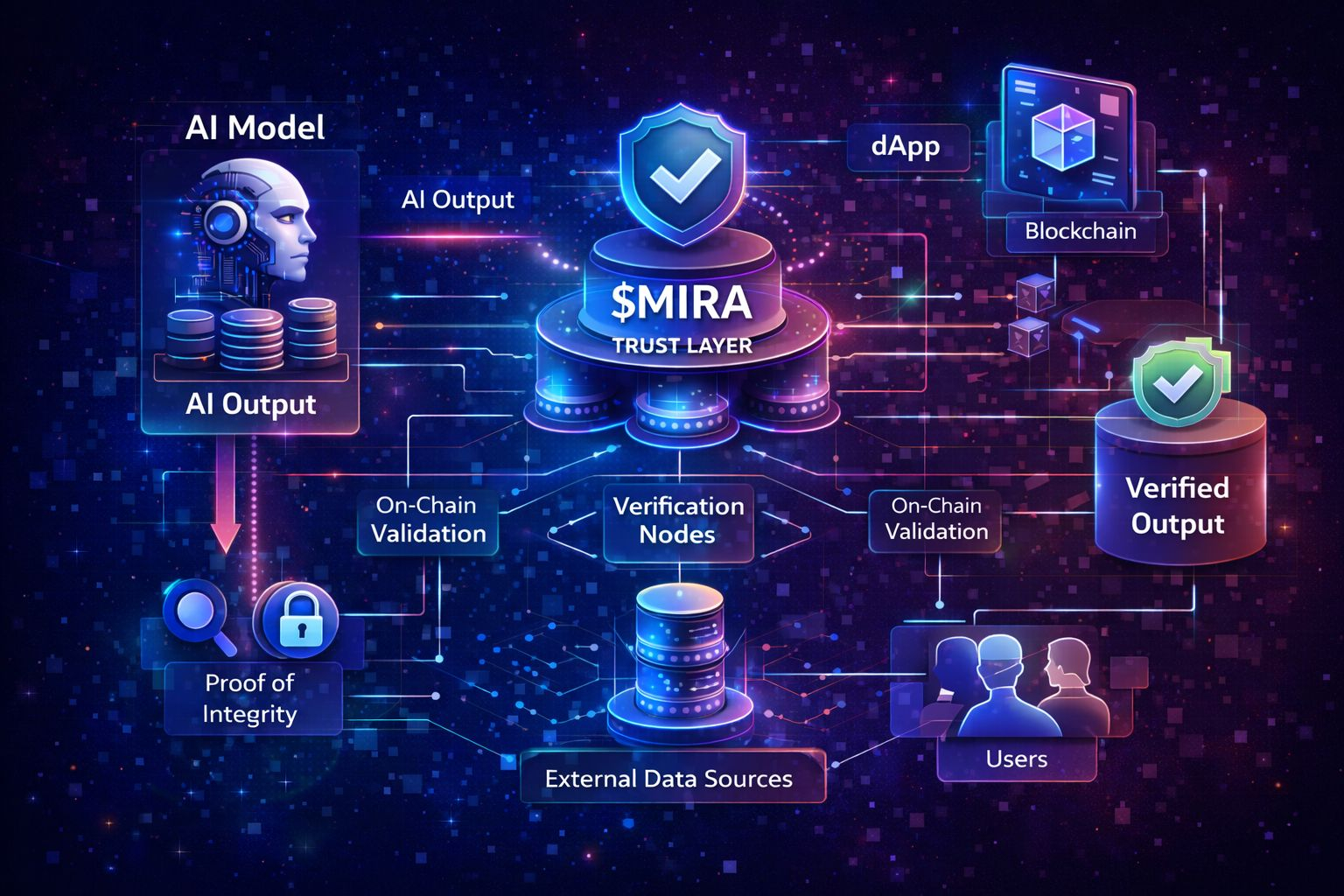

Acesta este un motiv pentru care proiectele care explorează infrastructura de verificare câștigă atenție. În timp ce cercetam diferite abordări, am început să privesc mai profund ideea din spatele @mira_network și cum $MIRA își propune să exploreze conceptul unui strat de încredere pentru AI.

Ideea este interesantă deoarece rezultatele AI sunt adesea dificile de verificat rapid. Un model AI poate produce un răspuns în câteva secunde, dar verificarea acelui răspuns poate necesita timp, expertiză și acces la surse de date fiabile. Această dezechilibru între generare și verificare creează provocări potențiale pe măsură ce adoptarea AI crește.

Dacă aplicațiile descentralizate încep să se bazeze pe perspectivele conduse de AI, trebuie să existe sisteme care să confirme că aceste perspective îndeplinesc standardele de fiabilitate. Straturile de verificare ar putea ajuta la asigurarea transparenței și a încrederii atunci când sistemele AI interacționează cu aplicațiile bazate pe blockchain.

Un alt motiv pentru care acest subiect este important este suprapunerea tot mai mare între AI și Web3. Rețelele blockchain sunt deja folosite pentru sisteme financiare, proprietate digitală, mecanisme de guvernare și infrastructură distribuită. Pe măsură ce instrumentele AI se integrează în aceste medii, asigurarea unor rezultate fiabile devine un factor critic.

Proiecte precum @mira_network explorează cum infrastructura descentralizată ar putea susține procesele de verificare a AI. Conceptul din spatele $MIRA se concentrează pe construirea de cadre care permit validarea rezultatelor AI, în loc să fie acceptate fără ezitare.

Această abordare ar putea ajuta potențial să întărească fiabilitatea aplicațiilor alimentate de AI în ecosistemele Web3. Indiferent dacă este vorba despre analiză de date, guvernare descentralizată sau procese automatizate, mecanismele de verificare ar putea oferi o încredere suplimentară utilizatorilor care interacționează cu sistemele AI.

În timpul campaniei #Mira, a fost destul de interesant să observ cum reacționează comunitatea la aceste idei. Perioadele de campanie aduc adesea noi participanți care încep să exploreze viziunea proiectului și discută despre implicațiile mai ample ale verificării AI.

În multe feluri, următoarea etapă a dezvoltării AI s-ar putea să nu se concentreze doar pe inteligență, ci și pe credibilitate. Sistemele capabile să genereze perspective puternice trebuie, de asemenea, să ofere modalități prin care aceste perspective să fie validate.

De aceea, conversațiile în jurul straturilor de încredere, cadrelor de verificare și infrastructurii de AI descentralizate devin din ce în ce mai importante.

Observând cum se dezvoltă aceste idei în jurul @mira_network și $MIRA oferă o privire interesantă asupra modului în care comunitatea Web3 gândește despre relația viitoare dintre AI și încredere.