Cei mai mulți oameni presupun că cea mai mare provocare a AI-ului este inteligența. În realitate, provocarea a fost întotdeauna încrederea. Modelele mari pot produce răspunsuri încrezătoare, dar încrederea nu este egală cu corectitudinea. Erori subtile—interpretări greșite ale faptelor, citate fabricate sau raționamente incomplete—se strecoară în tăcere și rareori se anunță tare.

Aceste erori nu sunt catastrofale individual. Dar în sistemele financiare de contracte inteligente, sau rețele autonome, chiar și mici neatenții pot duce la consecințe în lumea reală. Și exact de aceea, a te baza pe un singur model este fragil.

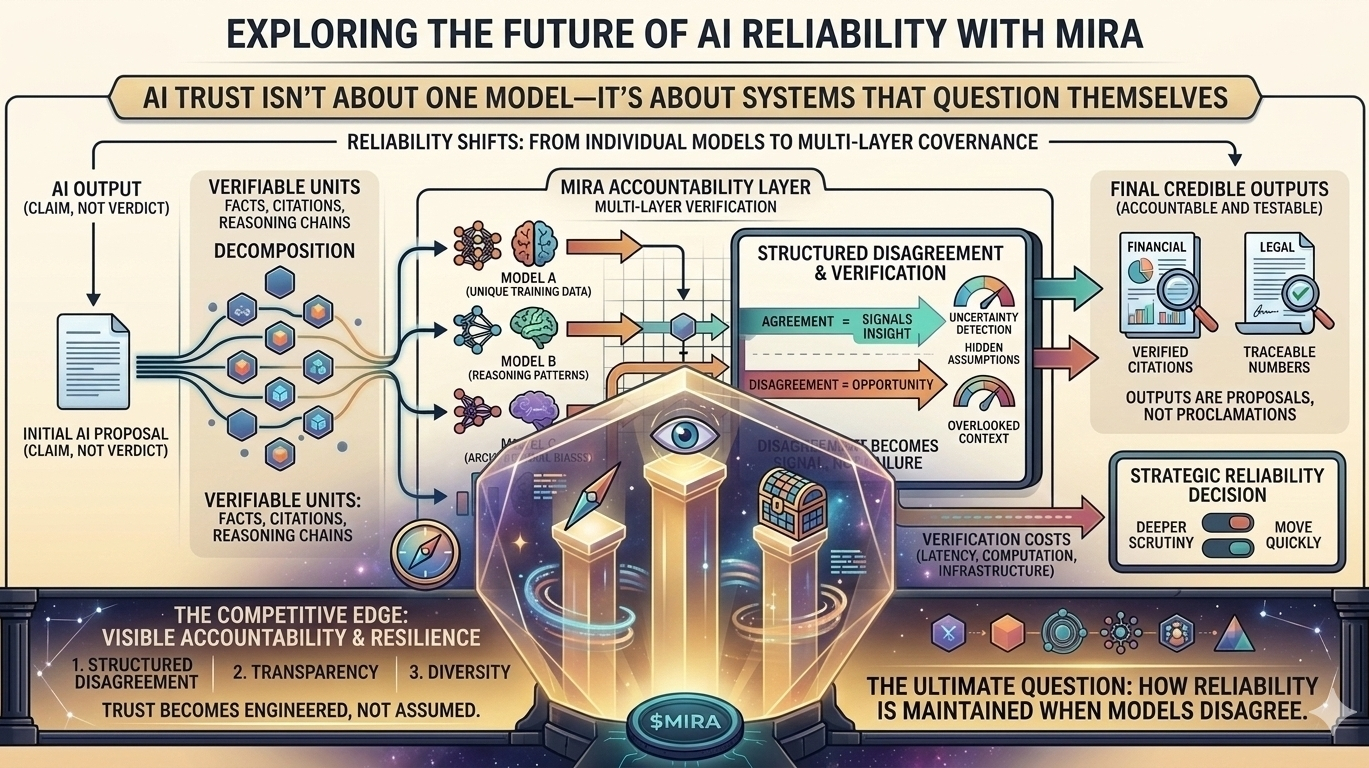

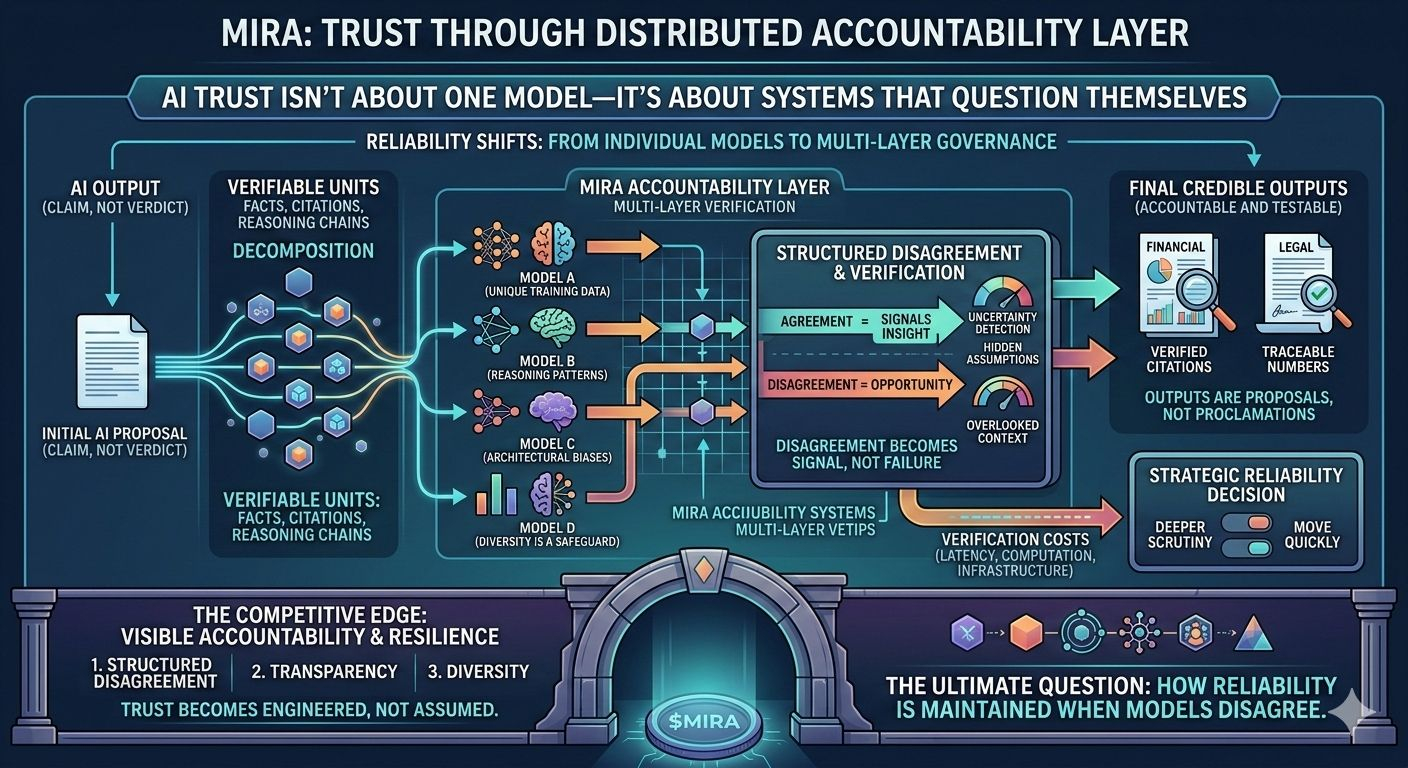

Mira introduce o nouă modalitate: tratează fiecare ieșire ca o afirmație, nu ca un verdict. Mai multe modele independente evaluează aceeași afirmație, fiecare aducând date de antrenament unice, tipare de raționament și prejudecăți arhitecturale. Acordul semnalează înțelegere, dar dezacordul semnalează oportunitate—oportunitate de a detecta incertitudini, presupuneri ascunse sau contexte neglijate.

În practică, ieșirile sunt descompuse în unități verificabile. Un rezumat financiar complex devine numere trasabile. O interpretare legală se transformă într-un lanț de raționament. AI nu devine magic mai inteligent—afirmațiile sale devin responsabile și testabile.

Încrederea se mută de la modele individuale și se îndreaptă spre guvernanța multi-strat. Ieșirile sunt credibile nu pentru că un model le-a produs, ci pentru că sisteme independente au ajuns la concluzii compatibile. Transparanța este critică: seturile de date suprapuse sau arhitecturile similare pot distorsiona consensul, astfel că diversitatea este o măsură de siguranță a fiabilității.

Verificarea are costuri—latență, calcul și infrastructură. Aplicațiile care integrează aceste straturi trebuie să decidă ce afirmații necesită o examinare mai profundă și care pot avansa rapid. Fiabilitatea nu mai este o caracteristică pasivă; este o decizie strategică încorporată în designul sistemului.

Avantajul competitiv pentru următoarea generație de AI nu va veni din cine răspunde cel mai repede sau sună cel mai inteligent. Va veni din responsabilitate vizibilă, dezacord structurat și reziliență în fața erorilor.

Guvernanța multi-model a Mirei nu este doar o caracteristică—este un strat de responsabilitate pentru inteligența mașinală. Ieșirile devin propuneri, nu declarații. Dezacordul devine semnal, nu eșec. Încrederea devine inginerie, nu presupusă.

Întrebarea supremă nu este dacă modelele sunt de acord. Este cine interpretează dezacordul, ce măsuri de siguranță se activează și cum se menține fiabilitatea. Aceasta este lumea în care AI poate fi cu adevărat de încredere.

#Mira

@Mira - Trust Layer of AI