Conversația care a făcut ca Mira să rezoneze pentru mine

La începutul acestei săptămâni, navigam printre postările campaniei CreatorPad pe Binance Square, în timp ce discutam cu un alt trader în comentarii. Comparăm diferite proiecte AI în crypto, glumind în mare parte despre cum fiecare al doilea protocol pretinde că este „infrastructura AI.”

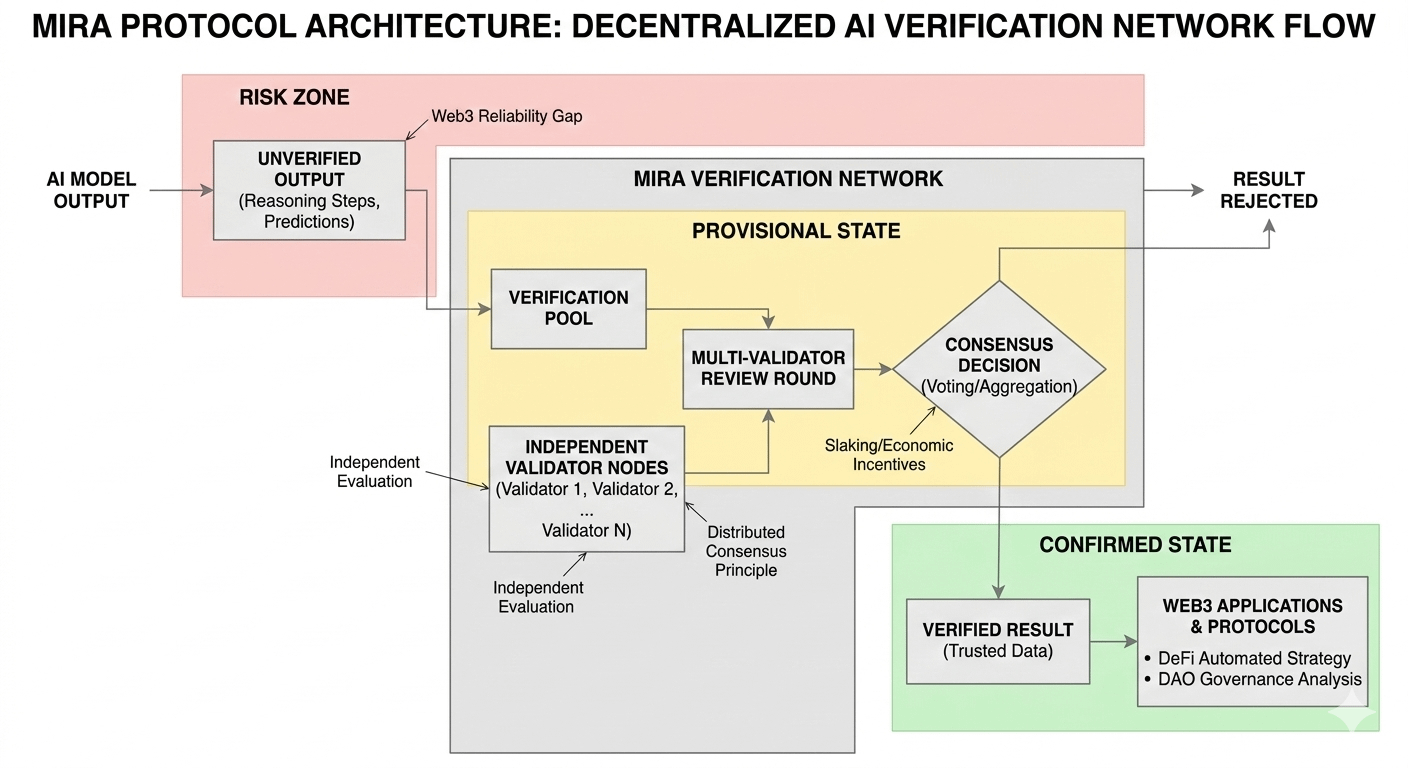

La un moment dat, cineva a lăsat un diagramă care explică rețeaua de verificare a lui Mira.

La prima vedere părea simplu. Dar după ce m-am uitat la el câteva minute, mi-am dat seama de ceva interesant: Mira nu încearcă să construiască un model de AI mai inteligent. Își propune să construiască o rețea care verifică rezultatele AI.

Această distincție este subtilă, dar schimbă complet modul în care proiectul se încadrează în ecosistemul Web3.

Problema care apare când AI se întâlnește cu Web3

Oricine a folosit instrumente AI regulat știe experiența ciudată de a obține un răspuns care pare extrem de încrezător... dar nu este complet corect.

În platformele centralizate, companiile se ocupă de acest lucru intern. Ele monitorizează rezultatele și îmbunătățesc modelele din culise.

Sistemele descentralizate nu pot depinde de o singură autoritate pentru a face asta.

Dacă agenții AI încep să interacționeze cu protocoale Web3 - analizând piețele, rezumând propuneri de guvernare sau executând strategii automate - rezultatele incorecte ar putea influența decizii financiare sau de guvernare reale.

Așa că întrebarea devine evidentă:

Așa că întrebarea devine evidentă:

Cine verifică informațiile generate de mașină înainte ca rețeaua să aibă încredere în ele?

Aceasta este lacuna de infrastructură pe care Mira pare să o abordeze.

Transformarea verificării într-o rețea

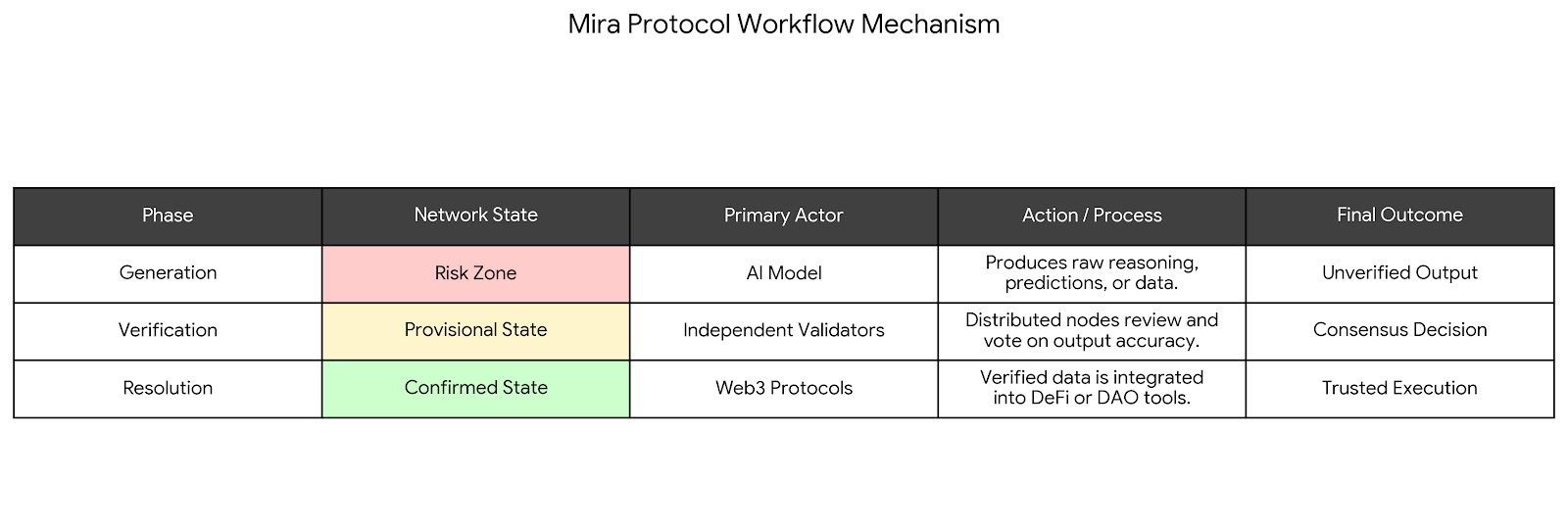

Din citirea fragmentelor de documentație și a discuțiilor CreatorPad, arhitectura Mira se învârte în jurul împărțirii fluxului de lucru AI în două roluri separate.

Primul rol este generarea. Modelele AI produc rezultate precum pași de raționament, predicții sau răspunsuri structurate.

Al doilea rol este verificarea. Participanții independenți evaluează acele rezultate înainte de a fi acceptate ca rezultate valide.

În loc să aibă încredere în model direct, sistemul redirecționează rezultatele printr-un proces de verificare distribuit.

În timp ce încercam să vizualizez designul, am desenat un flux de proces brut în notițele mele:

Rezultatul AI → Piscina de verificare → Revizuirea multi-validator → Decizia de consens → Rezultatul verificat

Structura seamănă de fapt cu validarea tranzacțiilor blockchain, cu excepția faptului că rețeaua validează informații în loc de transferuri financiare.

Această alegere de design face ca Mira să se simtă mai puțin ca o aplicație AI și mai mult ca un strat de infrastructură de fiabilitate.

De ce contează descentralizarea verificării

Un detaliu care mi-a ieșit în evidență în timp ce citeam thread-uri comunitare este accentul pe mai mulți validatori independenți.

Dacă un singur participant verifică un rezultat AI, acea evaluare ar putea fi părtinitoare sau greșită. Dar când mai mulți participanți revizuiesc același rezultat, probabilitatea acceptării incorecte scade.

Aceasta aplică de fapt același principiu care securizează blockchain-urile: consens distribuit.

Diferența este că, în loc să verifice blocurile de tranzacții, rețeaua verifică raționamentele produse de mașini.

Dacă rezultatul modelului trece rondele de verificare, devine date de încredere pe care aplicațiile se pot baza.

Dacă eșuează, rezultatul este respins.

Un exemplu practic: agenți AI în DeFi

În timp ce citind postări CreatorPad despre Mira, tot timpul mă gândeam la agenții de tranzacționare automate.

Imaginează-ți un model AI analizând piscine de lichiditate și sugerând ajustări de portofoliu. Fără verificare, acel rezultat ar putea declanșa tranzacții direct.

Dacă raționamentul este defectuos, strategia ar putea duce la decizii proaste.

Cu structura Mira, rezultatul AI ar putea intra mai întâi într-o rundă de verificare în care participanții independenți revizuiesc raționamentul înainte de a influența aplicația.

Este un pas mic în plus, dar introduce responsabilitate în sistemele de decizie automate.

Și pe măsură ce mai multe instrumente DeFi experimentează cu agenți AI, acel strat de fiabilitate ar putea deveni din ce în ce mai important.

Economia din spatele rețelei

Un alt aspect interesant al designului Mira este modelul de stimulente.

Verificatorii nu revizuiesc pur și simplu rezultatele din curiozitate. Ei sunt recompensați economic pentru evaluarea corectă a rezultatelor.

Aceasta transformă verificarea într-o activitate productivă în cadrul ecosistemului.

Dezvoltatorii AI generează rezultate.

Verificatorii validează acele rezultate.

Aplicațiile consumă rezultatele verificate.

Această relație triangulară creează ceea ce unii participanți CreatorPad au început să numească o economie de verificare, unde încrederea în sine devine un serviciu descentralizat.

Provocările cu care sistemul se confruntă în continuare

Provocările cu care sistemul se confruntă în continuare

Chiar dacă conceptul este captivant, există mai multe întrebări pe care rețeaua va trebui să le rezolve.

Primul este complexitatea evaluării. Unele rezultate AI sunt ușor de verificat, în special afirmațiile factuale. Altele implică raționamente sau interpretări, ceea ce face validarea mai dificilă.

Al doilea este viteza. Rondele de verificare introduc latență, în timp ce multe aplicații AI se așteaptă la răspunsuri rapide.

Al treilea este coordonarea. Sistemul trebuie să se asigure că verificatorii efectuează evaluări independente în loc să copieze pur și simplu semnalele de consens.

Aceste provocări nu subminează conceptul, dar subliniază dificultatea de a construi straturi de încredere descentralizată pentru AI.

De ce ideea continuă să apară în discuțiile CreatorPad

După ce am petrecut timp citind thread-uri de campanie CreatorPad, am observat că discuțiile despre Mira tind să se concentreze mai puțin pe speculația token-urilor și mai mult pe arhitectură.

Aceasta este de obicei un semnal că un proiect abordează o problemă de infrastructură mai profundă.

Blockchains au creat un consens descentralizat pentru tranzacții financiare. Dar sistemele AI produc ceva diferit - informații și raționamente.

Dacă aplicațiile descentralizate încep să se bazeze pe analize generate de mașini, rețelele vor avea nevoie de mecanisme pentru a confirma că acele rezultate sunt de încredere.

Experimentul Mira este de fapt despre dacă verificarea AI în sine poate deveni o rețea descentralizată.

Este încă devreme, iar multe provocări de design rămân. Dar întrebarea pe care protocolul o explorează pare surprinzător de fundamentală pentru viitoarea intersecție a AI și Web3.

Dacă mașinile generează răspunsurile, cineva - sau mai degrabă, o rețea - va trebui să le verifice.

$HANA $DEGO #Mira

@Mira - Trust Layer of AI $MIRA