Inteligența artificială se mișcă repede. Mai repede decât se așteptau cei mai mulți oameni.

AI scrie cod, redactează contracte, analizează piețele financiare și chiar asista în diagnosticele medicale. Dar există o problemă tăcută sub această explozie tehnologică:

AI este puternic — dar nu întotdeauna de încredere.

Modelele mari de limbaj pot avea halucinații. Generatoarele de imagini pot fabrica date. Agenții autonomi pot lua decizii bazate pe presupuneri defectuoase. În medii cu mize mari, cum ar fi finanțele, sănătatea și guvernarea, „probabil corect” nu este suficient.

Aici apare o nouă categorie de infrastructură — straturi de verificare AI.

Unul dintre cele mai interesante proiecte care construiesc acest strat este MIRA de la Rețeaua Mira, care încearcă să rezolve una dintre cele mai mari probleme nerezolvate în economia AI:

Cum putem dovedi că rezultatele AI sunt de fapt corecte?

Lacuna de încredere în AI

Ecosistemul AI de astăzi are o slăbiciune structurală.

Cele mai multe sisteme AI funcționează ca niște cutii negre. Un utilizator trimite un prompt, modelul produce un răspuns, iar sistemul pur și simplu presupune că este valid.

Dar cu cât AI se integrează mai profund în societate, cu atât mai periculoasă devine acea presupunere.

Imaginează-ți trei scenarii.

Scenariul 1: AI financiar

Un agent de tranzacționare recomandă o alocare a portofoliului pe baza analizei pieței.

Dacă raționamentul său conține o eroare, milioane de dolari ar putea fi alocați greșit.

Scenariul 2: AI în sănătate

Un asistent AI propune o dozare a medicamentului pe baza datelor pacientului.

Dacă modelul a halucinat o directivă, consecințele ar putea fi catastrofale.

Scenariul 3: Agenți AI autonomi

Un agent AI execută tranzacții blockchain automat prin contracte inteligente.

Un rezultat defectuos ar putea declanșa acțiuni ireversibile pe lanț.

Problema nu este că AI este inutil.

Problema este că AI necesită în continuare încredere.

Și încrederea nu scalează.

Ideea centrală a rețelei Mira: Inteligență verificabilă

Rețeaua Mira introduce o schimbare radicală în modul în care operează sistemele AI.

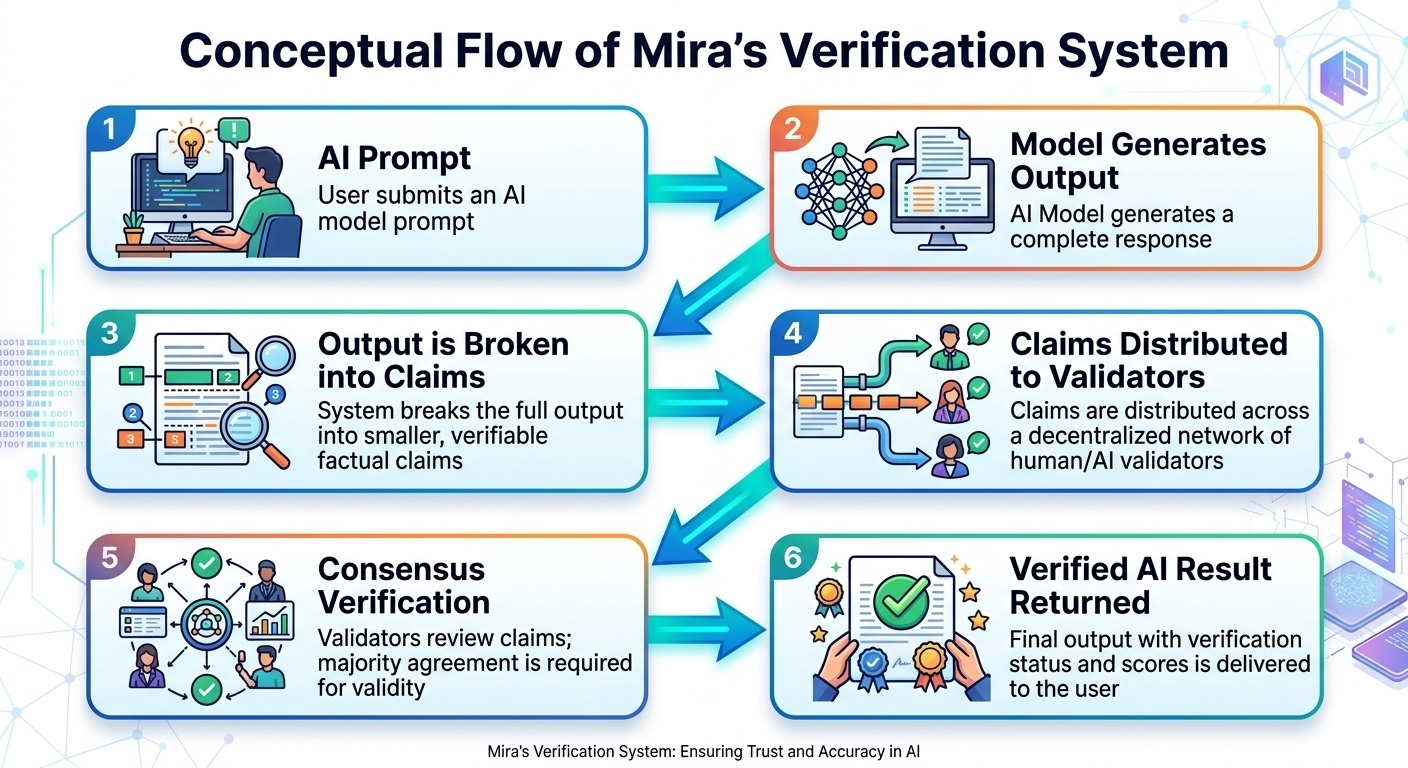

În loc să ne încredem într-un singur model, Mira descompune fiecare răspuns AI în afirmații structurate și le verifică printr-o rețea distribuită de validatori.

Acest lucru creează ceva nou în structura AI:

Un strat de verificare criptografic pentru rezultatele AI.

Ideea este simplă, dar puternică:

Dacă blockchain poate verifica tranzacțiile financiare fără încredere,

de ce nu poate o rețea să verifice rezultatele AI în același mod?

Cum verifică de fapt Mira AI

La un nivel tehnic, Mira transformă răspunsurile AI în afirmații verificabile.

Aceste afirmații sunt apoi evaluate de validatori independenți din întreaga rețea.

În loc să ne încredem într-un singur model, mai multe modele și noduri confirmă independent dacă rezultatul este valid.

Acest lucru reduce dramatic halucinațiile și prejudecățile, deoarece fiecare afirmație trebuie să supraviețuiască verificării distribuite.

Flux conceptual al sistemului de verificare Mira

Acest mecanism seamănă cu modul în care blockchains validează tranzacțiile — doar că aici rețeaua validează cunoștințe în loc de transferuri financiare.

Rețeaua este deja operativă la scară

Această idee nu este teoretică.

Ecosistemul Mira a crescut deja rapid:

• Peste 2,5 milioane de utilizatori

• Aproape 2 miliarde de tokeni procesați zilnic în aplicații

• milioane de interogări AI verificate în fiecare săptămână

Pentru a pune asta în perspectivă:

Procesarea a miliarde de tokeni pe zi este echivalentă cu analiza unor cantități uriașe de text, imagini și media — comparabile cu mari porțiuni ale fluxului de informații de pe internet.

Acest lucru arată că cererea pentru o infrastructură AI de încredere este reală.

Caracteristici cheie ale produsului care definesc Mira

1. Verificare la nivel de afirmație

Sistemele AI tradiționale oferă un răspuns.

Mira convertește răspunsurile în afirmații verificabile, permițând rețelei să verifice fiecare parte individual.

Acest lucru crește dramatic fiabilitatea.

2. Consens distribuit AI

Mai mulți validatori verifică rezultatele în loc să se bazeze pe un singur model.

Acest lucru reduce:

• halucinații

• prejudecăți ale modelului

• risc de manipulare

Rezultatul este inteligența verificată prin consens.

3. API-uri pentru dezvoltatori pentru AI verificat

Mira oferă un set de API-uri incluzând:

• Generați

• Verificați

• Generați verificat

Aceste instrumente permit dezvoltatorilor să integreze AI verificat direct în aplicațiile lor.

În termeni simpli:

Dezvoltatorii pot construi produse AI unde încrederea este integrată în arhitectură.

4. Securitate economică prin $MIRA

Tokenul nativ MIRA sprijină economia de verificare.

Participanții pot:

• staking tokens pentru a deveni validatori

• câștigarea de recompense pentru verificare precisă

• participarea la deciziile de guvernare

Acest lucru aliniază stimulentele astfel încât rețeaua să recompenseze corectitudinea.

De ce contează acest lucru pentru viitorul AI

Industria AI intră într-o nouă fază.

Prima fază a fost despre capabilitate.

A doua fază este despre fiabilitate.

Fără verificare, AI va rămâne limitat în sectoare sensibile precum:

• finanțe

• sănătate

• lege

• sisteme autonome

Viziunea Mira este de a deveni stratul de încredere pentru AI, permițând mașinilor să opereze autonom fără supraveghere umană, menținând în același timp corectitudinea verificabilă.

Cu alte cuvinte:

AI nu va scala global până când încrederea nu va scala cu ea.

Narațiunea mai mare: Crypto + Infrastructura AI

Cele mai interesante proiecte crypto de astăzi nu sunt doar monede.

Ele sunt straturi de infrastructură.

Exemple includ:

• rețele de calcul

• piețe de date

• cloud-uri GPU descentralizate

• sisteme de verificare AI

Mira se potrivește direct în acest nou strat.

Așa cum blockchains a verificat adevărul financiar,

Mira își propune să verifice adevărul informațional.

Dacă va avea succes, ar putea deveni un strat fundamental pentru următoarea generație de sisteme AI autonome.

Un experiment de gândire

Imaginează-ți o economie AI în care:

• agenții AI tranzacționează active

• sistemele autonome gestionează lanțuri de aprovizionare

• cercetătorii AI generează noi ipoteze științifice

Acum imaginează-ți că fiecare rezultat AI din acest sistem este verificat criptografic înainte de a fi de încredere.

Aceasta este viitorul pe care Mira încearcă să-l construiască.

Și dacă economia AI devine la fel de mare cum se așteaptă mulți, stratul de verificare ar putea deveni unul dintre cele mai valoroase componente ale acesteia.

Gândire finală

Cea mai mare întrebare în AI nu mai este:

„Ce poate face AI?”

Întrebarea reală este:

„Cum știm când AI are dreptate?”

Rețeaua Mira încearcă să răspundă la această întrebare cu criptografie, consens distribuit și stimulente economice.

Dacă AI devine creierul lumii digitale,

rețelele de verificare precum Mira ar putea deveni sistemul său imunitar.

💬 Discuție pentru comunitate

Dacă agenții AI încep să execute tranzacții financiare, să scrie contracte sau să facă recomandări medicale — ar trebui ca rezultatele lor să necesite întotdeauna verificare descentralizată? Sau vor rămâne companiile AI centralizate autoritatea de încredere?

@Mira - Trust Layer of AI #Mira #mira $MIRA