Modelele de limbaj mari pot scrie poezii, pot scrie cod, dar adesea se împotmolesc la matematică de școală primară? Această dilemă a fost în sfârșit depășită.

Recent am văzut o mișcare genială: cercetătorii au reușit să „încapsuleze” un interpret WASM (WebAssembly) în greutățile modelului Transformer fără pierderi!

Aceasta nu este doar simpla idee că „modelul va folosi un instrument”, ci că se execută direct o adevărată calculator în cadrul LLM.

💡Logica de bază: o arhitectură hibridă similară cu chipurile DSP, asemănătoare cu arhitectura DSP de la TI:

Rețele neuronale (ARM): Responsabilă pentru raționament logic, înțelegere semantică și organizare a limbajului.

Interpretator încorporat (DSP): Responsabil de calculul determinist de înaltă precizie și viteză.

Când LLM se confruntă cu problema care este mai mare între 3.11 și 3.8, nu mai ghicește următorul Token bazându-se pe „intuiție”, ci apelează direct la motorul de calcul intern.

🚀De ce este asta important?

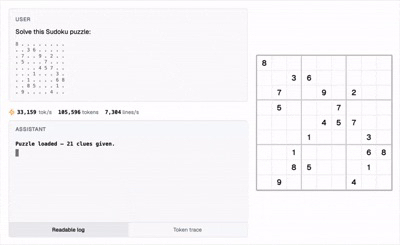

100% rată de acuratețe: Chiar și cele mai dificile Sudoku-uri pot fi rezolvate instantaneu, eliminând complet iluzia calculului.

Un milion de pași de rulare: Programul poate rula milioane de pași în interiorul modelului, performanța fiind explozivă.

Aplicații în toate domeniile: simulări fizice, modelare financiară, calcule criptografice… aceste domenii cu cerințe extrem de ridicate de precizie, LLM poate în sfârșit să le îndeplinească cu adevărat.

Aceasta nu mai este doar „AI generativă”, este „AI de calcul nativ”. Oamenii sunt cu un pas mai aproape de adevărata inteligență artificială generală (AGI)!

#AI #LLM #WebAssembly #Transformer #DeepLearning #AGI