Одно и то же жалование продолжает возникать по поводу больших языковых моделей.

Они звучат авторитетно, даже когда они ошибаются.

Опасность заключается не только в галлюцинации. Это уверенность, наложенная на неопределенность. Ответ может быть структурированным, беглым и убедительным, при этом все еще содержащим тонкие фактические ошибки или встроенную предвзятость. Это создает риск, который большинство пользователей недооценивают.

В основе своей LLM работают на основе распределений вероятностей. Они предсказывают вероятные последовательности, а не проверенные истины. Исследования показывают, что галлюцинация не является ошибкой, которая исчезает с увеличением масштаба. Это внутреннее ограничение вероятностной генерации. Попытки уменьшить галлюцинацию за счет более строгой курирования данных часто увеличивают предвзятость. Расширение наборов данных для снижения предвзятости может увеличить несогласованность. Существует структурный компромисс, которому ни одна модель полностью не может избежать.

Это становится критически важным, поскольку ИИ переходит в области с высокими последствиями. Торговые системы, инструменты соблюдения, медицинские резюме, юридическое оформление, автономные агенты. В этих областях звучать правильно недостаточно. Важно быть правильным.

Глубже проблема заключается в архитектуре. Большинство систем ИИ полагаются на централизованную валидацию или человеческий надзор. Это не масштабируется в мире, где агенты ИИ работают непрерывно и глобально.

Здесь @Mira - Trust Layer of AI переосмысляет проблему.

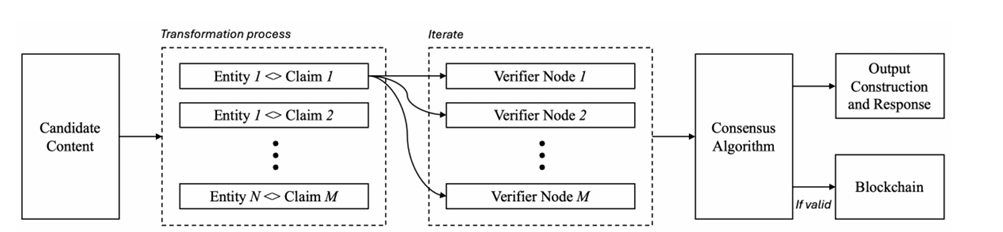

Вместо того чтобы пытаться усовершенствовать одну модель, MIira $MIRA вводит децентрализованный уровень верификации. Выходы ИИ разбиваются на мелкие, независимые утверждения. Каждое утверждение распределяется по нескольким узлам верификаторов. Эти узлы проводят свои собственные выводы и представляют суждения, которые агрегируются в консенсус.

Что отличает это, так это экономический уровень. Верификаторы должны ставить ценность. Если они попытаются угадать или систематически отклониться от консенсуса, их ставка может быть сокращена. В белой книге даже количественно оценивается, как повторные раунды верификации резко снижают вероятность успешного случайного угадывания. За несколько итераций статистическая манипуляция становится экономически нецелесообразной.

Существует также структурная выгода от децентрализации. Централизованные ансамбли все еще отражают предвзятость того, кто выбирает модели. Разрешительная сеть поощряет разнообразие в подходах к обучению и перспективах. По мере увеличения участия системная предвзятость может быть разбавлена через гетерогенный консенсус, а не контролируемую кураторство.

Конфиденциальность встроена в проект. Сложные выходы преобразуются в утверждения на уровне сущностей и случайным образом разбиваются, так что ни один отдельный узел не восстанавливает весь контекст. Верификация происходит без раскрытия полных документов отдельным операторам.

Более широкий взгляд выходит за рамки проверки генерации постов. Цель состоит в том, чтобы встроить верификацию непосредственно в саму генерацию, объединяя выводы и валидацию в единый процесс. Если это будет достигнуто, это переместит ИИ от вероятностного вывода к экономически безопасной надежности.

Когда системы ИИ начинают перемещать капитал, автоматизировать решения и формировать общественный дискурс, вопрос уже не в том, насколько умными они кажутся.

Настоящий вопрос заключается в том, можно ли доверять их выходам без человеческого надзора.

Это структурный разрыв $MIRA стремится закрыть через децентрализованную, согласованную с интересами инфраструктуру верификации.