Большинство систем ИИ сегодня хорошо генерируют ответы. Они гораздо менее надежны в их гарантировании.

Вы задаете вопрос. Модель отвечает с уверенностью. Структура звучит логично. Объяснение кажется полным. Но под этой реакцией скрывается простая проблема: она может быть неправильной.

Эта неопределенность является невидимым ограничением современных систем знаний ИИ.

Информация генерируется быстрее, чем может быть проверена.

Здесь Мира начинает изменять уравнение.

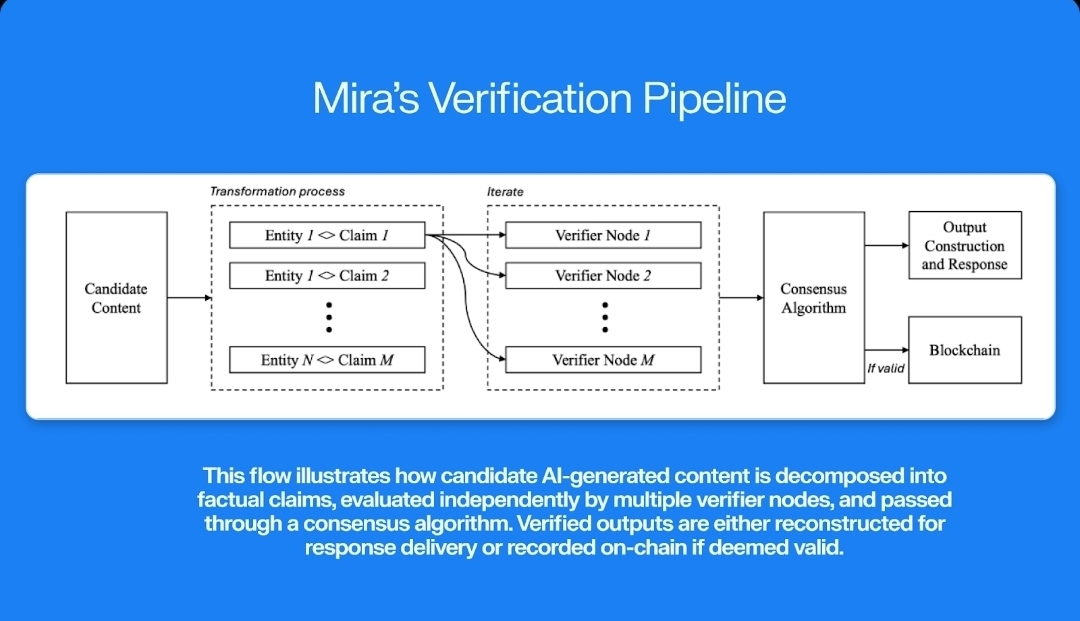

Вместо того чтобы рассматривать выводы ИИ как окончательные ответы, Мира рассматривает их как утверждения, требующие проверки. Система разбивает сгенерированный контент на более мелкие утверждения, которые могут быть независимо проверены в децентрализованной сети валидаторов.

Этот процесс трансформирует то, как сама информация может быть структурирована.

Традиционные графы знаний хранят отношения между сущностями. Они отображают связи между людьми, местами, событиями и концепциями в графо-ориентированной структуре, где узлы представляют собой сущности, а ребра представляют собой отношения.

Но эти графы обычно предполагают, что информация внутри них уже корректна.

На самом деле большинство современных графов знаний строится на основе собранных данных, человеческого ввода или автоматизированных извлекающих пайплайнов. Ошибки могут бесшумно распространяться по системе.

Mira вводит другую модель.

Прежде чем информация станет частью графа, она должна пройти через верификацию.

Каждое утверждение, сгенерированное моделью ИИ, может быть разложено на структурированные утверждения. Эти утверждения распределены между несколькими независимыми моделями или валидаторами, которые оценивают их точность и достигают консенсуса, прежде чем они будут приняты.

После проверки эти утверждения можно закрепить как надежные данные внутри графа знаний.

Результат — это граф, который не просто хранит отношения.

Он хранит проверенные отношения.

Это различие имеет большее значение, чем кажется.

В нормальной системе знаний ИИ информация является вероятностной. Система считает, что что-то вероятно истинно, потому что она видела подобные паттерны в обучающих данных.

В проверенном графе знаний информация становится отслеживаемой. Каждый узел и связь могут нести доказательства того, что утверждение было оценено и согласовано несколькими валидаторами в сети.

Это меняет то, как ИИ-системы рассуждают.

Вместо того чтобы генерировать ответы из слабо связанных вероятностей, модели могут запрашивать структурированную карту проверенных знаний.

Рассуждения становятся более надежными, потому что сама основа была проверена.

Для автономных ИИ-агентов это может быть критически важным.

Агенты, работающие независимо, нуждаются в надежном источнике информации. Если их база знаний содержит галлюцинированные факты или несогласованные данные, их решения могут быстро стать ненадежными.

Проверенный граф знаний снижает этот риск.

Агенты могут ссылаться на утверждения, которые уже были проверены распределенным слоем верификации, а не полагаться исключительно на свои собственные прогнозы.

Со временем это создает замкнутый круг.

ИИ генерирует знания.

Сеть проверяет это.

Проверенные утверждения расширяют граф знаний.

Будущие ИИ-системы запрашивают этот граф, чтобы рассуждать более точно.

Система становится постепенно более надежной по мере роста.

Это более широкое видение за слоями верификации, такими как Mira.

Не просто исправление галлюцинаций.

Но создание инфраструктуры для надежных знаний само по себе.

Если каждое утверждение внутри графа знаний ИИ несет доказательство верификации, информация перестает быть эфемерным текстом, созданным моделью.

Это становится структурированными, проверяемыми знаниями.

И как только знания становятся проверяемыми, ИИ-системы перестают так часто угадывать.

Они начинают рассуждать на основе чего-то ближе к истине.