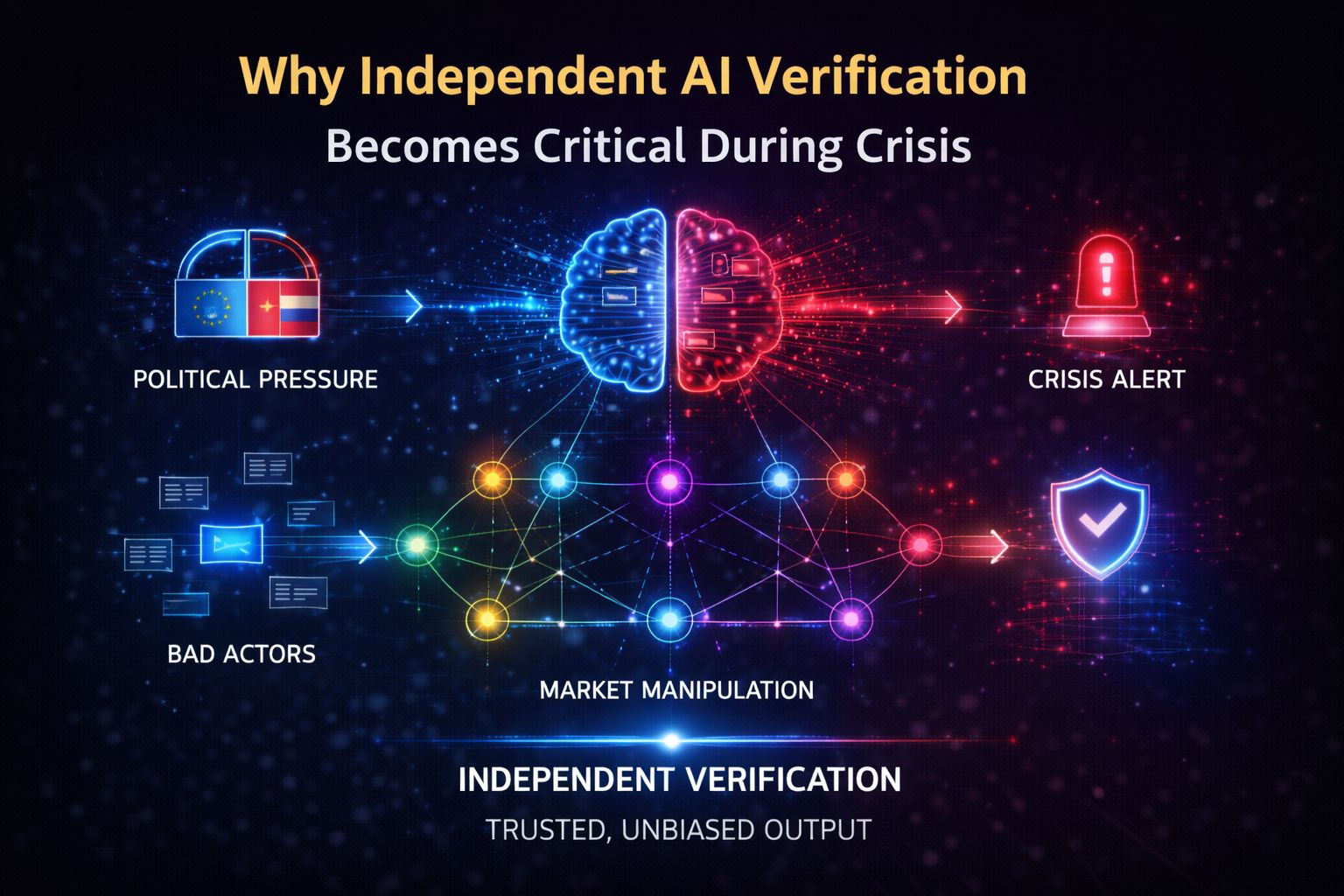

Почему независимая проверка ИИ становится критически важной во время войны и кризиса

Большие языковые модели обучаются на огромных массивах данных из интернета. Эти данные не нейтральны. Они отражают политический, культурный и институциональный вес регионов, которые производят большую часть контента. Когда доминирующая доля учебного материала поступает из конкретной страны или медийной экосистемы, модели могут впитывать шаблоны оформления, терминологии и нарративного уклона.

Это не требует злого умысла. Это структурно. Модели учатся статистическим взаимосвязям. Если определенные точки зрения повторяются чаще, эти точки зрения получают вероятностное преимущество в ответах.

В стабильные времена это может казаться тонким культурным уклоном. Во время войны или геополитических кризисов это становится гораздо более серьезным.

Информация становится стратегическим активом. Наративы формируют рынки, общественное мнение и даже восприятие на поле боя. Если системы ИИ, используемые трейдерами, журналистами, аналитиками или политиками, отражают сосредоточенную региональную предвзятость, последствия быстро нарастают. Финансовые рынки могут реагировать на искаженные сводки. Оценки рисков могут унаследовать дисбаланс нарратива. Автономные системы могут действовать на основе неполной или фреймированной информации.

Опасность не в том, что ИИ намеренно распространяет пропаганду. Опасность в том, что он может непреднамеренно усиливать доминирующие нарративы из-за распределения обучения и механизмов усиления.

Независимая проверка фактов становится необходимой в этих условиях.

Здесь становится актуальной архитектура децентрализованной верификации. Вместо того чтобы доверять одной модели, обученной под одним институциональным углом, результаты можно разложить на дискретные фактические утверждения. Каждое утверждение затем может быть оценено независимо разными узлами-верификаторами, работающими с экономическими стимулами, согласованными с точностью, а не с преданностью нарративу.

@Mira - Trust Layer of AI именно такая структура.

Вместо того чтобы предполагать, что одна модель может устранить свою предвзятость, $MIRA вводит систему, в которой несколько моделей участвуют в консенсусной верификации. Валидаторы ставят ценность для участия, создавая подотчетность. Если они последовательно отклоняются так, что это указывает на небрежную или недобросовестную верификацию, они рискуют экономическими штрафами.

Разнообразие играет ключевую роль. Децентрализованная сеть поощряет гетерогенные архитектуры моделей, различные тренировочные корпуса и географически распределенных операторов. Со временем это снижает вероятность того, что одна доминирующая перспектива контролирует результат.

Другим критическим фактором во время кризиса является конфиденциальность. Чувствительные документы, сводки разведки или финансовые анализы не могут быть широко раскрыты. Подход Mira, заключающийся в разбивке контента на гранулярные утверждения и распределении их по узлам, означает, что ни один валидатор не восстанавливает весь документ, защищая конфиденциальность и сохраняя целостность верификации.

Во время войны или в условиях высокой геополитической напряженности нейтральная информация становится инфраструктурой. Рынки зависят от нее. Учреждения зависят от нее. Граждане зависят от нее.

ИИ все больше внедряется в исследовательские процессы, системы торговых ботов и автоматизированные потоки решений и рабочего процесса. С увеличением зависимости возрастает необходимость в проверяемой нейтральности.

Независимая проверка фактов больше не является опциональной. Она становится механизмом стабильности.

$MIRA и #Mira рамка верификации стремится создать слой доверия, согласованный с инсентивами, который снижает структурную предвзятость и повышает уверенность в выходах ИИ, когда точность имеет наибольшее значение.