Большинство ИИ-систем сегодня имеют одну основную слабость.

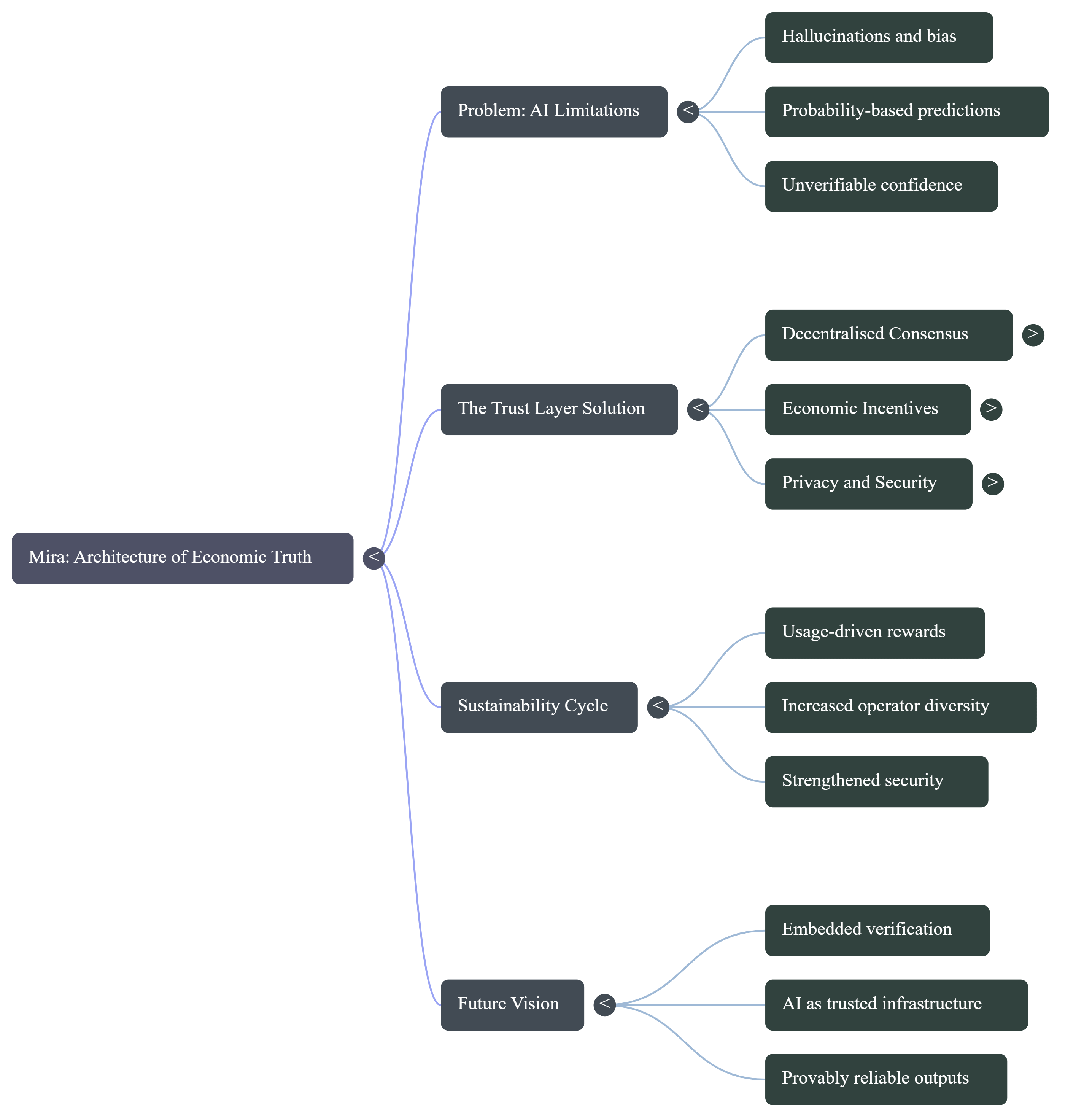

Они генерируют ответы, которые звучат уверенно, но не могут гарантировать их правильность. Галлюцинации и предвзятости не являются редкими сбоями. Они возникают из того, как строятся большие модели. Эти системы предсказывают вероятности, а не проверенные истины. Даже при тонкой настройке, кажется, существует минимальная ошибка, которую одна модель не может полностью устранить.

Мира начинает с другой веры.

Вместо того чтобы пытаться создать одну идеальную модель, она строит систему, в которой несколько моделей проверяют друг друга.

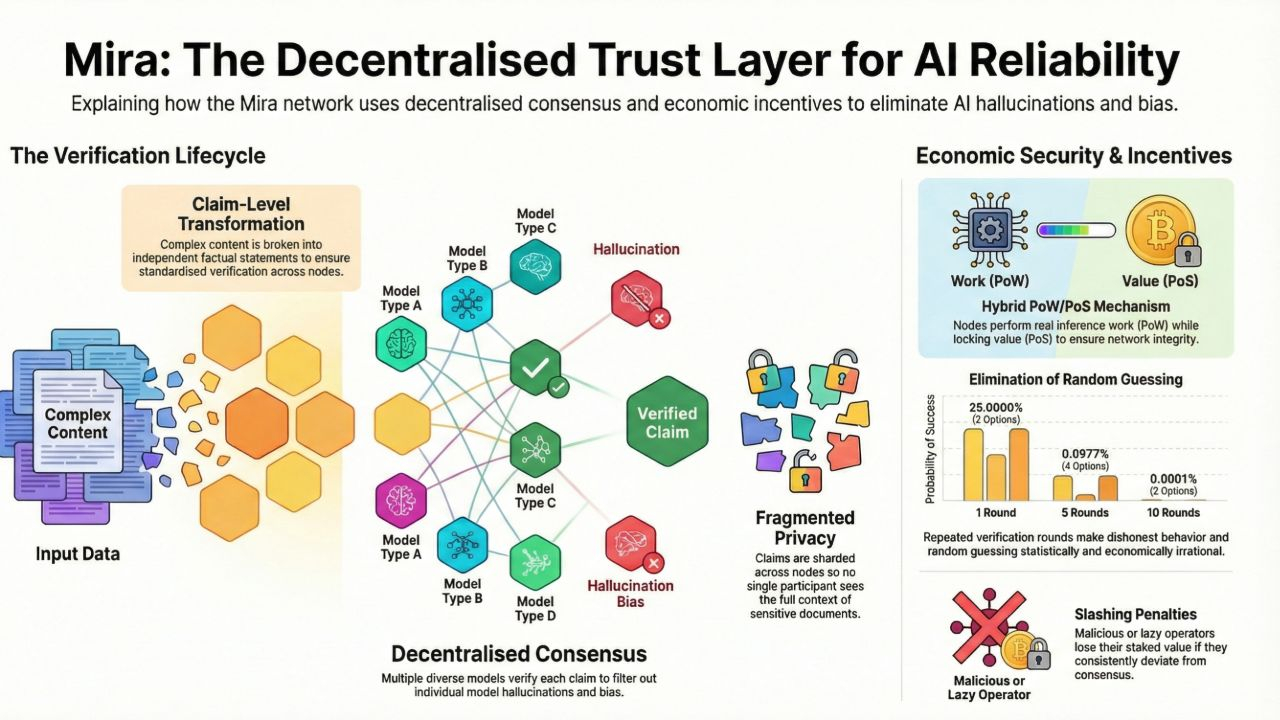

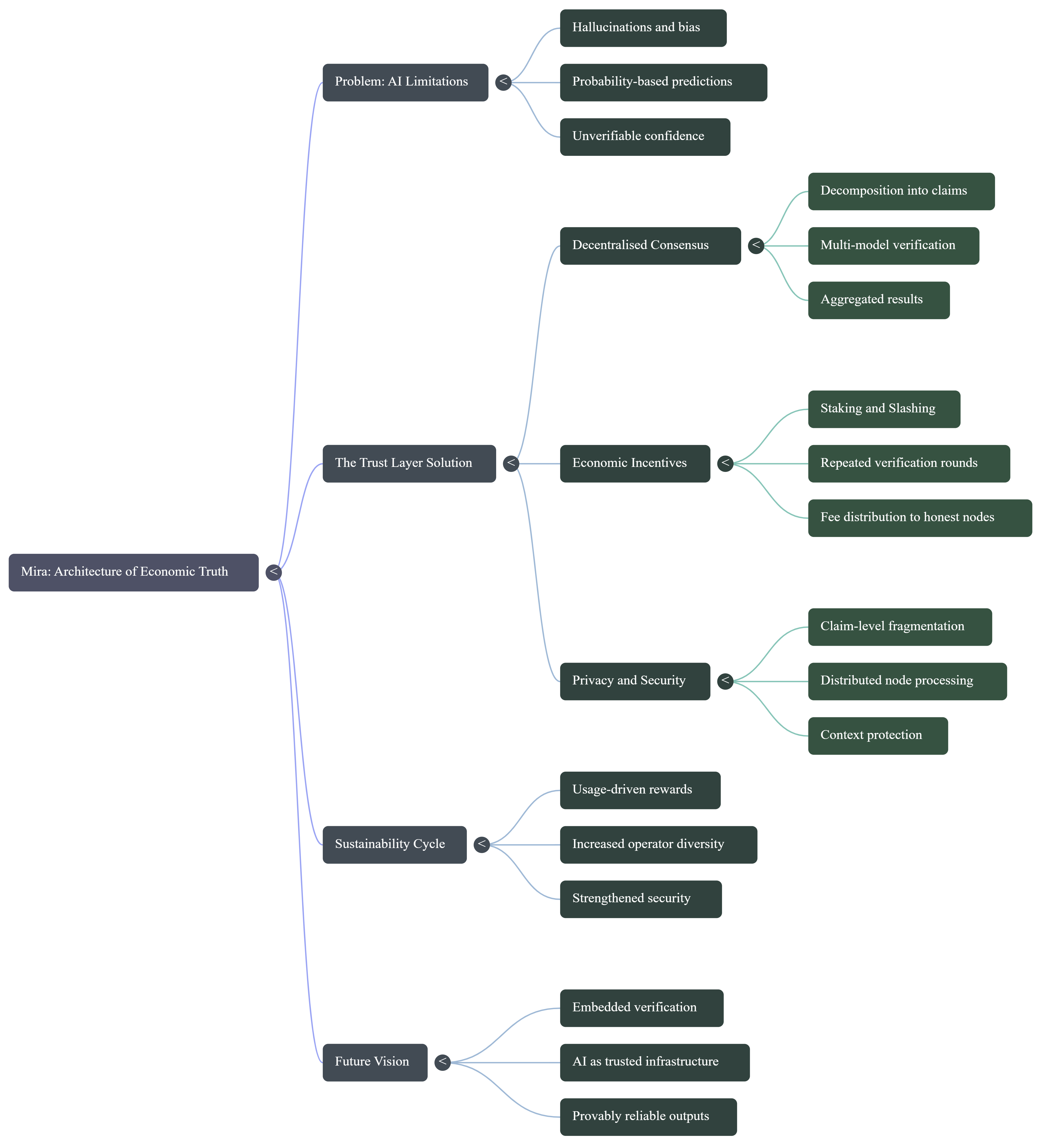

Согласно @Mira - Trust Layer of AI докладу, $MIRA преобразует выводы ИИ в более мелкие, независимые требования. Например, длинный абзац разбивается на четкие фактические утверждения. Каждое утверждение затем отправляется разным узлам-проверяющим. Эти узлы проводят свои собственные выводы и представляют суждение. Сеть агрегирует ответы и производит консенсусный результат.

Этот процесс снижает как галлюцинации, так и предвзятость, поскольку ни одна отдельная модель не контролирует результат.

Но одной верификации недостаточно. Важны стимулы.

$MIRA сочетает работу по выводу с стекингом. Валидаторы должны заблокировать ценность, чтобы участвовать в сети. Если они попытаются обмануть систему, угадывая ответы или отправляя небрежные ответы, они рискуют потерять свою долю через штрафы.

Доклад даже объясняет, почему это необходимо. Поскольку вопросы верификации могут иногда выглядеть как задачи с множественным выбором, случайное угадывание может показаться привлекательным. Mira решает эту проблему, требуя повторных раундов верификации и экономических штрафов. Вероятность постоянного правильного угадывания резко падает при нескольких проверках, что делает нечестное поведение статистически и экономически нерациональным.

Вот как строится устойчивость.

Пользователи платят сборы за проверенные выводы. Эти сборы распределяются между честными операторами узлов, которые выполняют настоящую работу по выводу. По мере роста использования вознаграждения растут. По мере роста вознаграждений больше операторов присоединяются. С увеличением разнообразия операторов уменьшается предвзятость и усиливается безопасность. Это становится замкнутым циклом.

Еще один важный слой — это конфиденциальность. Вместо отправки полных документов одному валидатору, содержание разбивается на фрагменты уровня требований и распределяется по узлам. Ни один отдельный участник не видит весь контекст. Это защищает чувствительную информацию, позволяя при этом проводить верификацию.

Долгосрочное видение идет дальше. Mira стремится перейти от верификации выводов после генерации к встраиванию верификации непосредственно в процесс генерации. Это означает создание ИИ-систем, где валидация является частью того, как создается ответ, а не последующей мыслью.

Проще говоря, Mira рассматривает правду как нечто, что должно быть экономически защищено.

Не предполагается.

Не централизовано.

Но проверено через децентрализованный консенсус и согласованные стимулы.

Поскольку ИИ становится инфраструктурой для финансов, здравоохранения, права и автоматизации, доверие не может зависеть только от уверенности. Оно должно основываться на системах, которые вознаграждают честность и наказывают за манипуляции.

Это основа, которую пытается построить Mira.

Системы, такие как $MIRA стремятся создать слой доверия, который делает выводы ИИ не только убедительными, но и доказуемо надежными.

#Mira #MİRA #AIToken #cforcrypto