Все говорят, что глобальные AI-компании все еще как новорожденный ребенок, который знает лишь основы.

На самом деле, с 25 лет назад крупные AI-компании уже немного стали зрелыми.

Уже можно строить чрезвычайно сложные интеллектуальные системы.

Роботы могут двигаться самостоятельно, решения модели можно редактировать.

Но если нет границ, эти способности могут стать усилителями рисков.

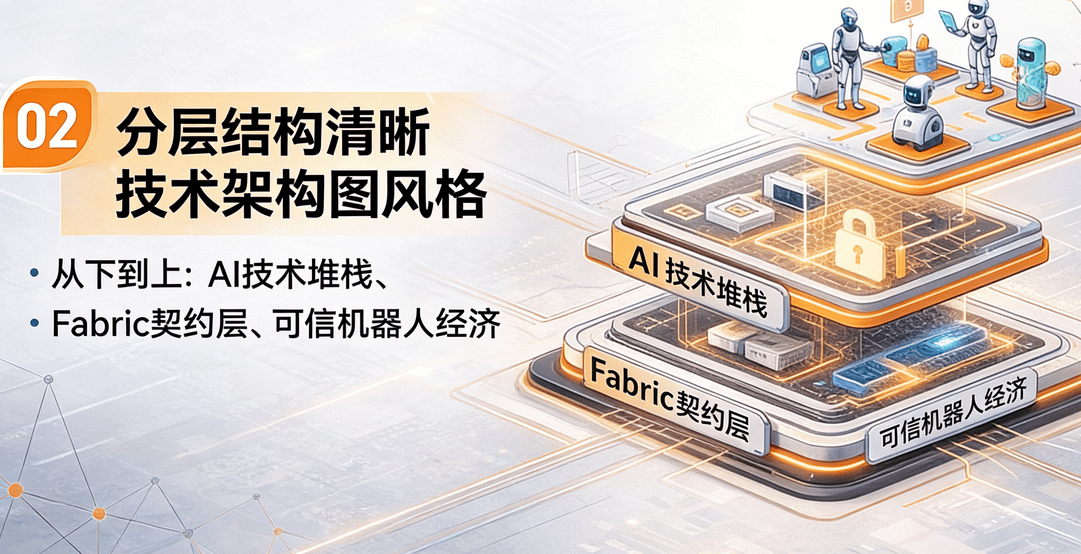

@Fabric Foundation Экосистема, которую мы создаем, является основой этого контракта.

Дело не в том, чтобы научить AI-роботов уму, а в том, чтобы они стали более дисциплинированными.

Традиционный способ мошенничества нацелен на людей.

А мошенничество в сети и на блокчейне нацелено на системные интерфейсы.

Хакеры не нуждаются в том, чтобы говорить с вами много, им просто нужно взломать одну систему прокси.

Если немного изменить права, ваши средства исчезнут.

В таких неблагоприятных условиях идентичность и права постепенно стали ключевыми моментами.

Многие также считают, что процесс Claim зачастую очень сложен, на самом деле это структурное тестирование.

#ROBO механизм уже ясно говорит вам:

1. Вы готовы соблюдать хорошие правила?

2. Вам нужно понять ограничения прав.

3. Вы принимаете механизм проверяемого аудита?

Это похоже на ввод пароля для робота, на самом деле это усиливает вероятность безопасности.

Если в будущем сложится экономика роботов, первое, на что стоит обратить внимание, это не размер, а степень доверия.

Поэтому вопрос нового времени не в том, что "технологии недостаточно развиты".

А не "правила отстают от технологий"

Когда действительно высокопроизводительное автоматизированное оборудование и модели будут созданы,

Но без обязательств риски могут распространиться до невообразимых масштабов.

Fabric, по сути, также меняет связь между ИИ-роботами и активами.

Когда у вас есть такие контракты, как Fabric, вы сможете контролировать больше неописуемых рисков.

Также могут стать ведущими в проверке поведения.