Я не стал обращать внимание на Mira, потому что думал, что нам нужен еще один протокол ИИ.

Я начал обращать внимание, потому что осознал нечто неприятное: ИИ уже кажется достаточно умным. Но он не кажется достаточно надежным.

Есть разница.

Когда я использую ИИ сегодня, я не сомневаюсь, может ли он генерировать контент. Он явно может. Реальный вопрос в том, могу ли я доверять этому контенту, не проверяя его лично. И сейчас честный ответ — нет.

Вот где подходит Mira Network.

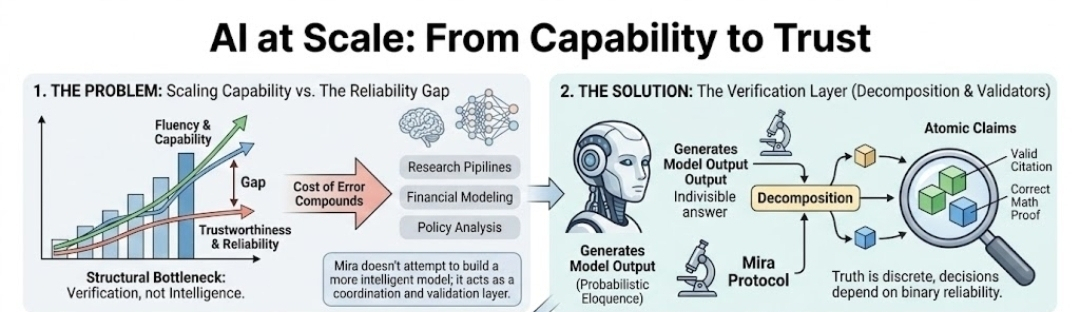

Mira не пытается конкурировать с создателями моделей. Это не еще одна LLM. Это децентрализованный протокол проверки, предназначенный для того, чтобы находиться между выводами ИИ и доверием. Эта позиция тонкая, но она меняет весь разговор.

Вместо того чтобы предполагать, что ответ модели — это единственная, неделимая истина, Mira разбивает выводы на отдельные утверждения. Эти утверждения затем распределяются по сети независимых валидаторов. Каждый валидатор — который сам может быть системой ИИ — оценивает утверждение отдельно. Согласие достигается через координацию блокчейна и экономические стимулы.

Таким образом, модель доверия меняется.

Вы больше не полагаетесь на уверенность единственной модели. Вы полагаетесь на распределенное согласие в условиях, обеспеченных ставками. Проверка фиксируется в цепочке блоков. Стимулы вознаграждают точную оценку и наказывают за небрежное одобрение.

Истина становится экономически обеспеченной, а не репутационно предполагаемой.

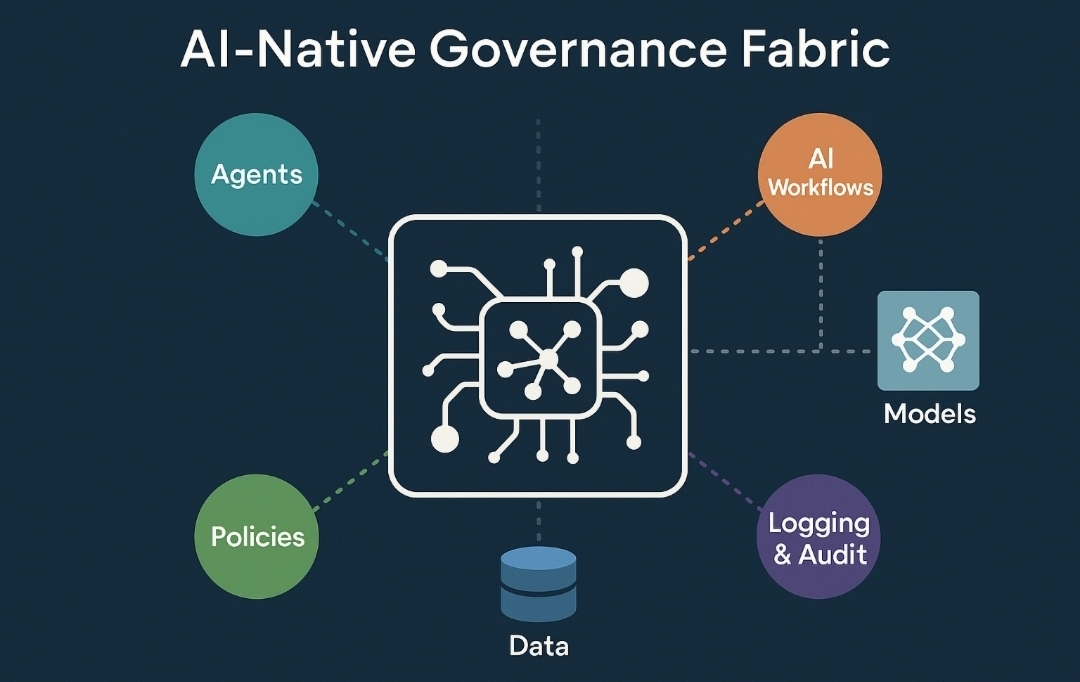

То, что делает это больше, чем теория, — это направление, в котором движется ИИ. Мы уже видим ранние формы автономных агентов, управляющих портфелями, взаимодействующих с DeFi, автоматизирующих рабочие процессы и генерирующих исследования. Как только ИИ переходит от предложения к выполнению, «вероятно, правильно» перестает быть достаточно хорошим.

Mira не предполагает, что галлюцинации исчезнут с большими моделями. Она принимает, что вероятностные выводы являются неотъемлемой частью текущих архитектур. Вместо того чтобы бороться с этим на уровне модели, она строит уровень надежности вокруг этого.

Это кажется реалистичным.

Конечно, эта архитектура вводит сложность. Декомпозиция рассуждений на проверяемые утверждения не является тривиальной задачей. Проверка добавляет задержку. Разнообразие валидаторов должно поддерживаться, чтобы предотвратить коррелированный bias. Риски сговора необходимо тщательно смягчать.

Но основная теза трудно игнорировать:

Интеллект без проверки не масштабируется безопасно.

Централизованная модерация не будет достаточной, если ИИ станет инфраструктурой. Репутация не будет достаточной, когда системы будут работать автономно в финансовых, юридических и промышленных областях.

Mira позиционирует себя как уровень доверия для ИИ — преобразуя вероятностные выводы модели в информацию, основанную на консенсусе.

Это не броско. Это не гонится за эталонами моделей. Это решает структурную слабость в том, как ИИ в настоящее время развернут.

И если ИИ продолжит двигаться к автономному выполнению, протоколы проверки, такие как Mira, не будут казаться необязательными.

Они будут ощущаться как необходимые.