Я как-то застряла в лифте. Недолго — минут десять. Но этого хватило, чтобы начать разглядывать стены. И там висел сертификат проверки: дата, подпись инженера, печать. Я тогда подумала — зачем это здесь? Лифт либо работает, либо нет. Пассажиры же не читают эти бумажки. А потом до меня дошло.

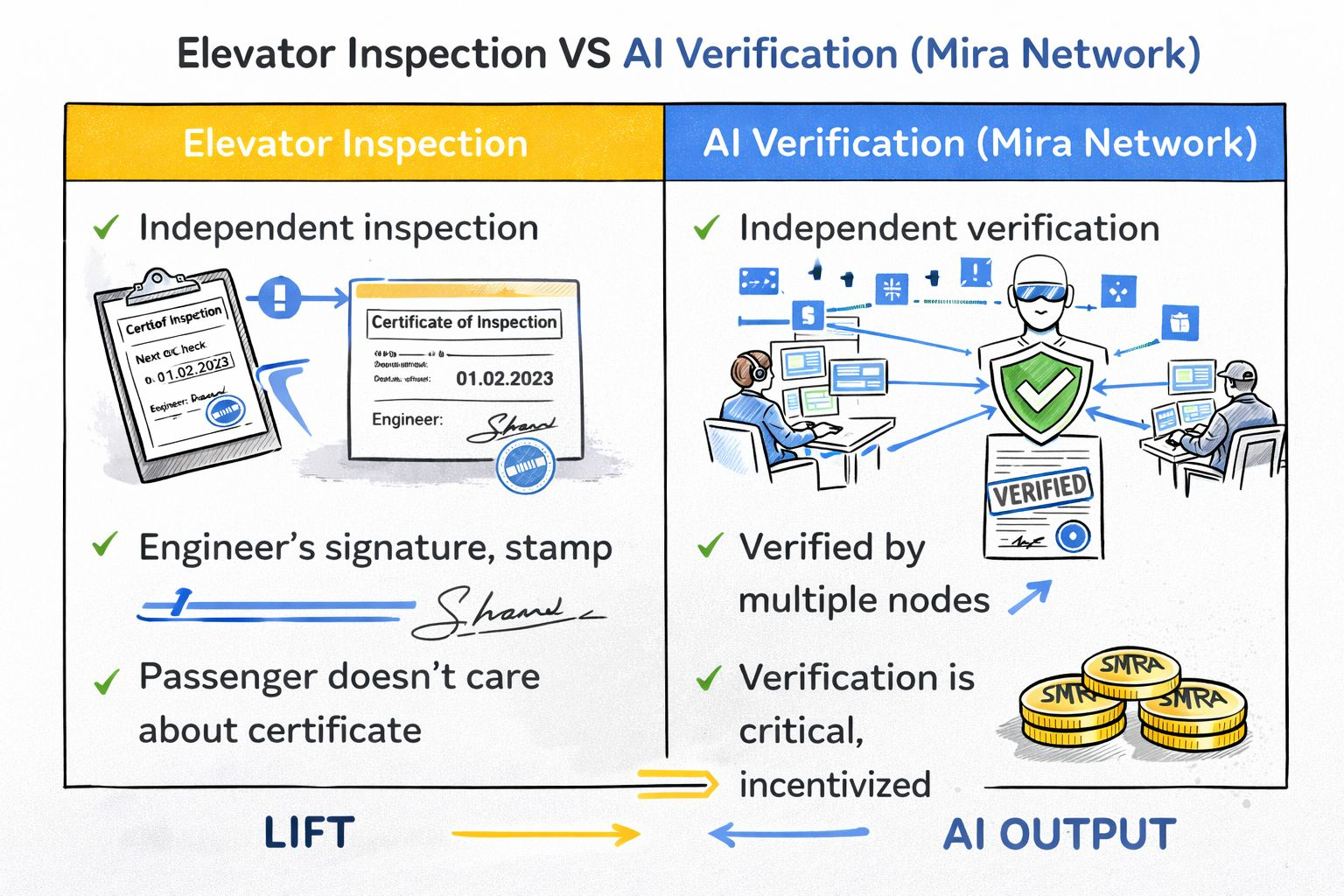

Этот сертификат не для пассажиров. Он для системы. Это доказательство, что кто-то независимый проверил механизм и подписался под этим своим именем. Не компания, которая установила лифт. Не производитель. Кто-то третий.

Когда я позже читала про @Mira - Trust Layer of AI , эта сцена с лифтом вдруг вспомнилась сама. Потому что сейчас с AI-агентами всё работает наоборот. Агент выдает вывод — и этот же агент является единственным источником этого вывода. Нет третьей стороны. Нет подписи. Нет “даты проверки на стене”.

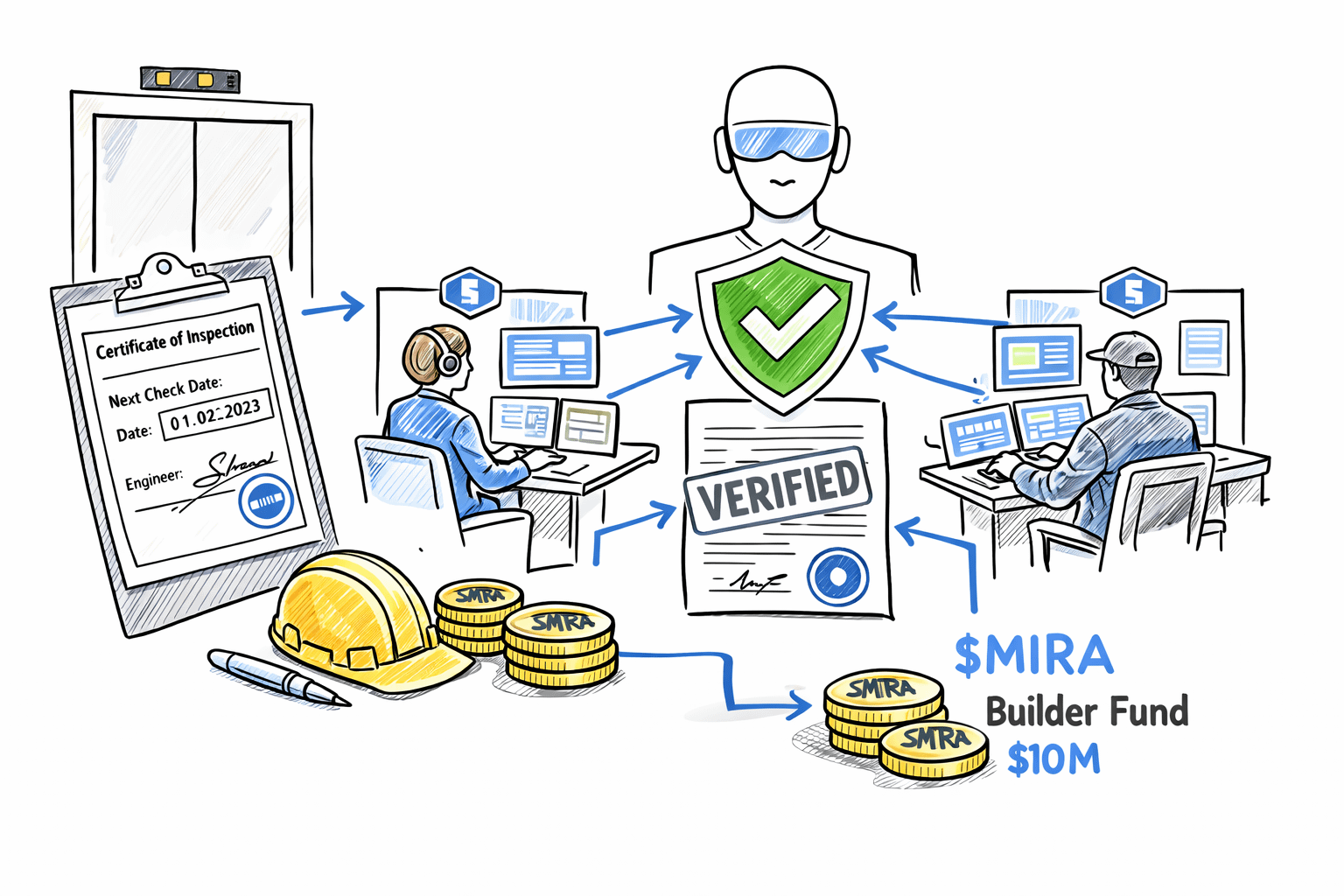

Есть просто текст, который появился — и ты либо доверяешь ему, либо нет. Mira пытается добавить этот отсутствующий слой. Сеть независимых узлов проверяет вывод агента отдельно друг от друга. Затем результаты сверяются. Если все сходятся — вывод проходит дальше. Если есть расхождение — система останавливается до того, как это станет реальным действием.

То есть вместо одного источника появляется сеть подписей.

Мне еще запомнилась одна деталь: у Mira есть $10M Builder Fund. Это фонд для разработчиков, которые строят продукты поверх этой системы верификации. Не просто идея на бумаге — попытка сделать так, чтобы проверка AI действительно стала частью инфраструктуры.

$MIRA в этой модели создает стимул для узлов участвовать в проверке. Верификаторы ставят стейк и рискуют им, если подтвердят неправильный результат. То есть подпись под проверкой имеет реальную цену.

И чем больше я думаю об этом, тем больше понимаю одну вещь.

Пока большинство проектов делает агентов быстрее и автономнее, @Mira - Trust Layer of AI строит для них систему проверки. Примерно как тот инженер, который подписывает проверку лифта — и о котором никто не думает, пока двери просто открываются и закрываются.

#Mira @Mira - Trust Layer of AI $MIRA