В быстро меняющемся мире искусственного интеллекта большинство проектов преследуют одни и те же цели: больше скорости, больше масштаба и более впечатляющие результаты. Но Mira Network подходит к проблеме с совершенно другой стороны. Вместо того чтобы сосредоточиться на том, насколько мощным может стать ИИ, она ставит более сложный и неудобный вопрос: Что происходит, когда люди начинают слишком легко доверять ответам ИИ?

Этот вопрос находится в центре философии Mira.

Сегодня многие системы ИИ оцениваются по тому, насколько гладко они генерируют язык. Если ответ звучит уверенно, структурированно и умно, люди, как правило, принимают его. Проблема в том, что беглость не равна надежности. Модель ИИ может создать отточенное объяснение, которое звучит убедительно, но при этом все еще содержит тонкие ошибки, неверные интерпретации или преувеличенные выводы.

И когда ответ кажется полным, большинство пользователей редко останавливаются, чтобы проверить его. Они читают его, принимают и движутся дальше. Такое поведение создает тихий, но серьезный риск: ИИ может ошибаться очень убедительным образом.

Сеть Mira, похоже, лучше понимает эту проблему, чем большинство проектов в области ИИ-криптовалют.

Вместо того, чтобы пытаться сделать выводы ИИ более впечатляющими, Mira сосредоточена на том, чтобы сделать доверие более сложным для предоставления без проверки. Это смещает разговор от чистой производительности к чему-то более важному — суждению и ответственности.

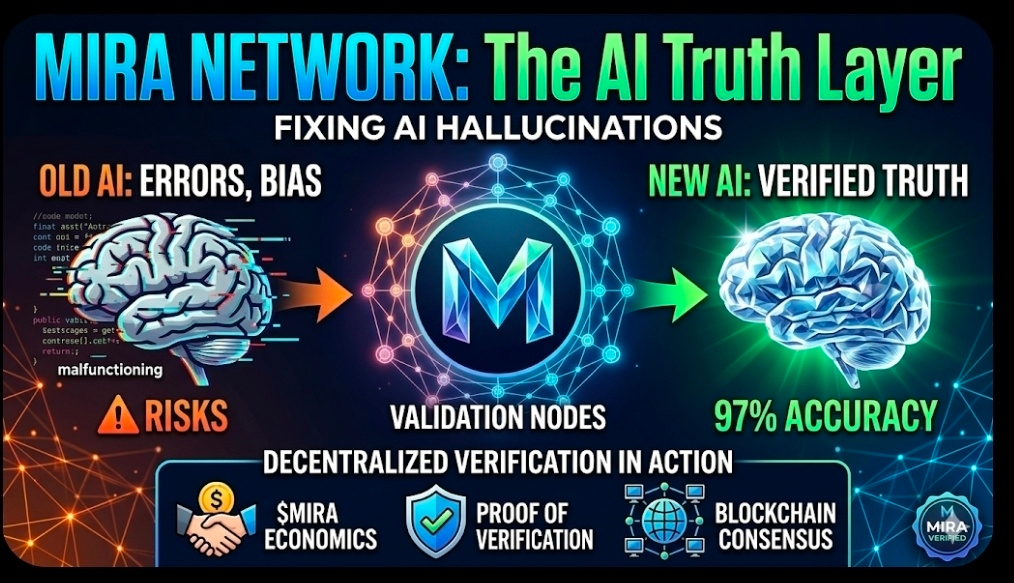

В основе подхода Mira лежит простая, но мощная идея: выводы ИИ не должны вызывать доверие просто потому, что их произвела одна система. Их необходимо проверять.

Это означает, что требования, выдвинутые системой ИИ, должны пройти процесс проверки и валидации, прежде чем их можно будет считать надежными. Уверенность должна возникать после проверки, а не до нее.

Хотя эта концепция звучит очевидно, большинство текущей экосистемы ИИ все еще предполагает, что лучшие модели в конечном итоге решат проблему доверия самостоятельно. Улучшенное обучение, большие наборы данных, более мощные системы поиска и лучшие интерфейсы могут снизить количество ошибок, но они не могут полностью их устранить.

Даже самая передовая модель все еще может создать убедительную ошибку.

Mira начинает с более дисциплинированного предположения: проблема доверия в ИИ не только в лучших моделях — она заключается в создании систем, которые проверяют выводы.

Интересно, что эта философия тесно связана с принципами технологии блокчейна. Криптовалюта изначально была построена на скептицизме по отношению к централизованному доверию. Вместо того, чтобы полагаться на единую власть, системы блокчейна используют распределенную валидацию для подтверждения информации.

Mira применяет тот же подход к искусственному интеллекту.

Вместо того чтобы предполагать, что интеллект автоматически заслуживает доверия, проект пытается создать структуру, в которой выводы ИИ должны заслужить доверие через проверку.

Это делает Mira менее ориентированной на производство ИИ и больше на ответственность ИИ.

Еще одной причиной, по которой проект кажется приземленным, является то, что он отражает реальное поведение пользователей. На практике люди редко перепроверяют ответы ИИ. Большинство пользователей заняты и предпочитают быстрые ответы. Когда ответ ИИ выглядит отполированным и полным, это естественно снижает желание задать ему вопросы.

Mira, похоже, спроектирована с учетом этой реальности. Вместо того, чтобы ожидать, что пользователи станут идеальными проверяющими фактов, она пытается встроить проверку непосредственно в систему.

Этот подход становится все более важным по мере того, как ИИ начинает влиять на решения, а не просто генерировать текст.

Следующая фаза ИИ заключается не только в написании резюме или ответах на вопросы. Она будет все больше помогать людям интерпретировать информацию, оценивать возможности, анализировать риски и принимать решения.

Когда ИИ работает в этих областях, ошибки больше не безобидны.

Ошибочный вывод может повлиять на инвестиции, решения в области управления, выводы исследований или бизнес-стратегии. В этот момент последствия ошибки становятся реальными. Ошибки ИИ перестают быть неловкими сбоями — они становятся операционными рисками.

Здесь начинается усиление тезиса Mira.

Проект по сути исследует, может ли доверие к выводу ИИ стать формой инфраструктуры, а не чем-то, что пользователи просто предполагают. Вместо того, чтобы просить системы ИИ генерировать больше ответов, Mira спрашивает, может ли окружение вокруг этих ответов сделать ложную уверенность более трудной для создания.

В настоящее время немногие проекты работают на этом уровне.

Большинство платформ ИИ конкурируют по возможностям — кто может генерировать более быстрые ответы, более умный текст или более продвинутую автоматизацию. Mira, напротив, пытается конкурировать по доверительности.

Это гораздо более сложный рынок для создания. Проверка вводит трение. Она может увеличить время, стоимость и сложность. Разработчики и пользователи примут эти компромиссы только в том случае, если выгоды будут явно видны.

Это становится самой большой проблемой Mira.

Успех проекта будет зависеть от того, станет ли проверка практически необходимой, а не просто теоретически привлекательной. Если людям нравится концепция, но они избегают ее использования, потому что это кажется неудобным, Mira может остаться сильной идеей без широкого принятия.

Тем не менее, если непроверенные выводы ИИ начинают казаться рискованными — особенно в ситуациях, где решения имеют реальные последствия — проверка может стать необходимой.

Когда это произойдет, такие системы, как Mira, могут перейти от статуса необязательных инструментов к базовой инфраструктуре, аналогичной уровням безопасности в интернете.

Невидимые системы часто становятся наиболее важными, когда технологии созревают. Когда проверка работает хорошо, пользователи могут едва замечать ее. Они просто испытывают меньше вводящих в заблуждение выводов, получая доверие.

Отсутствие ошибок может быть трудно продвигать, но его ценность может быть огромной.

В конечном итоге, сеть Mira — это не просто еще один проект ИИ, связанный с технологиями блокчейна. Это попытка формализовать скептицизм в эпоху, когда машины могут говорить убедительно.

Вместо того чтобы доверять ответам, потому что они звучат умно, Mira пытается создать процесс, в котором ответы доверяются, потому что они прошли проверку.

Это амбиция уже уже, чем многие нарративы об ИИ, но она также глубже. Проект не гонится за самой широкой историей об искусственном интеллекте. Вместо этого он исследует конкретную и становящуюся все более важной проблему: как создать доверие к информации, сгенерированной ИИ.

Поскольку ИИ становится более вовлеченным в то, как люди интерпретируют данные, оценивают риски и принимают решения, эта проблема станет только более актуальной.

Mira позиционирует себя непосредственно в этом разрыве между внешним видом и надежностью.