@Mira - Trust Layer of AI #Mira

@Mira - Trust Layer of AI #Mira

Когда люди говорят об улучшении ИИ, разговор обычно начинается с больших моделей, большего объема обучающих данных или более быстрой инференции. Моя первая реакция на такую формулировку — скептицизм. Не потому, что эти вещи не важны, а потому что они упускают более тихую проблему, лежащую в основе большинства современных ИИ-систем: интерпретация. ИИ может производить огромные объемы выходных данных, но настоящий вопрос заключается в том, может ли кто-то надежно доверять тому, что эти выходные данные означают.

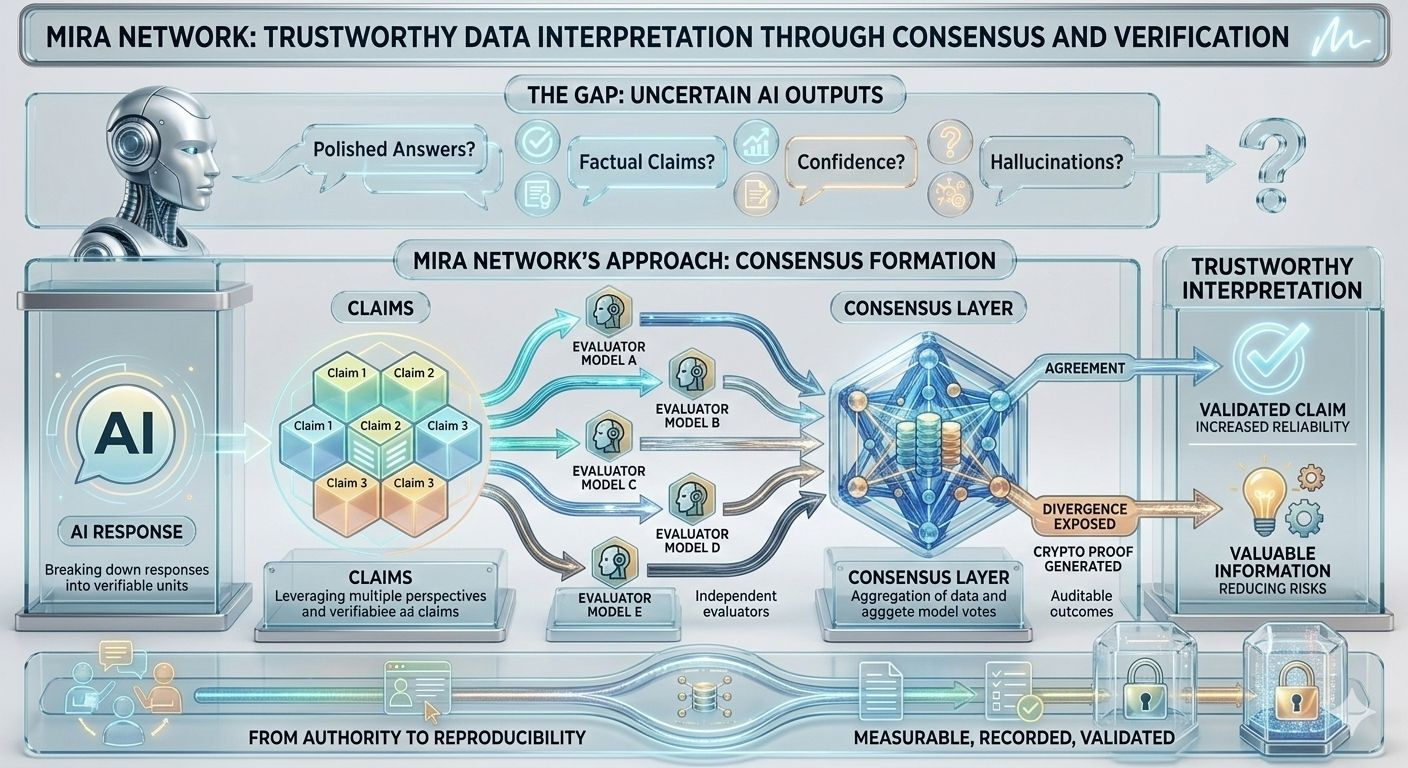

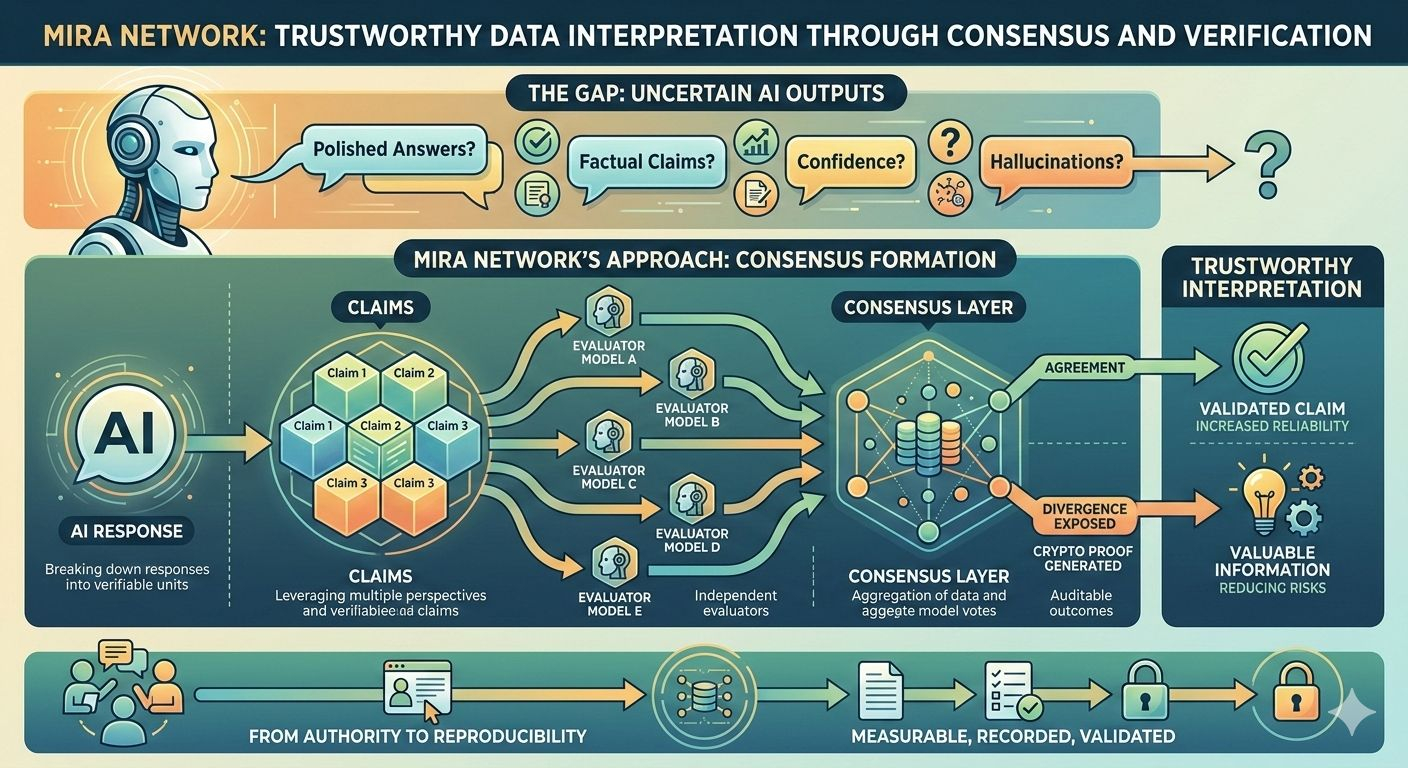

Это разрыв, который надежная интерпретация пытается преодолеть. Проблема заключается не только в том, что модели время от времени выдают галлюцинации; дело в том, что пользователи редко имеют четкий способ проверить, следует ли верить конкретному утверждению, сгенерированному ИИ-системой. Когда ответ выглядит отполированным и уверенным, легко забыть, что система, которая его производит, может опираться на неопределенные паттерны, а не на проверяемые факты.

Большинство современных развертываний ИИ рассматривают эту неопределенность как приемлемый компромисс. Если ответ выглядит разумным и приходит быстро, система считается успешной. Но как только ИИ начинает поддерживать финансовые решения, автоматизированные операции или процессы управления, "разумно выглядящий" больше не является достаточным. Интерпретация становится проблемой инфраструктуры, а не косметическим улучшением.

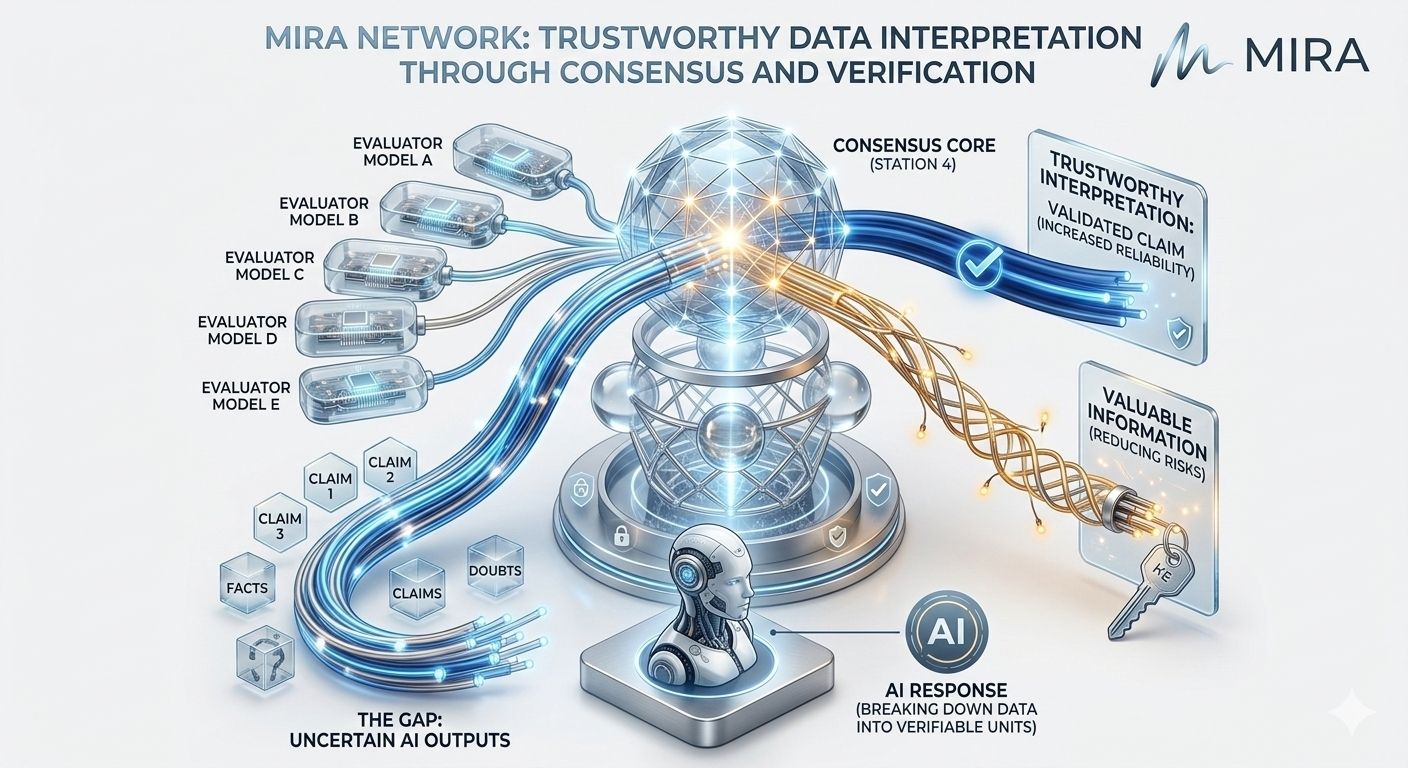

Здесь Mira Network предлагает другой подход. Вместо того чтобы рассматривать ответ ИИ как единственный результат, система разбивает его на более мелкие утверждения, которые могут быть оценены независимо. Каждое утверждение затем может быть проверено по нескольким моделям, позволяя сети сравнивать интерпретации, а не полагаться на один источник размышлений.

Как только вы начинаете думать об этом таким образом, интерпретация данных перестает быть задачей одной модели и начинает выглядеть больше как формирование консенсуса. Если несколько независимых систем оценивают одно и то же утверждение и приходят к схожим выводам, вероятность надежности увеличивается. Если их интерпретации расходятся, само разногласие становится ценным информацией.

Но интересная часть заключается не только в проверке — это то, как процесс проверки становится структурированным. Превращение утверждений в проверяемые единицы означает, что интерпретацию можно измерять, фиксировать и валидировать. Вместо того чтобы доверять оценке уверенности модели, пользователи взаимодействуют с системой, которая производит криптографические доказательства того, что несколько оценщиков проверили информацию.

Конечно, это поднимает другой вопрос: кто выполняет эту оценочную работу? В децентрализованной сети проверки роль переходит от одного централизованного поставщика ИИ к распределенному набору участников, работающих с разными моделями. Каждый участник вносит свой анализ, а сеть агрегирует результаты в интерпретацию, основанную на консенсусе.

Этот переход изменяет стимулы вокруг надежности данных. В традиционных ИИ-сервисах пользователи неявно доверяют поставщику, работающему с моделью. С наличием слоя проверки доверие распределяется среди независимых оценщиков, чьи выводы должны совпадать для валидации утверждения. Система становится менее о власти и больше о воспроизводимости.

Естественно, механика этого процесса имеет большое значение. Утверждения должны быть структурированы достаточно ясно, чтобы их можно было оценивать независимо. Оценщики должны иметь стимулы для предоставления точных суждений, а не просто соглашаться с большинством. И сети нужен способ фиксировать результаты прозрачно, чтобы интерпретация оставалась подотчетной с течением времени.

Эти детали — это то, где интерпретация переходит от концепции к инфраструктуре. Проверка — это не просто проверка фактов; это создание системы, в которой несколько точек зрения могут сходиться к надежному ответу без зависимости от одного контролера. Если эта инфраструктура работает хорошо, надежность вывода ИИ улучшается без замедления систем, которые их генерируют.

Существует также более широкое значение, которое часто упускается из виду. Как только интерпретация ИИ становится проверяемой, это открывает двери для автоматизации в областях, которые ранее требовали человеческого контроля. Автономные системы могут ссылаться на проверенные утверждения, а не на сырые выходы модели, снижая риск того, что одно галлюцинирование нарушит весь рабочий процесс.

Это не значит, что проверка полностью устраняет неопределенность. Разногласия между моделями все равно будут происходить, и сети необходимо решить, как эти конфликты разрешаются. Но даже этот процесс может быть ценным, потому что он выявляет неоднозначность, а не прячет ее за одним уверенным ответом.

Со временем реальная мера успеха для таких систем, как Mira Network, не будет заключаться просто в том, правильно ли они проверяют выводы ИИ в нормальных условиях. Реальный тест наступит, когда данные будут неаккуратными, модели резко будут не согласны или стимулы будут подталкивать участников к манипуляциям. Надежная интерпретация имеет значение только в том случае, если она продолжает функционировать, когда информационная среда становится сложной.

Таким образом, самый важный вопрос заключается не в том, может ли ИИ генерировать ответы быстрее или более бегло. Вопрос в том, может ли экосистема создавать системы, которые интерпретируют эти ответы так, что люди могут проверять, аудировать и полагаться на них. Потому что в мире, все больше формируемом автоматизированными решениями, разница между информацией и надежной интерпретацией может оказаться самым важным слоем из всех.