Разговор об искусственном интеллекте быстро расширяется по всему технологическому миру. Каждую неделю мы видим новые модели, новые возможности и новые приложения. Но наряду с этим быстрым прогрессом возникает другой вопрос: как мы можем проверить результаты, произведенные системами ИИ?

Искусственный интеллект может анализировать огромные объемы данных, генерировать инсайты и автоматизировать процессы быстрее, чем когда-либо прежде. Однако скорость сама по себе не гарантирует надежность. Поскольку ИИ интегрируется в критические системы, обеспечение доверия к результатам становится все более важным.

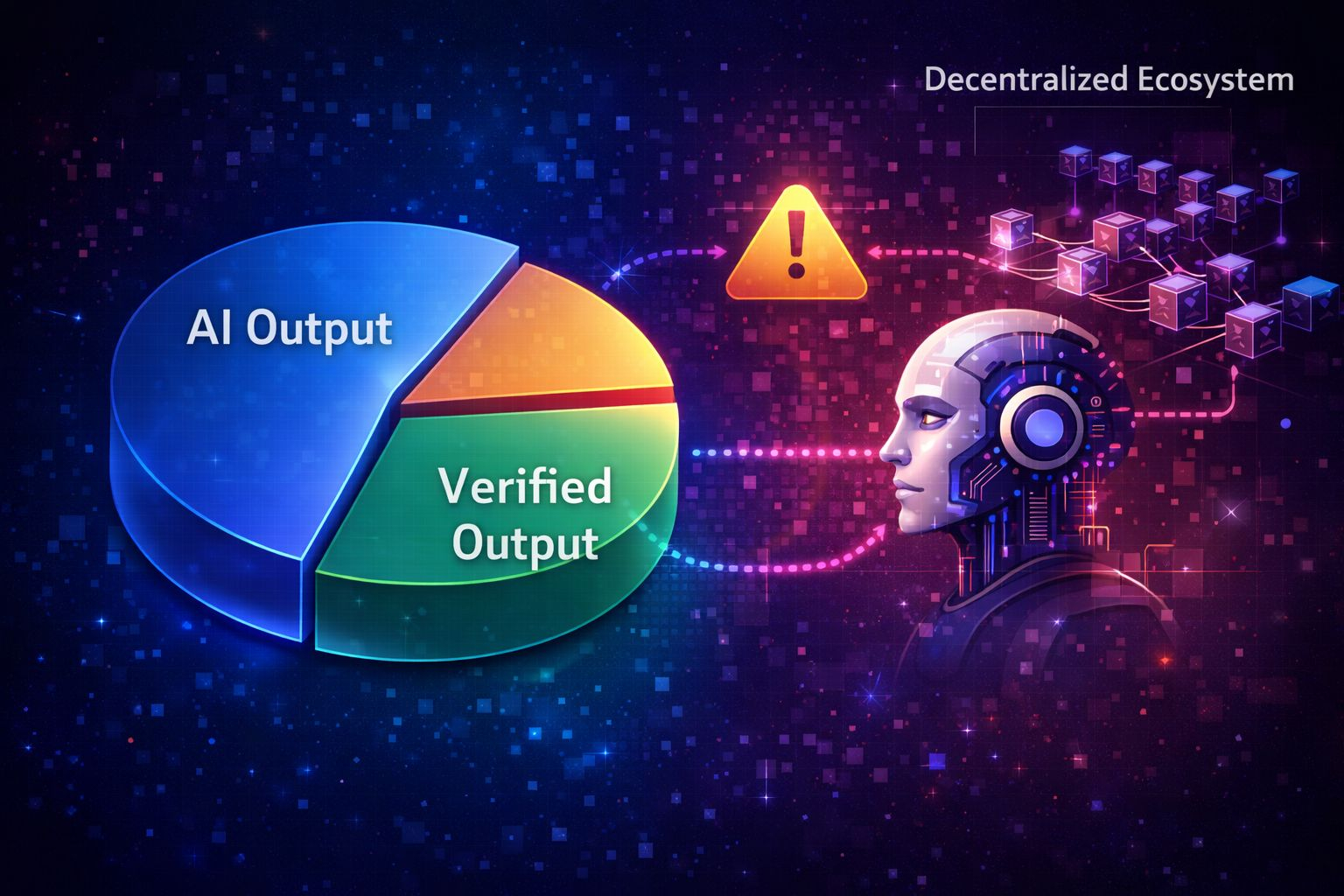

Эта задача становится еще более сложной в децентрализованных экосистемах. В традиционных централизованных платформах пользователи часто полагаются на доверие к компаниям, управляющим системой. Но в средах Web3 доверие должно исходить от прозрачных механизмов, а не от централизованной власти.

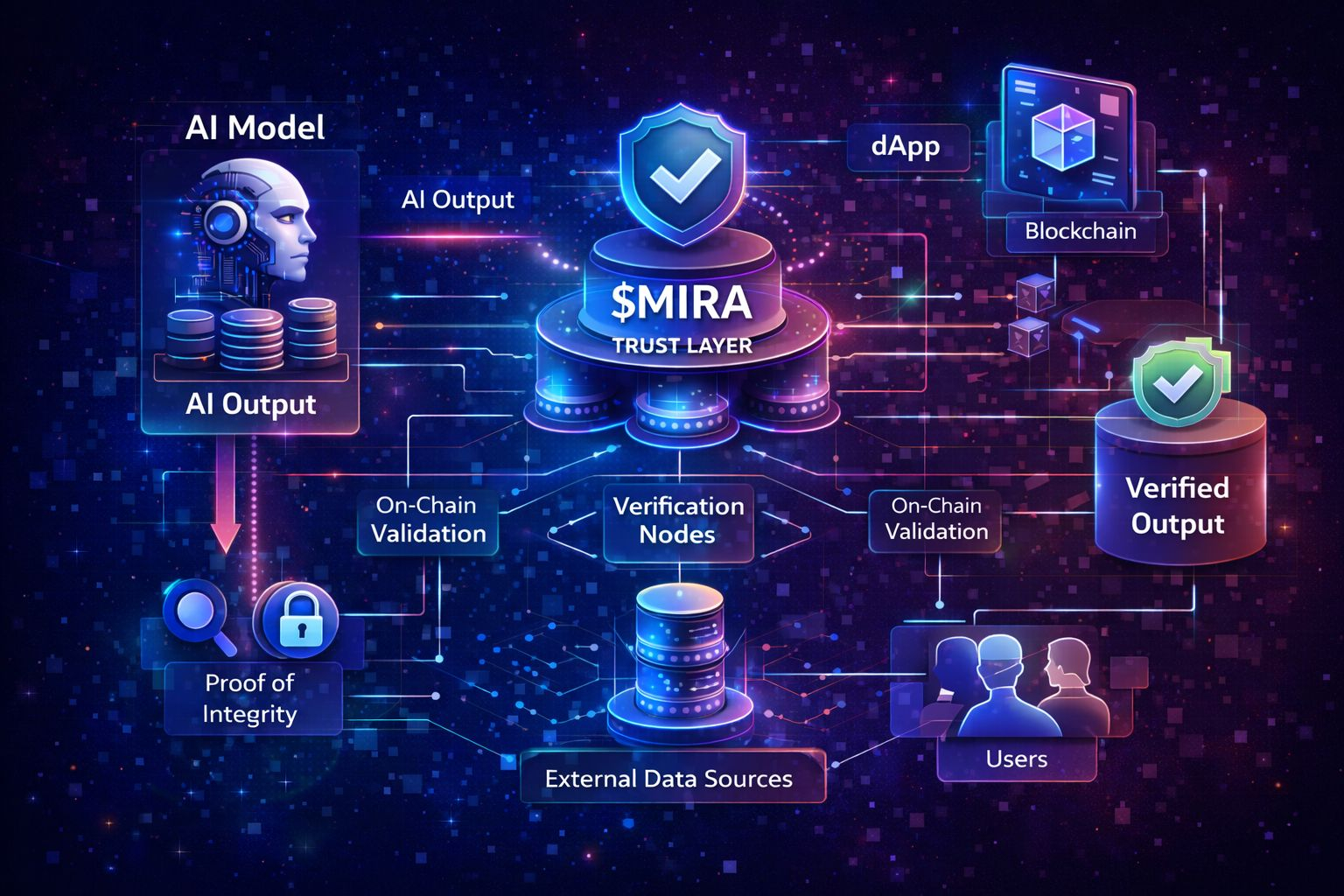

Это одна из причин, почему проекты, исследующие инфраструктуру верификации, привлекают внимание. В процессе исследования различных подходов я начал глубже изучать идею, стоящую за @mira_network, и как $MIRA намерена исследовать концепцию слоя доверия для ИИ.

Идея интересна, потому что результаты ИИ часто трудно быстро проверить. Модель ИИ может дать ответ за секунды, но проверка этого ответа может потребовать времени, экспертизы и доступа к надежным источникам данных. Этот дисбаланс между генерацией и верификацией создает потенциальные проблемы с увеличением принятия ИИ.

Если децентрализованные приложения начнут полагаться на идеи, основанные на ИИ, должны существовать системы, которые подтверждают, что эти идеи соответствуют стандартам надежности. Слои верификации могут помочь обеспечить прозрачность и уверенность, когда системы ИИ взаимодействуют с приложениями на базе блокчейна.

Еще одна причина, почему эта тема важна, заключается в растущем пересечении между ИИ и Web3. Блокчейн-сети уже используются для финансовых систем, цифрового владения, механизмов управления и распределенной инфраструктуры. Поскольку инструменты ИИ интегрируются с этими средами, обеспечение надежных результатов становится критическим фактором.

Проекты, такие как @mira_network, исследуют, как децентрализованная инфраструктура может поддержать процессы верификации ИИ. Концепция, стоящая за $MIRA , сосредоточена на создании рамок, которые позволяют результатам ИИ быть валидированными, а не слепо принятыми.

Этот подход потенциально может помочь укрепить надежность приложений на базе ИИ в экосистемах Web3. Будь то в анализе данных, децентрализованном управлении или автоматизированных процессах, механизмы верификации могут предоставить дополнительную уверенность для пользователей, взаимодействующих с системами ИИ.

Во время кампании #Mira наблюдать за реакцией сообщества на эти идеи было довольно интересно. Периоды кампании часто привлекают новых участников, которые начинают исследовать видение проекта и обсуждать более широкие последствия верификации ИИ.

Во многих отношениях следующий этап развития ИИ может сосредоточиться не только на интеллекте, но и на надежности. Системы, способные генерировать мощные идеи, также должны предоставлять способы для валидации этих идей.

Вот почему обсуждения вокруг слоев доверия, рамок верификации и децентрализованной инфраструктуры ИИ становятся все более важными.

Наблюдение за тем, как эти идеи развиваются вокруг @mira_network и $MIRA , предоставляет интересный взгляд на то, как сообщество Web3 думает о будущих отношениях между ИИ и доверием.