*Момент, когда ответ AI заставил меня задуматься*

Сегодня я просматривал дашборд DeFi, обсуждая некоторые кампании CreatorPad на Binance Square. Я попросил AI-ассистента подвести итоги активности ликвидности по нескольким пулам, за которыми я следил. Ответ на первый взгляд выглядел прекрасно. Структурированный анализ, четкое обоснование, даже небольшой прогноз о том, куда может двигаться ликвидность дальше. Затем я проверил сырые данные. Одно из предположений, которое сделал AI, было немного неверным. Не драматически неверным, но достаточно, чтобы его вывод о направлении рынка не совсем подтвердился. Этот момент напомнил мне о чем-то неприятном в системах AI: они невероятно хорошо производят ответы, которые звучат надежно, даже когда логика, стоящая за ними, не идеальна. И именно это проблема, которую, похоже, пытается решить Mira. Реальная проблема доверия за выводами AI. В криптовалюте мы много говорим о децентрализации и минимизации доверия. Блокчейны решили проблему транзакций, заменив доверие на распределенный консенсус. Но системы AI все еще в основном работают в среде с высокой степенью доверия. Когда модель генерирует информацию — анализ, рекомендацию или резюме — пользователи обычно доверяют этому выводу без какой-либо процедуры проверки. В централизованных системах компания, управляющая моделью, выступает в роли авторитета, стоящего за этим доверием. Как только AI начинает взаимодействовать с децентрализованными системами, ситуация становится более сложной. Представьте себе AI-агентов, анализирующих DeFi-рынки, подводящих итоги предложений по управлению или генерирующих сигналы для автоматизированных торговых стратегий. Если эти выводы неверны, последствия могут затронуть децентрализованные приложения. Вот где архитектура Mira становится интересной. Вместо того чтобы предполагать, что выводы AI надежны, она вводит слой проверки между генерацией и доверием.

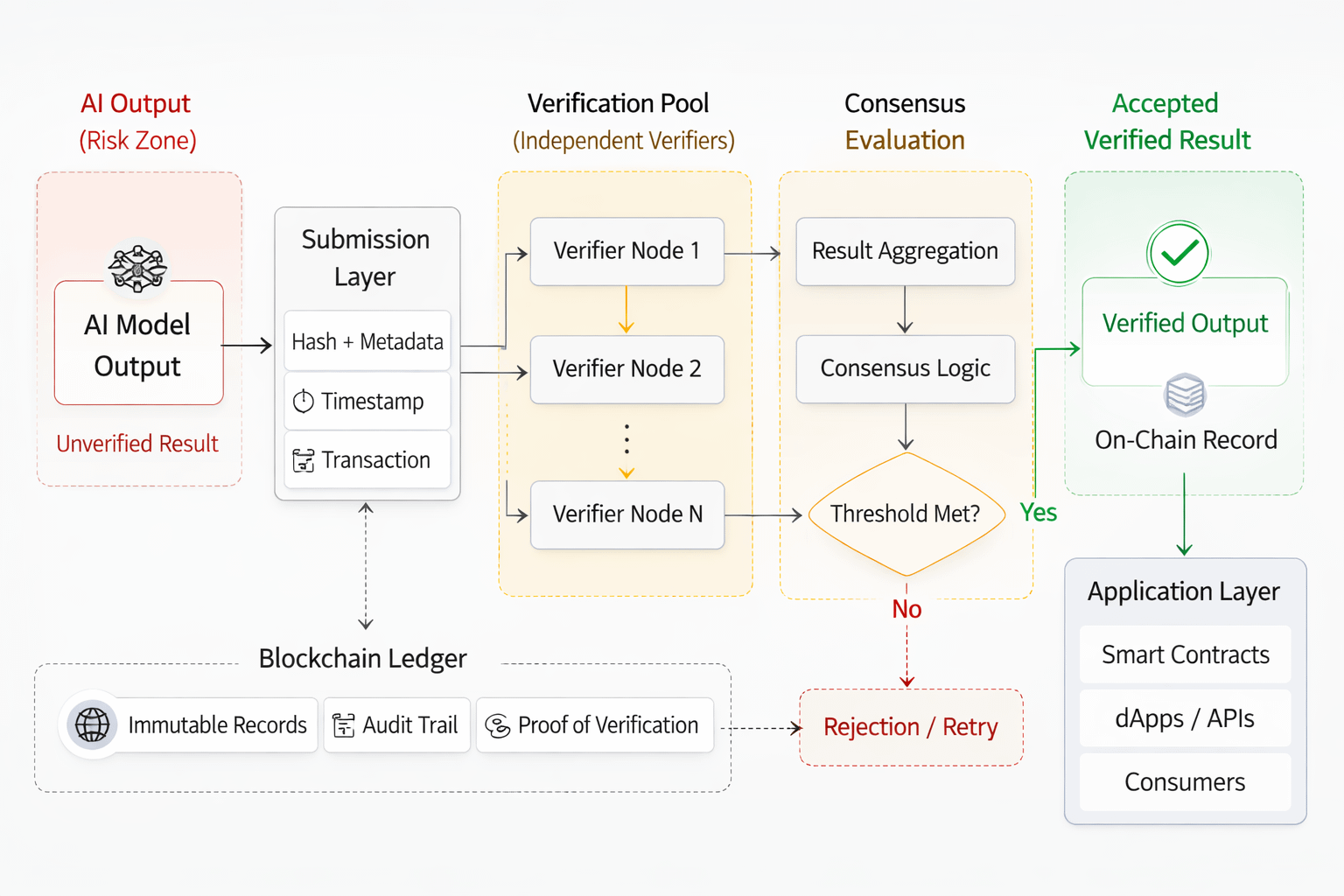

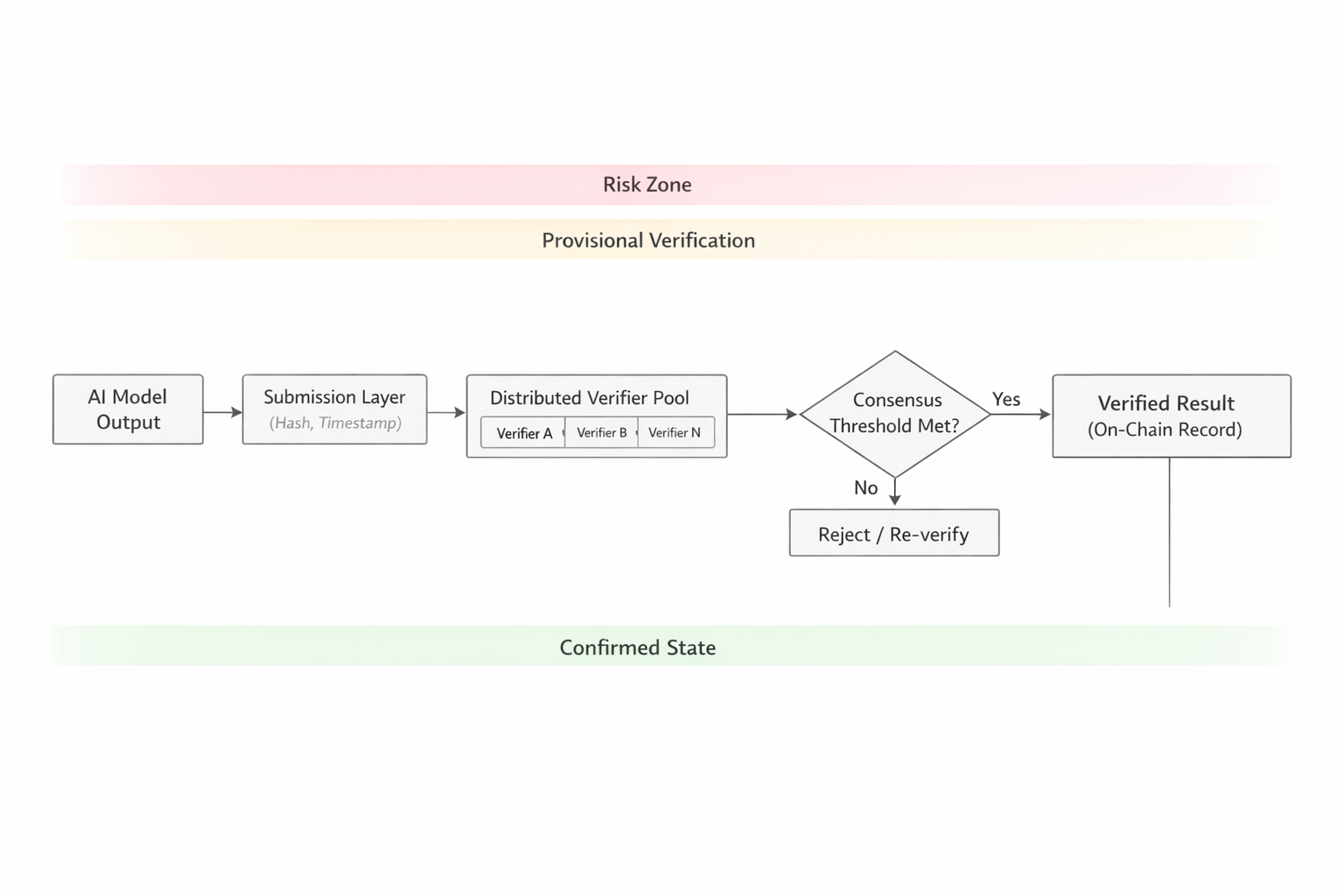

Основной механизм Mira: разделение вывода от принятия. Читая посты CreatorPad и углубляясь в ссылки на документацию, поделенные в темах Binance Square, система Mira работает, разделяя процесс на два этапа. Первый этап прост: модели ИИ производят выходные данные.. Но эти выходные данные не принимаются немедленно сетью. Вместо этого они проходят фазу проверки, где независимые участники оценивают результат, прежде чем он станет надежной информацией. Поток выглядит примерно так:

AI Output → Проверка Раунда → Соглашение Удостоверителей → Принятый Результат

Изучая дизайн, я на самом деле нарисовал небольшую диаграмму рабочего процесса, чтобы понять это. Структура напомнила мне пайплайны валидации блокчейна, за исключением того, что сеть проверяет информацию, а не транзакции. Этот небольшой сдвиг в дизайне может оказаться довольно значительным. Превращение проверки в децентрализованную сеть. Одной из деталей, которая выделяется в модели Mira, является зависимость от нескольких независимых удостоверителей. Вместо того чтобы доверять одному единственному субъекту для оценки выходных данных ИИ, сеть распределяет эту ответственность между участниками. Каждый удостоверитель проверяет выходные данные и подает оценку. Если достаточно участников согласны с тем, что информация действительна, сеть принимает ее. Если нет, выходные данные отклоняются или помечаются. По сути, Mira применяет тот же принцип, который защищает блокчейны — распределенный консенсус — к оценке информации, сгенерированной машинами. И этот подход может значительно снизить слепое доверие к выходным данным ИИ. Где это может иметь значение в реальных приложениях. Читая обсуждения кампаний CreatorPad, я все время думал о агентах ИИ, работающих внутри систем DeFi. Некоторые протоколы уже экспериментируют с инструментами аналитики, управляемыми ИИ, которые рекомендуют распределение портфеля или стратегии ликвидности. Если эти инструменты производят неправильные рассуждения, пользователи могут принимать финансовые решения на основе ошибочной информации. С уровнем проверки Mira эти выходные данные могут быть оценены несколькими участниками, прежде чем они повлияют на приложения. Вместо того чтобы доверять модели напрямую, сеть подтверждает, выдерживают ли рассуждения проверку. Этот дополнительный шаг может показаться незначительным, но в финансовых системах он может значительно снизить риск. Экономическая сторона доверия. Еще один аспект дизайна Mira, который привлек мое внимание, это модель вознаграждений. Участники, которые проверяют выходные данные ИИ, не просто выполняют техническую задачу. Они получают экономическое вознаграждение за точные оценки. Это создает систему, в которой само доверие становится сетевой услугой. Разработчики ИИ генерируют информацию. Удостоверители оценивают эту информацию. Приложения используют проверенные результаты. Некоторые участники CreatorPad начали называть эту структуру экономикой проверки, где валидация знаний, сгенерированных машинами, становится продуктивной деятельностью. Если контент, сгенерированный ИИ, продолжит расширяться по экосистемам Web3, такой экономический слой может стать неожиданно ценным.

Системные задачи, которые необходимо решить. Конечно, архитектура поднимает несколько важных вопросов. Проверка не всегда бывает простой. Некоторые выходные данные ИИ связаны с фактическими утверждениями, которые можно легко проверить, но другие требуют рассуждений или интерпретации. Протокол должен иметь надежные оценочные рамки, чтобы направлять удостоверителей. Скорость — еще одна проблема. Приложения ИИ часто работают быстро, в то время как слои проверки вводят дополнительные шаги перед тем, как результаты будут приняты. Существует также риск проблем с координацией, если удостоверители просто копируют ответы друг друга, вместо того чтобы проводить независимые оценки. Это сложные дизайнерские задачи, но они также похожи на проблемы координации, с которыми сталкивались ранние сети блокчейна при создании систем консенсуса. Почему Mira продолжает появляться в обсуждениях CreatorPad. Проведя время, читая посты кампаний CreatorPad на Binance Square, я заметил, что обсуждения Mira часто углубляются глубже, чем типичные разговоры о токенах. Люди не просто спрашивают о ценовых показателях. Они обсуждают, как децентрализованные системы могут проверять информацию, сгенерированную ИИ, в масштабах. Это совершенно другой тип разговора.. Более широкий вопрос о дизайне Mira. Блокчейны преобразовали финансовые системы, устранив необходимость доверять централизованным посредникам. Однако системы ИИ по-прежнему сильно полагаются на доверие. Пользователи доверяют поставщику модели, обучающим данным и инфраструктуре, производящей выходные данные. Архитектура Mira намекает на другую возможность. Вместо того чтобы слепо доверять ИИ, сети могли бы коллективно проверять информацию, сгенерированную машинами, прежде чем принять ее. Если ИИ продолжит интегрироваться в децентрализованные экосистемы — от аналитики DeFi до инструментов управления — такой уровень проверки может стать необходимым. А если это произойдет, такие проекты, как Mira, не будут просто экспериментами с ИИ. Они могут стать частью инфраструктуры, которая определяет, как работает доверие в эпоху знаний, сгенерированных машинами.

$ARIA $UAI $MIRA #Mira @Mira - Trust Layer of AI

#creatorpad #LearnWithFatima

#TrendingTopic #Market_Update