Вчера смотрела интервью и все время отвлекалась на серьги у ведущей. Алмазы блестели так, что было сложно слушать разговор — глаза все время возвращались к ним.

И я вдруг подумала — интересно, они настоящие или нет.

Потому что на глаз это почти невозможно понять.

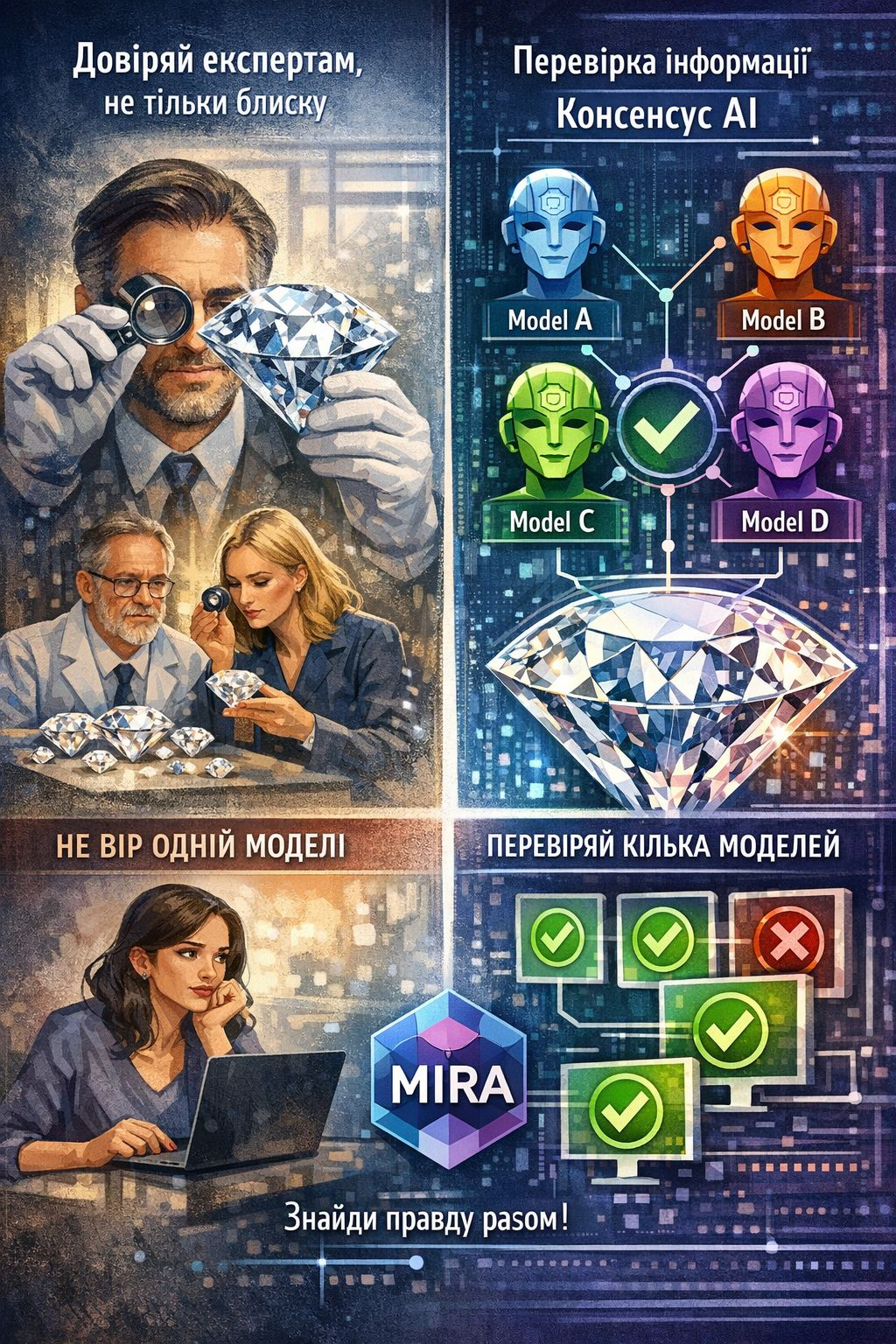

Есть такая штука в мире алмазов. Смотришь на камень — блестящий, красивый. Настоящий? Подделка? Сам не отличишь. Поэтому несешь к экспертам. Не к одному — к нескольким. И если все говорят "да, это алмаз" — тогда веришь.

@Mira - Trust Layer of AI напоминает этот принцип. Только тут вместо алмазов — информация. А проблема та же. ИИ умеет создавать красивые ответы, которые выглядят как правда. Блестящие. Убедительные. Но действительно ли они настоящие?

Сама не отличишь. Потому что ИИ лжёт уверенно. Галлюцинирует с деталями. Выдумывает факты так натурально, что кажется — он точно знает.

И вот #Mira говорит — стоп. Не слушай одну модель. Дай проверить другим. Три модели, четыре, пять — пусть каждая скажет своё. А потом смотри, где консенсус.

Звучит просто. Но знаете, что самое странное? Мы этого не делали. Все эти годы ИИ — мы просто спрашивали одну модель и верили. Потому что она же умная, так? Обученная на терабайтах данных. Должна же знать.

Ага. Как должна.

А на самом деле каждая модель имеет свои диковинки. Свои слабые места. Свои галлюцинации. И если спрашиваешь только одну — попадаешь именно в её слабое место и даже не понимаешь.

$MIRA монетизирует то, что должно быть очевидным с самого начала — проверку. Платишь токенами, чтобы несколько независимых моделей посмотрели на одно и то же. И сказали — согласны или нет.

Это дорого. Да. Потому что каждая модель — это вычисления. Каждая проверка — это ресурсы. Но знаете, что дороже? Ошибка. Когда ИИ точно говорит тебе что-то неправильное, и ты принимаешь решение на основе этого.

Я думала об этом, когда впервые попробовала Mira. Задала вопрос одной модели — получила ответ. Задала через @Mira - Trust Layer of AI — получила консенсус трех моделей. И знаете что? Одна модель ошиблась. Сказала факт, который не подтвердился. Если бы я слушала только её — поверила бы во лжь.

Но две другие поймали ошибку. Консенсус был другой. Правильный.

И вот сижу я и думаю — сколько раз раньше я верила одной модели? Сколько ошибок я не заметила, потому что не было с чем сравнить?

Это как лететь на самолете с одним двигателем. Работает — прекрасно. Ломается — падаешь. Поэтому самолеты имеют несколько двигателей. Резервирование. Безопасность.

@Mira - Trust Layer of AI делает что-то похожее на резервирование для ИИ. Не один "двигатель истины", а несколько разных моделей, которые проверяют друг друга. Если одна глючит — другие могут это заметить.

Но есть нюанс. Консенсус — это не гарантия правды. Это только гарантия, что большинство моделей согласны. А если все модели обучены на одних и тех же неправильных данных? Они все будут согласны. Но все неправильные.

Mira об этом честно говорит. Они не обещают абсолютную истину. Они показывают, где модели согласны, а где расходятся. А уже ты сама решай — доверять консенсусу или нет.

Это честнее, чем "наш ИИ самый умный и никогда не ошибается". Потому что все ошибаются. Вопрос только — как часто и насколько критично.

И вот здесь я понимаю, зачем @Mira - Trust Layer of AI нужна. Не потому, что она делает ИИ идеальным. А потому, что она делает ошибки ИИ заметными. Когда видишь, что три модели сказали одно, а четвертая другое — ты по крайней мере знаешь, что есть разночтение. Можешь покопать глубже. Проверить самой.

А когда спрашиваешь одну модель — ты даже не знаешь, что нужно проверять. Она сказала — ты поверила — пошла дальше. И только потом, может, окажется, что это была галлюцинация.

$MIRA платишь за то, чтобы знать, где сомневаться. Где копать глубже. Где не доверять слепо.

Это не гарантия истины. Это карта, где возможны ловушки.

И знаете что? Может, это всё, что нам нужно от ИИ. Не идеальная истина. А честное предупреждение, где она под сомнением.

Mira не претендует на роль оракула. Они просто показывают — вот где модели согласны, вот где нет. Дальше решение за человеком.

Алмазы проверяют несколько экспертов, потому что дорогие. Информация тоже дорога. Особенно когда на ее основе принимаешь важные решения.

Поэтому @Mira - Trust Layer of AI .

Поэтому $MIRA.

Поэтому консенсус вместо слепой веры.

И всё же мне интересно — вы доверяете первому ответу ИИ или все-таки проверили бы его через Mira?

#Mira @Mira - Trust Layer of AI $MIRA