Большие языковые модели могут писать стихи, писать код, но часто терпят неудачи в начальной математике? Эта проблема наконец-то решена.

Недавно увидел удивительный трюк: исследователь умудрился без потерь (Losslessly) "жестко закодировать" интерпретатор WASM (WebAssembly) в веса модели Transformer!

Это не просто "модель будет использовать инструменты", это фактически запуск настоящего компьютера внутри LLM.

💡 Основная логика: гибридная архитектура, подобная DSP-чипам, как архитектура DSP от TI:

Нейронные сети (ARM): отвечают за логическое рассуждение, семантическое понимание и организацию языка.

Встроенный интерпретатор (DSP): специально предназначен для высокоточных, высокоскоростных детерминированных вычислений.

Когда LLM сталкивается с вопросом, кто больше, 3.11 или 3.8, он больше не полагается на "интуицию" для угадывания следующего токена, а напрямую вызывает внутренний вычислительный движок.

🚀Почему это важно?

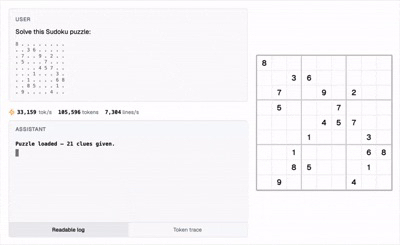

100% точность: даже самые сложные судоку можно решить за секунды, полностью устраняя иллюзии вычислений.

Миллион шагов выполнения: программа может выполнять миллионы шагов внутри модели, производительность взрывоопасна.

Применение во всех областях: физическое моделирование, финансовое моделирование, криптографические вычисления... Эти области с высоким требованием к точности, LLM наконец-то смогли выполнить должным образом.

Это больше не просто "генеративный ИИ", это "родной вычислительный ИИ". Человечество на шаг ближе к настоящему общему искусственному интеллекту (AGI)!

#AI #LLM #WebAssembly #Transformer #DeepLearning #AGI