Я помню, как несколько лет назад проходил через офис логистики среднего размера, наблюдая, как две команды спорят из-за отправки, которой технически не существовало. На одном экране посылка уже прошла таможню. На другом она все еще была помечена как “ожидание верификации.” Обе системы были “корректными” в своем контексте. У обеих были временные метки, подписи и записи. И все же ни одна из них не могла убедительно доказать другой, что её версия реальности была той, которой стоит доверять.

Меня поразило не само сообщение об ошибке. Ошибки случаются. Это было тихое предположение, которое лежало в основе всего, что верификация локальна, фрагментарна и постоянно повторяется. Каждая система пыталась восстановить доверие с нуля, снова и снова. Это не было провалом перемещения данных. Данные были там, быстро перемещаясь между системами. Это была неудача в соглашении.

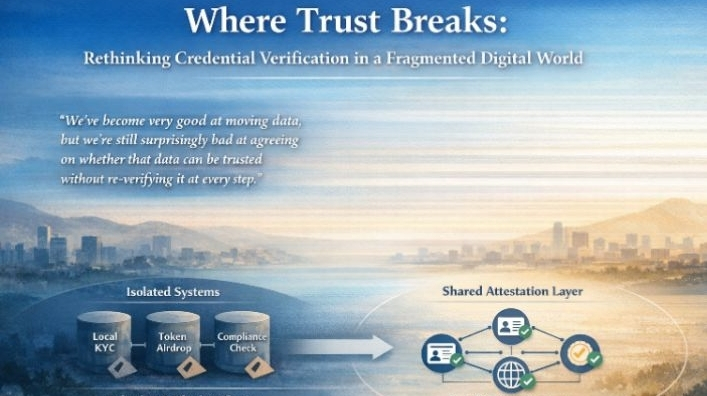

Со временем я начал замечать, что этот шаблон повторяется в разных отраслях. Финансовые системы, медицинские записи, платформы идентификации, даже механизмы распределения токенов в криптостране страдают от одной и той же структурной проблемы. Мы стали очень хороши в перемещении данных, но по-прежнему удивительно плохи в том, чтобы согласовать, можно ли доверять этим данным без повторной проверки на каждом шаге.

Проверка учетных данных — хороший пример. Будь то доказательство идентичности, подтверждение права на аирдроп токенов или подтверждение соблюдения норм в регулируемой среде, процесс обычно бывает избыточным и изолированным. Одна платформа проверяет пользователя, другая повторяет тот же процесс, а третья может даже не признать предыдущую проверку. Каждая система функционирует как остров, с собственными правилами и предположениями.

Распределение токенов, особенно в крипто, еще более явно выставляет эту слабость. Я видел проекты, которые сталкиваются с трудностями при проведении аирдропов, не потому что они не могли распределить токены, а потому что не могли уверенно определить, кто их должен получить. Атаки Сибила, дублирующие идентичности, непоследовательные критерии соответствия — это больше не крайние случаи. Это норма. И большинство решений в конечном итоге накладывает больше проверок, больше баз данных, больше трения, вместо того чтобы решать основную проблему координации.

Вот в таком контексте я начал обращать внимание на проекты, пытающиеся переосмыслить инфраструктуру проверки на более фундаментальном уровне. Не как функцию приложения, а как общий слой, на который могут полагаться несколько систем. Одной из таких попыток является проект, позиционирующий себя как своего рода глобальная инфраструктура для проверки учетных данных и распределения токенов.

Я не вижу этого как законченного решения. Это больше похоже на эксперимент — попытку ответить на трудный вопрос: как бы это выглядело, если бы сама проверка стала переносимой, многоразовой и последовательно интерпретируемой между системами?

В своей основе идея относительно проста, даже если реализация таковой не является. Вместо того чтобы каждая платформа независимо проверяла учетные данные и хранила свои изолированные записи, система вводит общий слой аттестации. В этой модели информация — скажем, что пользователь прошел проверку KYC или имеет право на конкретное распределение токенов — записывается как аттестация. Эта аттестация затем может быть ссылкой, повторно использована и проверена другими системами без необходимости повторять весь процесс проверки.

Я начал воспринимать это меньше как базу данных и больше как механизм координации. Цель состоит не только в хранении информации, но и в создании общей отправной точки, на которую разные участники могут полагаться. Если несколько систем могут согласовать действительность аттестации, тогда необходимость в избыточной проверке начинает уменьшаться.

Это становится особенно актуальным в распределении токенов. Вместо того чтобы каждому проекту строить свою собственную логику соответствия и проверочный процесс, они могли бы, в теории, полагаться на существующие аттестации. История участия пользователя, проверка идентичности или вклад могут быть представлены как набор проверяемых утверждений. Распределение становится меньше вопросом догадок и больше вопросом ссылок.

Что делает этот подход интересным для меня, так это то, что он не пытается полностью устранить сложность. Он признает, что разные системы все равно будут иметь разные требования и предположения о доверии. Но он пытается стандартизировать, как эти предположения выражаются и делятся.

Также есть тонкий сдвиг в том, как рассматривается идентичность. Вместо того чтобы быть статическим профилем, хранящимся в одной системе, идентичность становится чем-то более близким к коллекции аттестаций — модульной, составной и зависящей от контекста. Это больше соответствует тому, как доверие на самом деле работает в реальном мире. Мы не полагаемся на одну учетную запись для всего. Мы полагаемся на сеть сигналов, каждый из которых несет определенный вес в зависимости от контекста.

На практике это может снизить трение в областях, где проверка в настоящее время является узким местом. Процессы адаптации могут стать быстрее, если предыдущие аттестации будут признаны. Распределение токенов может стать более целенаправленным и менее подверженным злоупотреблениям. Даже среды с высоким уровнем соблюдения могут получить выгоду от наличия общего, подлежащего аудиту слоя проверки, а не от наборов внутренних систем.

Тем не менее, я осторожен в том, насколько далеко это может зайти.

Самая большая проблема не техническая. Это координация. Чтобы общий слой аттестации работал, несколько независимых участников должны согласовать не только формат данных, но и их значение и действительность. Это не то, что технология может обеспечить сама по себе. Это требует согласования стимулов, стандартов и, в некоторой степени, управления.

Я видел подобные идеи, которые сталкивались с трудностями в прошлом. Системы идентификации, которые обещали переносимость, в конечном итоге оказались фрагментированными, потому что разные платформы не доверяли аттестациям друг друга. Инициативы по обмену данными застряли, потому что участники не хотели полагаться на внешние источники истины. Даже в крипто, где межоперабельность часто подчеркивается, неудачи в координации обычны.

Также возникает вопрос опор доверия. Кто выдает аттестации? Почему другие должны им доверять? Если система становится слишком централизованной вокруг нескольких ключевых эмитентов, это рискует воспроизвести те самые проблемы, которые она пытается решить. Если она слишком децентрализована, может стать сложно оценить качество и надежность аттестаций.

Производительность и масштабируемость — еще одна проблема. Системы проверки часто работают в условиях временных ограничений. Если ссылки или проверка аттестаций вводят задержки или сложность, принятие может пострадать. Во многих случаях организации выберут менее элегантную, но более предсказуемую внутреннюю систему вместо общего инфраструктурного решения, которое добавляет неопределенности.

И затем есть человеческий фактор. Такие системы предполагают, что участники будут действовать таким образом, чтобы это соответствовало более широкой цели повторного доверия. Но на практике стимулы могут быть несогласованными. Некоторые участники получают выгоду от сохранения своих данных в изоляции. Другие могут использовать систему, выдавая низкокачественные или вводящие в заблуждение аттестации. Проектирование механизмов для смягчения этих действий — это нетривиальная задача.

Несмотря на эти опасения, я думаю, что направление стоит внимания. Идея рассматривать проверку как инфраструктуру, а не как функцию уровня приложения, решает реальную и постоянную проблему. Это смещает акцент с построения лучших отдельных систем на улучшение того, как системы взаимодействуют.

С точки зрения реальных последствий, я вижу это как актуальное в областях, где координация между сущностями неизбежна. Международные финансы — очевидный пример, где соблюдение и проверка идентичности являются критическими и фрагментированными. Цепочки поставок, где несколько сторон должны согласовать статус и подлинность товаров, также могут получить выгоду. Даже новые области, такие как децентрализованные робототехнические системы или экономики между машинами, могут потребовать общего слоя проверяемых учетных данных для надежного функционирования.

Что я нахожу наиболее интересным, так это то, что, если что-то подобное сработает, это не будет особенно заметно. Это не будет ощущаться как момент прорыва. Не будет единой точки, где все внезапно изменится. Вместо этого процессы, которые раньше были медленными и повторяющимися, станут немного более плавными. Системы, которые раньше не соглашались, начнут чаще согласовываться. Трение уменьшится, почти незаметно.

Вот так обычно развивается значительная инфраструктура. Не через драматические изменения, а через постепенные улучшения, которые накапливаются с течением времени.

Я не знаю, сработает ли этот конкретный подход. Слишком много переменных — технических, социальных, экономических, чтобы делать уверенные прогнозы. Но проблема, которую он пытается решить, реальна, и она не исчезнет. По мере того как больше систем становятся взаимосвязанными, стоимость фрагментированной проверки только увеличится.

Если здесь есть какой-либо показатель успеха, то это будет не в том, как широко говорят о системе, а в том, насколько мало людям нужно думать о проверке вообще. Если это сработает, это будет ощущаться не как новый слой, а скорее как что-то, что всегда должно было быть там, тихо удерживая все вместе на заднем плане.

@SignOfficial #SignDigitalSovereignInfra $SIGN