Tháng trước, tôi đã ngồi với một người lãnh đạo hoạt động fintech, người đã kể cho tôi một câu chuyện mà tôi không thể quên. Nhóm của anh ấy đã triển khai một đại lý hỗ trợ khách hàng AI để xử lý các câu hỏi về đủ điều kiện vay. Mô hình hoạt động tốt trong thử nghiệm, nhưng chỉ sau một tuần, nó đã đưa ra hướng dẫn sai cho hàng chục người dùng. Nó đã nhầm lẫn các quy tắc chính sách, phát biểu sai tiêu chí phê duyệt, và tạo ra các rủi ro tuân thủ mà mất vài ngày để sửa chữa. Nhóm đã vội vàng triển khai AI nhưng quên một điều quan trọng. Họ không có một lớp kiểm soát nhất quán để giữ cho mô hình phù hợp với các quy tắc thực tế. Khoảng trống nhỏ đó đã biến hiệu quả thành hỗn loạn. Nó khiến tôi tự hỏi, khi mỗi ngành công nghiệp đều dấn thân vào AI tự động, ai sẽ xây dựng các hàng rào bảo vệ giữ cho kết quả an toàn và đáng tin cậy?

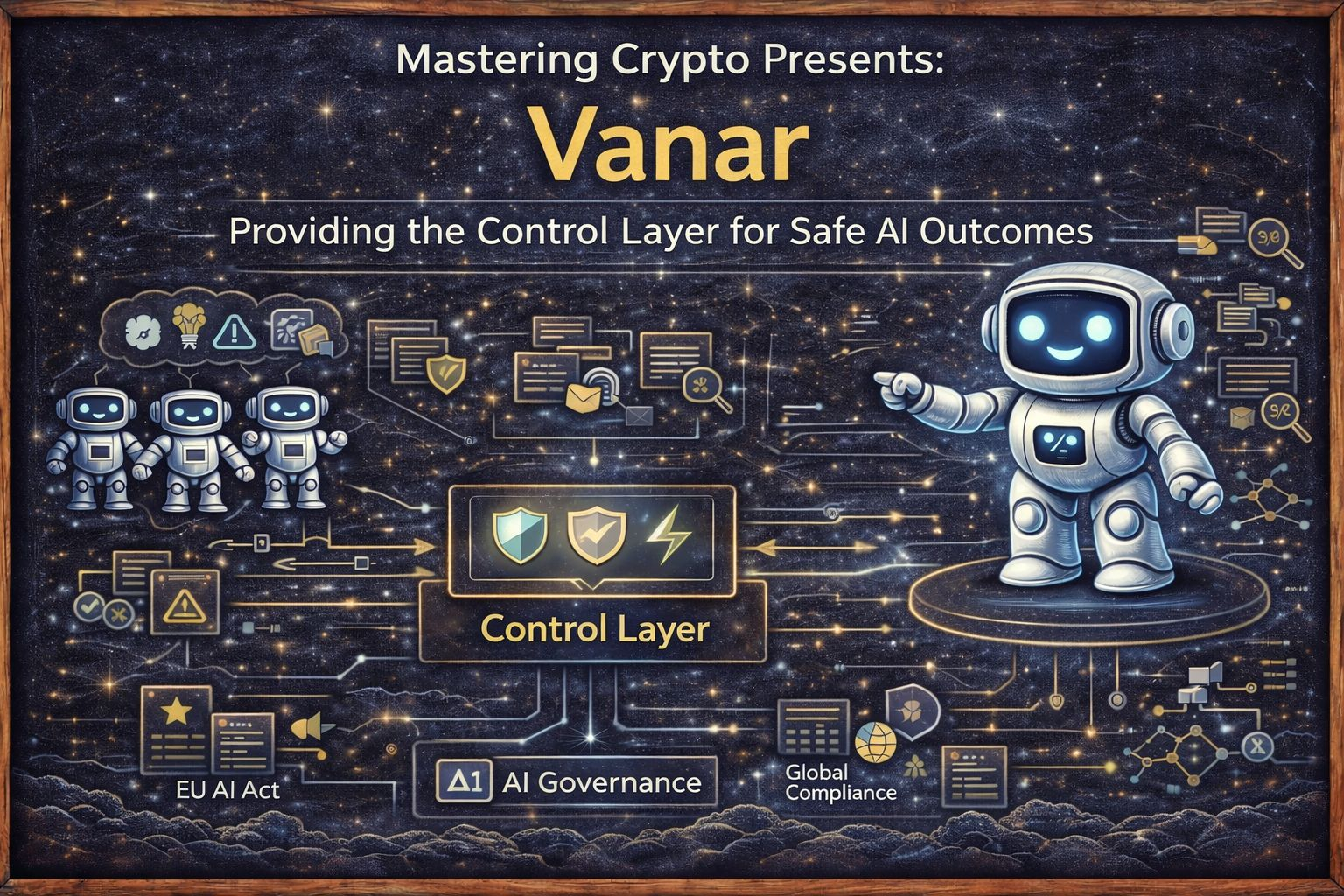

Câu hỏi đó đưa chúng ta đến Vanar, một nền tảng được xây dựng để cung cấp một lớp kiểm soát dành riêng cho các hệ thống AI. Nó không phải là một bộ lọc bổ sung hay một kiểm tra sau khi triển khai. Nó là một lớp nền tảng nằm giữa các mô hình AI và các hành động trong thế giới thực. Công nghệ được gắn rễ trong hạ tầng blockchain mô-đun gốc AI của Vanar, kết hợp với hệ thống trí nhớ ngữ nghĩa Neutron của nó. Sự kết hợp này cho phép các nhóm xác định, thực thi và kiểm toán các quy tắc tại điểm thực thi.

Vanar hoạt động bằng cách nhúng quản trị trực tiếp vào quy trình làm việc của AI. Hệ thống Neutron lưu trữ ngữ cảnh và lịch sử quyết định trong định dạng có thể xác minh, vì vậy các tác nhân luôn dựa vào dữ liệu chính xác và giảm thiểu ảo giác. Các quy tắc tùy chỉnh chuyển đổi các chính sách nội bộ và yêu cầu tuân thủ thành logic có thể thực thi hoạt động nhất quán. Mỗi hành động đều được ghi lại và có thể truy nguyên, tạo ra một dấu vết kiểm toán đầy đủ cho các cơ quan quản lý và các nhóm nội bộ. Nó không làm chậm AI hay giới hạn sự sáng tạo. Nó cung cấp cho AI những ranh giới rõ ràng để hoạt động an toàn trở thành mặc định, không phải là kết quả của sự may mắn.

Nhu cầu này về kiểm soát tích hợp phù hợp với một sự chuyển mình lớn trong ngành. Vào năm 2026, các công ty không chỉ đua nhau để áp dụng AI. Họ đang đua nhau để quản lý nó. Các khuôn khổ quy định như Đạo luật AI của EU yêu cầu tính minh bạch và trách nhiệm. Các nhóm an ninh doanh nghiệp ưu tiên giám sát thời gian thực, kiểm soát truy cập và giám sát hành vi của tác nhân. Nghiên cứu thị trường cho thấy rằng các công ty có các lớp kiểm soát AI chuyên dụng giảm thiểu sự cố tuân thủ và xây dựng niềm tin khách hàng mạnh mẽ hơn. Vanar ngồi ở giao điểm này của tốc độ AI và quản trị, kết hợp trách nhiệm theo phong cách blockchain với tính linh hoạt gốc AI để phù hợp với nhu cầu doanh nghiệp hiện đại.

Từ kinh nghiệm của tôi khi làm việc với các triển khai AI, sự cân bằng này quan trọng hơn bất kỳ tính năng nào. Tôi đã thấy các nhóm kiểm soát AI quá mức cho đến khi nó trở nên vô dụng, và tôi đã thấy các nhóm triển khai mà không có các rào cản và phải đối mặt với những sai lầm tốn kém. Vanar nổi bật vì nó gặp gỡ các nhà phát triển tại nơi họ đang đứng. Nó sử dụng các công cụ quen thuộc để thiết lập các quy tắc, cung cấp cái nhìn rõ ràng về các hành động của tác nhân, và mở rộng cùng với việc sử dụng AI ngày càng tăng. Nó tôn trọng rằng AI cần có quyền tự chủ để tạo ra giá trị, nhưng nó đảm bảo rằng quyền tự chủ vẫn nằm trong các giới hạn do con người định nghĩa. Thiết kế thực tiễn, lấy con người làm trung tâm biến một hệ thống kỹ thuật thành một công cụ thúc đẩy kinh doanh.

Không có lớp kiểm soát nào có thể giải quyết mọi rủi ro mãi mãi. AI sẽ trở nên có khả năng hơn, các quy định sẽ phát triển, và các mối đe dọa mới sẽ xuất hiện. Thiết kế mô-đun của Vanar cho phép nó thích ứng mà không cần phải loại bỏ các hệ thống hiện có. Nó hỗ trợ các cập nhật liên tục cho các quy tắc, xử lý ngữ cảnh tốt hơn và xác thực mạnh mẽ hơn khi hệ sinh thái trưởng thành.

Nhìn về phía trước, các nhóm AI thành công nhất sẽ là những nhóm kiểm soát mà không giới hạn. Họ sẽ sử dụng các lớp làm cho sự an toàn và tuân thủ trở thành một phần của hoạt động AI hàng ngày. Vanar không chỉ là một công cụ cho các tác nhân AI hiện tại. Nó là nền tảng cho kỷ nguyên tiếp theo của trí tuệ nhân tạo có trách nhiệm, có khả năng mở rộng. Khi chúng ta tiếp tục thúc đẩy AI thực hiện nhiều hơn, lớp kiểm soát sẽ là những gì cho phép chúng ta tin tưởng vào các kết quả. Và sự tin tưởng đó sẽ là điều khiến mọi thứ trong AI đáng giá để xây dựng.