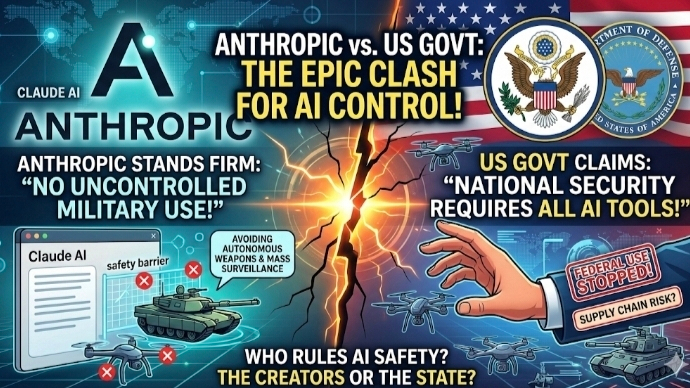

Tôi đã nghiên cứu tình huống này một cách cẩn thận và trong quá trình tìm kiếm, tôi bắt đầu hiểu về mức độ nghiêm trọng của sự xung đột này. Đây không chỉ là một sự bất đồng bình thường giữa một công ty và chính phủ. Nó liên quan đến quyền lực, kiểm soát, an toàn, và tương lai của trí tuệ nhân tạo trong thế giới thực. Công ty liên quan là Anthropic, nhà sản xuất hệ thống AI mang tên Claude. Họ xây dựng các công cụ AI tiên tiến có thể viết, phân tích và hỗ trợ trong các quyết định phức tạp. Chính phủ Hoa Kỳ, đặc biệt là các bộ quốc phòng, cũng muốn sử dụng các hệ thống AI mạnh mẽ cho an ninh quốc gia và mục đích quân sự. Đó là nơi mọi thứ bắt đầu trở nên phức tạp.

Theo những gì tôi hiểu, Anthropic có những quy định nghiêm ngặt về cách sử dụng AI của họ. Họ nói rằng công nghệ của họ không nên được sử dụng cho một số hoạt động quân sự nhất định, đặc biệt là những thứ như vũ khí tự động hoặc giám sát quy mô lớn. Họ tin rằng AI hiện tại không hoàn toàn đáng tin cậy và có thể mắc sai lầm. Nếu những sai lầm đó xảy ra trong các lĩnh vực nhạy cảm như quyết định chiến tranh, kết quả có thể rất nguy hiểm. Tôi bắt đầu biết về điều đó khi tôi đọc cách AI đôi khi đưa ra câu trả lời sai hoặc thể hiện sự thiên lệch. Nếu điều đó xảy ra trong một cuộc trò chuyện đơn giản, thì không sao. Nhưng nếu điều đó xảy ra trong các hoạt động quân sự, nó trở thành một vấn đề nghiêm trọng.

Chính phủ Mỹ nhìn nhận vấn đề khác. Họ tin rằng nếu công nghệ AI có sẵn và hợp pháp, họ nên có thể sử dụng nó cho quốc phòng. Họ lập luận rằng các mối đe dọa an ninh là có thật và các đối thủ trên toàn cầu đang phát triển các hệ thống AI của riêng họ. Trong quan điểm của họ, việc hạn chế quyền truy cập vào các công cụ AI tiên tiến có thể làm suy yếu sức mạnh quốc gia. Họ cảm thấy rằng một công ty tư nhân không nên quyết định những gì chính phủ có thể hoặc không thể làm trong các hoạt động quân sự hợp pháp.

Sự bất đồng này dần dần trở nên lớn hơn. Các báo cáo cho biết chính phủ đã yêu cầu Anthropic cho phép sử dụng quân sự rộng hơn đối với hệ thống AI của họ. Anthropic từ chối gỡ bỏ một số hạn chế nhất định. Họ đã đứng vững với các nguyên tắc an toàn của mình. Vì điều này, căng thẳng đã gia tăng. Cuối cùng, chính phủ đã tiến hành ngăn chặn các cơ quan liên bang sử dụng công nghệ của Anthropic. Quyết định đó đã tạo ra những chấn động trong thế giới công nghệ.

Tôi đã nghiên cứu thêm và tôi phát hiện ra rằng chính phủ thậm chí đã gán nhãn công ty này là một rủi ro chuỗi cung ứng tiềm năng. Đó là một nhãn nghiêm trọng vì nó ảnh hưởng không chỉ đến các hợp đồng trực tiếp của chính phủ mà còn đến các công ty khác làm việc với chính phủ. Nếu họ phụ thuộc vào công nghệ của Anthropic, họ cũng có thể cần phải thay đổi hệ thống của mình. Điều này cho thấy sức mạnh của những quyết định như vậy có thể trở nên lớn đến mức nào.

Từ phía Anthropic, họ nói rằng họ không chống lại việc hỗ trợ an ninh quốc gia. Họ đã làm việc với các cơ quan chính phủ trước đây. Nhưng họ tin rằng phải có những ranh giới rõ ràng. Họ lập luận rằng AI hiện tại không đủ tiên tiến để đưa ra quyết định sống còn mà không có sự kiểm soát mạnh mẽ của con người. Họ muốn tránh việc lạm dụng trong tương lai. Trong quan điểm của họ, phát triển có trách nhiệm quan trọng hơn việc triển khai không giới hạn.

Tôi đã nhận thấy rằng xung đột này thực sự liên quan đến việc ai kiểm soát AI. Có phải là những người sáng tạo ra nó, hay là các chính phủ muốn sử dụng nó? Khi AI trở nên mạnh mẽ hơn, nó sẽ có ảnh hưởng lớn hơn trong quốc phòng, chăm sóc sức khỏe, tài chính và đời sống hàng ngày. Nếu các công ty đặt ra các quy định nghiêm ngặt, chính phủ có thể cảm thấy bị hạn chế. Nếu chính phủ buộc các công ty phải gỡ bỏ các hạn chế, các công ty có thể cảm thấy các giá trị đạo đức của họ đang bị phớt lờ.

Trong quá trình tìm kiếm của tôi, tôi bắt đầu hiểu cách sự kiện này có thể hình thành tương lai của chính sách AI. Các công ty AI khác đang theo dõi một cách chặt chẽ. Họ đang nghĩ về những gì họ sẽ làm nếu gặp phải áp lực tương tự. Các nhà đầu tư cũng đang theo dõi vì những xung đột như vậy có thể ảnh hưởng đến sự phát triển kinh doanh và các mối quan hệ đối tác.

Tình huống này cho thấy rằng trí tuệ nhân tạo không còn chỉ là một công cụ công nghệ. Nó đã trở thành một tài sản chiến lược. Nó kết nối chính trị, đạo đức, kinh tế và an ninh quốc gia. Kết quả của cuộc xung đột này có khả năng ảnh hưởng đến cách các công ty AI và chính phủ làm việc cùng nhau trong tương lai. Nó có thể dẫn đến các luật mới, hợp đồng rõ ràng hơn và các cuộc tranh luận công khai mạnh mẽ hơn về việc AI nên đi xa đến đâu.

Nói một cách đơn giản, đây là một cuộc chiến về trách nhiệm và quyền hạn. Anthropic tin rằng các giới hạn an toàn là cần thiết. Chính phủ tin rằng quyền truy cập vào các công cụ tiên tiến là cần thiết. Cả hai bên đều nghĩ rằng họ đang bảo vệ tương lai. Câu hỏi thực sự là làm thế nào họ tìm được sự cân bằng, vì AI sẽ không ngừng phát triển. Nó sẽ trở nên mạnh mẽ hơn, và những loại xung đột này có thể trở nên phổ biến hơn trong những năm tới.