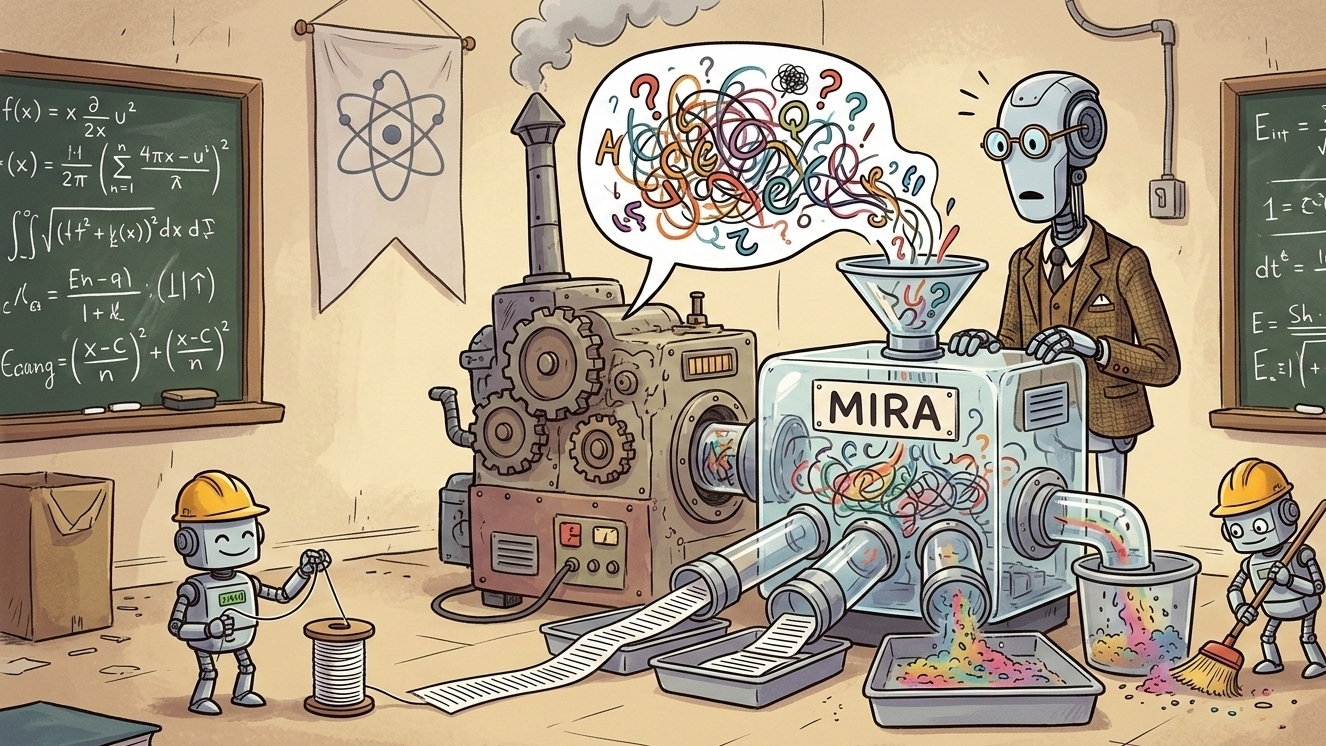

Trong nỗ lực nghiêm túc nhằm đạt được sự rõ ràng trí tuệ, chúng ta phải phân tích sự tinh tế kiến trúc của @mira_network, một dự án coi ảo giác AI không chỉ là một sự bất tiện nhỏ, mà là một thất bại hệ thống cần được giải quyết thông qua sự đồng thuận phân tán. Thách thức cơ bản của học máy hiện đại là tình huống "Hộp Đen": chúng ta nhận được một đầu ra, nhưng chúng ta thiếu một cơ chế phi tập trung để kiểm toán tính xác thực của nó. Mira giải quyết vấn đề này bằng cách triển khai một quy trình xác minh có cấu trúc, nhiều giai đoạn, biến một phản hồi AI đơn lẻ, có thể nghi ngờ thành một sự thật đã được xác thực toán học. Bằng cách neo quy trình này trên token $MIRA , mạng lưới đảm bảo rằng mọi người xác thực đều có "da trong trò chơi," hiệu quả biến tìm kiếm sự thật thành một động lực kinh tế có động lực.

Sự đổi mới chính ở đây là khái niệm "Phân tích yêu cầu." Khi một AI tạo ra một phản hồi, giao thức Mira không chỉ đơn giản hỏi một mô hình thứ hai xem nó "trông ổn không"—một phương pháp sẽ khoa học như việc một sinh viên hỏi bạn cùng phòng của họ để xem xét một luận văn lúc 3:00 AM. Thay vào đó, hệ thống phân tích đầu ra thành "các yêu cầu nguyên tử" hoặc "cặp thực thể-yêu cầu." Những mảnh ghép này sau đó được phân tán và phân phối qua một mạng lưới toàn cầu của các nút xác thực độc lập. Việc phân tán cấu trúc này đảm bảo rằng không có nút nào có đầy đủ ngữ cảnh của yêu cầu của người dùng, từ đó bảo vệ quyền riêng tư dữ liệu trong khi chịu sự kiểm tra độc lập, chéo giữa các mô hình đối với mọi khẳng định thực tế.

Hơn nữa, giai đoạn cuối của quá trình xác thực cấp học thuật này là lớp Đồng thuận Tập hợp. Để một yêu cầu được "xác thực" chính thức và cấp một chứng chỉ mật mã, nó phải vượt qua ngưỡng siêu đa số—thường khoảng 67%. Nếu một yêu cầu không rõ ràng hoặc thiếu bằng chứng đủ, hệ thống được thiết kế để "từ chối một câu trả lời" thay vì ép buộc một ảo tưởng. Sự "im lặng tốn kém" này thực sự là một tính năng, không phải là một lỗi; trong những lĩnh vực có rủi ro cao như y tế hoặc tài chính, biết khi nào một AI không chắc chắn còn giá trị hơn nhiều so với việc nhận được một lời nói dối tự tin. Khi chúng ta tham gia vào #Mira hệ sinh thái, chúng ta đang hỗ trợ một tương lai nơi mà "Mạng lưới Tác động" cuối cùng có thể hoạt động một cách tự trị, được quản lý bởi một lớp tin cậy không thể thay đổi như chính các định luật của logic.