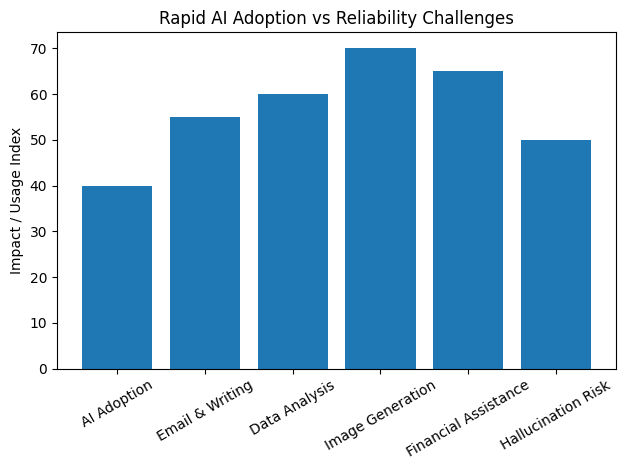

Tôi đã suy nghĩ rất nhiều về việc trí tuệ nhân tạo đang nhanh chóng trở thành một phần của cuộc sống hàng ngày. Chỉ vài năm trước, AI chủ yếu được sử dụng trong các phòng thí nghiệm nghiên cứu hoặc các công ty chuyên biệt. Ngày nay, nó viết email, phân tích dữ liệu, tạo hình ảnh và thậm chí giúp mọi người đưa ra quyết định tài chính. Tốc độ của sự chuyển đổi này thật đáng kinh ngạc. Nhưng càng mạnh mẽ, các hệ thống này càng khiến một câu hỏi bắt đầu trở nên quan trọng: liệu chúng ta có thể thực sự tin tưởng vào những gì AI sản xuất hay không?

Hầu hết các mô hình AI ngày nay hoạt động dựa trên xác suất. Chúng phân tích khối lượng dữ liệu khổng lồ và dự đoán câu trả lời có khả năng nhất cho một câu hỏi. Nhiều lần, kết quả rất ấn tượng và chính xác. Nhưng đôi khi, các hệ thống này sản xuất thông tin mà đơn giản là không chính xác. Chúng có thể bịa ra sự thật, hiểu sai nguồn gốc, hoặc tạo ra các tuyên bố nghe có vẻ thuyết phục nhưng không có bằng chứng thực sự đứng sau chúng. Hiện tượng này thường được gọi là ảo giác, và đó là một trong những hạn chế lớn nhất của AI hiện đại.

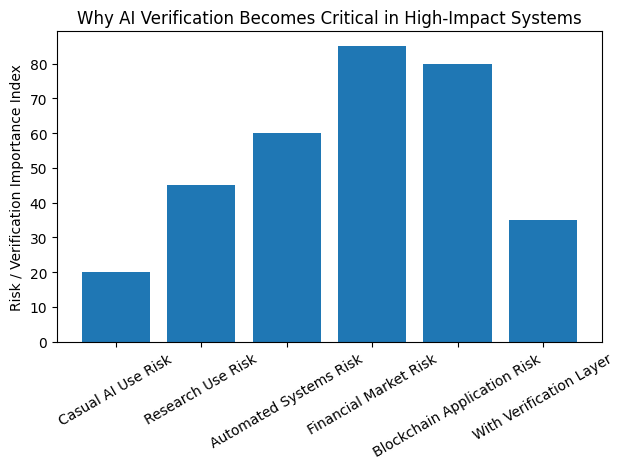

Đối với các cuộc trò chuyện thông thường hoặc các nhiệm vụ đơn giản, những sai sót này có thể không gây ra vấn đề nghiêm trọng. Nhưng khi AI bắt đầu được sử dụng trong các thị trường tài chính, các hệ thống tự động, các môi trường nghiên cứu, hoặc các ứng dụng blockchain, độ chính xác trở nên cực kỳ quan trọng. Một thông tin sai lệch có thể dẫn đến quyết định kém, thua lỗ tài chính, hoặc lòng tin bị tổn hại. Đây là lý do tại sao việc xác minh đang trở thành một trong những chủ đề quan trọng nhất trong tương lai của trí tuệ nhân tạo.

Mira Network tiếp cận thách thức này từ một góc nhìn rất thú vị. Thay vì cố gắng cạnh tranh trong cuộc đua xây dựng các mô hình AI lớn hơn hoặc nhanh hơn, dự án tập trung vào việc làm cho các đầu ra AI đáng tin cậy và có thể xác minh. Mục tiêu không chỉ là tạo ra thông tin, mà còn xác nhận xem thông tin đó có thực sự chính xác hay không.

Ý tưởng cốt lõi đứng sau Mira Network là biến các đầu ra AI phức tạp thành các tuyên bố nhỏ hơn, có thể xác minh. Khi một hệ thống AI tạo ra một phản hồi, Mira không chỉ đơn giản chấp nhận đầu ra như một khối thông tin duy nhất. Thay vào đó, hệ thống tách phản hồi đó thành nhiều tuyên bố riêng biệt. Mỗi tuyên bố có thể được kiểm tra và xác minh độc lập.

Những tuyên bố này được phân phối trên một mạng lưới các nhà xác minh AI độc lập. Mỗi nhà xác minh sẽ xem xét các tuyên bố và kiểm tra độ chính xác của chúng. Bởi vì quy trình xác minh là phi tập trung, hệ thống không phụ thuộc vào một mô hình, một công ty, hoặc một cơ quan nào. Thay vào đó, nhiều người tham gia đóng góp vào quy trình xác minh, tạo ra sự đồng thuận về những gì là đúng và những gì không.

Cấu trúc phi tập trung này tạo ra một hình thức lòng tin mạnh mẽ hơn. Thay vì tin tưởng vào một nguồn duy nhất, mạng lưới xây dựng sự tự tin thông qua sự đồng thuận phân tán. Công nghệ blockchain giúp điều phối quy trình này, đảm bảo rằng kết quả xác minh là minh bạch và có thể kiểm toán.

Một phần quan trọng khác của hệ thống là cấu trúc khuyến khích. Những người tham gia cung cấp xác minh chính xác sẽ được thưởng, trong khi hành vi không trung thực hoặc cẩu thả có thể bị phạt. Những khuyến khích kinh tế này giúp duy trì tính toàn vẹn của mạng lưới. Chúng khuyến khích những người tham gia đóng góp phân tích trung thực và ngăn chặn thao túng hoặc xác minh sai.

Điều tôi thấy đặc biệt thú vị là cách mô hình này có thể hỗ trợ tương lai của các hệ thống tự động. Trong những năm tới, các tác nhân AI có thể hoạt động trực tiếp trong tài chính phi tập trung, thị trường dữ liệu, và cơ sở hạ tầng kỹ thuật số. Những tác nhân này có thể phân tích thị trường, thực hiện các chiến lược và tương tác với các hợp đồng thông minh mà không cần can thiệp của con người. Trong một môi trường như vậy, thông tin đáng tin cậy trở nên thiết yếu.

Một lớp xác minh như Mira Network có thể hoạt động như một biện pháp bảo vệ cho các hệ thống này. Bằng cách xác nhận độ chính xác của các đầu ra AI trước khi chúng được sử dụng trong các quy trình quan trọng, mạng lưới có thể giảm thiểu rủi ro và cải thiện độ tin cậy. Thay vì dựa vào sự tin tưởng mù quáng vào các mô hình AI, các nhà phát triển và người dùng có được quyền truy cập vào trí tuệ đã được xác minh.

Khi trí tuệ nhân tạo tiếp tục mở rộng vào các lĩnh vực công nghệ mới, lòng tin sẽ trở thành một trong những tài nguyên quý giá nhất. Các mô hình mạnh mẽ một mình không đủ. Các hệ thống cũng phải chứng minh rằng các đầu ra của chúng là chính xác và đáng tin cậy. Mira Network đại diện cho một nỗ lực xây dựng lớp lòng tin đó cho thế giới do AI điều khiển.

Tương lai của AI có thể sẽ không chỉ được hình thành bởi sự đổi mới trong thiết kế mô hình, mà còn bởi các hệ thống đảm bảo tính minh bạch và trách nhiệm. Các dự án kết hợp trí tuệ nhân tạo với xác minh phi tập trung có thể đóng một vai trò quan trọng trong sự chuyển mình đó.

Đối với tôi, Mira Network đại diện cho một bước đầu tiên hướng tới một tương lai mà trí tuệ không chỉ mạnh mẽ, mà còn có thể chứng minh.