𝗔𝗥𝗧𝗜𝗙𝗜𝗖𝗜𝗔𝗟 𝗜𝗡𝗧𝗘𝗟𝗟𝗜𝗚𝗘𝗡𝗖𝗘 𝗜𝗦 𝗥𝗔𝗣𝗜𝗗𝗟𝗬 𝗕𝗘𝗖𝗢𝗠𝗜𝗡𝗚 𝗢𝗡𝗘 𝗢𝗙 𝗧𝗛𝗘 𝗠𝗢𝗦𝗧 𝗜𝗡𝗙𝗟𝗨𝗘𝗡𝗧𝗜𝗔𝗟 𝗧𝗘𝗖𝗛𝗡𝗢𝗟𝗢𝗚𝗜𝗘𝗦 𝗜𝗡 𝗧𝗛𝗘 𝗗𝗜𝗚𝗜𝗧𝗔𝗟 𝗪𝗢𝗥𝗟𝗗. 𝗙𝗥𝗢𝗠 𝗔𝗡𝗦𝗪𝗘𝗥𝗜𝗡𝗚 𝗤𝗨𝗘𝗦𝗧𝗜𝗢𝗡𝗦 𝗧𝗢 𝗔𝗦𝗦𝗜𝗦𝗧𝗜𝗡𝗚 𝗪𝗜𝗧𝗛 𝗥𝗘𝗦𝗘𝗔𝗥𝗖𝗛 𝗔𝗡𝗗 𝗗𝗔𝗧𝗔 𝗔𝗡𝗔𝗟𝗬𝗦𝗜𝗦, 𝗔𝗜 𝗦𝗬𝗦𝗧𝗘𝗠𝗦 𝗔𝗥𝗘 𝗡𝗢𝗪 𝗨𝗦𝗘𝗗 𝗜𝗡 𝗠𝗔𝗡𝗬 𝗗𝗔𝗜𝗟𝗬 𝗧𝗔𝗦𝗞𝗦. 𝗔𝗦 𝗧𝗛𝗘𝗜𝗥 𝗨𝗦𝗘 𝗘𝗫𝗣𝗔𝗡𝗗𝗦, 𝗔𝗡 𝗜𝗠𝗣𝗢𝗥𝗧𝗔𝗡𝗧 𝗖𝗢𝗡𝗖𝗘𝗥𝗡 𝗜𝗦 𝗚𝗥𝗢𝗪𝗜𝗡𝗚: 𝗛𝗢𝗪 𝗥𝗘𝗟𝗜𝗔𝗕𝗟𝗘 𝗧𝗛𝗘 𝗜𝗡𝗙𝗢𝗥𝗠𝗔𝗧𝗜𝗢𝗡 𝗣𝗥𝗢𝗗𝗨𝗖𝗘𝗗 𝗕𝗬 𝗔𝗜 𝗔𝗖𝗧𝗨𝗔𝗟𝗟𝗬 𝗜𝗦.

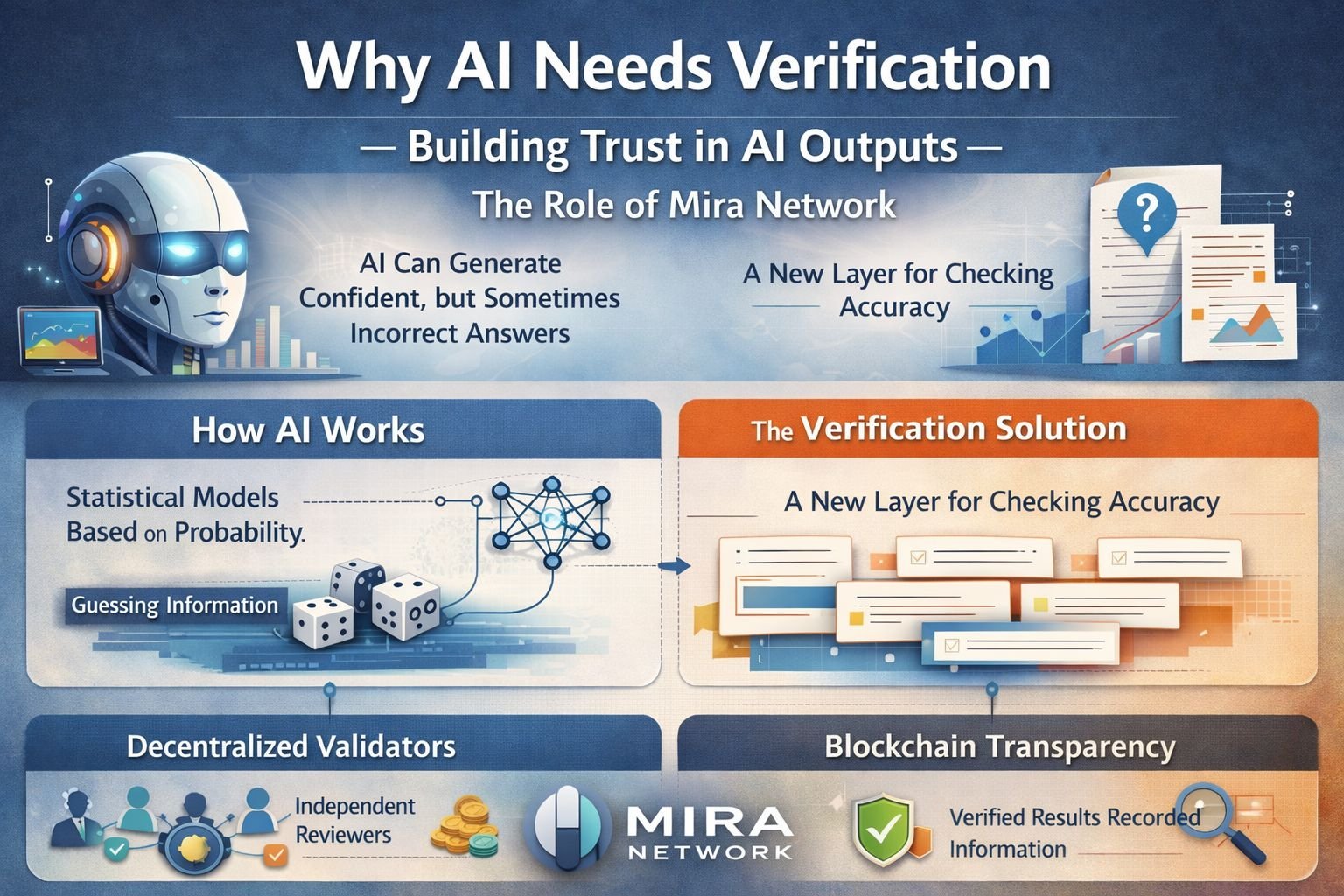

𝗠𝗢𝗗𝗘𝗥𝗡 𝗔𝗜 𝗧𝗢𝗢𝗟𝗦 𝗖𝗔𝗡 𝗚𝗘𝗡𝗘𝗥𝗔𝗧𝗘 𝗗𝗘𝗧𝗔𝗜𝗟𝗘𝗗 𝗘𝗫𝗣𝗟𝗔𝗡𝗔𝗧𝗜𝗢𝗡𝗦, 𝗥𝗘𝗣𝗢𝗥𝗧𝗦, 𝗔𝗡𝗗 𝗜𝗡𝗦𝗜𝗚𝗛𝗧𝗦 𝗪𝗜𝗧𝗛𝗜𝗡 𝗦𝗘𝗖𝗢𝗡𝗗𝗦. 𝗧𝗛𝗘𝗜𝗥 𝗥𝗘𝗦𝗣𝗢𝗡𝗦𝗘𝗦 𝗢𝗙𝗧𝗘𝗡 𝗔𝗣𝗣𝗘𝗔𝗥 𝗖𝗟𝗘𝗔𝗥 𝗔𝗡𝗗 𝗖𝗢𝗡𝗙𝗜𝗗𝗘𝗡𝗧, 𝗪𝗛𝗜𝗖𝗛 𝗠𝗔𝗞𝗘𝗦 𝗧𝗛𝗘𝗠 𝗘𝗔𝗦𝗬 𝗧𝗢 𝗧𝗥𝗨𝗦𝗧. 𝗛𝗢𝗪𝗘𝗩𝗘𝗥, 𝗧𝗛𝗜𝗦 𝗖𝗢𝗡𝗙𝗜𝗗𝗘𝗡𝗖𝗘 𝗗𝗢𝗘𝗦 𝗡𝗢𝗧 𝗔𝗟𝗪𝗔𝗬𝗦 𝗚𝗨𝗔𝗥𝗔𝗡𝗧𝗘𝗘 𝗔𝗖𝗖𝗨𝗥𝗔𝗖𝗬, 𝗔𝗡𝗗 𝗦𝗢𝗠𝗘 𝗔𝗡𝗦𝗪𝗘𝗥𝗦 𝗠𝗔𝗬 𝗖𝗢𝗡𝗧𝗔𝗜𝗡 𝗜𝗡𝗖𝗢𝗥𝗥𝗘𝗖𝗧 𝗢𝗥 𝗠𝗜𝗦𝗟𝗘𝗔𝗗𝗜𝗡𝗚 𝗜𝗡𝗙𝗢𝗥𝗠𝗔𝗧𝗜𝗢𝗡.

𝗧𝗛𝗘 𝗥𝗘𝗔𝗦𝗢𝗡 𝗕𝗘𝗛𝗜𝗡𝗗 𝗧𝗛𝗜𝗦 𝗖𝗛𝗔𝗟𝗟𝗘𝗡𝗚𝗘 𝗟𝗜𝗘𝗦 𝗜𝗡 𝗛𝗢𝗪 𝗠𝗢𝗦𝗧 𝗔𝗜 𝗠𝗢𝗗𝗘𝗟𝗦 𝗔𝗥𝗘 𝗕𝗨𝗜𝗟𝗧. 𝗜𝗡𝗦𝗧𝗘𝗔𝗗 𝗢𝗙 𝗦𝗧𝗢𝗥𝗜𝗡𝗚 𝗩𝗘𝗥𝗜𝗙𝗜𝗘𝗗 𝗞𝗡𝗢𝗪𝗟𝗘𝗗𝗚𝗘 𝗟𝗜𝗞𝗘 𝗧𝗥𝗔𝗗𝗜𝗧𝗜𝗢𝗡𝗔𝗟 𝗗𝗔𝗧𝗔𝗕𝗔𝗦𝗘𝗦, 𝗟𝗔𝗥𝗚𝗘 𝗟𝗔𝗡𝗚𝗨𝗔𝗚𝗘 𝗠𝗢𝗗𝗘𝗟𝗦 𝗟𝗘𝗔𝗥𝗡 𝗣𝗔𝗧𝗧𝗘𝗥𝗡𝗦 𝗙𝗥𝗢𝗠 𝗠𝗔𝗦𝗦𝗜𝗩𝗘 𝗗𝗔𝗧𝗔𝗦𝗘𝗧𝗦. 𝗧𝗛𝗘𝗬 𝗔𝗡𝗔𝗟𝗬𝗭𝗘 𝗛𝗢𝗪 𝗪𝗢𝗥𝗗𝗦 𝗔𝗡𝗗 𝗜𝗗𝗘𝗔𝗦 𝗨𝗦𝗨𝗔𝗟𝗟𝗬 𝗔𝗣𝗣𝗘𝗔𝗥 𝗧𝗢𝗚𝗘𝗧𝗛𝗘𝗥 𝗔𝗡𝗗 𝗧𝗛𝗘𝗡 𝗚𝗘𝗡𝗘𝗥𝗔𝗧𝗘 𝗥𝗘𝗦𝗣𝗢𝗡𝗦𝗘𝗦 𝗕𝗔𝗦𝗘𝗗 𝗢𝗡 𝗧𝗛𝗢𝗦𝗘 𝗣𝗔𝗧𝗧𝗘𝗥𝗡𝗦.

𝗪𝗛𝗘𝗡 𝗦𝗢𝗠𝗘𝗢𝗡𝗘 𝗔𝗦𝗞𝗦 𝗔 𝗤𝗨𝗘𝗦𝗧𝗜𝗢𝗡, 𝗧𝗛𝗘 𝗔𝗜 𝗣𝗥𝗘𝗗𝗜𝗖𝗧𝗦 𝗧𝗛𝗘 𝗠𝗢𝗦𝗧 𝗟𝗜𝗞𝗘𝗟𝗬 𝗦𝗘𝗤𝗨𝗘𝗡𝗖𝗘 𝗢𝗙 𝗪𝗢𝗥𝗗𝗦 𝗥𝗔𝗧𝗛𝗘𝗥 𝗧𝗛𝗔𝗡 𝗥𝗘𝗧𝗥𝗜𝗘𝗩𝗜𝗡𝗚 𝗔 𝗖𝗢𝗡𝗙𝗜𝗥𝗠𝗘𝗗 𝗙𝗔𝗖𝗧. 𝗧𝗛𝗜𝗦 𝗣𝗥𝗢𝗕𝗔𝗕𝗜𝗟𝗜𝗧𝗬-𝗕𝗔𝗦𝗘𝗗 𝗣𝗥𝗢𝗖𝗘𝗦𝗦 𝗠𝗔𝗞𝗘𝗦 𝗔𝗜 𝗙𝗟𝗘𝗫𝗜𝗕𝗟𝗘 𝗔𝗡𝗗 𝗣𝗢𝗪𝗘𝗥𝗙𝗨𝗟, 𝗕𝗨𝗧 𝗜𝗧 𝗔𝗟𝗦𝗢 𝗠𝗘𝗔𝗡𝗦 𝗧𝗛𝗘 𝗦𝗬𝗦𝗧𝗘𝗠 𝗠𝗔𝗬 𝗦𝗢𝗠𝗘𝗧𝗜𝗠𝗘𝗦 𝗣𝗥𝗢𝗗𝗨𝗖𝗘 𝗦𝗧𝗔𝗧𝗘𝗠𝗘𝗡𝗧𝗦 𝗧𝗛𝗔𝗧 𝗦𝗢𝗨𝗡𝗗 𝗟𝗢𝗚𝗜𝗖𝗔𝗟 𝗬𝗘𝗧 𝗔𝗥𝗘 𝗡𝗢𝗧 𝗘𝗡𝗧𝗜𝗥𝗘𝗟𝗬 𝗖𝗢𝗥𝗥𝗘𝗖𝗧.

𝗔𝗦 𝗔𝗜 𝗧𝗢𝗢𝗟𝗦 𝗕𝗘𝗖𝗢𝗠𝗘 𝗠𝗢𝗥𝗘 𝗪𝗜𝗗𝗘𝗟𝗬 𝗨𝗦𝗘𝗗 𝗜𝗡 𝗔𝗥𝗘𝗔𝗦 𝗦𝗨𝗖𝗛 𝗔𝗦 𝗕𝗨𝗦𝗜𝗡𝗘𝗦𝗦, 𝗥𝗘𝗦𝗘𝗔𝗥𝗖𝗛, 𝗔𝗡𝗗 𝗧𝗘𝗖𝗛𝗡𝗢𝗟𝗢𝗚𝗬, 𝗧𝗛𝗘 𝗜𝗠𝗣𝗔𝗖𝗧 𝗢𝗙 𝗜𝗡𝗖𝗢𝗥𝗥𝗘𝗖𝗧 𝗜𝗡𝗙𝗢𝗥𝗠𝗔𝗧𝗜𝗢𝗡 𝗕𝗘𝗖𝗢𝗠𝗘𝗦 𝗠𝗢𝗥𝗘 𝗦𝗘𝗥𝗜𝗢𝗨𝗦. 𝗘𝗩𝗘𝗡 𝗦𝗠𝗔𝗟𝗟 𝗜𝗡𝗔𝗖𝗖𝗨𝗥𝗔𝗖𝗜𝗘𝗦 𝗖𝗔𝗡 𝗜𝗡𝗙𝗟𝗨𝗘𝗡𝗖𝗘 𝗗𝗘𝗖𝗜𝗦𝗜𝗢𝗡𝗦, 𝗦𝗣𝗥𝗘𝗔𝗗 𝗠𝗜𝗦𝗜𝗡𝗙𝗢𝗥𝗠𝗔𝗧𝗜𝗢𝗡, 𝗢𝗥 𝗥𝗘𝗗𝗨𝗖𝗘 𝗧𝗥𝗨𝗦𝗧 𝗜𝗡 𝗔𝗜 𝗦𝗬𝗦𝗧𝗘𝗠𝗦.

𝗧𝗢 𝗔𝗗𝗗𝗥𝗘𝗦𝗦 𝗧𝗛𝗜𝗦 𝗜𝗦𝗦𝗨𝗘, 𝗔 𝗡𝗘𝗪 𝗖𝗢𝗡𝗖𝗘𝗣𝗧 𝗜𝗦 𝗘𝗠𝗘𝗥𝗚𝗜𝗡𝗚 𝗜𝗡 𝗧𝗛𝗘 𝗔𝗜 𝗘𝗖𝗢𝗦𝗬𝗦𝗧𝗘𝗠: 𝗔 𝗩𝗘𝗥𝗜𝗙𝗜𝗖𝗔𝗧𝗜𝗢𝗡 𝗟𝗔𝗬𝗘𝗥. 𝗜𝗡𝗦𝗧𝗘𝗔𝗗 𝗢𝗙 𝗢𝗡𝗟𝗬 𝗙𝗢𝗖𝗨𝗦𝗜𝗡𝗚 𝗢𝗡 𝗚𝗘𝗡𝗘𝗥𝗔𝗧𝗜𝗡𝗚 𝗜𝗡𝗙𝗢𝗥𝗠𝗔𝗧𝗜𝗢𝗡, 𝗧𝗛𝗜𝗦 𝗟𝗔𝗬𝗘𝗥 𝗙𝗢𝗖𝗨𝗦𝗘𝗦 𝗢𝗡 𝗖𝗛𝗘𝗖𝗞𝗜𝗡𝗚 𝗪𝗛𝗘𝗧𝗛𝗘𝗥 𝗧𝗛𝗘 𝗢𝗨𝗧𝗣𝗨𝗧𝗦 𝗣𝗥𝗢𝗗𝗨𝗖𝗘𝗗 𝗕𝗬 𝗔𝗜 𝗦𝗬𝗦𝗧𝗘𝗠𝗦 𝗔𝗥𝗘 𝗔𝗖𝗖𝗨𝗥𝗔𝗧𝗘 𝗔𝗡𝗗 𝗥𝗘𝗟𝗜𝗔𝗕𝗟𝗘.

𝗣𝗥𝗢𝗝𝗘𝗖𝗧𝗦 𝗦𝗨𝗖𝗛 𝗔𝗦 𝗠𝗜𝗥𝗔 𝗡𝗘𝗧𝗪𝗢𝗥𝗞 𝗔𝗥𝗘 𝗘𝗫𝗣𝗟𝗢𝗥𝗜𝗡𝗚 𝗧𝗛𝗜𝗦 𝗜𝗗𝗘𝗔 𝗕𝗬 𝗙𝗢𝗖𝗨𝗦𝗜𝗡𝗚 𝗢𝗡 𝗩𝗔𝗟𝗜𝗗𝗔𝗧𝗜𝗡𝗚 𝗔𝗜-𝗚𝗘𝗡𝗘𝗥𝗔𝗧𝗘𝗗 𝗢𝗨𝗧𝗣𝗨𝗧𝗦 𝗥𝗔𝗧𝗛𝗘𝗥 𝗧𝗛𝗔𝗡 𝗕𝗨𝗜𝗟𝗗𝗜𝗡𝗚 𝗔𝗡𝗢𝗧𝗛𝗘𝗥 𝗟𝗔𝗥𝗚𝗘 𝗔𝗜 𝗠𝗢𝗗𝗘𝗟. 𝗕𝗬 𝗕𝗥𝗘𝗔𝗞𝗜𝗡𝗚 𝗥𝗘𝗦𝗣𝗢𝗡𝗦𝗘𝗦 𝗜𝗡𝗧𝗢 𝗦𝗠𝗔𝗟𝗟𝗘𝗥 𝗖𝗟𝗔𝗜𝗠𝗦 𝗔𝗡𝗗 𝗔𝗟𝗟𝗢𝗪𝗜𝗡𝗚 𝗜𝗡𝗗𝗘𝗣𝗘𝗡𝗗𝗘𝗡𝗧 𝗩𝗔𝗟𝗜𝗗𝗔𝗧𝗢𝗥𝗦 𝗧𝗢 𝗥𝗘𝗩𝗜𝗘𝗪 𝗧𝗛𝗘𝗠, 𝗧𝗛𝗘 𝗦𝗬𝗦𝗧𝗘𝗠 𝗔𝗜𝗠𝗦 𝗧𝗢 𝗖𝗥𝗘𝗔𝗧𝗘 𝗔 𝗠𝗢𝗥𝗘 𝗧𝗥𝗨𝗦𝗧𝗪𝗢𝗥𝗧𝗛𝗬 𝗘𝗡𝗩𝗜𝗥𝗢𝗡𝗠𝗘𝗡𝗧 𝗙𝗢𝗥 𝗔𝗜-𝗚𝗘𝗡𝗘𝗥𝗔𝗧𝗘𝗗 𝗜𝗡𝗙𝗢𝗥𝗠𝗔𝗧𝗜𝗢𝗡.

𝗔𝗦 𝗔𝗥𝗧𝗜𝗙𝗜𝗖𝗜𝗔𝗟 𝗜𝗡𝗧𝗘𝗟𝗟𝗜𝗚𝗘𝗡𝗖𝗘 𝗖𝗢𝗡𝗧𝗜𝗡𝗨𝗘𝗦 𝗧𝗢 𝗘𝗩𝗢𝗟𝗩𝗘, 𝗩𝗘𝗥𝗜𝗙𝗜𝗖𝗔𝗧𝗜𝗢𝗡 𝗠𝗔𝗬 𝗕𝗘𝗖𝗢𝗠𝗘 𝗔 𝗖𝗥𝗜𝗧𝗜𝗖𝗔𝗟 𝗖𝗢𝗠𝗣𝗢𝗡𝗘𝗡𝗧 𝗢𝗙 𝗧𝗛𝗘 𝗔𝗜 𝗘𝗖𝗢𝗦𝗬𝗦𝗧𝗘𝗠. 𝗜𝗡 𝗧𝗛𝗘 𝗙𝗨𝗧𝗨𝗥𝗘, 𝗧𝗛𝗘 𝗧𝗥𝗨𝗘 𝗦𝗧𝗥𝗘𝗡𝗚𝗧𝗛 𝗢𝗙 𝗔𝗜 𝗠𝗔𝗬 𝗡𝗢𝗧 𝗢𝗡𝗟𝗬 𝗗𝗘𝗣𝗘𝗡𝗗 𝗢𝗡 𝗛𝗢𝗪 𝗜𝗡𝗧𝗘𝗟𝗟𝗜𝗚𝗘𝗡𝗧𝗟𝗬 𝗜𝗧 𝗚𝗘𝗡𝗘𝗥𝗔𝗧𝗘𝗦 𝗜𝗡𝗙𝗢𝗥𝗠𝗔𝗧𝗜𝗢𝗡, 𝗕𝗨𝗧 𝗔𝗟𝗦𝗢 𝗢𝗡 𝗛𝗢𝗪 𝗥𝗘𝗟𝗜𝗔𝗕𝗟𝗬 𝗧𝗛𝗔𝗧 𝗜𝗡𝗙𝗢𝗥𝗠𝗔𝗧𝗜𝗢𝗡 𝗖𝗔𝗡 𝗕𝗘 𝗩𝗘𝗥𝗜𝗙𝗜𝗘𝗗.

@Mira - Trust Layer of AI #Mira $MIRA