Điều gì sẽ xảy ra nếu bạn có thể xây dựng trợ lý AI của riêng mình chạy trên máy của bạn, kết nối với Telegram, và giúp đỡ với nghiên cứu crypto, tạo nội dung, và hỗ trợ cộng đồng?

Đó chính xác là những gì tôi đã thử nghiệm với OpenClaw.

Thay vì chỉ sử dụng AI qua một ứng dụng chat bình thường, tôi muốn xây dựng một cái gì đó hữu ích hơn: một trợ lý thực sự có thể sống trong môi trường riêng của nó, giữ tổ chức, và cuối cùng phát triển thành một công cụ quy trình làm việc nghiêm túc cho nội dung Binance Square, giáo dục crypto, và tự động hóa.

Trong hướng dẫn này, tôi sẽ chỉ cho bạn:

• OpenClaw là gì

• lý do tôi chọn thiết lập VMware Ubuntu

• sự khác biệt giữa máy cục bộ so với VM so với VPS

• và các bước chính xác mà tôi đã sử dụng để làm cho một bot AI Telegram hoạt động

Nếu bạn muốn từ người sử dụng AI trở thành nhà xây dựng AI, đây là một nơi tuyệt vời để bắt đầu.

OpenClaw là gì?

OpenClaw là một khung trợ lý AI giúp bạn xây dựng trợ lý riêng của mình và kết nối nó với các công cụ, quy trình làm việc và kênh trò chuyện thực tế.

Thay vì chỉ trò chuyện với AI, OpenClaw cho phép bạn tạo ra một cái gì đó có cấu trúc hơn, chẳng hạn như:

• một bot AI Telegram

• một trợ lý Discord

• một trợ lý nghiên cứu crypto

• một trợ lý quy trình nội dung

• một bot hỗ trợ cộng đồng

• một trợ lý Binance được hỗ trợ kỹ năng trong tương lai

Điều làm OpenClaw thú vị là nó không chỉ đơn thuần về các phản hồi. Nó liên quan đến việc xây dựng một môi trường trợ lý thực sự mà bạn kiểm soát.

Các trường hợp sử dụng cho OpenClaw

Dưới đây là một số ví dụ thực tế:

• Trợ lý Giáo dục Crypto

Giải thích Bitcoin, ví, sản phẩm Binance, quản lý rủi ro và các lộ trình học tập cho người mới bắt đầu.

• Trợ lý Nội dung

Soạn thảo các bài viết Binance Square, nội dung Telegram, các chủ đề giáo dục và ý tưởng chiến dịch.

• Community Copilot

Giúp trả lời các câu hỏi, hướng dẫn người dùng và hỗ trợ các cộng đồng crypto.

• Công cụ Quy trình Nghiên cứu

Thu thập ý tưởng, tổ chức ghi chú và biến nghiên cứu thành đầu ra hữu ích.

Đối với các nhà sáng tạo và vận hành, OpenClaw có thể trở thành một phần của hệ thống quy trình làm việc thực sự.

Máy cục bộ so với VM so với VPS

Trước khi xây dựng, tôi đã có một câu hỏi chính:

Tôi nên chạy trợ lý của mình ở đâu?

1) Máy cục bộ

Điều này có nghĩa là cài đặt OpenClaw trực tiếp trên tài khoản người dùng laptop hoặc desktop của bạn.

Tốt nhất cho:

• thử nghiệm nhanh

• học tập

• thử nghiệm đơn giản

Ưu điểm:

• dễ bắt đầu

• không tốn thêm chi phí

• tốt cho phát triển nhanh

Nhược điểm:

• dừng lại khi máy của bạn ngủ hoặc tắt

• ít sạch hơn nếu kết hợp với môi trường hàng ngày của bạn

2) VMware / Máy ảo

Điều này có nghĩa là tạo ra một môi trường Ubuntu chuyên dụng bên trong máy tính của bạn.

Tốt nhất cho:

• phát triển cục bộ sạch hơn

• thử nghiệm an toàn hơn

• học cách làm việc theo kiểu máy chủ

Ưu điểm:

• thiết lập tách biệt

• dễ dàng tổ chức hơn

• gần với môi trường triển khai thực tế

• tuyệt vời cho ảnh chụp nhanh và phục hồi

Nhược điểm:

• vẫn phụ thuộc vào việc máy tính của bạn đang bật

• sử dụng nhiều tài nguyên hệ thống hơn so với cài đặt cục bộ trực tiếp

3) VPS

Một VPS là tốt nhất khi bạn muốn trợ lý của mình trực tuyến mọi lúc.

Tốt nhất cho:

• bot sản xuất

• tự động hóa 24/7

• sử dụng công cộng lâu dài

Ưu điểm:

• luôn trực tuyến

• ổn định

• dễ dàng mở rộng hơn sau này

Nhược điểm:

• chi phí hàng tháng

• nhiều công việc bảo trì và bảo mật hơn

Khuyến nghị của tôi

Con đường thông minh nhất cho hầu hết mọi người là:

Bắt đầu cục bộ hoặc trong một VM → học thiết lập → chuyển đến VPS sau

Đó là lý do tại sao tôi đã sử dụng Ubuntu Server bên trong VMware trước. Nó đã cho tôi một môi trường sạch sẽ mà không cần đi thẳng vào việc lưu trữ sản xuất hoàn chỉnh.

👉Thiết lập Xây dựng của Tôi👀

Đây là thiết lập mà tôi đã sử dụng:

• Máy chủ: Windows

• Ảo hóa: VMware

• Hệ điều hành khách: Ubuntu Server 24.04

• Thông số VM: 4 vCPU, 8 GB RAM, 80 GB ổ đĩa

• Mạng: cầu nối

• Mục tiêu: OpenClaw + bot Telegram

• Trường hợp sử dụng: xây dựng một môi trường trợ lý AI thực sự cho giáo dục crypto và quy trình làm việc nội dung trong tương lai

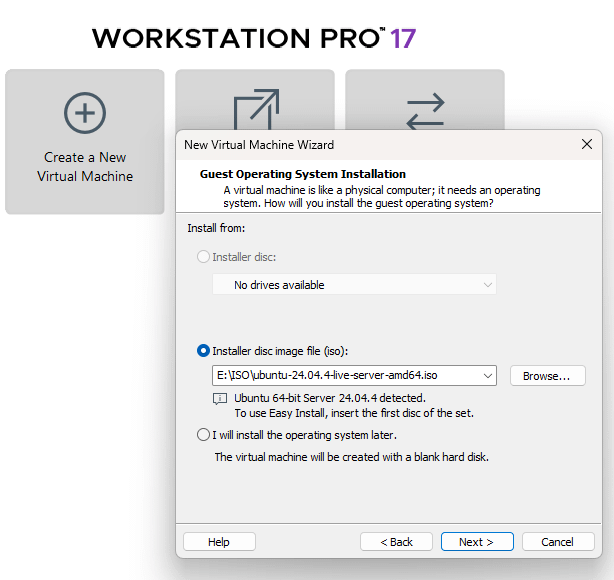

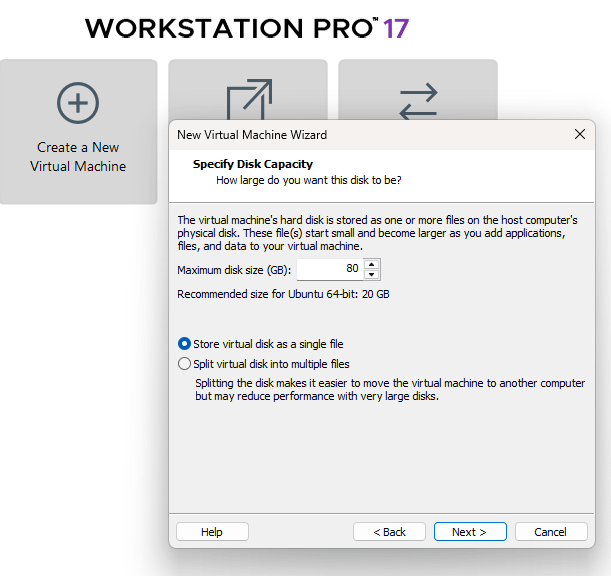

Bước 1: Cài đặt Ubuntu Server trong VMware

Tôi đã tạo một VM mới với:

• 4 lõi

• 8 GB RAM

• 80 GB ổ đĩa

• Ubuntu Server 24.04

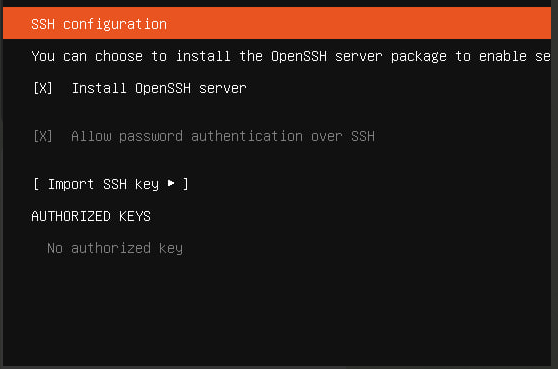

Trong quá trình cài đặt, tôi đã chọn:

• Sử dụng toàn bộ ổ đĩa

• LVM được kích hoạt

• máy chủ OpenSSH được kích hoạt

• bỏ qua các gói tùy chọn

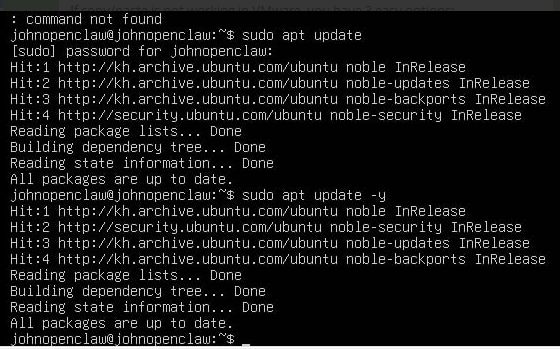

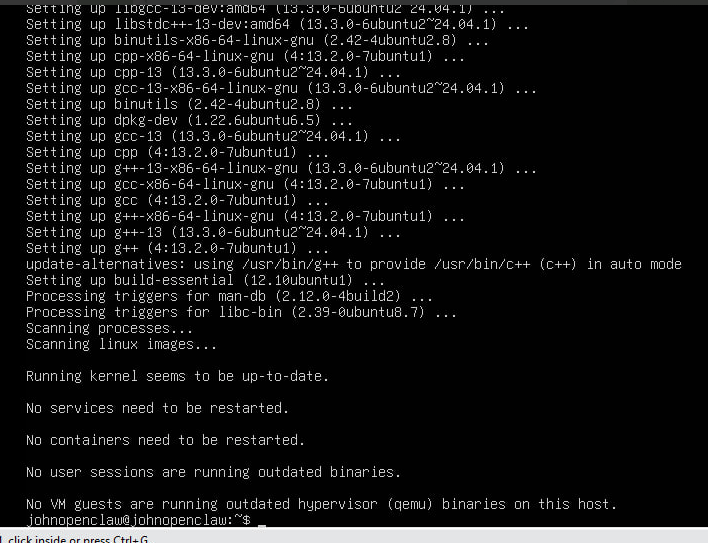

Bước 2: Cập nhật hệ thống

Sau khi đăng nhập vào Ubuntu, tôi đã cập nhật các gói:

sudo apt update

sudo apt upgrade -y

sudo apt install -y curl git build-essential tmux

Điều này chuẩn bị cho VM cho phần còn lại của thiết lập.

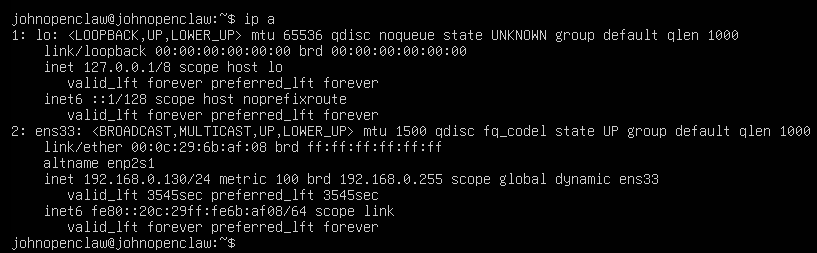

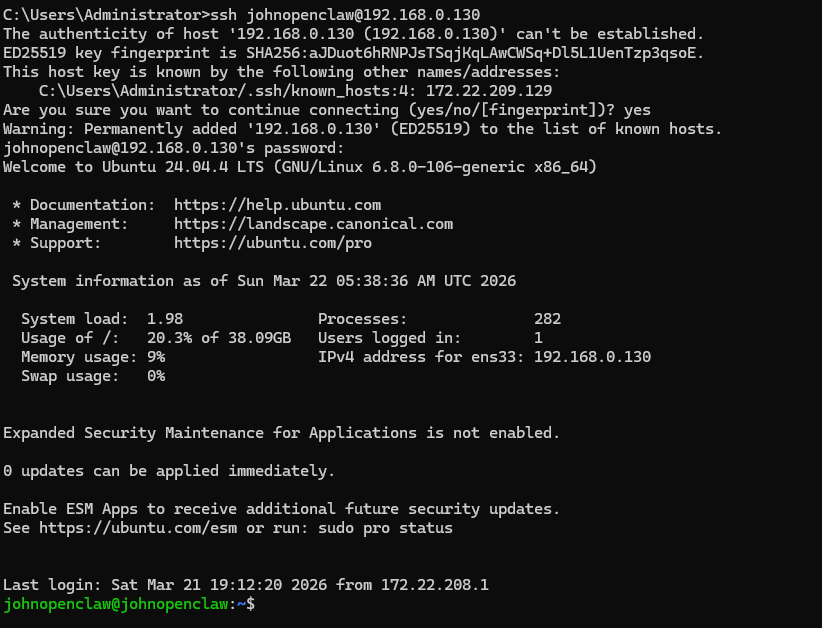

Bước 3: Kết nối với SSH từ Windows

Gõ trực tiếp bên trong console VMware thật không tiện, vì vậy tôi đã chuyển sang SSH từ Windows.

Đầu tiên, tôi tìm thấy địa chỉ IP của VM:

ip a

Sau đó từ Windows PowerShell:

ssh yourusername@YOUR-VM-IP

Điều đó khiến việc sao chép/dán dễ dàng hơn và ngay lập tức cải thiện quy trình làm việc.

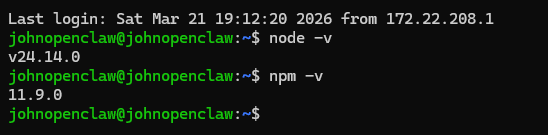

Bước 4: Cài đặt Node.js với nvm

Sau đó tôi đã cài đặt nvm và sử dụng nó để cài đặt Node 24:

curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.40.3/install.sh | bash

source ~/.bashrc

nvm install 24

nvm use 24

nvm alias default 24

node -v

npm -v

Khi Node và npm đã hoạt động, môi trường đã sẵn sàng cho OpenClaw.

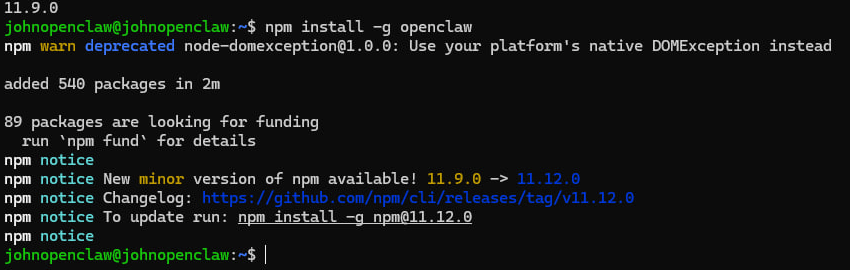

Bước 5: Cài đặt OpenClaw

Tiếp theo, tôi đã cài đặt OpenClaw toàn cầu:

npm install -g openclaw

Sau đó, tôi đã kiểm tra nó:

openclaw --help

trạng thái openclaw

Tại thời điểm này, OpenClaw đã được cài đặt, nhưng gateway vẫn chưa được cấu hình đầy đủ.

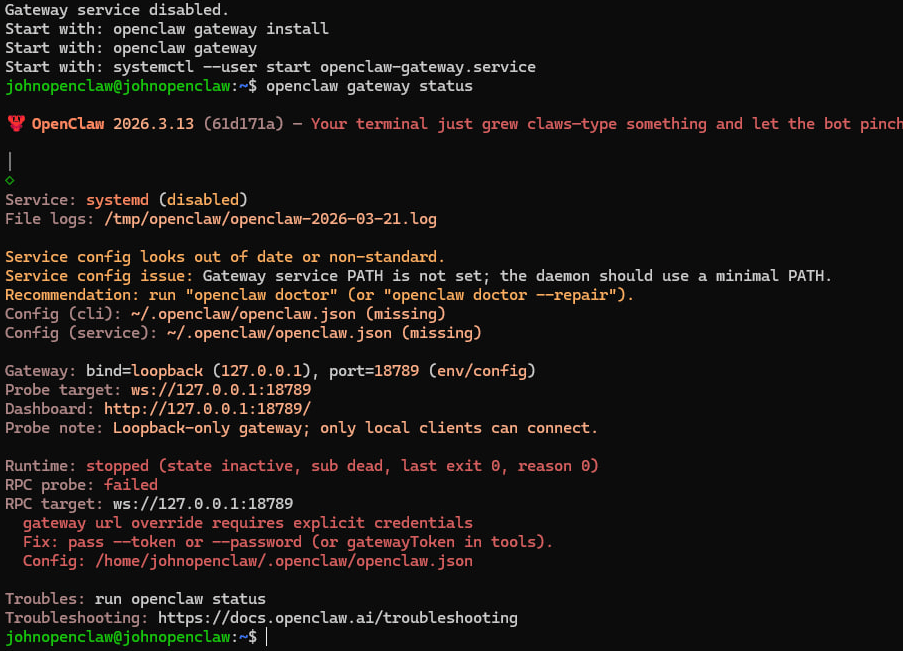

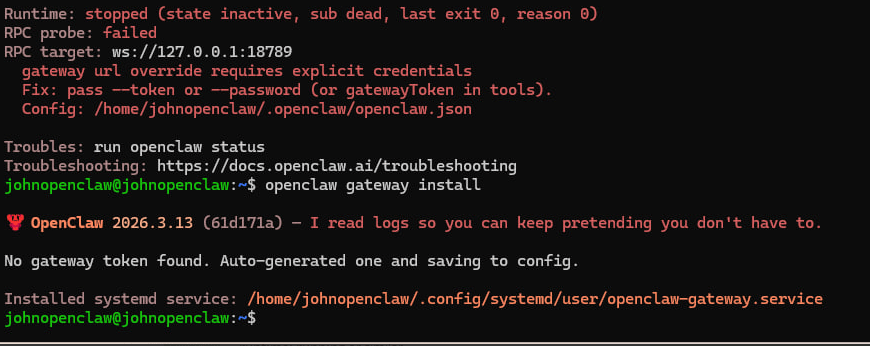

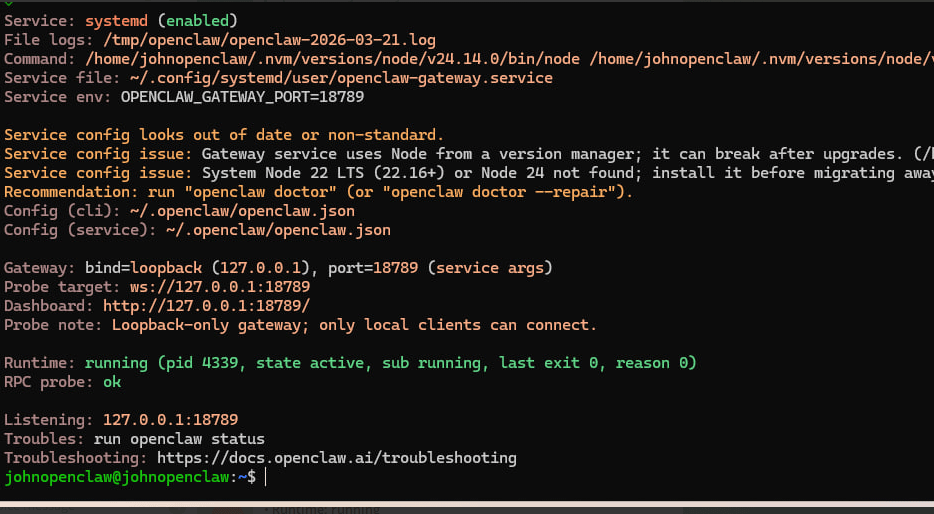

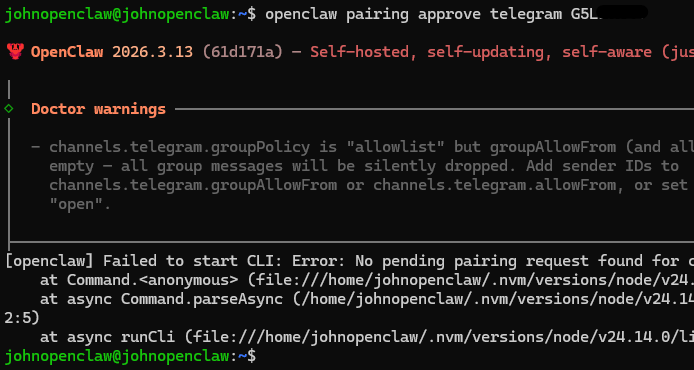

Bước 6: Cài đặt và khởi động gateway

Để chạy dịch vụ:

cài đặt gateway openclaw

khởi động gateway openclaw

trạng thái gateway openclaw

Lúc đầu, tôi gặp một vấn đề: dịch vụ gateway tồn tại, nhưng quá trình gateway thực tế không lắng nghe đúng cách.

Vì vậy, tôi đã kiểm tra nhật ký và tìm thấy nguyên nhân.

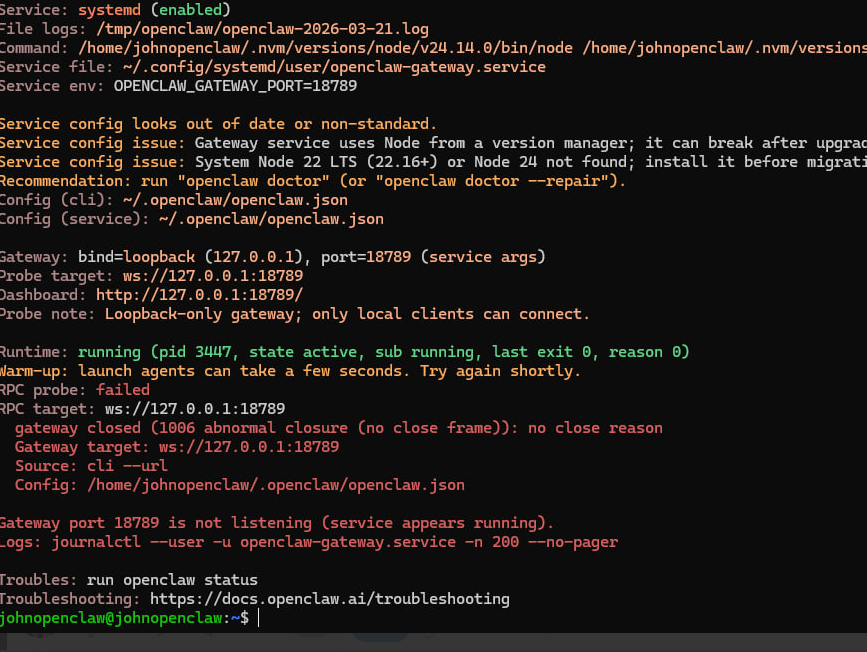

Bước 7: Sửa vấn đề gateway

Vấn đề chính là:

Khởi động gateway bị chặn: đặt gateway.mode=local

Vì vậy, tôi đã sửa nó với:

cài đặt openclaw đặt chế độ gateway.local

khởi động lại gateway openclaw

trạng thái gateway openclaw

Sau đó, gateway đã khỏe mạnh và lắng nghe đúng cách.

Đây là bước ngoặt. Một khi gateway đã hoạt động, môi trường trợ lý trở nên thực tế.

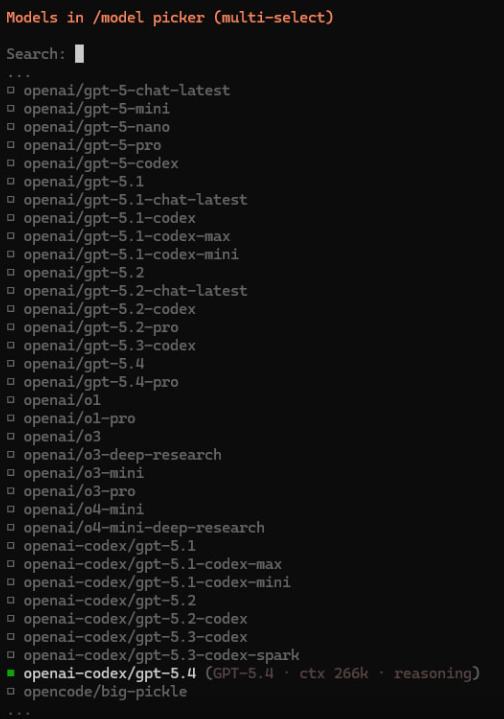

Bước 8: Cấu hình mô hình và kênh

Sau đó, tôi đã chạy:

cấu hình openclaw

Bên trong thiết lập, tôi đã cấu hình:

• không gian làm việc

• mô hình

• kênh Telegram

Đối với mô hình, tôi đã chọn:

• openai-codex/gpt-5.4

Đối với Telegram, tôi đã sử dụng một mã token bot được tạo thông qua @BotFather.

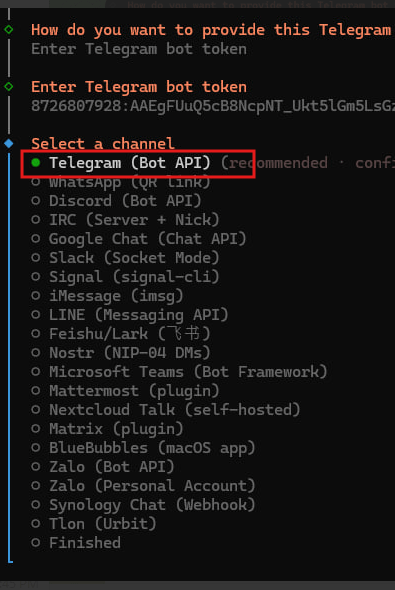

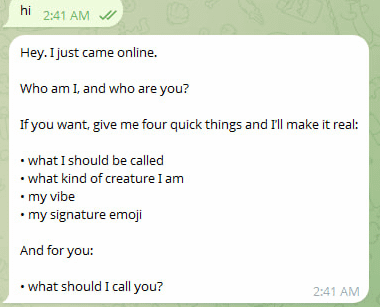

Bước 9: Tạo và kết nối bot Telegram

Để cấu hình Telegram, tôi đã tạo một bot với @BotFather và sao chép mã token.

Bên trong thiết lập OpenClaw, tôi đã chọn:

• Kênh

• Cấu hình/liên kết

• Telegram (Bot API)

• Nhập mã token bot Telegram

Sau khi lưu cấu hình đó, bot đã sẵn sàng để ghép nối.

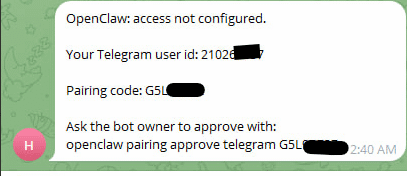

Bước 10: Kết nối tài khoản Telegram

Khi tôi gửi một tin nhắn đến bot, OpenClaw đã cho tôi mã ghép nối. Sau đó, tôi đã phê duyệt nó trong VM:

phê duyệt ghép nối openclaw telegram YOURCODE

Sau đó, tôi đã gửi một tin nhắn khác trong Telegram, và bot đã trả lời thành công.

Đó là khoảnh khắc thực sự "nó hoạt động".

😍Kết quả😎

Tôi đã kiểm tra bot một lần nữa từ một mạng khác, và nó vẫn hoạt động hoàn hảo.

Điều đó đã chứng minh một điều quan trọng:

Điều này không còn chỉ là một thử nghiệm cục bộ.

Giờ đây, đó là một thiết lập trợ lý AI thực sự.

Và điều đó mở ra cánh cửa cho nhiều trường hợp sử dụng lớn hơn:

• bot giáo dục crypto

• trợ lý nội dung Binance Square

• trợ giúp cộng đồng Telegram

• nghiên cứu trợ lý

• công cụ tự động hóa quy trình làm việc

Tại sao điều này quan trọng đối với các nhà sáng tạo

Đối với các nhà sáng tạo, giá trị không chỉ nằm ở việc "có AI."

Giá trị thực sự là xây dựng một hệ thống giúp bạn:

• di chuyển nhanh hơn

• giữ nhất quán

• tổ chức ý tưởng

• trả lời thông minh hơn

• biến nghiên cứu thành nội dung

• hỗ trợ khán giả của bạn trên nhiều nền tảng

Một thiết lập như thế này có thể phát triển thành:

• một trợ lý học tập Binance

• một trợ lý soạn thảo nội dung

• một trợ lý vận hành cộng đồng

• một hệ thống quy trình làm việc crypto

Đó là lý do tại sao tôi nghĩ điều này quan trọng: một khi bạn thấy trợ lý AI của riêng mình hoạt động trực tiếp, cách suy nghĩ của bạn sẽ thay đổi từ người tiêu dùng thành nhà xây dựng.

Các bài học tôi đã học

Một vài bài học thực tế từ việc xây dựng này:

• VMware là một phòng thí nghiệm cục bộ tuyệt vời

• SSH làm cho việc thiết lập dễ dàng hơn nhiều

• cài đặt OpenClaw rất đơn giản

• cấu hình gateway rất quan trọng

• Kết nối Telegram rất đơn giản khi thiết lập cốt lõi đã khỏe mạnh

• thử nghiệm từ một mạng khác là một kiểm tra sự tự tin tuyệt vời

Nếu tôi cải thiện thiết lập này sau, các bước tiếp theo của tôi sẽ là:

• xoay vòng mã token bot

• dọn dẹp môi trường Node/gateway để ổn định lâu dài

• định hình danh tính và các câu lệnh của trợ lý

• thêm kỹ năng và tự động hóa quy trình trong tương lai

Kết luận cuối cùng

Nếu bạn muốn xây dựng trợ lý AI của riêng mình, bạn không cần phải bắt đầu với một thiết lập đám mây hoàn hảo.

Bắt đầu với những gì bạn có:

• máy tính của bạn

• một VM

• Ubuntu

• Telegram

• một mục tiêu thực tế

Đó là đủ để xây dựng một cái gì đó thực sự.

Và một khi trợ lý của bạn trả lời trực tiếp lần đầu tiên, bạn sẽ hiểu tại sao điều này không chỉ là một thử nghiệm công nghệ. Đây là khởi đầu của cơ sở hạ tầng AI của riêng bạn.

🤯Nếu bạn đã nghĩ đến việc xây dựng trợ lý AI của riêng mình, lời khuyên của tôi rất đơn giản:

👉Bắt đầu ngay. Bắt đầu nhỏ. Xây dựng một phiên bản hoạt động.

Hãy thử nó trong một VM, kết nối Telegram và đưa trợ lý trực tiếp đầu tiên của bạn lên mạng. Sau đó, bạn có thể cải thiện, mở rộng và cuối cùng chuyển đến VPS để thiết lập sản xuất hoàn chỉnh.

Nếu bạn muốn, tôi cũng có thể chia sẻ một hướng dẫn tiếp theo về:

• cách cải thiện danh tính của trợ lý

• cách di chuyển từ VM đến VPS

• cách biến nó thành một trợ lý nội dung và nghiên cứu crypto

🙏Nếu bạn xây dựng phiên bản của riêng mình, hãy chia sẻ kết quả của bạn trong phần bình luận — tôi rất muốn xem nó.

Nếu điều này hữu ích, hãy chia sẻ lại để giúp nhiều người bắt đầu xây dựng với AI. Và cho tôi biết bạn muốn gì tiếp theo: triển khai VPS, quy trình làm việc Telegram, thiết kế câu lệnh, hay tích hợp kỹ năng Binance?

#OPENCLAW #AIAssistant #BuildWithYou