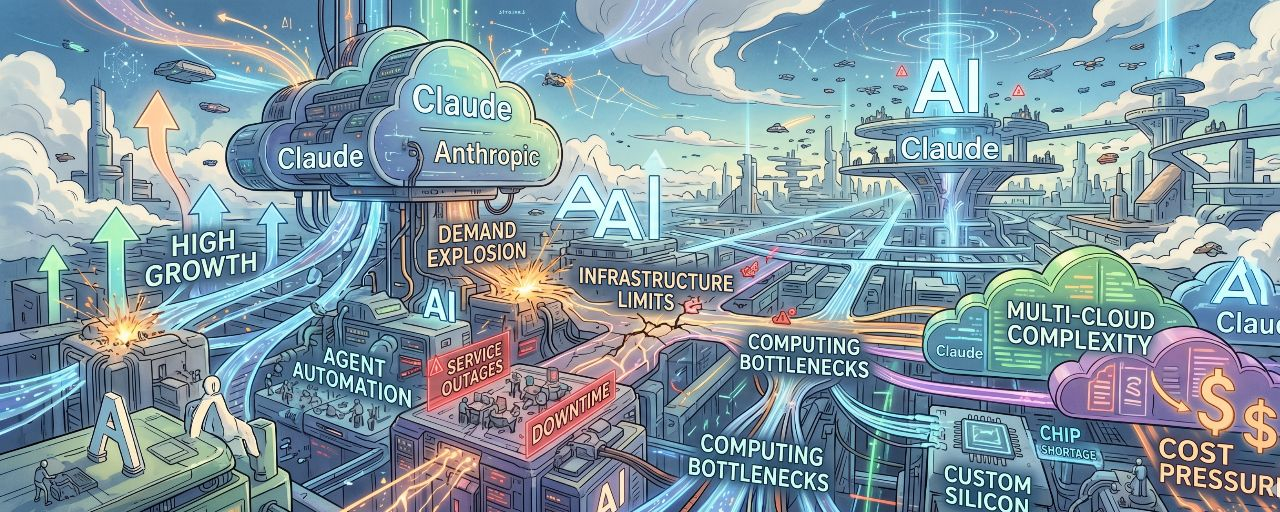

2026年春天,一次持续数小时的服务中断,让Anthropic再次被推上舆论中心。

对于大量依赖Claude进行编程、写作与自动化工作的用户来说,这不仅是一次普通故障,更像是一场突如其来的“生产力停摆”。但如果把目光停留在“宕机”本身,就会错过更重要的信号——这场波动背后,隐藏的是AI行业正在全面爆发的算力矛盾。

而更值得注意的是:

Anthropic并不是在“掉队”,而是在高速增长中撞上了基础设施的极限。

宕机只是表象,需求爆炸才是本质

类似的系统故障,并非Anthropic独有。

无论是OpenAI还是Google,都在大模型发布或用户激增阶段经历过不同程度的服务不稳定。这类问题往往源于复杂的分布式系统:

· 流量突增

· 推理负载失衡

· 调度系统瓶颈

· 多云架构切换

因此,把宕机简单归因为“算力不够”,是一种过度简化。

但问题在于:

为什么这类故障正在变得更频繁、更剧烈?

答案是:AI的使用方式正在发生结构性变化。

从“对话工具”到“算力黑洞”

早期AI产品是轻量级的:

· 提问

· 回答

· 结束

但现在,以Claude Code为代表的新一代AI系统已经变成:

· 持续执行复杂任务(数小时)

· 多轮推理与决策

· 自动调用工具链

这带来一个根本变化:

AI不再是“瞬时调用”,而是“持续占用算力的进程”

结果是:

· 单用户消耗暴涨

· 企业客户成为算力核心消耗者

· 系统负载从线性增长变为指数放大

这才是“频繁宕机”的真正背景。

爆炸式增长:Anthropic真正的竞争力来源

如果只看故障,很容易误判Anthropic的状态。但一旦引入收入数据,结论会彻底改变。

根据公开信息:

· 2025年底:年化收入约 90亿美元

· 2026年:已超过 300亿美元

这意味着什么?

一年内增长超过3倍

更关键的是,这种增长并非“虚热”,而是来自高价值场景:

· 代码生成

· Agent自动化

· 企业级AI服务

与之对比:

· OpenAI更偏消费端规模

· Anthropic更偏企业与开发者市场

这带来一个重要差异:

Anthropic的用户不一定最多,但“每个用户更值钱”

为什么越成功,问题越严重?

这正是AI行业最反直觉的一点:

需求越强,公司反而越容易遇到瓶颈

原因在于三重压力。

1)算力供应被“卡脖子”

当前AI算力高度依赖:

· NVIDIA GPU

· Google TPU

· Amazon Trainium

这意味着:

· 成本不可控

· 供货受限

· 扩张速度被外部决定

本质上,AI公司是在“租用别人的计算能力”。

2)成本结构正在吞噬增长

AI商业模式有一个核心矛盾:

收入增长 ≠ 利润增长

特别是在Agent时代:

· 任务持续执行

· Token消耗巨大

· 推理成本长期累积

结果是:

用户越多、用得越狠,成本增长更快

3)订阅制逻辑失效

传统SaaS假设:

用户用不满额度

但AI现实是:

重度用户会“榨干系统”

因此Anthropic开始:

· 从订阅 → 按量计费

· 限制高强度使用

· 强化账户控制

本质是在做一件事:

把极端算力消耗者单独收费

自研芯片:不是救火,而是争夺未来

在这样的背景下,Anthropic开始探索自研芯片。

但必须澄清:

这不是为了避免宕机

现实情况是:

· 项目仍处极早期

· 尚未确定设计方案

· 周期至少3–5年

· 成本约5亿美元起步

这说明:

自研芯片是长期战略,而非短期补救

为什么AI巨头都在做同一件事?

不仅Anthropic:

· Meta

· OpenAI

都在推进定制芯片或ASIC。

原因只有两个:

1)成本优势

· 总成本降低30%–50%

· 单位功耗性能显著提升

2)控制权

更关键的是:

谁掌握芯片,谁掌握AI的上限

如果长期依赖外部:

· 扩张受限

· 成本不可控

· 战略被动

多云多芯:现实中的“过渡解法”

在自研芯片落地前,Anthropic采取的是:

多供应商并行策略

当前部署包括:

· NVIDIA GPU

· Google TPU

· Amazon芯片

优势:

· 分散风险

· 提高弹性

· 优化成本

但代价是:

· 系统复杂度激增

· 调度难度上升

· 稳定性挑战更大

某种程度上,这正是故障频发的技术背景之一。

行业正在发生的真正变化

把所有线索串起来,可以看到AI竞争正在发生转变:

第一阶段(过去)

· 拼模型规模

· 拼参数数量

第二阶段(现在)

· 拼推理效率

· 拼成本控制

第三阶段(未来)

· 拼芯片

· 拼数据中心

· 拼能源与基础设施

结论:

AI竞争正在从“算法问题”,转变为“工业体系竞争”

结语:增长与瓶颈的共生

Claude的宕机,不是一个孤立事件。

它揭示的是一个更深层的现实:

· 模型能力已经成熟

· 商业需求开始爆发

· 算力成为核心瓶颈

而Anthropic的处境,恰恰说明了它的竞争力:

不是因为做得不好才出问题,而是因为做得太成功

年化收入从90亿美元跃升至300亿美元,意味着它已经跨过了AI公司最难的一道门槛——从技术验证走向规模化商业。

但接下来的问题也更加残酷:

如何把爆炸式需求,转化为可持续交付能力?

在这个问题解决之前:

· 宕机

· 涨价

· 使用限制

都不会消失。

因为真正的矛盾从来不是:

“系统有没有准备好”

而是:

人类第一次面对一个需求增长速度,超过算力供给速度的技术系统