@Mira - Trust Layer of AI #Mira

@Mira - Trust Layer of AI #Mira

Wenn Menschen über die Verbesserung von KI sprechen, beginnt das Gespräch normalerweise mit größeren Modellen, mehr Trainingsdaten oder schnellerer Inferenz. Meine erste Reaktion auf diese Sichtweise ist Skepsis. Nicht, weil diese Dinge nicht wichtig sind, sondern weil sie das ruhigere Problem unter den meisten KI-Systemen heute übersehen: die Interpretation. KI kann enorme Mengen an Ausgaben produzieren, aber die eigentliche Frage ist, ob jemand zuverlässig vertrauen kann, was diese Ausgaben bedeuten.

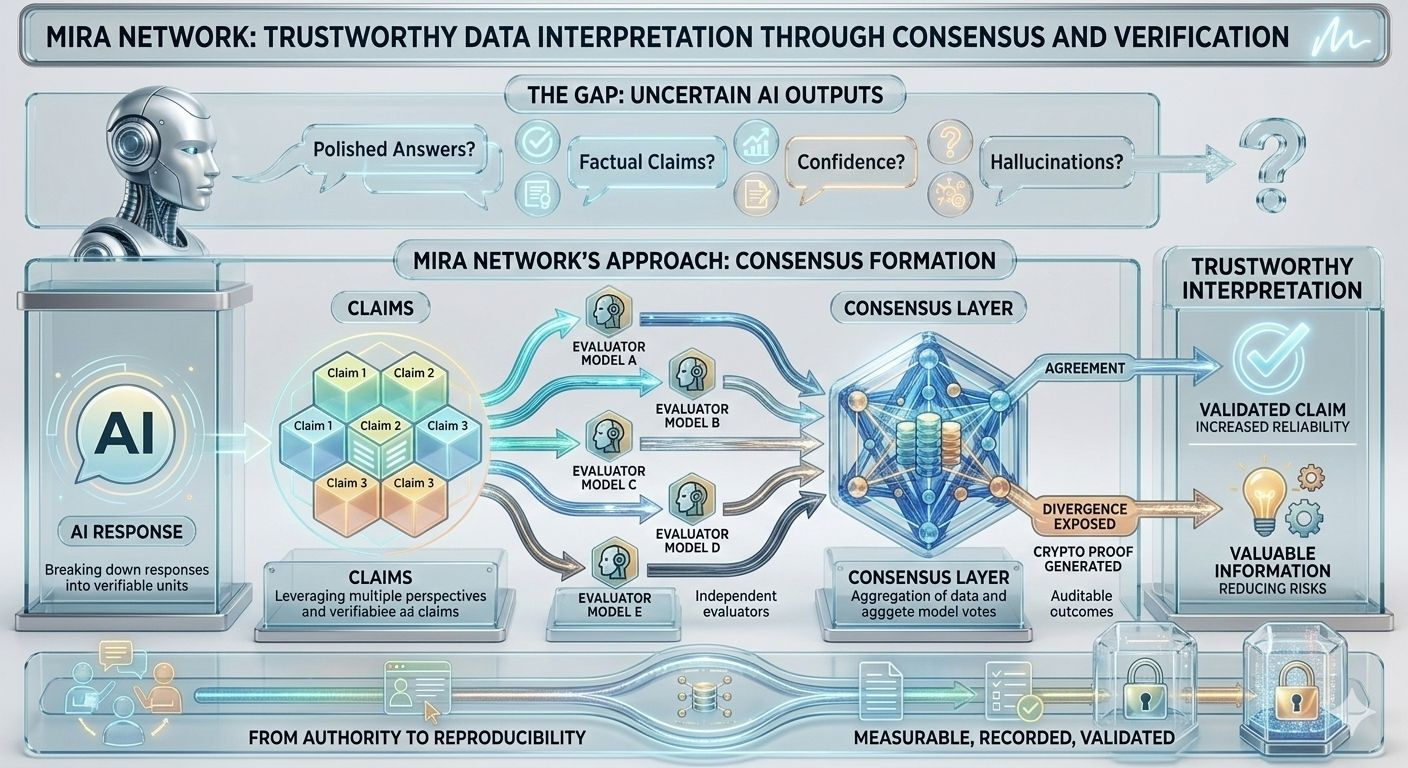

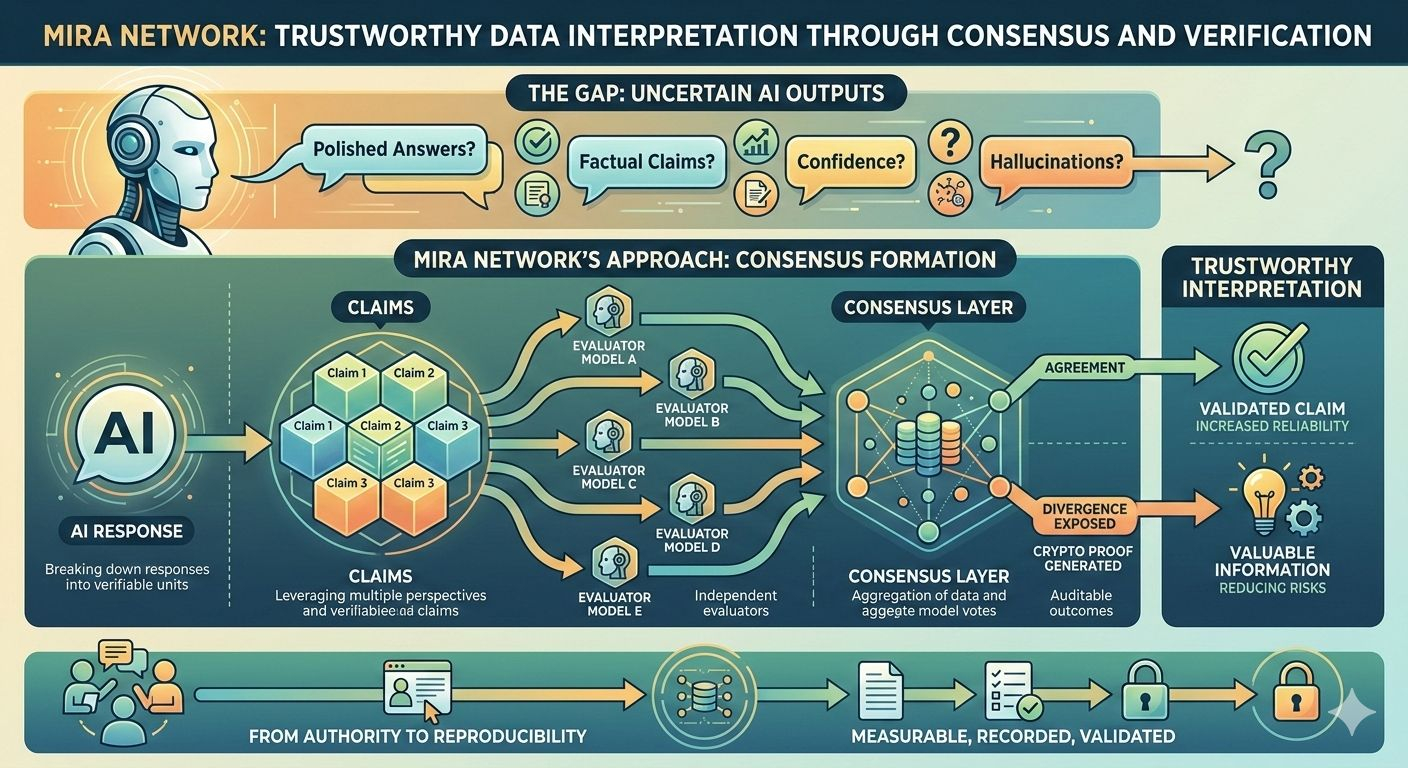

Das ist die Lücke, die vertrauenswürdige Interpretation zu schließen versucht. Die Herausforderung besteht nicht nur darin, dass Modelle gelegentlich halluzinieren; es ist, dass Benutzer selten einen klaren Weg haben, um zu überprüfen, ob eine spezifische Behauptung, die von einem KI-System erzeugt wurde, geglaubt werden sollte. Wenn eine Antwort poliert und selbstbewusst erscheint, ist es leicht zu vergessen, dass das System, das sie produziert, möglicherweise aus unsicheren Mustern und nicht aus überprüfbaren Fakten schöpft.

Die meisten aktuellen KI-Einführungen betrachten diese Unsicherheit als akzeptablen Kompromiss. Wenn eine Antwort vernünftig aussieht und schnell eintrifft, gilt das System als erfolgreich. Aber sobald KI beginnt, finanzielle Entscheidungen, automatisierte Abläufe oder Governance-Prozesse zu unterstützen, hört „vernünftig aussehend“ auf, gut genug zu sein. Die Interpretation wird zu einem Infrastrukturproblem statt zu einer kosmetischen Verbesserung.

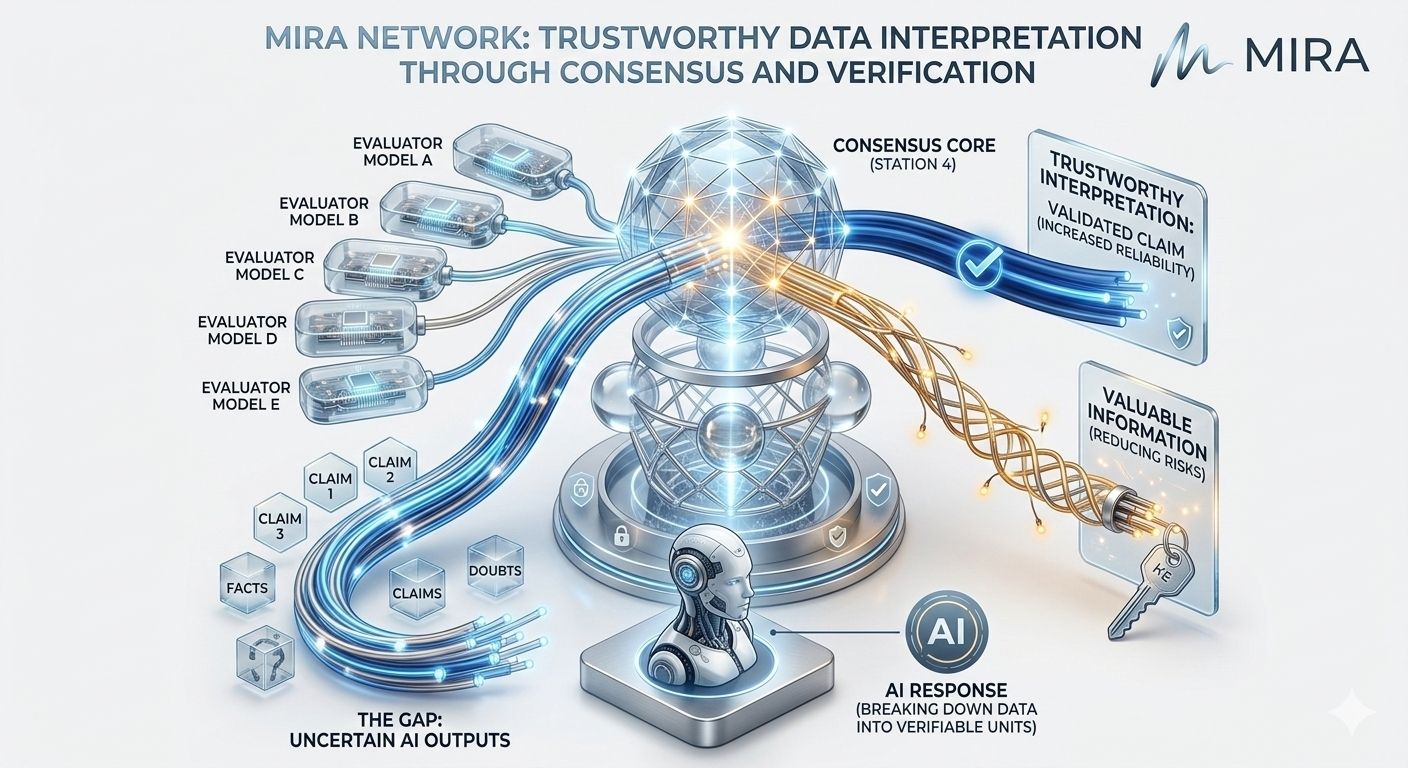

Hier führt Mira Network einen anderen Ansatz ein. Anstatt eine KI-Antwort als ein einzelnes Ausgabestück zu behandeln, zerlegt das System sie in kleinere Ansprüche, die unabhängig bewertet werden können. Jeder Anspruch kann dann über mehrere Modelle hinweg untersucht werden, sodass das Netzwerk Interpretationen vergleichen kann, anstatt sich auf eine einzige Quelle der Argumentation zu verlassen.

Wenn man darüber nachdenkt, wird die Dateninterpretation nicht mehr zu einer Aufgabe eines einzelnen Modells, sondern sieht eher wie eine Konsensbildung aus. Wenn mehrere unabhängige Systeme denselben Anspruch bewerten und zu ähnlichen Schlussfolgerungen gelangen, steigt die Wahrscheinlichkeit der Zuverlässigkeit. Wenn ihre Interpretationen divergieren, wird die Uneinigkeit selbst zu wertvollen Informationen.

Aber der interessante Teil ist nicht nur die Verifizierung – es ist, wie der Verifizierungsprozess strukturiert wird. Die Umwandlung von Ansprüchen in überprüfbare Einheiten bedeutet, dass die Interpretation gemessen, aufgezeichnet und validiert werden kann. Anstatt einem Vertrauenswert eines Modells zu vertrauen, interagieren die Nutzer mit einem System, das kryptografische Beweise liefert, dass mehrere Bewerter die Informationen geprüft haben.

Natürlich wirft dies eine weitere Frage auf: Wer führt diese Bewertungsarbeit durch? In einem dezentralisierten Verifizierungsnetzwerk verschiebt sich die Rolle von einem einzelnen zentralisierten KI-Anbieter zu einer verteilten Gruppe von Teilnehmern, die verschiedene Modelle betreiben. Jeder Teilnehmer trägt zur Analyse bei, und das Netzwerk aggregiert die Ergebnisse zu einer konsensbasierten Interpretation.

Dieser Wandel ändert die Anreize hinsichtlich der Datenzuverlässigkeit. In traditionellen KI-Diensten vertrauen die Nutzer implizit dem Anbieter, der das Modell betreibt. Mit einer Verifizierungsschicht wird das Vertrauen auf unabhängige Bewerter verteilt, deren Schlussfolgerungen übereinstimmen müssen, um einen Anspruch zu validieren. Das System wird weniger über Autorität und mehr über Reproduzierbarkeit.

Natürlich sind die Mechanismen hinter diesem Prozess sehr wichtig. Ansprüche müssen klar genug strukturiert sein, um unabhängig bewertet werden zu können. Bewerter müssen Anreize haben, genaue Urteile abzugeben, anstatt einfach der Mehrheit zuzustimmen. Und das Netzwerk benötigt eine Möglichkeit, Ergebnisse transparent aufzuzeichnen, sodass die Interpretation im Laufe der Zeit überprüfbar bleibt.

Diese Details sind der Punkt, an dem die Interpretation von Konzept zu Infrastruktur übergeht. Verifizierung geht nicht nur darum, Fakten zu überprüfen; es geht darum, ein System zu entwerfen, in dem mehrere Perspektiven auf eine zuverlässige Antwort convergieren können, ohne von einem einzigen Gatekeeper abhängig zu sein. Wenn diese Infrastruktur gut funktioniert, verbessert sich die Zuverlässigkeit der KI-Ausgaben, ohne die Systeme, die sie generieren, zu verlangsamen.

Es gibt auch eine breitere Implikation, die oft übersehen wird. Sobald die KI-Interpretation überprüfbar wird, öffnet sie die Tür zu Automatisierung in Bereichen, die zuvor menschliche Aufsicht erforderten. Autonome Systeme könnten validierte Ansprüche anstelle von Rohmodell-Ausgaben heranziehen, wodurch das Risiko reduziert wird, dass eine einzelne Halluzination einen gesamten Arbeitsablauf stört.

Das bedeutet nicht, dass die Verifizierung die Unsicherheit vollständig beseitigt. Uneinigkeit zwischen Modellen wird weiterhin auftreten, und das Netzwerk muss entscheiden, wie diese Konflikte gelöst werden. Aber selbst dieser Prozess kann wertvoll sein, da er Mehrdeutigkeit offenbart, anstatt sie hinter einer einzigen, selbstbewussten Antwort zu verbergen.

Im Laufe der Zeit wird das eigentliche Maß für den Erfolg von Systemen wie Mira Network nicht einfach darin bestehen, ob sie KI-Ausgaben unter normalen Bedingungen korrekt verifizieren. Der echte Test wird kommen, wenn die Daten unordentlich sind, Modelle stark widersprechen oder Anreize die Teilnehmer zur Manipulation drängen. Vertrauenswürdige Interpretation ist nur dann von Bedeutung, wenn sie weiterhin funktioniert, wenn die Informationsumgebung kompliziert wird.

Die wichtigste Frage ist also nicht, ob KI Antworten schneller oder flüssiger generieren kann. Die Frage ist, ob das Ökosystem Systeme schaffen kann, die diese Antworten auf eine Weise interpretieren, die Menschen überprüfen, auditen und auf die sie sich verlassen können. Denn in einer Welt, die zunehmend von automatisierten Entscheidungen geprägt ist, könnte der Unterschied zwischen Informationen und vertrauenswürdiger Interpretation die wichtigste Ebene von allen sein.