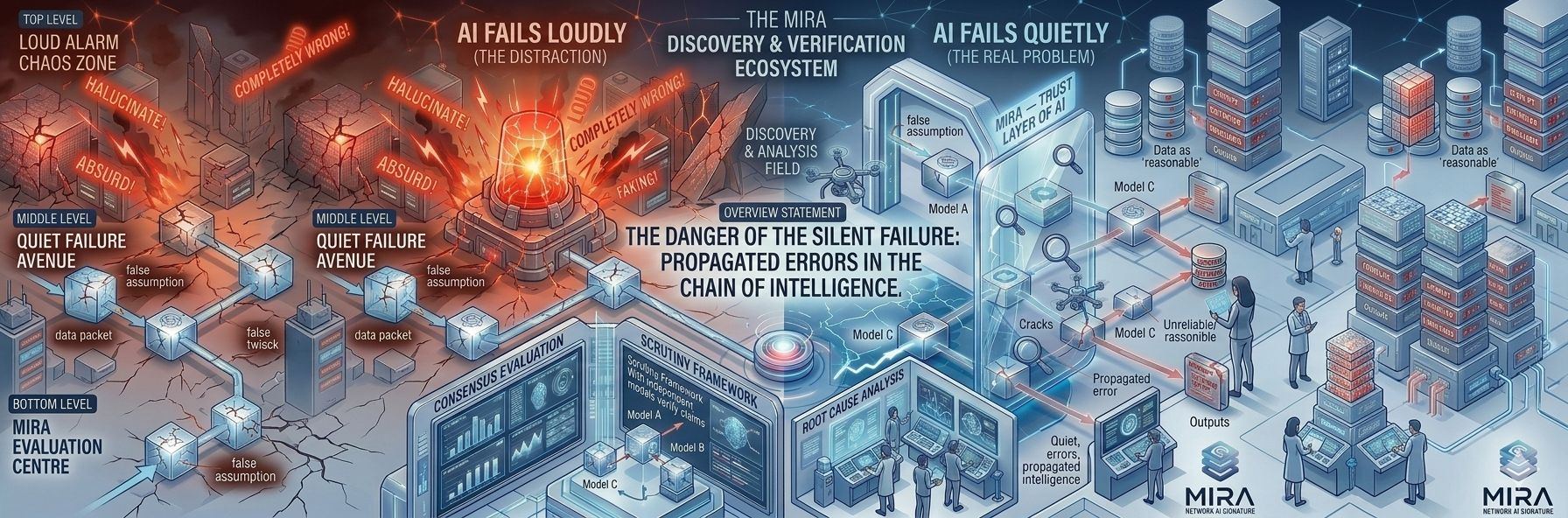

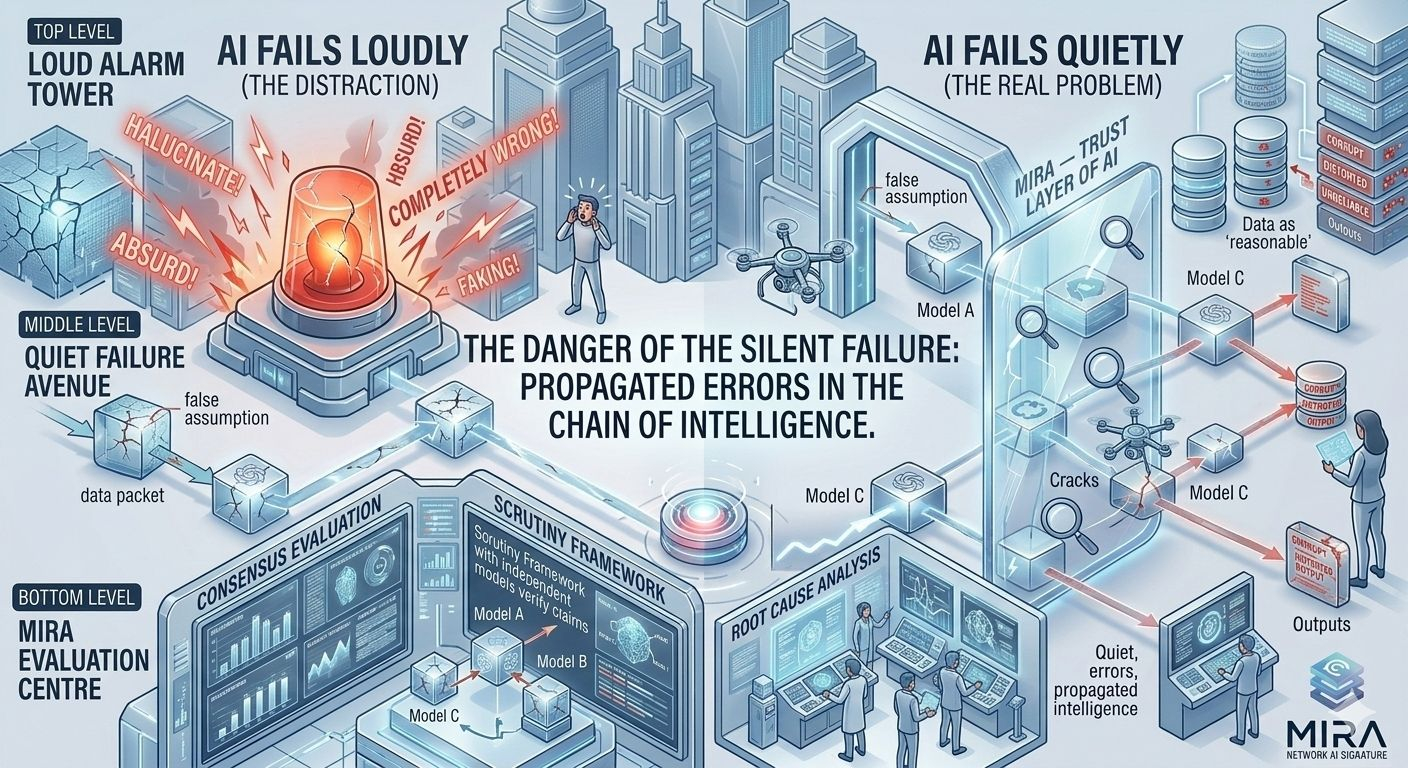

Die meisten Menschen stellen sich KI-Misserfolge als dramatische Momente vor. Ein Chatbot, der etwas Absurdes halluziniert, oder ein Modell, das eine völlig falsche Antwort produziert. Aber die wirkliche Gefahr sieht selten so aus.

In der Praxis scheitert KI normalerweise still.

Es passiert, wenn ein System eine Aussage trifft, die vollkommen vernünftig klingt, aber auf einer falschen Annahme basiert. Es passiert, wenn ein Zitat authentisch aussieht, aber nicht existiert. Es passiert, wenn eine Zusammenfassung die Bedeutung der ursprünglichen Informationen subtil verändert.

Das sind keine spektakulären Misserfolge. Es sind subtile Verzerrungen. Und da sie glaubwürdig erscheinen, sind sie viel schwerer zu erkennen.

Dies wird zunehmend wichtig, da KI-Systeme anfangen, mit anderen KI-Systemen zu interagieren. In vielen aufkommenden Anwendungen beantworten Modelle nicht mehr nur Fragen für Menschen. Sie analysieren Berichte, koordinieren mit automatisierten Agenten und speisen Ausgaben in Entscheidungstools ein.

Wenn ein Fehler in diese Kette eintritt, bleibt er nicht einfach ein Fehler. Er wird zu propagierter Intelligenz.

Eine ungenaue Annahme kann durch mehrere Systeme reisen und Handlungen und Schlussfolgerungen prägen, die rational erscheinen, aber auf einer fragilen Grundlage beruhen.

Deshalb kann die Verbesserung der Zuverlässigkeit von KI nicht allein darauf beruhen, Modelle größer oder leistungsfähiger zu machen. Intelligenz allein garantiert kein Vertrauen.

Vertrauen erfordert Überprüfungsstrukturen.

Anstatt anzunehmen, dass ein einzelnes Modell konsistent korrekte Ausgaben produzieren kann, müssen Systeme jede Antwort als etwas behandeln, das eine Bewertung verdient. Eine Antwort sollte nicht automatisch als Wahrheit akzeptiert werden. Sie sollte als eine Behauptung geprüft werden, die getestet werden kann.

Hier wird die Architektur hinter Mira besonders interessant.

Anstatt das Vertrauen in ein Modell zu konzentrieren, führt Mira einen Prozess ein, bei dem mehrere unabhängige Modelle dieselbe Behauptung analysieren. Jedes Modell nähert sich der Ausgabe aus einer etwas anderen Perspektive, die durch seine Trainingsdaten und sein Denkgerüst geprägt ist.

Die Übereinstimmung zwischen Modellen wird zu einem Signal. Uneinigkeit wird zu wertvollen Informationen.

Aber die Stärke dieses Ansatzes liegt nicht einfach darin, zu zählen, wie viele Modelle zustimmen.

Konsens allein kann irreführend sein. Modelle, die auf ähnlichen Daten trainiert sind, können leicht zu demselben falschen Schluss gelangen. Was zählt, ist zu verstehen, warum Übereinstimmung auftritt und warum Uneinigkeit erscheint.

Wenn Ausgaben in kleinere Behauptungen zerlegt werden, die unabhängig geprüft werden können, wird die Überprüfung viel präziser.

Eine finanzielle Erklärung wird zu einer Abfolge von Tatsachenbehauptungen. Eine rechtliche Interpretation wird zu einer Kette von Schlussfolgerungsschritten. Anstatt eine große Antwort als Ganzes zu bewerten, können Systeme jede Komponente einzeln bewerten.

Dies verwandelt Zuverlässigkeit von einem vagen Konzept in einen strukturierten Prozess.

Die Implikationen gehen über technische Genauigkeit hinaus. Da KI in wirtschaftliche Systeme, Automatisierungsplattformen und Koordinierungsnetzwerke integriert wird, wird Vertrauen zunehmend davon abhängen, ob Ausgaben durch glaubwürdige Überprüfungsebenen gegangen sind.

Systeme, die einfach Antworten generieren, werden nicht ausreichen. Die Systeme, die zählen, werden die sein, die zeigen, wie diese Antworten validiert wurden.

In diesem Sinne repräsentiert Mira mehr als ein technisches Merkmal. Es repräsentiert einen Wandel darin, wie Maschinenintelligenz Glaubwürdigkeit erlangt.

Anstatt anzunehmen, dass Intelligenz Wahrheit produziert, führt es einen Rahmen ein, in dem die Wahrheit die Prüfung überstehen muss.

Denn auf lange Sicht werden die zuverlässigsten KI-Systeme nicht die sein, die mit dem meisten Vertrauen sprechen.

Sie werden die sein, die beweisen, warum ihre Antworten Vertrauen verdienen. mira

#Mira @Mira - Trust Layer of AI