Wenn Menschen über Vertrauen in die Robotik sprechen, springt das Gespräch normalerweise zu Sicherheitsprotokollen oder fortschrittlicher Hardware. Meine erste Reaktion ist anders. Vertrauen in autonome Maschinen scheitert selten, weil die Roboter unfähig sind. Es scheitert, weil die Systeme um sie herum—Datenflüsse, Governance und Verantwortlichkeit—unklar sind. Ohne eine Struktur, die definiert, wer Entscheidungen kontrolliert und wie diese Entscheidungen überprüft werden, bleiben selbst die fortschrittlichsten Roboter schwer zu vertrauen.

Wenn Menschen über Vertrauen in die Robotik sprechen, springt das Gespräch normalerweise zu Sicherheitsprotokollen oder fortschrittlicher Hardware. Meine erste Reaktion ist anders. Vertrauen in autonome Maschinen scheitert selten, weil die Roboter unfähig sind. Es scheitert, weil die Systeme um sie herum—Datenflüsse, Governance und Verantwortlichkeit—unklar sind. Ohne eine Struktur, die definiert, wer Entscheidungen kontrolliert und wie diese Entscheidungen überprüft werden, bleiben selbst die fortschrittlichsten Roboter schwer zu vertrauen.

Für die meisten Robotik-Ökosysteme heute ist Governance ein nachträglicher Gedanke. Maschinen sammeln Daten, führen Modelle aus und führen Aktionen durch, aber die Rahmenbedingungen, die Eigentum und Verantwortung koordinieren, sind oft fragmentiert. Unternehmen kontrollieren die Hardware, Entwickler kontrollieren die Software, und Benutzer sind gezwungen, Systemen zu vertrauen, die sie nicht überprüfen können. Das Ergebnis ist eine Kluft zwischen dem, was Roboter technisch tun können und dem, was die Menschen ihnen erlauben zu tun.

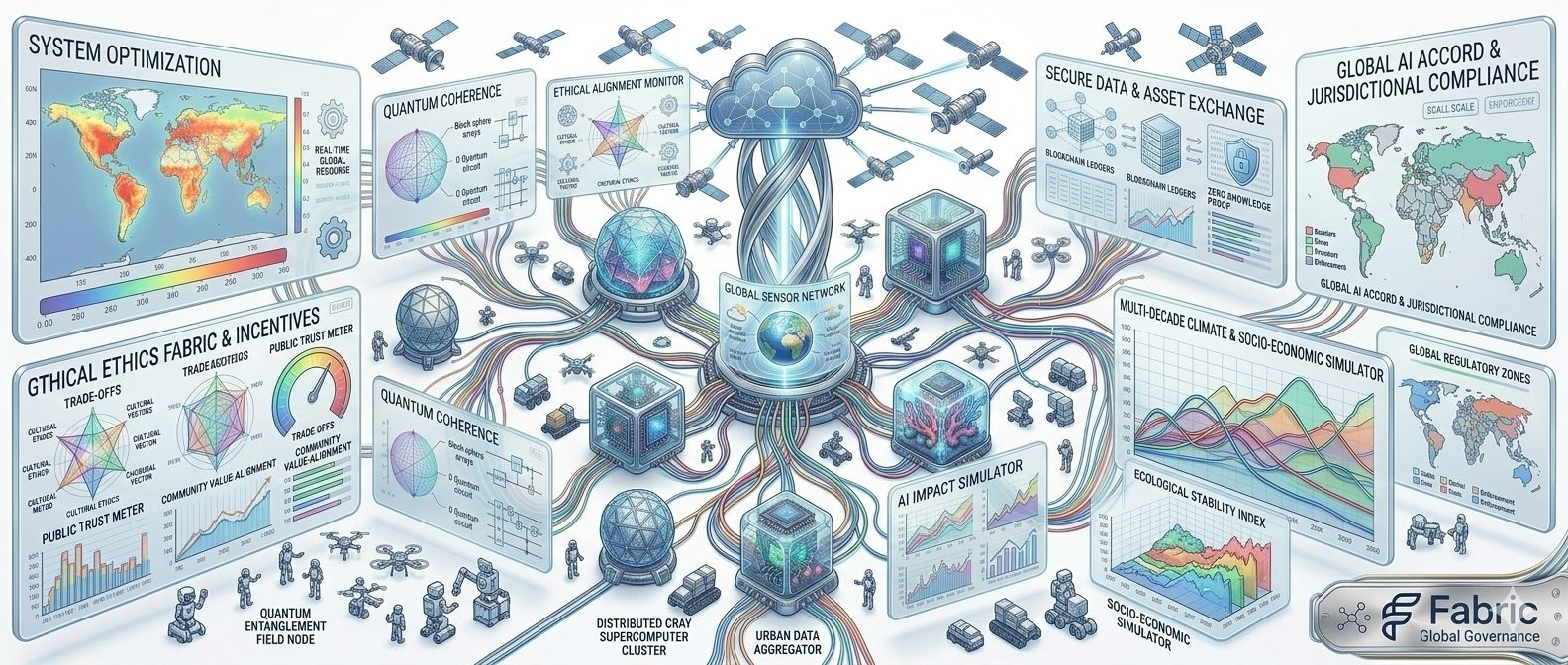

Dies ist der Ort, an dem das Modell hinter der Fabric Foundation anders aussieht. Anstatt Roboter als isolierte Geräte zu behandeln, betrachtet der Fabric-Ansatz sie als Teilnehmer in einem koordinierten Netzwerk. Datenberechnung und Governance werden durch überprüfbare Infrastruktur organisiert, anstatt durch geschlossene Systeme. Der Roboter führt nicht nur Befehle aus; er arbeitet in einem Rahmen, in dem Aktionen, Entscheidungen und Ergebnisse validiert werden können.

Dieser Wandel verändert, wie Vertrauen produziert wird. In traditionellen Robotik-Einsätzen geschieht die Überprüfung normalerweise intern. Protokolle existieren, aber sie werden von derselben Einheit kontrolliert, die die Maschinen betreibt. Wenn etwas schiefgeht, beruht der Nachweis, was passiert ist, oft auf zentralisierten Aufzeichnungen. Das Modell von Fabric führt eine andere Ebene ein – eine, in der robotische Aktivitäten durch gemeinsame Infrastruktur koordiniert und überprüft werden können, anstatt durch private Aufsicht.

Natürlich existieren Überprüfungssysteme nicht isoliert. Sobald Sie ein Netzwerk schaffen, das Maschinen durch überprüfbares Computing koordiniert, taucht eine neue Reihe von operationellen Fragen auf. Wer regiert Updates zu robotischen Verhaltensweisen? Wie werden Datenbeiträge validiert? Wie arbeiten mehrere Interessengruppen zusammen, ohne die Kontrolle an einen einzelnen Betreiber abzugeben?

Diese Fragen sind wichtig, weil die Robotik in eine Phase eintritt, in der die Autonomie schnell zunimmt. Lagerhäuser, Logistiksysteme und industrielle Umgebungen integrieren bereits Flotten von Maschinen, die mit realen Vermögenswerten interagieren. Wenn Dutzende oder Hunderte von Robotern Aufgaben koordinieren, geht es bei der Governance weniger darum, ein einzelnes Gerät zu kontrollieren, sondern mehr darum, ein ganzes System von Agenten zu managen, die gleichzeitig handeln.

Das Design von Fabric versucht, dem entgegenzuwirken, indem es Governance-Mechanismen direkt in die Infrastrukturebene einführt. Anstatt Robotik von der Netzwerkkoordination zu trennen, vereint es beides. Datensammlung, rechnerische Arbeit und Durchsetzung von Richtlinien werden durch eine öffentliche Ledger-Umgebung organisiert, die es ermöglicht, Entscheidungen über Teilnehmer hinweg zu verfolgen und zu validieren.

Der interessante Teil ist nicht nur die Transparenz, sondern auch der Wandel der Anreize. Wenn die Aktivitäten von Maschinen überprüfbar werden und durch gemeinsame Infrastruktur geregelt werden, können Mitwirkende – Entwickler, Betreiber und Organisationen – zusammenarbeiten, ohne sich ausschließlich auf institutionelles Vertrauen zu verlassen. Das System selbst bietet die Prüfbarheit, die normalerweise zentrale Kontrolle erfordert.

Aber die Einführung von Governance in Robotiknetzwerke verändert auch, wo Risiken auftreten. In einem geschlossenen System sind Fehler normalerweise lokal. Ein Roboter hat eine Fehlfunktion, ein Modell produziert falsche Ausgaben oder ein Sensor liefert ungenaue Messwerte. Diese Probleme sind ernst, tendieren jedoch dazu, innerhalb der Organisation, die die Maschinen betreibt, begrenzt zu bleiben.

In einem offenen, koordinierten Netzwerk verschieben sich die Risiken nach oben. Governance-Streitigkeiten, fehlerhafte Überprüfungsmechanismen oder schlecht gestaltete Koordinationsregeln können das Verhalten vieler Maschinen gleichzeitig beeinflussen. Anstatt einen einzelnen Roboter zu debuggen, müssen Betreiber möglicherweise systemische Probleme angehen, die ein ganzes Netzwerk autonomer Agenten betreffen.

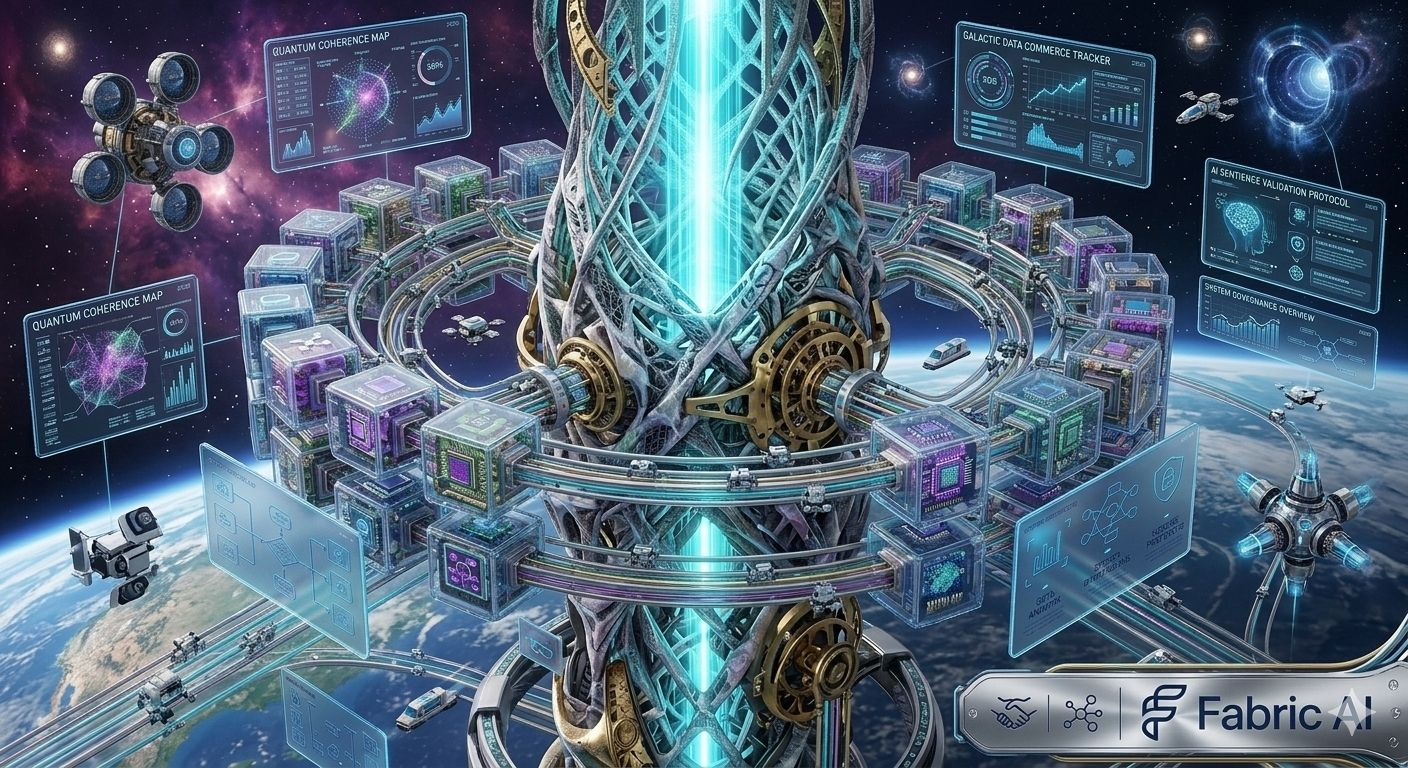

Das macht das Modell nicht schwächer. In vielerlei Hinsicht macht es das System realistischer. Wenn die Robotik über isolierte Einsätze hinaus expandiert, wird die Koordination zunehmend zwischen Organisationen und nicht nur innerhalb dieser stattfinden. Ein Roboter, der Waren liefert, Infrastruktur inspiziert oder Umweltdaten sammelt, kann mit mehreren Entitäten interagieren, die jeweils ihre eigenen Anreize haben.

Deshalb wird Governance zu einem grundlegenden Problem und nicht zu einem peripheren. Vertrauen in Robotik hängt nicht nur davon ab, ob eine Maschine eine Aufgabe ausführen kann. Es geht darum, ob das Ökosystem um diese Maschine Rechenschaft durchsetzen, Streitigkeiten lösen und einen zuverlässigen Betrieb aufrechterhalten kann, während die Komplexität wächst.

Der Ansatz von Fabric legt nahe, dass die Zukunft der Robotik weniger wie eine Sammlung proprietärer Maschinen aussieht und mehr wie ein koordiniertes Netzwerk autonomer Agenten. In dieser Umgebung wird Vertrauen nicht nur durch technische Präzision geschaffen. Es entsteht aus transparenten Systemen, die definieren, wie Maschinen zusammenarbeiten, wie ihre Arbeit überprüft wird und wie Entscheidungen über ihr Verhalten geregelt werden.

Der echte Test dieses Modells wird nicht kommen, wenn alles reibungslos läuft. Jedes System kann vertrauenswürdig erscheinen, wenn die Bedingungen stabil sind. Die echte Frage ist, wie sich die Governance-Ebene verhält, wenn der Druck steigt – wenn Maschinen widersprüchliche Daten produzieren, wenn Anreize divergieren oder wenn Netzwerkteilnehmer sich darüber uneinig sind, wie Roboter arbeiten sollten.

Hier wird der langfristige Wert des Fabric-Modells letztendlich gemessen. Nicht daran, ob Roboter einem Netzwerk beitreten können, sondern daran, ob dieses Netzwerk Vertrauen aufrechterhalten kann, wenn die Komplexität der realen Koordination beginnt, das System an seine Grenzen zu bringen.@Fabric Foundation #ROBO